GLM-5.1

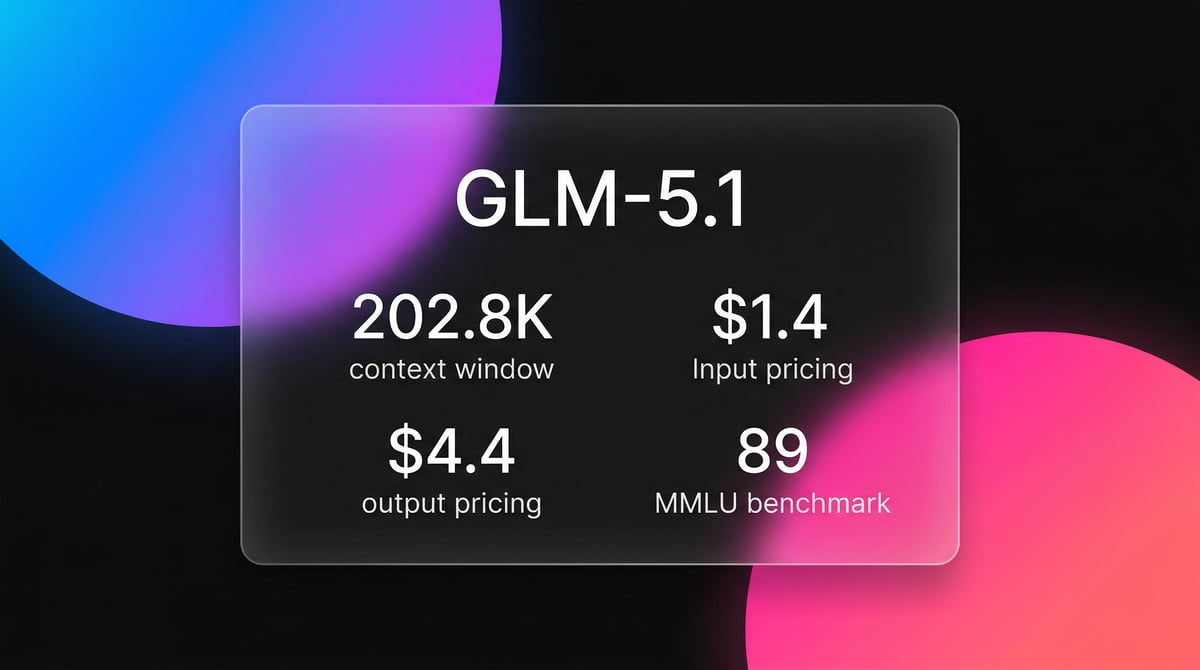

GLM-5.1 è il model di punta per il reasoning di Zhipu AI, dotato di una context window di 202K e di un ciclo di esecuzione autonomo di 8 ore per ingegneria...

Informazioni su GLM-5.1

Scopri le capacita di GLM-5.1, le funzionalita e come puo aiutarti a ottenere risultati migliori.

GLM-5.1 è il model di punta di Zhipu AI progettato per l'ingegneria di sistemi complessi e task agentic a lungo termine. Costruito su un'architettura Mixture-of-Experts (MoE) con 744 miliardi di parameters e 40 miliardi attivi per pass, rappresenta un salto significativo nella resistenza e nella risoluzione autonoma dei problemi. Il model è specificamente progettato per superare i plateau di reasoning visti nei precedenti large language models, mantenendo produttività e qualità del codice su migliaia di tool-call e centinaia di iterazioni. Identifica i blocchi, esegue esperimenti e adegua la propria strategia senza intervento umano.

Tecnicamente, GLM-5.1 eccelle come motore di reasoning primario in sistemi multi-agent. Gestisce decisioni architetturali di alto livello delegando l'implementazione a modelli più piccoli. Presenta una context window di 202K supportata da un meccanismo di attention sparsa dinamica, garantendo coerenza attraverso codebase massicce. Il model è rilasciato con open weights sotto licenza MIT, fornendo una valida alternativa locale ai modelli frontier proprietari per task come l'ottimizzazione di database, l'ingegneria di kernel GPU e lo sviluppo di applicazioni web full-stack.

I risultati di KernelBench Level 3 mostrano che GLM-5.1 mantiene un'accelerazione significativa nei carichi di lavoro ML agentic su turni lunghi rispetto a Claude Opus 4.6. Questa resistenza consente agli sviluppatori di attivare un task ingegneristico al mattino e ricevere un servizio completamente testato e distribuito entro la fine della giornata. Gestisce l'intero ciclo di vita di una correzione di bug, dalla riproduzione del problema in una sandbox all'invio della pull request finale.

Casi d'uso per GLM-5.1

Scopri i diversi modi in cui puoi usare GLM-5.1 per ottenere ottimi risultati.

Ingegneria Software Autonoma

Esegue task in autonomia per oltre 8 ore per progettare, implementare e debuggare microservizi senza guida umana.

Ottimizzazione di database ad alte prestazioni

Il model ottimizza iterativamente implementazioni di ricerca vettoriale basate su Rust nel corso di centinaia di cicli.

Ottimizzazione del kernel GPU

Analizza implementazioni di riferimento per produrre kernel GPU più veloci che superano i compilatori di autotuning predefiniti.

Orchestrazione Multi-Agent

Agisce come un nucleo di reasoning che coordina sottotask e tool-call attraverso uno sciame di modelli più piccoli e specializzati.

Task complessi da terminale

Esegue operazioni da terminale nel mondo reale e amministrazione di sistema in più passaggi tramite strumenti CLI agentic.

Web design Full-Stack

Il model genera layout UI visivamente coerenti e logica backend per ambienti desktop basati su browser.

Punti di forza

Limitazioni

Avvio rapido API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Ottimizza questo schema di database.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Installa l'SDK e inizia a fare chiamate API in pochi minuti.

Cosa dice la gente su GLM-5.1

Guarda cosa pensa la community di GLM-5.1

“GLM-5.1 è rimasto in loop su un prompt per 8 ore filate. Non si è arreso come fanno molti modelli; ha continuato ad aggiungere funzionalità e ad auto-revisionarsi.”

“L'ho testato fino a 140k di contesto non meno di 5 volte ed è rimasto coerente. Il SOTA potrebbe avere un rivale.”

“GLM-5.1 è praticamente testa a testa con Opus su questo benchmark. È diventato il #1 open model nell'Arena.”

“Ogni volta che vedo un NPC convincersi veramente attraverso un dialogo non scritto con GLM-5.1, è pura magia.”

“Le prestazioni nel coding sono legittime. Ha risolto una race condition nel nostro backend Go su cui GPT-4o continuava ad avere allucinazioni.”

“Eseguirlo localmente con Unsloth cambia le regole del gioco per la privacy dei dati nel nostro stack tecnologico legale.”

Video su GLM-5.1

Guarda tutorial, recensioni e discussioni su GLM-5.1

“GLM-5.1 ha ottenuto il 45,3% in questo benchmark, un salto sostanziale per la famiglia.”

“È un model incredibilmente lento... probabilmente hanno più GPU che servono ancora GLM-5.”

“Il modo in cui gestisce le tool-call è molto più robusto rispetto al GLM 5 standard.”

“Attualmente è il model di reasoning più potente che puoi scaricare ed eseguire sul tuo hardware.”

“Puoi vederlo identificare i propri errori nel log di pensiero.”

“Può operare autonomamente per 8 ore, perfezionando le strategie attraverso migliaia di iterazioni.”

“Supera Gemini 3.1 Pro e Qwen 3.6 Plus nei popolari benchmark di repo-generation.”

“La modalità agentic è dove questo model brilla davvero, non si arrende davanti ai bug difficili.”

“Z.ai ha praticamente eliminato il paywall su un model frontier-level da 744B di parametri.”

“Gestisce efficacemente il problema del 'plateau' dove altri LLM perdono concentrazione nel tempo.”

“Riduzione dell'80% delle dimensioni dall'originale 1,65TB a 236GB mantenendo la qualità.”

“Il potere dell'open source: anche in una versione quantizzata, ha scritto codice funzionante per i fuochi d'artificio.”

“Avrai bisogno di almeno 256GB di RAM di sistema solo per pensare di caricare questo gigante MoE.”

“Utilizza un meccanismo di attention sparsa dinamica per mantenere coerente quella context window di 202k.”

“Usare Unsloth rende il processo di training e inference significativamente più efficiente.”

Potenzia il tuo workflow con l'automazione AI

Automatio combina la potenza degli agenti AI, dell'automazione web e delle integrazioni intelligenti per aiutarti a fare di piu in meno tempo.

Consigli Pro per GLM-5.1

Consigli esperti per aiutarti a ottenere il massimo da GLM-5.1 e raggiungere risultati migliori.

Attiva la Modalità Thinking

Assicurati che l'opzione 'Thinking' sia abilitata nella tua configurazione per sbloccare le capacità di iterazione autonoma di 8 ore.

Usa le quote fuori dagli orari di punta

Esegui batch ingegneristici di grandi dimensioni al di fuori dell'orario di punta (14:00-18:00 ora di Pechino) per prezzi più vantaggiosi.

Requisiti di memoria locale

Usa la quantizzazione Unsloth Dynamic GGUF per far rientrare il model da 1,6TB in 256GB di RAM di sistema per esecuzioni locali.

Selezione strategica dei task

Riserva GLM-5.1 per il reasoning architetturale e utilizza GLM-4.7 per le implementazioni di routine per gestire i costi.

Testimonianze

Cosa dicono i nostri utenti

Unisciti a migliaia di utenti soddisfatti che hanno trasformato il loro workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Correlati AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Domande frequenti su GLM-5.1

Trova risposte alle domande comuni su GLM-5.1