Qwen3-Coder-Next

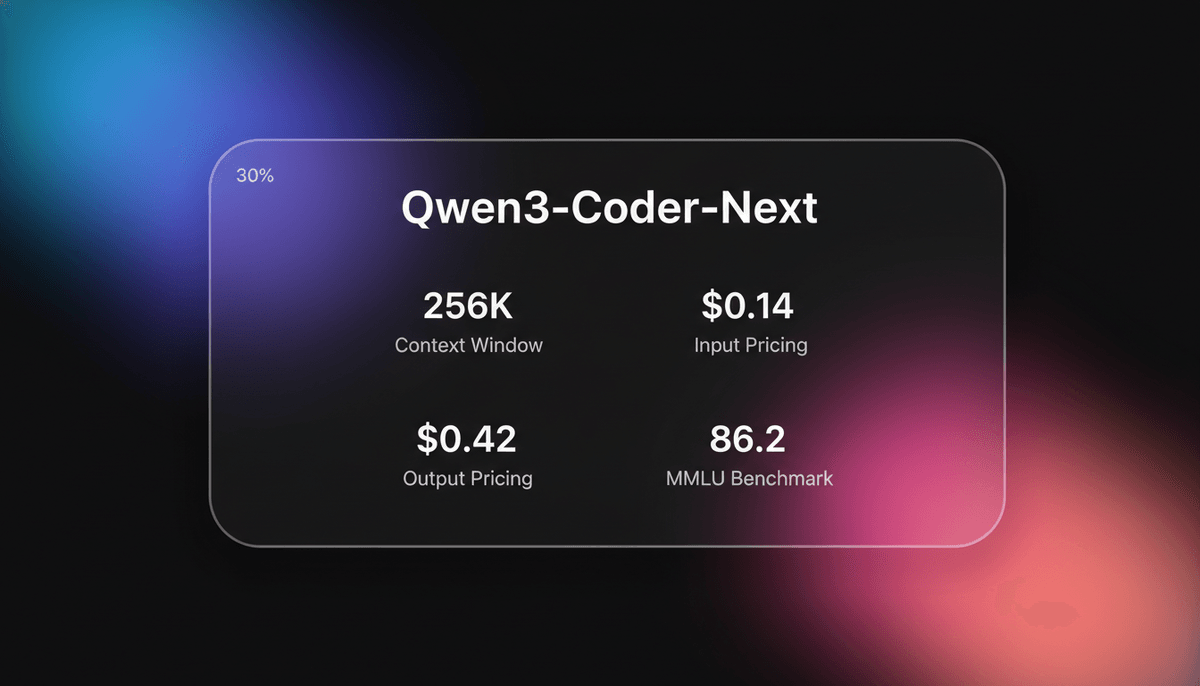

Qwen3-Coder-Next è il model di programmazione d'élite Apache 2.0 di Alibaba Cloud, dotato di un'architettura MoE da 80B e un context window da 256k per uno...

Informazioni su Qwen3-Coder-Next

Scopri le capacita di Qwen3-Coder-Next, le funzionalita e come puo aiutarti a ottenere risultati migliori.

Architettura del model

Qwen3-Coder-Next è un model open-weight specializzato progettato da Alibaba Cloud per agenti di ingegneria del software. Utilizza un'architettura Mixture-of-Experts (MoE) con 80 miliardi di parametri totali, ma attiva solo 3 miliardi di parametri per token. Questo design combina l'intelligenza di un model massiccio con la velocità di inference di uno piccolo. L'architettura include un meccanismo di attenzione ibrido, che integra Gated DeltaNet con la Gated Attention standard per elaborare contesti fino a 262.144 tokens.

Specializzazione agentic

Il model è addestrato su oltre 800.000 attività di programmazione verificabili e ambienti eseguibili. Questo addestramento enfatizza il reasoning a lungo raggio e la capacità di ripristino in caso di fallimenti dell'esecuzione. Ottiene un punteggio del 70,8% su SWE-Bench Verified, dimostrando la sua capacità di gestire attività di sviluppo in più fasi, dalla pianificazione iniziale all'esecuzione del codice finale. Eccelle in framework agentic autonomi come OpenClaw e Qwen Code.

Deployment e privacy

Concesso in licenza con Apache 2.0, questo model offre un'alternativa sicura per gli sviluppatori che necessitano di ambienti di sviluppo locali e privati. Può essere eseguito su hardware di classe consumer con RAM sufficiente tramite quantizzazione. L'elevato context window consente l'analisi a livello di repository senza il degrado delle prestazioni tipicamente riscontrato nei model con contesto più ridotto.

Casi d'uso per Qwen3-Coder-Next

Scopri i diversi modi in cui puoi usare Qwen3-Coder-Next per ottenere ottimi risultati.

Agenti di programmazione autonomi

Alimenta framework in grado di gestire attività di sviluppo in più fasi, dalla pianificazione all'esecuzione finale.

Sviluppo locale privato

Esegue assistenza alla programmazione d'élite su GPU consumer con 16GB di VRAM utilizzando layer MoE quantizzati.

Analisi di repository su larga scala

Elabora intere codebase all'interno della sua finestra da 256k per identificare il debito tecnico.

Riparazione e refactoring del codice

Aggiorna codice legacy agli standard moderni fornendo feedback in ambienti eseguibili.

Scripting multilingue

Genera codice ad alta fedeltà in oltre 40 linguaggi di programmazione, inclusi Rust e Go.

Simulazione 3D interattiva

Crea complessi visualizzatori e simulazioni basati sul web utilizzando una rapida generazione one-shot.

Punti di forza

Limitazioni

Avvio rapido API

alibaba/qwen-3-coder-next

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: "https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

});

async function main() {

const completion = await client.chat.completions.create({

model: "qwen3-coder-next",

messages: [

{ role: "system", content: "You are a professional coding assistant." },

{ role: "user", content: "Write a React component for a sortable list." },

],

});

console.log(completion.choices[0].message.content);

}

main();Installa l'SDK e inizia a fare chiamate API in pochi minuti.

Cosa dice la gente su Qwen3-Coder-Next

Guarda cosa pensa la community di Qwen3-Coder-Next

“Eguaglia quasi Claude nelle capacità di programmazione generali. Batte Claude 3.5 Sonnet su HumanEval al 92,7%.”

“L'efficienza della versione MoE è incredibile per l'hardware locale. Sto ottenendo 26 TPS su un sistema di fascia media.”

“Il self-speculative decoding è matematicamente impossibile per Qwen Coder Next a causa degli stati ricorrenti.”

“Qwen3-Coder-Next si basa su MoE ed è molto più forte e intelligente di prima!”

“Dimostra la capacità di cambiare provider a metà progetto con le nuove varianti di model da 480B.”

“La ricetta di addestramento agentic su 800k attività si nota nel modo in cui si riprende dagli errori di build.”

Video su Qwen3-Coder-Next

Guarda tutorial, recensioni e discussioni su Qwen3-Coder-Next

“Lo rende accessibile a chi vuole sperimentare con agenti di programmazione AI locali”

“Questo mi spinge a testare immediatamente questo model open code”

“L'efficienza della memoria in questo caso è un enorme vantaggio”

“Gestisce la logica complessa meglio del precedente model denso da 72B”

“È il primo model open che segue correttamente i miei comandi da terminale”

“Qwen 3 Coder Next ha solo 3 miliardi di parametri attivi per girare su schede video consumer”

“Funziona magnificamente. Sono davvero stupito di poter ottenere questo risultato in un colpo solo da una AI locale”

“80 miliardi di parametri di solito richiedono un cluster, ma l'approccio MoE cambia tutto”

“Gestisce oltre 40 linguaggi di programmazione senza alcun calo di prestazioni evidente”

“Usarlo con OpenClaw fa sembrare di avere un programmatore junior nel team”

“Un model da tre miliardi di parametri che sfida modelli da 10 a 20 volte la sua dimensione”

“Qwen 3 offre molti vantaggi ma con un costo inferiore”

“Il contesto da 256k è reale, non ha avuto allucinazioni nel mezzo del mio progetto”

“La latency è sorprendentemente bassa dato il peso totale di 80B di parametri”

“Ha corretto un bug nel mio repository Go legacy che GPT-4o aveva mancato tre volte”

Potenzia il tuo workflow con l'automazione AI

Automatio combina la potenza degli agenti AI, dell'automazione web e delle integrazioni intelligenti per aiutarti a fare di piu in meno tempo.

Consigli Pro per Qwen3-Coder-Next

Consigli esperti per aiutarti a ottenere il massimo da Qwen3-Coder-Next e raggiungere risultati migliori.

Utilizzare prompt di sistema lunghi

Fornisci al model esempi dettagliati e documentazione per allineare il suo comportamento agentic.

Feedback iterativo sugli errori

Invia i log di errore della console del browser al model per un'auto-correzione ad alto tasso di successo.

Ottimizzare lo scaricamento dei layer

Scarica specifici layer expert della MoE nella RAM di sistema per bilanciare la velocità di inference e il reasoning.

Allineare i parametri di campionamento

Utilizza una temperature di 1.0 con top_p 0.95 e top_k 40 per ottenere i risultati di programmazione più accurati.

Testimonianze

Cosa dicono i nostri utenti

Unisciti a migliaia di utenti soddisfatti che hanno trasformato il loro workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Correlati AI Models

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiniMax M2.5

minimax

MiniMax M2.5 is a SOTA MoE model featuring a 1M context window and elite agentic coding capabilities at disruptive pricing for autonomous agents.

GLM-4.7

Zhipu (GLM)

GLM-4.7 by Zhipu AI is a flagship 358B MoE model featuring a 200K context window, elite 73.8% SWE-bench performance, and native Deep Thinking for agentic...

GPT-4o mini

OpenAI

OpenAI's most cost-efficient small model, GPT-4o mini offers multimodal intelligence and high-speed performance at a significantly lower price point.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Domande frequenti su Qwen3-Coder-Next

Trova risposte alle domande comuni su Qwen3-Coder-Next