GLM-5.1

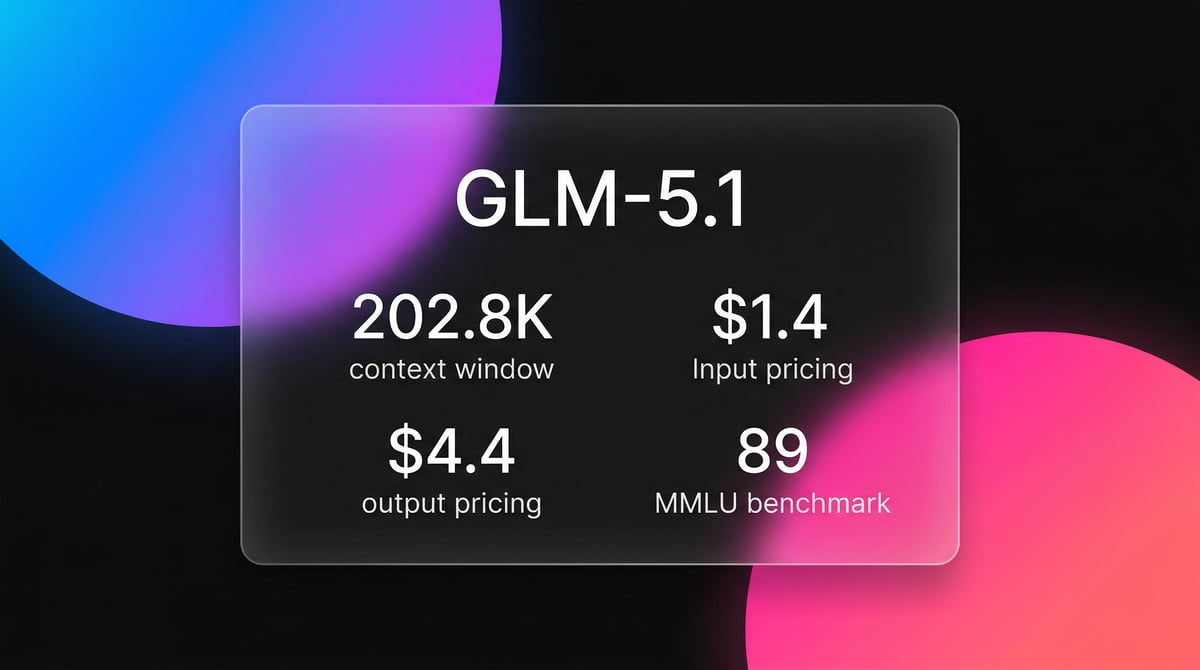

GLM-5.1はZhipu AIの旗艦となるreasoningモデルです。202Kのcontext windowを備え、複雑なagenticエンジニアリングのための8時間の自律実行ループを特徴とします。

GLM-5.1について

GLM-5.1の機能、特徴、そしてより良い結果を得るための方法について学びましょう。

GLM-5.1は、複雑なシステムエンジニアリングと長期的なagenticタスクのために設計されたZhipu AIの旗艦foundation modelです。7440億のparametersを持ち、パスごとに400億がアクティブになるMixture-of-Experts (MoE) アーキテクチャに基づいて構築されており、耐久性と自律的な問題解決において大きな飛躍を遂げました。このモデルは、初期のLLMに見られたreasoningの停滞を克服するように特別に設計されており、数千回のtool-callや何百回もの反復を通じて生産性とコード品質を維持します。人間の介入なしにブロッカーを特定し、実験を実行し、独自の戦略を調整します。

技術的には、GLM-5.1はマルチagentシステムにおける主要なreasoningエンジンとして優れています。高レベルのアーキテクチャ決定を処理しながら、実装を小規模なモデルに委任します。動的なsparse attentionメカニズムによってサポートされる202Kのcontext windowを備え、膨大なコードベース全体で一貫性を確保します。このモデルはMIT Licenseの下でopen weightsとしてリリースされており、データベース最適化、GPUカーネルエンジニアリング、フルスタックWebアプリケーション開発などのタスクにおいて、プロプライエタリなfrontier modelのローカルな代替手段となります。

KernelBench Level 3の結果によると、GLM-5.1はagenticなMLワークロードにおいて、Claude Opus 4.6と比較して長時間のターンで大幅な高速化を維持しています。この耐久性により、開発者は朝にエンジニアリングタスクを開始し、その日の終わりまでに完全にテストされデプロイされたサービスを受け取ることができます。サンドボックスでの問題再現から最終的なプルリクエストの提出まで、バグ修正のライフサイクル全体を処理します。

GLM-5.1のユースケース

GLM-5.1を使って素晴らしい結果を得るさまざまな方法を発見してください。

自律型ソフトウェアエンジニアリング

人間の介入なしに8時間以上自律的に動作し、マイクロサービスの設計、実装、デバッグを行います。

高性能データベースチューニング

Rustベースのvector検索実装を何百回ものラウンドを経て反復的に最適化します。

GPUカーネル最適化

参照実装を分析し、デフォルトのautotuneコンパイラを上回る高速なGPUカーネルを生成します。

マルチagentオーケストレーション

専門化された小規模モデル群の間でサブタスクやtool-callを調整するreasoningの核心として機能します。

複雑なターミナルタスク

agenticなCLIツールを介して、現実世界のターミナル操作や多段階のシステム管理を実行します。

フルスタックWebデザイン

ブラウザベースのデスクトップ環境向けに、視覚的に一貫性のあるUIレイアウトとバックエンドロジックを生成します。

強み

制限

APIクイックスタート

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimize this database schema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}SDKをインストールして、数分でAPIコールを開始しましょう。

GLM-5.1についてのユーザーの声

GLM-5.1についてコミュニティがどう思っているか見てください

“GLM-5.1は1つのプロンプトで8時間連続ループしました。他のモデルのように途中で終わらず、機能を追加し、自己評価し続けました。”

“140kのコンテキストで5回以上負荷テストを行いましたが、一貫性を保ちました。SOTAに挑戦者が現れたかもしれません。”

“GLM-5.1はこのbenchmarkではOpusとほぼ互角です。今やArenaでNo.1のopen modelです。”

“GLM-5.1との台本なしの対話でNPCが心から納得させられるのを見るたび、純粋な魔法のように感じます。”

“コーディング性能は本物です。GPT-4oが幻覚を起こし続けていたGoバックエンドの競合状態を修正しました。”

“Unslothを使ってこれをローカルで実行することは、私たちのリーガルテックスタックにおけるデータプライバシーの面でゲームチェンジャーです。”

GLM-5.1についての動画

GLM-5.1についてのチュートリアル、レビュー、ディスカッションを見る

“GLM-5.1はこのbenchmarkで45.3%を記録し、ファミリーにとって大きな飛躍です。”

“信じられないほど遅いモデルです…おそらくGPUの多くをまだGLM-5の提供に使っているのでしょう。”

“tool-callの扱いは標準のGLM 5よりもはるかに堅牢です。”

“現時点でダウンロードして自分のハードウェアで実行できる最強のreasoningモデルです。”

“Thinkingログの中で、モデル自身が自分の間違いを特定しているのがわかります。”

“8時間自律的に実行し、何千回もの反復を通じて戦略を洗練させます。”

“一般的なリポジトリ生成のbenchmarkにおいてGemini 3.1 ProやQwen 3.6 Plusを上回ります。”

“このモデルが真に輝くのはagenticモードであり、難しいバグでも諦めません。”

“Z.aiは、744B parametersのfrontierレベルモデルの壁を実質的に撤廃しました。”

“他のLLMが時間とともに集中力を失う'停滞'問題を効果的に管理しています。”

“元の1.65TBから236GBへの80%サイズ削減を実現しながら、品質を維持しています。”

“open-sourceの力:量子化バージョンであっても、花火のための動作コードを書きました。”

“このMoEの巨人を読み込むには、少なくとも256GBのシステムRAMが必要です。”

“動的なsparse attentionメカニズムを使用して、202kのコンテキストを維持しています。”

“Unslothを使用することで、学習とinferenceのプロセスが大幅に効率化されます。”

ワークフローを強化する AI自動化

AutomatioはAIエージェント、ウェブ自動化、スマート統合のパワーを組み合わせ、より短時間でより多くのことを達成するお手伝いをします。

GLM-5.1のプロのヒント

GLM-5.1を最大限に活用し、より良い結果を得るための専門家のヒント。

Thinking Modeの切り替え

8時間の自律反復機能を解放するには、構成で'Thinking'トグルが有効になっていることを確認してください。

オフピーク時利用枠の活用

北京時間の14:00〜18:00以外の時間帯に大規模なエンジニアリングバッチを実行すると、より有利な料金で利用できます。

ローカルメモリ要件

Unsloth Dynamic GGUF量子化を使用して、1.6TBのモデルを256GBのシステムメモリに収めてローカルで実行してください。

戦略的なタスク選択

GLM-5.1はアーキテクチャのreasoning用に確保し、ルーチン実装にはGLM-4.7を使用してコストを管理してください。

お客様の声

ユーザーの声

ワークフローを変革した何千人もの満足したユーザーに加わりましょう

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

関連 AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GLM-5.1についてのよくある質問

GLM-5.1に関するよくある質問への回答を見つけてください