GLM-5.1

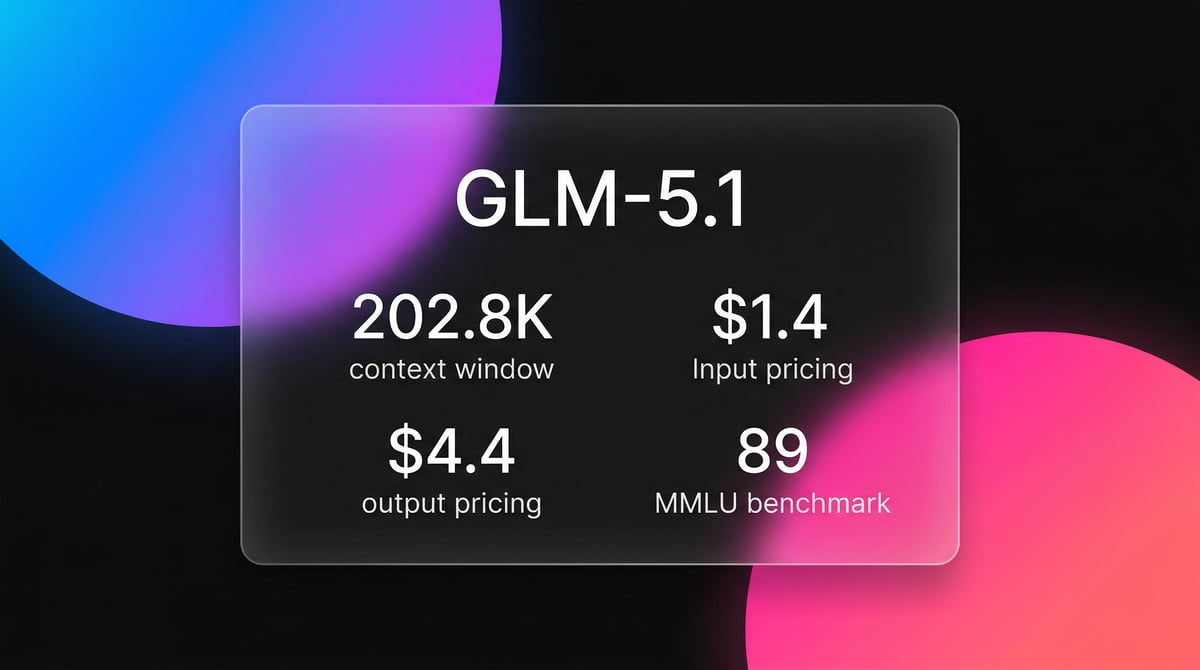

GLM-5.1 is Zhipu AI's flagship reasoning model, met een 202K context window en een autonome 8-uur durende execution loop voor complexe agentic engineering.

Over GLM-5.1

Leer over de mogelijkheden van GLM-5.1, functies en hoe het je kan helpen betere resultaten te behalen.

GLM-5.1 is Zhipu AI's flagship foundation model, ontworpen voor complexe systeem-engineering en agentic taken op lange termijn. Gebouwd op een Mixture-of-Experts (MoE) architectuur met 744 miljard parameters en 40 miljard actieve parameters per pass, vertegenwoordigt het een significante sprong in uithoudingsvermogen en autonoom probleemoplossend vermogen. Het model is specifiek ontworpen om de reasoning-plateaus te overwinnen die bij eerdere LLMs werden gezien, waardoor de productiviteit en codekwaliteit over duizenden tool-calls en honderden iteraties behouden blijven. Het identificeert blokkades, voert experimenten uit en past zijn eigen strategie aan zonder menselijke tussenkomst.

Technisch gezien blinkt GLM-5.1 uit als primaire reasoning-engine in multi-agent systemen. Het handelt beslissingen op hoog architecturaal niveau af en delegeert de implementatie naar kleinere modellen. Het beschikt over een 202K context window, ondersteund door een dynamisch sparse attention mechanisme, wat coherentie over enorme codebases garandeert. Het model wordt uitgebracht als open weights onder de MIT License en biedt een levensvatbaar lokaal alternatief voor propriëtaire frontier modellen voor taken zoals database-optimalisatie, GPU kernel engineering en full-stack webontwikkeling.

KernelBench Level 3 resultaten laten zien dat GLM-5.1 een aanzienlijke snelheidswinst behoudt in agentic ML-workloads gedurende lange turns vergeleken met Claude Opus 4.6. Dit uithoudingsvermogen stelt ontwikkelaars in staat om 's ochtends een engineering-taak te starten en aan het eind van de dag een volledig geteste, deployed service te ontvangen. Het beheert de volledige levenscyclus van een bugfix, van het reproduceren van het probleem in een sandbox tot het indienen van de uiteindelijke pull request.

Gebruikscases voor GLM-5.1

Ontdek de verschillende manieren waarop je GLM-5.1 kunt gebruiken voor geweldige resultaten.

Autonome software engineering

Het draait autonoom gedurende 8+ uur om microservices te ontwerpen, implementeren en debuggen zonder menselijke begeleiding.

High-performance database tuning

Het model optimaliseert iteratief op Rust gebaseerde vector search-implementaties gedurende honderden rondes.

GPU kernel optimalisatie

Het analyseert referentie-implementaties om snellere GPU kernels te produceren die beter presteren dan standaard autotune compilers.

Multi-agent orkestratie

Het fungeert als een reasoning-kern die subtaken en tool-calls coördineert binnen een zwerm gespecialiseerde kleinere modellen.

Complexe terminaltaken

Het voert real-world terminaloperaties en systeembeheer in meerdere stappen uit via agentic CLI-tools.

Full-stack webdesign

Het model genereert visueel consistente UI-lay-outs en backend-logica voor browsergebaseerde desktopomgevingen.

Sterke punten

Beperkingen

API snelstart

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimaliseer dit databaseschema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Installeer de SDK en begin binnen enkele minuten met API-calls.

Wat mensen zeggen over GLM-5.1

Bekijk wat de community denkt over GLM-5.1

“GLM-5.1 zat 8 uur lang vast in een loop op één prompt. Het gaf niet op zoals de meeste modellen; het bleef functies toevoegen en zichzelf evalueren.”

“Ik heb het 5 keer getest met 140k context en het bleef coherent. SOTA heeft mogelijk een uitdager.”

“GLM-5.1 gaat nek-aan-nek met Opus op deze benchmark. Het is nu het #1 open model in de Arena.”

“Elke keer als ik zie dat een NPC oprecht overtuigd raakt door ongescripte dialoog met GLM-5.1, is dat pure magie.”

“De coding-prestaties zijn legitiem. Het loste een race-condition op in onze Go-backend waar GPT-4o maar over bleef hallucineren.”

“Dit lokaal draaien met Unsloth is een game-changer voor gegevensprivacy in onze legal-tech stack.”

Video's over GLM-5.1

Bekijk tutorials, reviews en discussies over GLM-5.1

“GLM-5.1 behaalde 45,3% op deze benchmark, een aanzienlijke sprong voor deze familie.”

“Het is een ongelooflijk traag model... ze hebben waarschijnlijk meer van hun GPU's die nog GLM-5 draaien.”

“De manier waarop het met tool-calls omgaat is veel robuuster dan de standaard GLM 5.”

“Het is momenteel het krachtigste reasoning-model dat je zelf kunt downloaden en op eigen hardware kunt draaien.”

“Je kunt zien dat het daadwerkelijk zijn eigen fouten identificeert in de thinking log.”

“Het kan 8 uur autonoom draaien en strategieën verfijnen via duizenden iteraties.”

“Het presteert beter dan Gemini 3.1 Pro en Qwen 3.6 Plus op populaire repo-generatie benchmarks.”

“De agentic modus is waar dit model echt schittert; het geeft niet op bij moeilijke bugs.”

“Z.ai heeft in feite de betaalmuur verwijderd van een 744B parameter model op frontier-level.”

“Het beheert effectief het 'plateau'-probleem waarbij andere LLMs na verloop van tijd hun focus verliezen.”

“80% formaatreductie van de originele 1,65 TB naar 236GB met behoud van kwaliteit.”

“De kracht van open-source: zelfs in een gekwantiseerde versie schreef het werkende code voor vuurwerk.”

“Je hebt minstens 256GB systeem-RAM nodig om überhaupt te overwegen dit MoE-monster te laden.”

“Het gebruikt een dynamisch sparse attention mechanisme om die 202k context coherent te houden.”

“Het gebruik van Unsloth maakt het trainings- en inference-proces aanzienlijk efficiënter.”

Supercharge je workflow met AI-automatisering

Automatio combineert de kracht van AI-agents, webautomatisering en slimme integraties om je te helpen meer te bereiken in minder tijd.

Pro-tips voor GLM-5.1

Experttips om je te helpen het maximale uit GLM-5.1 te halen en betere resultaten te behalen.

Thinking Mode inschakelen

Zorg ervoor dat de 'Thinking' schakelaar is ingeschakeld in je configuratie om de 8-uur durende autonome iteratiemogelijkheden te ontgrendelen.

Gebruik daluren-quota

Voer grote engineering-batches uit tijdens daluren, buiten 14:00-18:00 uur (Beijing-tijd), voor betere prijzen.

Lokale geheugenvereisten

Gebruik Unsloth Dynamic GGUF kwantisering om het 1,6TB model in 256GB aan systeem-RAM te passen voor lokale runs.

Strategische taakselectie

Reserveer GLM-5.1 voor architecturale reasoning en gebruik GLM-4.7 voor routine-implementaties om kosten te beheersen.

Testimonials

Wat onze gebruikers zeggen

Sluit je aan bij duizenden tevreden gebruikers die hun workflow hebben getransformeerd

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Gerelateerd AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Veelgestelde vragen over GLM-5.1

Vind antwoorden op veelvoorkomende vragen over GLM-5.1