GLM-5.1

GLM-5.1 to flagowy model reasoning od Zhipu AI, wyposażony w 202K context window i autonomiczny 8-godzinny cykl wykonywania zadań dla złożonej inżynierii...

O GLM-5.1

Dowiedz sie o mozliwosciach GLM-5.1, funkcjach i jak moze pomoc Ci osiagnac lepsze wyniki.

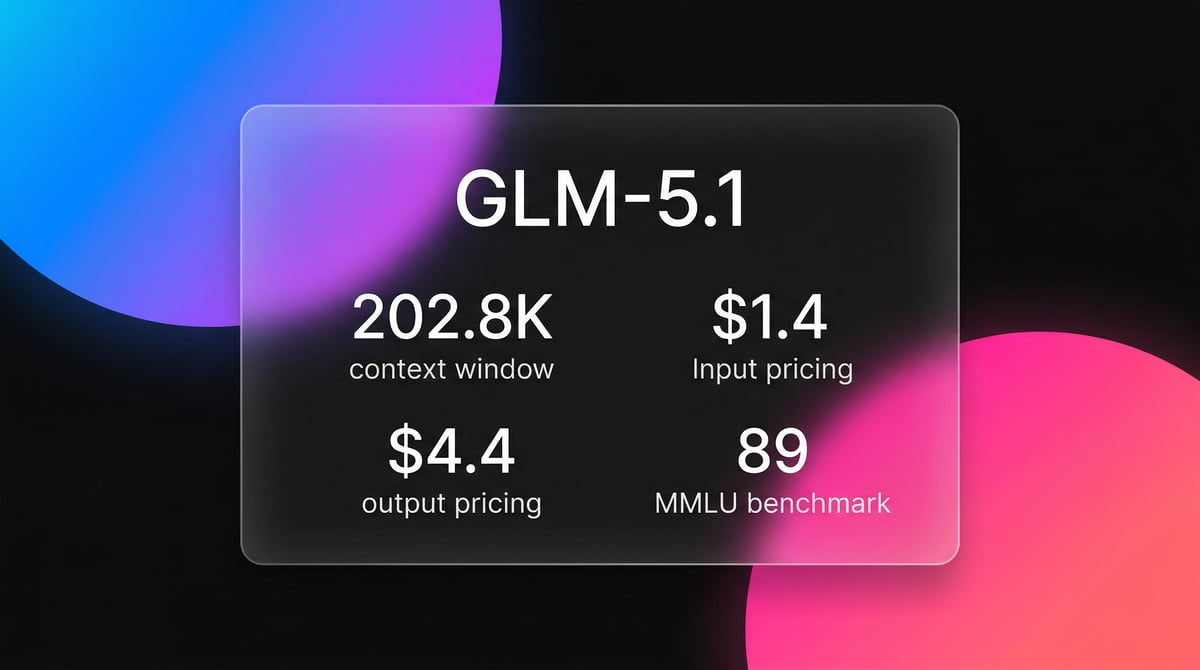

GLM-5.1 to flagowy model od Zhipu AI, zaprojektowany z myślą o złożonej inżynierii systemowej i długoterminowych zadaniach agentic. Zbudowany w oparciu o architekturę Mixture-of-Experts (MoE) z 744 miliardami parameters i 40 miliardami aktywnych na przejście, stanowi znaczący skok w wytrzymałości i autonomicznym rozwiązywaniu problemów. Model został specjalnie zaprojektowany, aby pokonać plateau rozumowania obserwowane we wcześniejszych modelach, utrzymując produktywność i jakość kodu przez tysiące wywołań narzędzi i setki iteracji. Samodzielnie identyfikuje blokady, uruchamia eksperymenty i dostosowuje strategię bez ingerencji człowieka.

Technicznie GLM-5.1 sprawdza się jako główny silnik reasoning w systemach multi-agentowych. Obsługuje decyzje architektoniczne wysokiego poziomu, delegując implementację do mniejszych modeli. Posiada 202K context window wspierane przez mechanizm dynamicznej, rzadkiej uwagi, zapewniając spójność w ogromnych bazach kodu. Model jest udostępniony jako open weights na licencji MIT, stanowiąc realną lokalną alternatywę dla zamkniętych frontier models w zadaniach takich jak optymalizacja baz danych, inżynieria jąder GPU i tworzenie pełnostosowych aplikacji webowych.

Wyniki KernelBench poziomu 3 pokazują, że GLM-5.1 utrzymuje znaczący wzrost prędkości w obciążeniach ML typu agentic przy długich sesjach w porównaniu do Claude Opus 4.6. Ta wytrzymałość pozwala programistom uruchomić zadanie inżynieryjne rano i otrzymać w pełni przetestowaną, wdrożoną usługę pod koniec dnia. Obsługuje cały cykl życia poprawki błędu, od odtworzenia problemu w piaskownicy po przesłanie ostatecznego pull requesta.

Przypadki uzycia dla GLM-5.1

Odkryj rozne sposoby wykorzystania GLM-5.1 do osiagniecia swietnych wynikow.

Autonomiczna inżynieria oprogramowania

Działa autonomicznie przez ponad 8 godzin, projektując, implementując i debugując mikrousługi bez nadzoru człowieka.

Wydajne strojenie baz danych

Model iteracyjnie optymalizuje implementacje wyszukiwania wektorowego oparte na Rust w setkach rund.

Optymalizacja jąder GPU

Analizuje implementacje referencyjne, aby tworzyć szybsze jądra GPU, które przewyższają domyślne kompilatory autotune.

Orkiestracja multi-agentowa

Pełni rolę rdzenia reasoning, który koordynuje podzadania i wywołania narzędzi w grupie wyspecjalizowanych, mniejszych modeli.

Złożone zadania terminalowe

Wykonuje rzeczywiste operacje terminalowe i wieloetapową administrację systemową poprzez narzędzia CLI agentic.

Projektowanie aplikacji webowych Full-Stack

Model generuje spójne wizualnie układy UI oraz logikę backendową dla środowisk desktopowych działających w przeglądarce.

Mocne strony

Ograniczenia

Szybki start API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimize this database schema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Zainstaluj SDK i zacznij wykonywac wywolania API w kilka minut.

Co mowia ludzie o GLM-5.1

Zobacz, co spolecznosc mysli o GLM-5.1

“GLM-5.1 zapętlił się na jednym prompcie przez 8 godzin. Nie poddał się jak większość modeli; ciągle dodawał nowe funkcje i dokonywał samooceny.”

“Testowałem go na 140k context window co najmniej 5 razy i pozostał spójny. SOTA może mieć poważnego rywala.”

“GLM-5.1 w tym benchmarku idzie łeb w łeb z Opus. Jest to obecnie model open nr 1 w Arena.”

“Za każdym razem, gdy widzę NPC, który daje się przekonać w wyniku nieskryptowanego dialogu z GLM-5.1, to czysta magia.”

“Wydajność w kodowaniu jest prawdziwa. Naprawił race condition w naszym backendzie Go, o którym GPT-4o ciągle halucynował.”

“Uruchomienie tego lokalnie z Unsloth to przełom dla prywatności danych w naszym stosie technologii prawnych.”

Filmy o GLM-5.1

Ogladaj samouczki, recenzje i dyskusje o GLM-5.1

“GLM-5.1 uzyskał 45,3% w tym benchmark, co jest znaczącym skokiem dla tej rodziny.”

“To niezwykle wolny model... prawdopodobnie mają więcej swoich GPU zajętych obsługą GLM-5.”

“Sposób, w jaki obsługuje wywołania narzędzi, jest znacznie bardziej solidny niż w standardowym GLM 5.”

“Jest to obecnie najsilniejszy model reasoning, który można pobrać i uruchomić na własnym sprzęcie.”

“Widać, jak faktycznie identyfikuje własne błędy w logu myślenia.”

“Może działać autonomicznie przez 8 godzin, udoskonalając strategie poprzez tysiące iteracji.”

“W popularnych benchmarkach generowania repozytoriów wyprzedza Gemini 3.1 Pro i Qwen 3.6 Plus.”

“Tryb agentic jest tym, w czym ten model naprawdę błyszczy – nie poddaje się przy trudnych błędach.”

“Z.ai w zasadzie usunęło barierę płatności dla modelu frontier-level z 744 mld parameters.”

“Skutecznie radzi sobie z problemem „plateau”, gdzie inne LLMs z czasem tracą koncentrację.”

“Redukcja rozmiaru o 80% z oryginalnych 1,65 TB do 236 GB przy zachowaniu jakości.”

“Potęga open-source: nawet w wersji skwantyzowanej napisał działający kod dla fireworks.”

“Będziesz potrzebować co najmniej 256 GB pamięci RAM, żeby w ogóle myśleć o załadowaniu tego giganta MoE.”

“Wykorzystuje dynamiczny mechanizm rzadkiej uwagi (sparse attention), aby utrzymać spójność 202k context window.”

“Użycie Unsloth sprawia, że proces treningu i inference jest znacznie bardziej wydajny.”

Przyspiesz swoj workflow z automatyzacja AI

Automatio laczy moc agentow AI, automatyzacji web i inteligentnych integracji, aby pomoc Ci osiagnac wiecej w krotszym czasie.

Porady Pro dla GLM-5.1

Wskazówki ekspertów, aby w pełni wykorzystać GLM-5.1.

Włącz tryb myślenia (Thinking Mode)

Upewnij się, że przełącznik „Thinking” jest włączony w konfiguracji, aby odblokować możliwości 8-godzinnej autonomicznej iteracji.

Korzystaj z przydziałów poza godzinami szczytu

Uruchamiaj duże zadania inżynieryjne poza godzinami szczytu (14:00-18:00 czasu pekińskiego), aby uzyskać lepsze ceny.

Wymagania dotyczące pamięci lokalnej

Użyj kwantyzacji Unsloth Dynamic GGUF, aby zmieścić model 1,6 TB w 256 GB pamięci systemowej przy uruchomieniu lokalnym.

Strategiczny dobór zadań

Zachowaj GLM-5.1 do rozumowania architektonicznego, a GLM-4.7 wykorzystuj do rutynowych implementacji, aby zarządzać kosztami.

Opinie

Co mowia nasi uzytkownicy

Dolacz do tysiecy zadowolonych uzytkownikow, ktorzy przeksztalcili swoj workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Powiazane AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Często Zadawane Pytania o GLM-5.1

Znajdź odpowiedzi na częste pytania o GLM-5.1