Qwen3.5-Omni

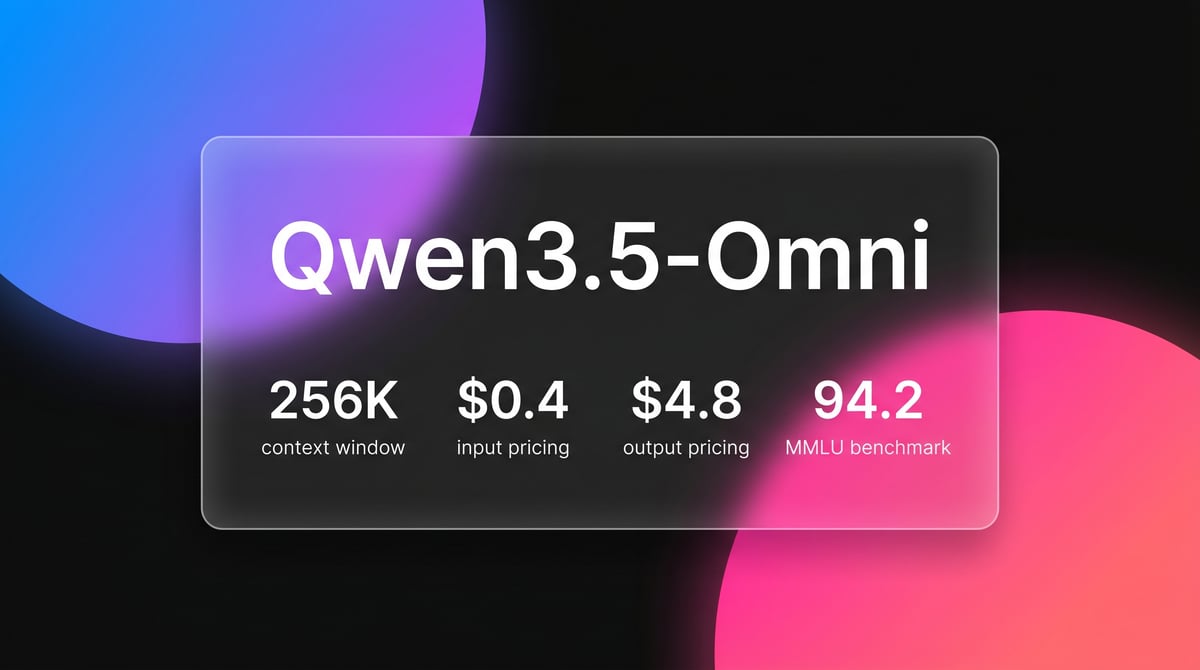

Qwen3.5-Omni to natywnie omnimodalne AI od Alibaba Cloud, oferujące płynne rozumowanie audiowizualne, czat głosowy w czasie rzeczywistym i 256k context dla...

O Qwen3.5-Omni

Dowiedz sie o mozliwosciach Qwen3.5-Omni, funkcjach i jak moze pomoc Ci osiagnac lepsze wyniki.

Ujednolicona architektura omnimodalna

Qwen3.5-Omni to natywnie omnimodalny model opracowany przez Alibaba Cloud, zbudowany na ujednoliconej architekturze zaprojektowanej do jednoczesnego przetwarzania danych tekstowych, obrazów, dźwięku i wideo. W przeciwieństwie do poprzednich modeli, które polegały na oddzielnych enkoderach, Qwen3.5-Omni wykorzystuje architekturę Thinker-Talker. Komponent Thinker przeprowadza złożone rozumowanie multimodalne na przeplatających się sygnałach, podczas gdy komponent Talker generuje wysokiej jakości strumieniową mowę z niskim latency. Pozwala to modelowi na obsługę ogromnego context, w tym do 10 godzin dźwięku lub prawie siedmiu minut wideo w jakości 720p w jednym prompt.

Zaawansowana synchronizacja i wydajność

Cechą techniczną tego modelu jest system Adaptive Rate Interleave Alignment (ARIA), który synchronizuje tokeny tekstu i mowy, zapewniając naturalnie brzmiące odpowiedzi głosowe. Model obsługuje przerwania semantyczne w czasie rzeczywistym, co pozwala użytkownikom przerywać AI podczas rozmowy. Jest zoptymalizowany zarówno pod kątem korporacyjnej analizy multimodalnej, jak i konsumenckich asystentów głosowych, oferując wydajność w zadaniach wizualnych i dźwiękowych, która dorównuje lub przewyższa flagowe modele własnościowe.

Specjalizacja dla interakcji z niskim latency

Architektura modelu jest specjalnie dostrojona do zastosowań w czasie rzeczywistym, gdzie latency ma kluczowe znaczenie. Dzięki wykorzystaniu podejścia Mixture-of-Experts (MoE) z architekturą gated delta networks, model utrzymuje wysoką wydajność obliczeniową. Ta efektywność pozwala mu na interakcję głosową w czasie rzeczywistym przy jednoczesnym zarządzaniu context window o rozmiarze 256k token, co czyni go odpowiednim do analizy długich treści, takich jak transkrypcje spotkań czy indeksowanie materiałów wideo.

Przypadki uzycia dla Qwen3.5-Omni

Odkryj rozne sposoby wykorzystania Qwen3.5-Omni do osiagniecia swietnych wynikow.

Asystenci głosowi w czasie rzeczywistym

Model tworzy interaktywne awatary AI, które prowadzą naturalne rozmowy głosowe z obsługą przerwań semantycznych.

Kinowe napisy do wideo

Generuje opisy na poziomie scenariusza oraz adnotacje z sygnaturami czasowymi dla długich treści wideo w wysokiej rozdzielczości.

Audiowizualne programowanie na żywo

Programiści naprawiają kod, udostępniając swój ekran i werbalnie tłumacząc logikę modelowi w czasie rzeczywistym.

Korporacyjna archiwizacja audio

System przetwarza do 10 godzin nagrań ze spotkań lub podcastów, aby wyciągnąć wnioski w jednym przebiegu.

Wielojęzyczne usługi tłumaczeniowe

Zapewnia kompleksowe tłumaczenie speech-to-speech w 113 językach oraz różnych regionalnych dialektach chińskich.

Moderacja treści

Model sprawdza strumienie wideo i audio pod kątem bezpieczeństwa, identyfikując zakazane treści wizualne i werbalne jednocześnie.

Mocne strony

Ograniczenia

Szybki start API

alibaba/qwen3.5-omni-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

const completion = await client.chat.completions.create({

model: 'qwen3.5-omni-plus',

messages: [{ role: 'user', content: 'Analyze this video content.' }],

modalities: ['text'],

stream: true,

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Zainstaluj SDK i zacznij wykonywac wywolania API w kilka minut.

Co mowia ludzie o Qwen3.5-Omni

Zobacz, co spolecznosc mysli o Qwen3.5-Omni

“Audiowizualne vibe coding zmienia zasady gry; w końcu rozumie, co pokazuję na ekranie, gdy tłumaczę błąd.”

“Zdolność Qwen3.5-Omni do obsłużenia 10 godzin audio w jednym context to szaleństwo dla badaczy i podcasterów.”

“Klonowanie głosu brzmi zaskakująco naturalnie w porównaniu z poprzednią generacją, w języku angielskim jest niemal nie do odróżnienia.”

“Wreszcie model, który nie przerywa mi w połowie zdania; przerwania semantyczne działają zgodnie z opisem.”

“Imponujące liczby w nowym Qwen3.6 27B, ale wersja Omni to ta, której wszyscy będą używać w prawdziwych produktach.”

“Próbowałem przerywać mu pięć razy i za każdym razem wyłapywał moją intencję.”

Filmy o Qwen3.5-Omni

Ogladaj samouczki, recenzje i dyskusje o Qwen3.5-Omni

“Architektura Thinker-Talker to ogromny skok naprzód w kwestii latency [04:15].”

“Obsługuje 400 sekund wideo, co jest dwukrotnością tego, co zwykle widzimy [07:22].”

“Ten model jest natywnie wielojęzyczny i multimodalny end-to-end [10:05].”

“System ARIA zapobiega błędom wymowy spotykanym w standardowym TTS [15:30].”

“Możesz dosłownie pokazać swój ekran i prowadzić płynną rozmowę o kodzie [22:10].”

“Próbowałem przerywać mu pięć razy i za każdym razem wyłapywał moją intencję [08:30].”

“Sposób, w jaki pisze kod na podstawie tego, co widzi na wideo, jest niesamowity [10:45].”

“To pierwszy realny konkurent dla trybu głosowego GPT-4o, jakiego widzieliśmy [14:20].”

“Obsługuje 113 języków w rozpoznawaniu mowy, co jest ogromną przewagą [18:55].”

“Ekstrakcja wizualna jest znacznie bardziej solidna w przypadku złożonych plików PDF i wideo [25:15].”

“10-godzinny context audio to prawdziwa gwiazda tego modelu w zastosowaniach korporacyjnych [12:10].”

“Wydajność w językach innych niż angielski to obszar, w którym Qwen zdecydowanie wygrywa [15:40].”

“Potrafi odróżnić hałas w tle od rzeczywistego przerywania przez użytkownika [19:22].”

“Ceny są bardzo konkurencyjne, zwłaszcza biorąc pod uwagę skalę aktywnych parameters [24:10].”

“Obecnie jest to najbardziej zdolny model do automatyzacji w Pythonie z wykorzystaniem wizualnego UI [28:45].”

Przyspiesz swoj workflow z automatyzacja AI

Automatio laczy moc agentow AI, automatyzacji web i inteligentnych integracji, aby pomoc Ci osiagnac wiecej w krotszym czasie.

Porady Pro dla Qwen3.5-Omni

Wskazówki ekspertów, aby w pełni wykorzystać Qwen3.5-Omni.

Optymalizacja przesyłania dźwięku

Dziel pliki audio dłuższe niż 10 godzin, aby zachować dokładność wyszukiwania faktów w ramach 256k context window.

Wykorzystanie przerwań semantycznych

Włącz natywne funkcje naprzemiennego mówienia w aplikacjach głosowych, aby odróżnić intencję użytkownika od hałasu w tle.

Używaj ARIA do terminów technicznych

Korzystaj ze strumieniowego trybu mowy, aby czerpać korzyści z dopasowania ARIA, co zapewnia precyzyjną wymowę liczb technicznych.

Kontrola liczby klatek wideo

Przesyłaj standardowe wideo w 1 FPS, ale zwiększ częstotliwość dla scen dynamicznych, aby zapewnić precyzję wizualną.

Opinie

Co mowia nasi uzytkownicy

Dolacz do tysiecy zadowolonych uzytkownikow, ktorzy przeksztalcili swoj workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Powiazane AI Models

GPT-5.4

OpenAI

GPT-5.4 is OpenAI's frontier model featuring a 1.05M context window and Extreme Reasoning. It excels at autonomous UI interaction and long-form data analysis.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.3 Codex

OpenAI

GPT-5.3 Codex is OpenAI's 2026 frontier coding agent, featuring a 400K context window, 77.3% Terminal-Bench score, and superior logic for complex software...

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Często Zadawane Pytania o Qwen3.5-Omni

Znajdź odpowiedzi na częste pytania o Qwen3.5-Omni