Qwen3-Coder-Next

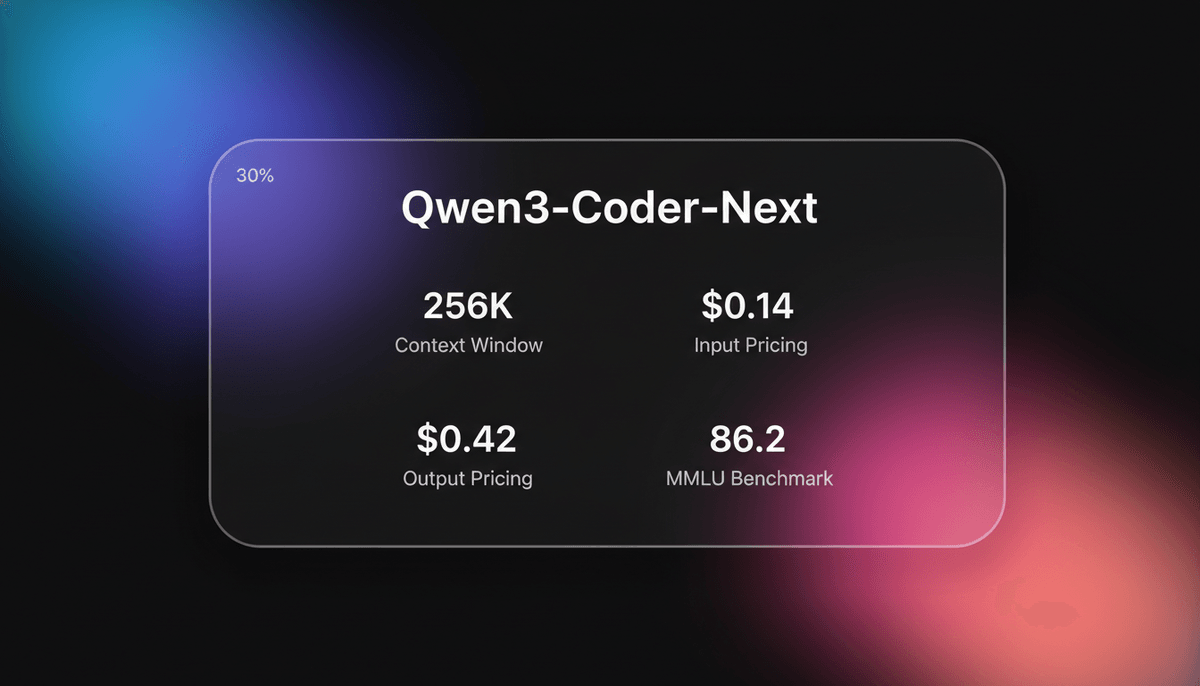

Qwen3-Coder-Next to elitarny model kodujący Alibaba Cloud na licencji Apache 2.0, oferujący architekturę MoE 80B i okno kontekstowe 256k dla zaawansowanego...

O Qwen3-Coder-Next

Dowiedz sie o mozliwosciach Qwen3-Coder-Next, funkcjach i jak moze pomoc Ci osiagnac lepsze wyniki.

Architektura modelu

Qwen3-Coder-Next to wyspecjalizowany model typu open-weight zaprojektowany przez Alibaba Cloud dla agentów inżynierii oprogramowania. Wykorzystuje architekturę Mixture-of-Experts (MoE) z łączną liczbą 80 miliardów parameters, aktywując jedynie 3 miliardy parameters na token. Taka konstrukcja łączy inteligencję ogromnego modelu z szybkością inference modelu o małej skali. Architektura obejmuje hybrydowy mechanizm attention, integrujący Gated DeltaNet ze standardowym Gated Attention, aby przetwarzać konteksty do 262 144 tokens.

Specjalizacja agentic

Model został przeszkolony na ponad 800 000 weryfikowalnych zadań programistycznych i środowisk wykonywalnych. Trening ten kładzie nacisk na długoterminowe reasoning oraz zdolność do radzenia sobie z błędami wykonania. Osiąga wynik 70,8% w SWE-Bench Verified, co potwierdza jego zdolność do obsługi wieloetapowych zadań programistycznych – od wstępnego planowania aż po ostateczne wykonanie kodu. Doskonale sprawdza się w autonomicznych strukturach typu agentic, takich jak OpenClaw i Qwen Code.

Wdrożenie i prywatność

Udostępniony na licencji Apache 2.0, model ten stanowi bezpieczną alternatywę dla programistów wymagających lokalnych, prywatnych środowisk pracy. Dzięki kwantyzacji może działać na sprzęcie konsumenckim z wystarczającą ilością RAM. Wysokie okno kontekstowe pozwala na analizę projektów na skalę całego repozytorium bez utraty wydajności, co często zdarza się w modelach z mniejszym kontekstem.

Przypadki uzycia dla Qwen3-Coder-Next

Odkryj rozne sposoby wykorzystania Qwen3-Coder-Next do osiagniecia swietnych wynikow.

Autonomiczni agenci programistyczni

Zasila frameworki obsługujące wieloetapowe zadania programistyczne, od planowania po finalną egzekucję.

Lokalne, prywatne środowisko programistyczne

Uruchamia elitarną pomoc w kodowaniu na konsumenckich GPU z 16GB VRAM przy użyciu kwantyzowanych warstw MoE.

Analiza repozytoriów na dużą skalę

Przetwarza całe bazy kodu w ramach okna 256k, aby zidentyfikować dług techniczny.

Naprawa i refaktoryzacja kodu

Aktualizuje starszy kod do nowoczesnych standardów, zapewniając zwrotną informację ze środowiska wykonywalnego.

Wielojęzyczne skryptowanie

Generuje wysokiej jakości kod w ponad 40 językach programowania, w tym Rust i Go.

Interaktywna symulacja 3D

Buduje złożone wizualizatory i symulacje internetowe przy użyciu szybkiego generowania one-shot.

Mocne strony

Ograniczenia

Szybki start API

alibaba/qwen-3-coder-next

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: "https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

});

async function main() {

const completion = await client.chat.completions.create({

model: "qwen3-coder-next",

messages: [

{ role: "system", content: "You are a professional coding assistant." },

{ role: "user", content: "Write a React component for a sortable list." },

],

});

console.log(completion.choices[0].message.content);

}

main();Zainstaluj SDK i zacznij wykonywac wywolania API w kilka minut.

Co mowia ludzie o Qwen3-Coder-Next

Zobacz, co spolecznosc mysli o Qwen3-Coder-Next

“Prawie dorównuje Claude pod względem ogólnych możliwości kodowania. Pokonuje Claude 3.5 Sonnet w HumanEval z wynikiem 92,7%.”

“Efektywność wersji MoE na lokalnym sprzęcie jest niesamowita. Uzyskuję 26 TPS na systemie ze średniej półki.”

“Self-speculative decoding jest matematycznie niemożliwe dla Qwen Coder Next ze względu na stany rekurencyjne.”

“Qwen3-Coder-Next jest oparty na MoE i jest znacznie silniejszy oraz mądrzejszy niż poprzednik!”

“Pokazuje możliwość przełączania się między dostawcami w trakcie projektu przy nowych wariantach modelu 480B.”

“Receptura treningu agentic na 800 tys. zadań jest widoczna w sposobie, w jaki model odzyskuje sprawność po błędach budowania.”

Filmy o Qwen3-Coder-Next

Ogladaj samouczki, recenzje i dyskusje o Qwen3-Coder-Next

“Dzięki temu jest dostępny dla osób chcących bawić się lokalnymi agentami programistycznymi AI”

“Dla mnie to aż krzyczy: otwórz kod i przetestuj ten model, co też zrobię”

“Efektywność pamięciowa w tym modelu to ogromny atut”

“Radzi sobie ze złożoną logiką lepiej niż poprzedni gęsty model 72B”

“To pierwszy open model, który poprawnie wykonuje moje polecenia terminalowe”

“Qwen 3 coder Next ma tylko 3 miliardy aktywnych parametrów, by działać na konsumenckiej karcie graficznej”

“Działa pięknie. Jestem pod ogromnym wrażeniem, że mogę uzyskać taki wynik w jednym podejściu z lokalnego AI”

“80 miliardów parametrów zazwyczaj wymaga klastra, ale podejście MoE zmienia wszystko”

“Obsługuje ponad 40 języków programowania bez żadnego zauważalnego spadku wydajności”

“Używanie go z OpenClaw sprawia wrażenie, jakby w zespole był junior dev”

“Model z 3 miliardami aktywnych parametrów staje w szranki z modelami 10-20 razy większymi”

“Qwen 3 ma wiele zalet przy znacznie niższym koszcie”

“Kontekst 256k jest prawdziwy, nie halucynował w środku mojego projektu”

“Latencja jest zaskakująco niska jak na 80B całkowitej wagi modelu”

“Naprawił błąd w moim starym repozytorium Go, którego GPT-4o nie zauważyło trzy razy”

Przyspiesz swoj workflow z automatyzacja AI

Automatio laczy moc agentow AI, automatyzacji web i inteligentnych integracji, aby pomoc Ci osiagnac wiecej w krotszym czasie.

Porady Pro dla Qwen3-Coder-Next

Wskazówki ekspertów, aby w pełni wykorzystać Qwen3-Coder-Next.

Stosuj długie system prompt

Dostarcz modelowi szczegółowe przykłady i dokumentację, aby odpowiednio ukierunkować jego agentic zachowanie.

Iteracyjna informacja zwrotna o błędach

Przesyłaj logi błędów z konsoli przeglądarki z powrotem do modelu, aby uzyskać wysoką skuteczność samokorekty.

Optymalizacja odciążania warstw

Odciążaj wybrane warstwy eksperckie MoE do pamięci RAM systemu, aby zbalansować szybkość inference i reasoning.

Dopasowanie parametrów próbkowania

Użyj temperatury 1.0 z top_p 0.95 i top_k 40, aby uzyskać najdokładniejsze wyniki kodowania.

Opinie

Co mowia nasi uzytkownicy

Dolacz do tysiecy zadowolonych uzytkownikow, ktorzy przeksztalcili swoj workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Powiazane AI Models

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiniMax M2.5

minimax

MiniMax M2.5 is a SOTA MoE model featuring a 1M context window and elite agentic coding capabilities at disruptive pricing for autonomous agents.

GLM-4.7

Zhipu (GLM)

GLM-4.7 by Zhipu AI is a flagship 358B MoE model featuring a 200K context window, elite 73.8% SWE-bench performance, and native Deep Thinking for agentic...

GPT-4o mini

OpenAI

OpenAI's most cost-efficient small model, GPT-4o mini offers multimodal intelligence and high-speed performance at a significantly lower price point.

Gemini 3.5 Flash

Gemini 3.5 Flash is Google's high-speed multimodal model with a 1M context window, optimized for sub-second agentic loops and complex coding tasks.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

Często Zadawane Pytania o Qwen3-Coder-Next

Znajdź odpowiedzi na częste pytania o Qwen3-Coder-Next