Como fazer Scraping do Exploit-DB | Web Scraper do Exploit Database

Aprenda a fazer scraping do Exploit-DB para dados de vulnerabilidades, códigos de exploit e referências CVE para alimentar pesquisas de cibersegurança e feeds...

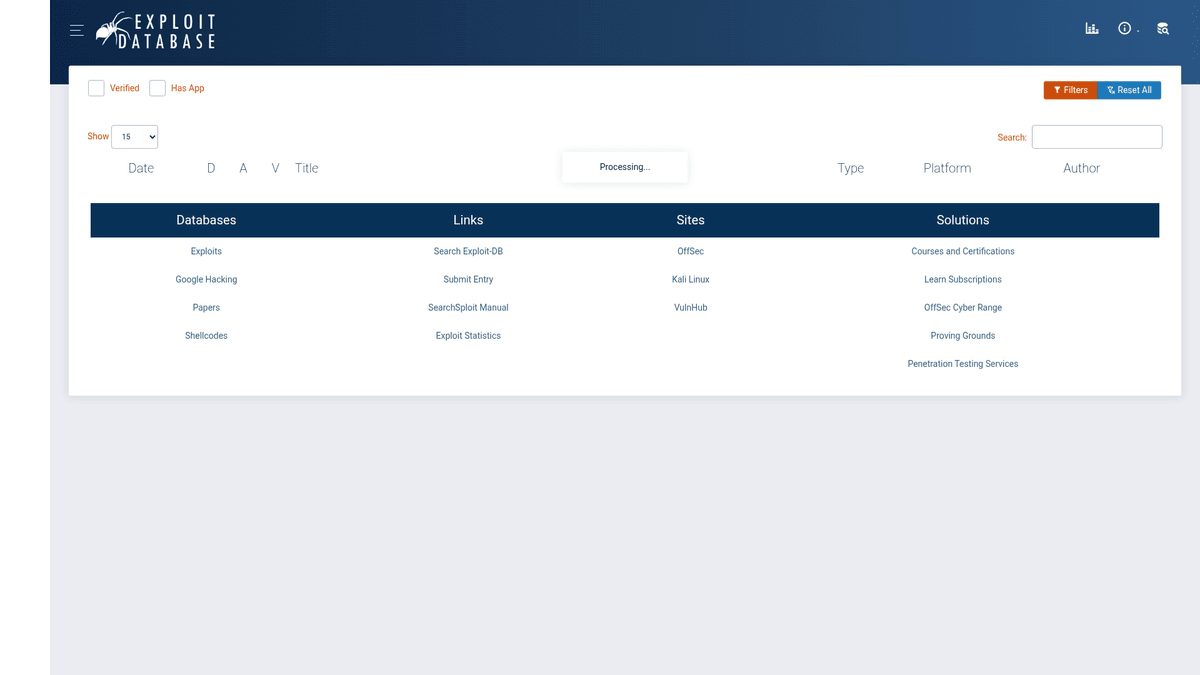

Proteção Anti-Bot Detectada

- Cloudflare

- WAF e gestão de bots de nível empresarial. Usa desafios JavaScript, CAPTCHAs e análise comportamental. Requer automação de navegador com configurações stealth.

- Limitação de taxa

- Limita requisições por IP/sessão ao longo do tempo. Pode ser contornado com proxies rotativos, atrasos de requisição e scraping distribuído.

- Bloqueio de IP

- Bloqueia IPs de data centers conhecidos e endereços sinalizados. Requer proxies residenciais ou móveis para contornar efetivamente.

- Desafio JavaScript

- Requer execução de JavaScript para acessar o conteúdo. Requisições simples falham; necessário navegador headless como Playwright ou Puppeteer.

Sobre Exploit Database

Descubra o que Exploit Database oferece e quais dados valiosos podem ser extraídos.

Repositório Abrangente de Vulnerabilidades

O Exploit Database (Exploit-DB) é um arquivo compatível com CVE de exploits públicos e softwares vulneráveis correspondentes, desenvolvido para uso por testadores de penetração e pesquisadores de vulnerabilidades. Mantido pela OffSec (Offensive Security), ele serve como um hub central para a comunidade de cibersegurança compartilhar códigos de prova de conceito (PoC) e pesquisas em várias plataformas e aplicações. O repositório é uma das fontes mais confiáveis para profissionais de segurança em todo o mundo.

Categorização e Profundidade de Dados

O site organiza os dados em categorias granulares, como Exploits Remotos, Aplicações Web, Exploits Locais e Shellcodes. Cada entrada normalmente inclui o título do exploit, data, autor, plataforma, ID de CVE associado e o código bruto do exploit. Essa abordagem estruturada permite que os pesquisadores alternem rapidamente entre diferentes tipos de vulnerabilidades e seu contexto histórico.

Valor Estratégico para Operações de Segurança

Coletar esses dados é altamente valioso para Security Operations Centers (SOCs) e equipes de inteligência de ameaças para correlacionar exploits conhecidos com vulnerabilidades internas. Ao automatizar a extração de códigos PoC e metadados, as organizações podem criar assinaturas de segurança personalizadas, aprimorar o ciclo de vida de gerenciamento de vulnerabilidades e construir feeds robustos de inteligência de ameaças.

Por Que Fazer Scraping de Exploit Database?

Descubra o valor comercial e os casos de uso para extração de dados de Exploit Database.

Enriquecimento de Threat Intelligence

Automatize a coleta de novas provas de conceito de exploits para alimentar centros de operações de segurança internos e plataformas de inteligência de ameaças.

Priorização de Vulnerabilidades

Cruze as vulnerabilidades de ativos internos com exploits disponíveis publicamente para determinar quais patches exigem aplicação imediata.

Desenvolvimento de Ferramentas de Segurança

Integre códigos de exploit funcionais e shellcode em frameworks de testes de invasão personalizados ou ferramentas automatizadas de avaliação de segurança.

Auditoria de Compliance

Mantenha um registro histórico de exploits para versões específicas de software para garantir que os sistemas atendam aos requisitos regulatórios de segurança.

Monitoramento de Zero-Day

Configure alertas para exploits recém-publicados que visam infraestruturas críticas ou softwares corporativos amplamente utilizados.

Desafios do Scraping

Desafios técnicos que você pode encontrar ao fazer scraping de Exploit Database.

Renderização Baseada em JavaScript

A base de dados principal de exploits é renderizada via jQuery DataTables, tornando-a invisível para scrapers HTTP básicos que não executam JavaScript.

Barreiras Anti-Bot do Cloudflare

O Exploit-DB é protegido pelo Cloudflare, que utiliza fingerprinting de navegador e desafios de TLS para bloquear tráfego não humano.

Rate Limiting Rigoroso

Requisições repetidas por arquivos de código de exploit brutos frequentemente disparam rate limiting baseado em IP ou banimentos temporários se não forem gerenciadas corretamente.

Carregamento de Conteúdo Dinâmico

O site utiliza AJAX para carregar dados de tabelas, exigindo que o scraper aguarde a inatividade da rede ou intercepte chamadas de API específicas.

Scrape Exploit Database com IA

Sem código necessário. Extraia dados em minutos com automação por IA.

Como Funciona

Descreva o que você precisa

Diga à IA quais dados você quer extrair de Exploit Database. Apenas digite em linguagem natural — sem código ou seletores.

A IA extrai os dados

Nossa inteligência artificial navega Exploit Database, lida com conteúdo dinâmico e extrai exatamente o que você pediu.

Obtenha seus dados

Receba dados limpos e estruturados prontos para exportar como CSV, JSON ou enviar diretamente para seus aplicativos.

Por Que Usar IA para Scraping

A IA facilita o scraping de Exploit Database sem escrever código. Nossa plataforma com inteligência artificial entende quais dados você quer — apenas descreva em linguagem natural e a IA os extrai automaticamente.

How to scrape with AI:

- Descreva o que você precisa: Diga à IA quais dados você quer extrair de Exploit Database. Apenas digite em linguagem natural — sem código ou seletores.

- A IA extrai os dados: Nossa inteligência artificial navega Exploit Database, lida com conteúdo dinâmico e extrai exatamente o que você pediu.

- Obtenha seus dados: Receba dados limpos e estruturados prontos para exportar como CSV, JSON ou enviar diretamente para seus aplicativos.

Why use AI for scraping:

- Manipulação Automática de Anti-Bot: O Automatio lida nativamente com desafios do Cloudflare e fingerprinting de navegador, garantindo que suas tarefas de scraping rodem sem intervenção manual.

- Seleção Visual de Dados: Mapeie facilmente a estrutura complexa do DataTable apenas clicando nos elementos que deseja extrair, evitando codificação complexa em CSS ou XPath.

- Sincronização de Dados Agendada: Configure seu scraper para rodar em intervalos específicos para garantir que seus feeds de threat intelligence estejam sempre atualizados com os últimos exploits.

Scrapers Web No-Code para Exploit Database

Alternativas point-and-click ao scraping com IA

Várias ferramentas no-code como Browse.ai, Octoparse, Axiom e ParseHub podem ajudá-lo a fazer scraping de Exploit Database sem escrever código. Essas ferramentas usam interfaces visuais para selecionar dados, embora possam ter dificuldades com conteúdo dinâmico complexo ou medidas anti-bot.

Workflow Típico com Ferramentas No-Code

Desafios Comuns

Curva de aprendizado

Compreender seletores e lógica de extração leva tempo

Seletores quebram

Mudanças no site podem quebrar todo o fluxo de trabalho

Problemas com conteúdo dinâmico

Sites com muito JavaScript requerem soluções complexas

Limitações de CAPTCHA

A maioria das ferramentas requer intervenção manual para CAPTCHAs

Bloqueio de IP

Scraping agressivo pode resultar no bloqueio do seu IP

Scrapers Web No-Code para Exploit Database

Várias ferramentas no-code como Browse.ai, Octoparse, Axiom e ParseHub podem ajudá-lo a fazer scraping de Exploit Database sem escrever código. Essas ferramentas usam interfaces visuais para selecionar dados, embora possam ter dificuldades com conteúdo dinâmico complexo ou medidas anti-bot.

Workflow Típico com Ferramentas No-Code

- Instalar extensão do navegador ou registrar-se na plataforma

- Navegar até o site alvo e abrir a ferramenta

- Selecionar com point-and-click os elementos de dados a extrair

- Configurar seletores CSS para cada campo de dados

- Configurar regras de paginação para scraping de múltiplas páginas

- Resolver CAPTCHAs (frequentemente requer intervenção manual)

- Configurar agendamento para execuções automáticas

- Exportar dados para CSV, JSON ou conectar via API

Desafios Comuns

- Curva de aprendizado: Compreender seletores e lógica de extração leva tempo

- Seletores quebram: Mudanças no site podem quebrar todo o fluxo de trabalho

- Problemas com conteúdo dinâmico: Sites com muito JavaScript requerem soluções complexas

- Limitações de CAPTCHA: A maioria das ferramentas requer intervenção manual para CAPTCHAs

- Bloqueio de IP: Scraping agressivo pode resultar no bloqueio do seu IP

Exemplos de Código

import requests

from bs4 import BeautifulSoup

# Exploit-DB uses Cloudflare; simple requests might be blocked

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Note: Main data is loaded via AJAX, initial HTML is a shell

print('Page Title:', soup.title.text)

except Exception as e:

print(f'Error encountered: {e}')Quando Usar

Ideal para páginas HTML estáticas com JavaScript mínimo. Perfeito para blogs, sites de notícias e páginas de produtos e-commerce simples.

Vantagens

- ●Execução mais rápida (sem overhead do navegador)

- ●Menor consumo de recursos

- ●Fácil de paralelizar com asyncio

- ●Ótimo para APIs e páginas estáticas

Limitações

- ●Não pode executar JavaScript

- ●Falha em SPAs e conteúdo dinâmico

- ●Pode ter dificuldades com sistemas anti-bot complexos

Como Fazer Scraping de Exploit Database com Código

Python + Requests

import requests

from bs4 import BeautifulSoup

# Exploit-DB uses Cloudflare; simple requests might be blocked

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Note: Main data is loaded via AJAX, initial HTML is a shell

print('Page Title:', soup.title.text)

except Exception as e:

print(f'Error encountered: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_exploit_db():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://www.exploit-db.com/')

# Wait for the DataTables to populate via AJAX

page.wait_for_selector('table#exploits-table')

rows = page.query_selector_all('table#exploits-table tbody tr')

for row in rows[:5]:

print(row.inner_text())

browser.close()

scrape_exploit_db()Python + Scrapy

import scrapy

class ExploitSpider(scrapy.Spider):

name = 'exploit_spider'

start_urls = ['https://www.exploit-db.com/']

def parse(self, response):

# Scrapy needs a JS middleware like scrapy-playwright for this site

for exploit in response.css('table#exploits-table tbody tr'):

yield {

'title': exploit.css('td.title a::text').get(),

'id': exploit.css('td.id::text').get(),

'cve': exploit.css('td.cve a::text').get()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://www.exploit-db.com/', { waitUntil: 'networkidle2' });

const results = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('table#exploits-table tbody tr'));

return rows.map(row => row.innerText);

});

console.log(results.slice(0, 5));

await browser.close();

})();O Que Você Pode Fazer Com Os Dados de Exploit Database

Explore aplicações práticas e insights dos dados de Exploit Database.

Feed de Inteligência de Ameaças em Tempo Real

Crie um feed contínuo de novos exploits para alertar as equipes de segurança sobre ameaças emergentes.

Como implementar:

- 1Configure uma coleta agendada da página inicial diariamente

- 2Compare os novos EDB-IDs com os registros coletados anteriormente

- 3Acione alertas no Slack ou e-mail para novos exploits críticos

Use Automatio para extrair dados de Exploit Database e construir essas aplicações sem escrever código.

O Que Você Pode Fazer Com Os Dados de Exploit Database

- Feed de Inteligência de Ameaças em Tempo Real

Crie um feed contínuo de novos exploits para alertar as equipes de segurança sobre ameaças emergentes.

- Configure uma coleta agendada da página inicial diariamente

- Compare os novos EDB-IDs com os registros coletados anteriormente

- Acione alertas no Slack ou e-mail para novos exploits críticos

- Correlação de Vulnerabilidades e Patching

Ajude as equipes de TI a priorizar patches de software com base na existência de código de exploit funcional.

- Extraia IDs de CVE e metadados de exploit associados

- Cruze as informações com listas internas de inventário de software

- Sinalize sistemas com exploits disponíveis publicamente para correção imediata

- Criação Automatizada de Assinaturas para SIEM

Extraia shellcode de prova de conceito para desenvolver assinaturas defensivas para detecção de intrusão.

- Navegue pelas páginas individuais de exploits e colete o código bruto

- Analise o código em busca de padrões de bytes exclusivos ou strings de rede

- Alimente os padrões extraídos em geradores de regras de SIEM ou IDS/IPS

- Análise Histórica de Tendências de Vulnerabilidade

Analise uma década de dados de exploits para entender quais plataformas são mais visadas ao longo do tempo.

- Colete todo o arquivo, incluindo datas, plataformas e tipos

- Agregue os dados por plataforma e ano

- Visualize tendências de ataque usando ferramentas de BI como Tableau ou PowerBI

- Datasets Acadêmicos de Cibersegurança

Forneça dados estruturados de alta qualidade para modelos de machine learning que preveem a confiabilidade de exploits.

- Colete exploits verificados versus não verificados

- Extraia o código-fonte bruto e os atributos de metadados

- Treine modelos para classificar padrões de código associados a exploits bem-sucedidos

Potencialize seu fluxo de trabalho com Automacao de IA

Automatio combina o poder de agentes de IA, automacao web e integracoes inteligentes para ajuda-lo a realizar mais em menos tempo.

Dicas Pro para Scraping de Exploit Database

Dicas de especialistas para extrair dados com sucesso de Exploit Database.

Interceptar Requisições XHR

Em vez de fazer scraping do HTML renderizado, procure pelas requisições JSON internas feitas pelo DataTables para extrair dados limpos e estruturados diretamente.

Usar Proxies Residenciais

Faça a rotação de IPs residenciais de alta qualidade para evitar o disparo do Web Application Firewall (WAF) agressivo do site e os limites de taxa.

Filtrar por Verificação

Verifique programaticamente o campo de status 'Verified' para priorizar códigos de exploit funcionais e de alta qualidade para seus datasets de segurança.

Normalizar Identificadores CVE

Sempre normalize as strings CVE extraídas em um formato padrão para garantir a fácil integração com outras bases de dados de vulnerabilidades, como o NVD.

Consultar o Mirror do GitLab

Antes de executar um scraping pesado, verifique o repositório oficial do Exploit-DB no GitLab para obter dados CSV em massa, que são mais fáceis de processar para registros históricos.

Depoimentos

O Que Nossos Usuarios Dizem

Junte-se a milhares de usuarios satisfeitos que transformaram seu fluxo de trabalho

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados Web Scraping

How to Scrape Biluppgifter.se: Vehicle Data Extraction Guide

How to Scrape CSS Author: A Comprehensive Web Scraping Guide

How to Scrape Bilregistret.ai: Swedish Vehicle Data Extraction Guide

How to Scrape The AA (theaa.com): A Technical Guide for Car & Insurance Data

How to Scrape Car.info | Vehicle Data & Valuation Extraction Guide

How to Scrape GoAbroad Study Abroad Programs

How to Scrape ResearchGate: Publication and Researcher Data

How to Scrape Statista: The Ultimate Guide to Market Data Extraction

Perguntas Frequentes Sobre Exploit Database

Encontre respostas para perguntas comuns sobre Exploit Database