Como fazer Scraping no jup.ag: Guia de Web Scraper para a Jupiter DEX

Aprenda como fazer scraping do jup.ag para obter preços de tokens Solana em tempo real, rotas de swap e volumes de mercado. Descubra as APIs oficiais da...

Proteção Anti-Bot Detectada

- Cloudflare

- WAF e gestão de bots de nível empresarial. Usa desafios JavaScript, CAPTCHAs e análise comportamental. Requer automação de navegador com configurações stealth.

- Limitação de taxa

- Limita requisições por IP/sessão ao longo do tempo. Pode ser contornado com proxies rotativos, atrasos de requisição e scraping distribuído.

- Fingerprinting de navegador

- Identifica bots pelas características do navegador: canvas, WebGL, fontes, plugins. Requer spoofing ou perfis de navegador reais.

- Fingerprinting de navegador

- Identifica bots pelas características do navegador: canvas, WebGL, fontes, plugins. Requer spoofing ou perfis de navegador reais.

Sobre Jupiter

Descubra o que Jupiter oferece e quais dados valiosos podem ser extraídos.

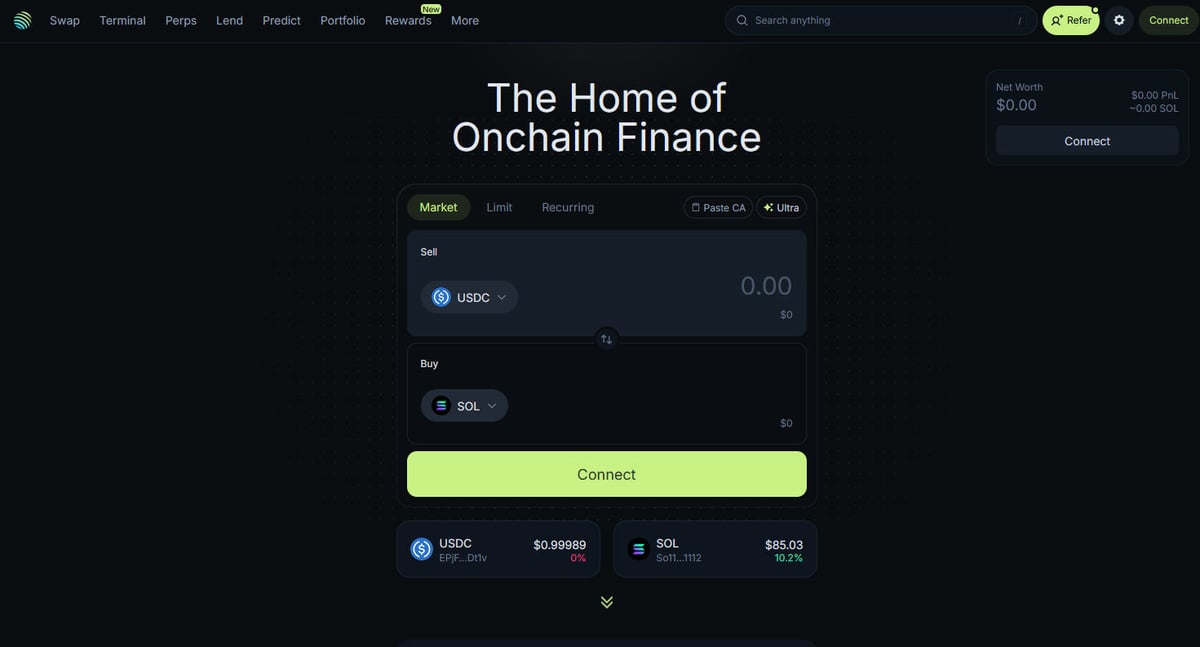

O Centro do DeFi na Solana

A Jupiter é o principal agregador de liquidez para a blockchain Solana, atuando como um "DeFi Superapp" que otimiza o roteamento de negociações em centenas de pools de liquidez para fornecer aos usuários os melhores preços e slippage mínimo. É o hub central para as finanças on-chain da Solana, oferecendo serviços que variam de simples swaps de tokens a recursos avançados, como negociação de perpétuos com alavancagem de até 250x, limit orders e dollar-cost averaging (DCA). A plataforma fornece dados críticos para o ecossistema, incluindo preços em tempo real, profundidade de liquidez e métricas de mercado abrangentes para milhares de ativos.

Arquitetura Técnica

O site é construído sobre uma stack técnica moderna usando Next.js e React, tornando-o uma aplicação de página única (SPA) altamente dinâmica. Como os preços e as rotas são calculados em tempo real com base no estado atual da blockchain, o frontend é constantemente atualizado via WebSockets e chamadas de API de alta frequência. Para cientistas de dados, desenvolvedores e traders, os dados da Jupiter são considerados o padrão ouro para acompanhar o sentimento do mercado da Solana e as mudanças de liquidez em todo o ecossistema.

Por que os Dados Importam

O acesso a esses dados é essencial para a construção de bots de negociação, dashboards de mercado e para a realização de análises históricas em uma das redes blockchain que mais cresce. Scrapers frequentemente visam a Jupiter para monitorar novas listagens de tokens, rastrear movimentos de "baleias" em mercados perpétuos ou identificar discrepâncias de preços para arbitragem. Embora a plataforma ofereça APIs oficiais, o scraping direto da web é frequentemente usado para capturar o estado exato da interface e dados de roteamento específicos que podem não estar totalmente expostos em endpoints públicos.

Por Que Fazer Scraping de Jupiter?

Descubra o valor comercial e os casos de uso para extração de dados de Jupiter.

Rastreamento de Preços em Tempo Real

Monitore os preços dos tokens Solana em tempo real para obter vantagem no altamente volátil mercado DeFi. A Jupiter agrega liquidez em todo o ecossistema, fornecendo as taxas de mercado mais precisas disponíveis.

Otimização de Bots de Trading

Alimente bots de trading automatizados com dados de rotas de swap de alta frequência e impacto no preço para arbitragem ou sniping. Isso permite uma execução mais rápida e melhor descoberta de preços em comparação ao trading manual.

Análise de Sentimento de Mercado

Acompanhe a adição de novos tokens à 'Strict List' da Jupiter para identificar projetos em tendência e a confiança da comunidade. Analisar mudanças de volume em diferentes ativos ajuda a prever movimentos mais amplos do mercado.

Monitoramento de Profundidade de Liquidez

Extraia dados de liquidez para determinar a profundidade de mercado de tokens SPL específicos e avaliar o potencial de slippage. Isso é crítico para traders de larga escala e provedores de liquidez institucional.

Dados de Desempenho Histórico

Colete o volume diário e o histórico de preços de tokens que podem não estar listados em exchanges centralizadas. Esses dados são essenciais para o backtesting de estratégias de trading e para a realização de pesquisas de mercado de longo prazo.

Métricas de Crescimento do Ecossistema

Meça o volume total e a contagem de transações na rede Solana usando a Jupiter como um proxy. Isso ajuda desenvolvedores e investidores a entender a taxa de adoção do DeFi na Solana ao longo do tempo.

Desafios do Scraping

Desafios técnicos que você pode encontrar ao fazer scraping de Jupiter.

Dependência de Renderização de JavaScript

A Jupiter é construída como uma Single Page Application (SPA) complexa usando React, o que significa que os dados não estão presentes no HTML inicial. Você deve usar uma ferramenta que possa renderizar totalmente o JavaScript para acessar preços e listas de tokens.

Proteção Agressiva do Cloudflare

O site utiliza o Web Application Firewall (WAF) do Cloudflare para bloquear tráfego que não seja de navegadores e scripts automatizados. Contornar esses desafios exige gerenciamento avançado de headers e fingerprinting de navegador.

Fluxo de Dados Dinâmico

Preços e rotas de swap são atualizados várias vezes por segundo via WebSockets e chamadas de API de alta frequência. Capturar snapshots consistentes desses dados requer uma infraestrutura de scraping de baixa latência e timing preciso.

Rate Limiting em Endpoints Públicos

Endpoints de API voltados ao público e rotas web têm limites de taxa rigorosos para evitar abusos. Exceder esses limites geralmente resulta em banimentos temporários ou permanentes de IP, tornando os proxies residenciais uma necessidade.

Volatilidade dos Seletores de UI

Atualizações frequentes no frontend da Jupiter podem fazer com que classes CSS e estruturas de DOM mudem sem aviso prévio. Isso exige que os scrapers tenham seletores robustos e flexíveis ou manutenção frequente para evitar quebras.

Scrape Jupiter com IA

Sem código necessário. Extraia dados em minutos com automação por IA.

Como Funciona

Descreva o que você precisa

Diga à IA quais dados você quer extrair de Jupiter. Apenas digite em linguagem natural — sem código ou seletores.

A IA extrai os dados

Nossa inteligência artificial navega Jupiter, lida com conteúdo dinâmico e extrai exatamente o que você pediu.

Obtenha seus dados

Receba dados limpos e estruturados prontos para exportar como CSV, JSON ou enviar diretamente para seus aplicativos.

Por Que Usar IA para Scraping

A IA facilita o scraping de Jupiter sem escrever código. Nossa plataforma com inteligência artificial entende quais dados você quer — apenas descreva em linguagem natural e a IA os extrai automaticamente.

How to scrape with AI:

- Descreva o que você precisa: Diga à IA quais dados você quer extrair de Jupiter. Apenas digite em linguagem natural — sem código ou seletores.

- A IA extrai os dados: Nossa inteligência artificial navega Jupiter, lida com conteúdo dinâmico e extrai exatamente o que você pediu.

- Obtenha seus dados: Receba dados limpos e estruturados prontos para exportar como CSV, JSON ou enviar diretamente para seus aplicativos.

Why use AI for scraping:

- Renderização Headless Completa: O Automatio lida nativamente com a pesada renderização de JavaScript da interface da Jupiter, garantindo que você veja os mesmos dados que um usuário humano. Você não precisa se preocupar com dados ausentes que só carregam após a visualização inicial da página.

- Rotação Inteligente de Proxy: A rotação integrada de proxies residenciais permite contornar o Cloudflare e o rate limiting baseado em IP sem esforço. Isso garante que suas sessões de scraping permaneçam ininterruptas, mesmo ao consultar dados em altas frequências.

- Seleção Visual de Dados: Selecione facilmente os preços, volumes ou rotas de tokens específicos que deseja extrair usando uma interface de apontar e clicar. Não há necessidade de escrever seletores XPath ou CSS complexos para atingir elementos dinâmicos.

- Agendamento Automatizado: Configure seus scrapers da Jupiter para rodar em um cronograma preciso, como a cada minuto ou a cada hora, para manter um conjunto de dados atualizado. Isso é perfeito para construir dashboards em tempo real ou alertas de preços automatizados.

- Integração Direta de Dados: Envie seus dados de DeFi extraídos diretamente para o Google Sheets, Airtable ou seu próprio banco de dados via Webhooks. Isso elimina a entrada manual de dados e otimiza seu fluxo de trabalho de trading ou pesquisa.

Scrapers Web No-Code para Jupiter

Alternativas point-and-click ao scraping com IA

Várias ferramentas no-code como Browse.ai, Octoparse, Axiom e ParseHub podem ajudá-lo a fazer scraping de Jupiter sem escrever código. Essas ferramentas usam interfaces visuais para selecionar dados, embora possam ter dificuldades com conteúdo dinâmico complexo ou medidas anti-bot.

Workflow Típico com Ferramentas No-Code

Desafios Comuns

Curva de aprendizado

Compreender seletores e lógica de extração leva tempo

Seletores quebram

Mudanças no site podem quebrar todo o fluxo de trabalho

Problemas com conteúdo dinâmico

Sites com muito JavaScript requerem soluções complexas

Limitações de CAPTCHA

A maioria das ferramentas requer intervenção manual para CAPTCHAs

Bloqueio de IP

Scraping agressivo pode resultar no bloqueio do seu IP

Scrapers Web No-Code para Jupiter

Várias ferramentas no-code como Browse.ai, Octoparse, Axiom e ParseHub podem ajudá-lo a fazer scraping de Jupiter sem escrever código. Essas ferramentas usam interfaces visuais para selecionar dados, embora possam ter dificuldades com conteúdo dinâmico complexo ou medidas anti-bot.

Workflow Típico com Ferramentas No-Code

- Instalar extensão do navegador ou registrar-se na plataforma

- Navegar até o site alvo e abrir a ferramenta

- Selecionar com point-and-click os elementos de dados a extrair

- Configurar seletores CSS para cada campo de dados

- Configurar regras de paginação para scraping de múltiplas páginas

- Resolver CAPTCHAs (frequentemente requer intervenção manual)

- Configurar agendamento para execuções automáticas

- Exportar dados para CSV, JSON ou conectar via API

Desafios Comuns

- Curva de aprendizado: Compreender seletores e lógica de extração leva tempo

- Seletores quebram: Mudanças no site podem quebrar todo o fluxo de trabalho

- Problemas com conteúdo dinâmico: Sites com muito JavaScript requerem soluções complexas

- Limitações de CAPTCHA: A maioria das ferramentas requer intervenção manual para CAPTCHAs

- Bloqueio de IP: Scraping agressivo pode resultar no bloqueio do seu IP

Exemplos de Código

import requests

def get_jupiter_price(token_address):

# Usar a Jupiter Price API V2 oficial é o método mais confiável

url = f"https://api.jup.ag/price/v2?ids={token_address}"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36",

"Accept": "application/json"

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

data = response.json()

price_info = data['data'].get(token_address)

if price_info:

print(f"Token: {token_address} | Preço: ${price_info['price']}")

except Exception as e:

print(f"Ocorreu um erro: {e}")

# Exemplo: Buscando o preço do SOL

get_jupiter_price("So11111111111111111111111111111111111111112")Quando Usar

Ideal para páginas HTML estáticas com JavaScript mínimo. Perfeito para blogs, sites de notícias e páginas de produtos e-commerce simples.

Vantagens

- ●Execução mais rápida (sem overhead do navegador)

- ●Menor consumo de recursos

- ●Fácil de paralelizar com asyncio

- ●Ótimo para APIs e páginas estáticas

Limitações

- ●Não pode executar JavaScript

- ●Falha em SPAs e conteúdo dinâmico

- ●Pode ter dificuldades com sistemas anti-bot complexos

Como Fazer Scraping de Jupiter com Código

Python + Requests

import requests

def get_jupiter_price(token_address):

# Usar a Jupiter Price API V2 oficial é o método mais confiável

url = f"https://api.jup.ag/price/v2?ids={token_address}"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36",

"Accept": "application/json"

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

data = response.json()

price_info = data['data'].get(token_address)

if price_info:

print(f"Token: {token_address} | Preço: ${price_info['price']}")

except Exception as e:

print(f"Ocorreu um erro: {e}")

# Exemplo: Buscando o preço do SOL

get_jupiter_price("So11111111111111111111111111111111111111112")Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_jupiter_tokens():

with sync_playwright() as p:

# Inicia um navegador que consegue renderizar o frontend em Next.js

browser = p.chromium.launch(headless=True)

context = browser.new_context(

user_agent="Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36"

)

page = context.new_page()

page.goto("https://jup.ag/tokens", wait_until="networkidle")

# Aguarda a renderização dos itens da lista de tokens no DOM

# Nota: Os seletores devem ser atualizados com base na build atual da interface

page.wait_for_selector(".token-item")

tokens = page.query_selector_all(".token-item")

for token in tokens[:10]:

name = token.query_selector(".token-name").inner_text()

price = token.query_selector(".token-price").inner_text()

print(f"{name}: {price}")

browser.close()

scrape_jupiter_tokens()Python + Scrapy

import scrapy

import json

class JupiterTokenSpider(scrapy.Spider):

name = 'jupiter_tokens'

# Acessando diretamente o endpoint JSON da lista de tokens usado pelo frontend

start_urls = ['https://token.jup.ag/all']

def parse(self, response):

# A resposta é uma lista JSON bruta de todos os tokens verificados

tokens = json.loads(response.text)

for token in tokens[:100]:

yield {

'symbol': token.get('symbol'),

'name': token.get('name'),

'address': token.get('address'),

'decimals': token.get('decimals'),

'logoURI': token.get('logoURI')

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

// Define um User-Agent realista para ajudar a contornar filtros básicos

await page.setUserAgent('Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36');

// Navega para a página principal de swap

await page.goto('https://jup.ag/', { waitUntil: 'networkidle2' });

// Exemplo de extração de um elemento de preço usando um seletor parcial

const solPrice = await page.evaluate(() => {

const element = document.querySelector('div[class*="price"]');

return element ? element.innerText : 'Preço não encontrado';

});

console.log(`Preço de SOL em tempo real observado na UI: ${solPrice}`);

await browser.close();

})();O Que Você Pode Fazer Com Os Dados de Jupiter

Explore aplicações práticas e insights dos dados de Jupiter.

Sistema de Alerta de Arbitragem de Preços

Identifique diferenças de preços entre a Jupiter e outras DEXs da Solana para executar negociações lucrativas.

Como implementar:

- 1Extraia taxas de swap em tempo real da Price API da Jupiter.

- 2Compare as taxas com os pools de liquidez da Orca e Raydium.

- 3Configure alertas automatizados ou hooks de execução para oportunidades de arbitragem.

Use Automatio para extrair dados de Jupiter e construir essas aplicações sem escrever código.

O Que Você Pode Fazer Com Os Dados de Jupiter

- Sistema de Alerta de Arbitragem de Preços

Identifique diferenças de preços entre a Jupiter e outras DEXs da Solana para executar negociações lucrativas.

- Extraia taxas de swap em tempo real da Price API da Jupiter.

- Compare as taxas com os pools de liquidez da Orca e Raydium.

- Configure alertas automatizados ou hooks de execução para oportunidades de arbitragem.

- Dashboard de Saúde do Mercado Solana

Crie uma visão em nível macro da atividade DeFi na Solana para investidores.

- Agregue o volume de 24h e dados de TVL para os principais tokens.

- Categorize os tokens por setores (Meme, AI, RWA).

- Visualize as mudanças de liquidez em diferentes classes de ativos ao longo do tempo.

- Sniper de Novas Listagens de Tokens

Detecte e analise novos tokens que aparecem na lista verificada da Jupiter imediatamente.

- Faça o scraping regular do endpoint da lista de tokens.

- Compare os novos resultados com um banco de dados local para encontrar novas adições.

- Analise a liquidez inicial e o volume para avaliar o potencial do token.

- Rastreador de Baleias e Perpétuos

Monitore grandes posições e taxas de financiamento no mercado de Perpétuos da Jupiter.

- Extraia dados de open interest e taxas de financiamento da seção Perps.

- Rastreie logs de grandes transações para identificar o comportamento das carteiras.

- Construa modelos de sentimento baseados nas proporções de long/short dos principais ativos.

- Serviço de Agregação de Yield

Forneça aos usuários as melhores taxas de empréstimo disponíveis nos cofres da Jupiter Lend.

- Extraia dados de APY para várias stablecoins e pares de SOL.

- Calcule o rendimento líquido após as taxas estimadas da plataforma.

- Automatize recomendações de rebalanceamento para otimização de portfólio.

Potencialize seu fluxo de trabalho com Automacao de IA

Automatio combina o poder de agentes de IA, automacao web e integracoes inteligentes para ajuda-lo a realizar mais em menos tempo.

Dicas Pro para Scraping de Jupiter

Dicas de especialistas para extrair dados com sucesso de Jupiter.

Priorize Endpoints Oficiais de API

Sempre que possível, use as APIs oficiais V6 de Quote ou Price da Jupiter em vez de fazer scraping da UI. Esses endpoints são projetados para acesso programático de alta performance e são geralmente mais estáveis.

Implemente Exponential Backoff

Quando suas requisições atingirem um rate limit, use uma estratégia que aumente progressivamente o tempo de espera entre as tentativas. Isso ajuda a evitar que seu IP seja sinalizado como malicioso pela camada de segurança da Jupiter.

Filtre via a Strict List

Faça o scraping da 'Strict List' de tokens da Jupiter para garantir que você está monitorando apenas ativos verificados. Esta é a melhor maneira de filtrar rugpulls de baixa liquidez e tokens de spam que aparecem na lista 'All'.

Use Proxies Residenciais de Alta Qualidade

Evite usar proxies de datacenter, pois eles costumam estar previamente na lista de bloqueio do Cloudflare. Proxies residenciais ou móveis transmitem mais confiança e têm menos probabilidade de acionar CAPTCHAs ou erros 403 Forbidden.

Monitore o Tráfego de WebSocket

Use o inspetor de rede do seu navegador para encontrar as conexões WebSocket que a Jupiter usa para atualizações ao vivo. Emular essas conexões pode ser mais eficiente do que recarregar a página para feeds de preços em tempo real.

Considere as Decimais do Token

Sempre extraia o campo 'decimals' dos metadados do token ao fazer o scraping de endereços de mint. Isso é crucial para converter corretamente números inteiros brutos on-chain em valores de moeda legíveis por humanos.

Depoimentos

O Que Nossos Usuarios Dizem

Junte-se a milhares de usuarios satisfeitos que transformaram seu fluxo de trabalho

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados Web Scraping

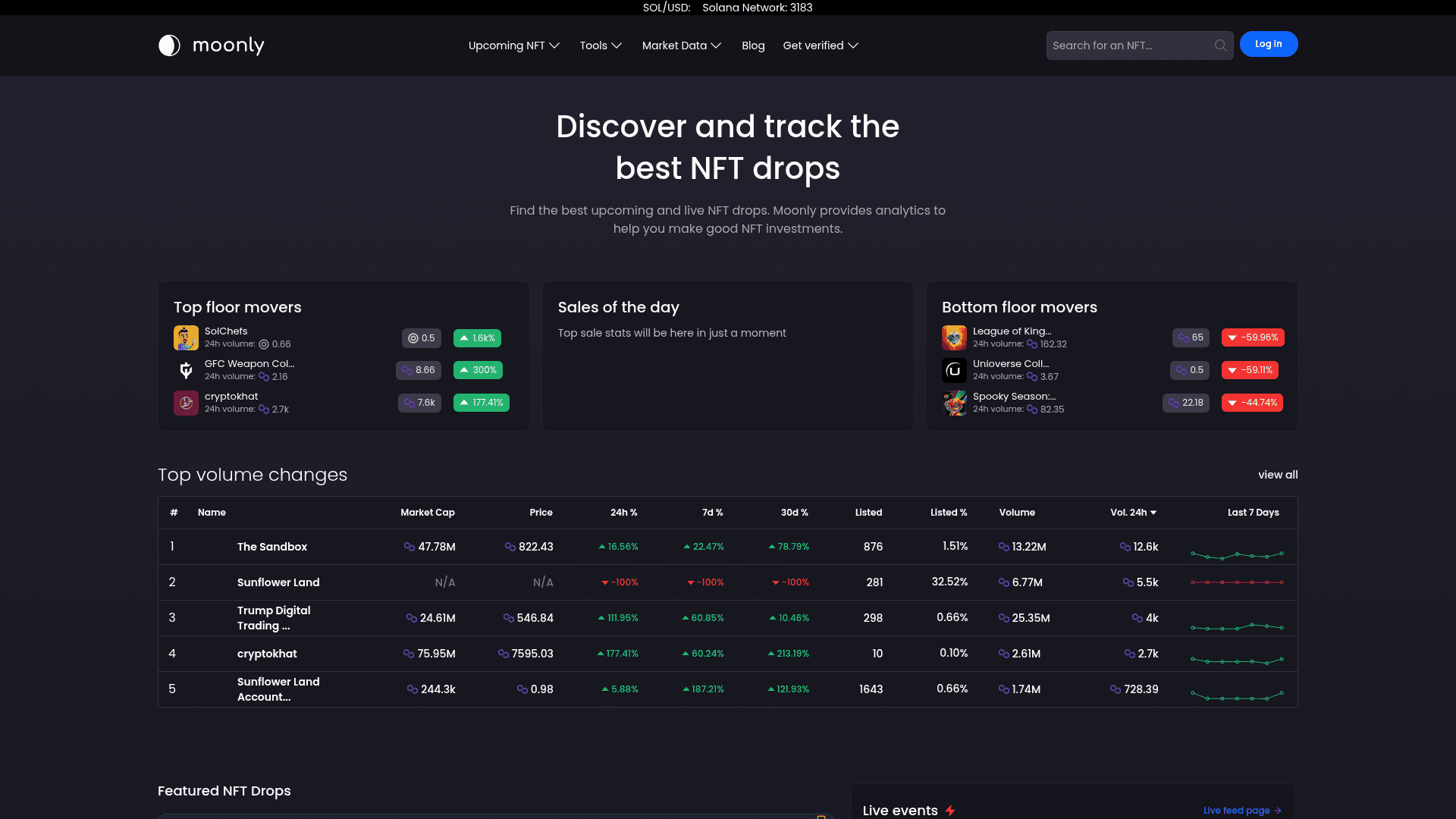

How to Scrape Moon.ly | Step-by-Step NFT Data Extraction Guide

How to Scrape Yahoo Finance: Extract Stock Market Data

How to Scrape Rocket Mortgage: A Comprehensive Guide

How to Scrape Open Collective: Financial and Contributor Data Guide

How to Scrape Indiegogo: The Ultimate Crowdfunding Data Extraction Guide

How to Scrape ICO Drops: Comprehensive Crypto Data Guide

How to Scrape Crypto.com: Comprehensive Market Data Guide

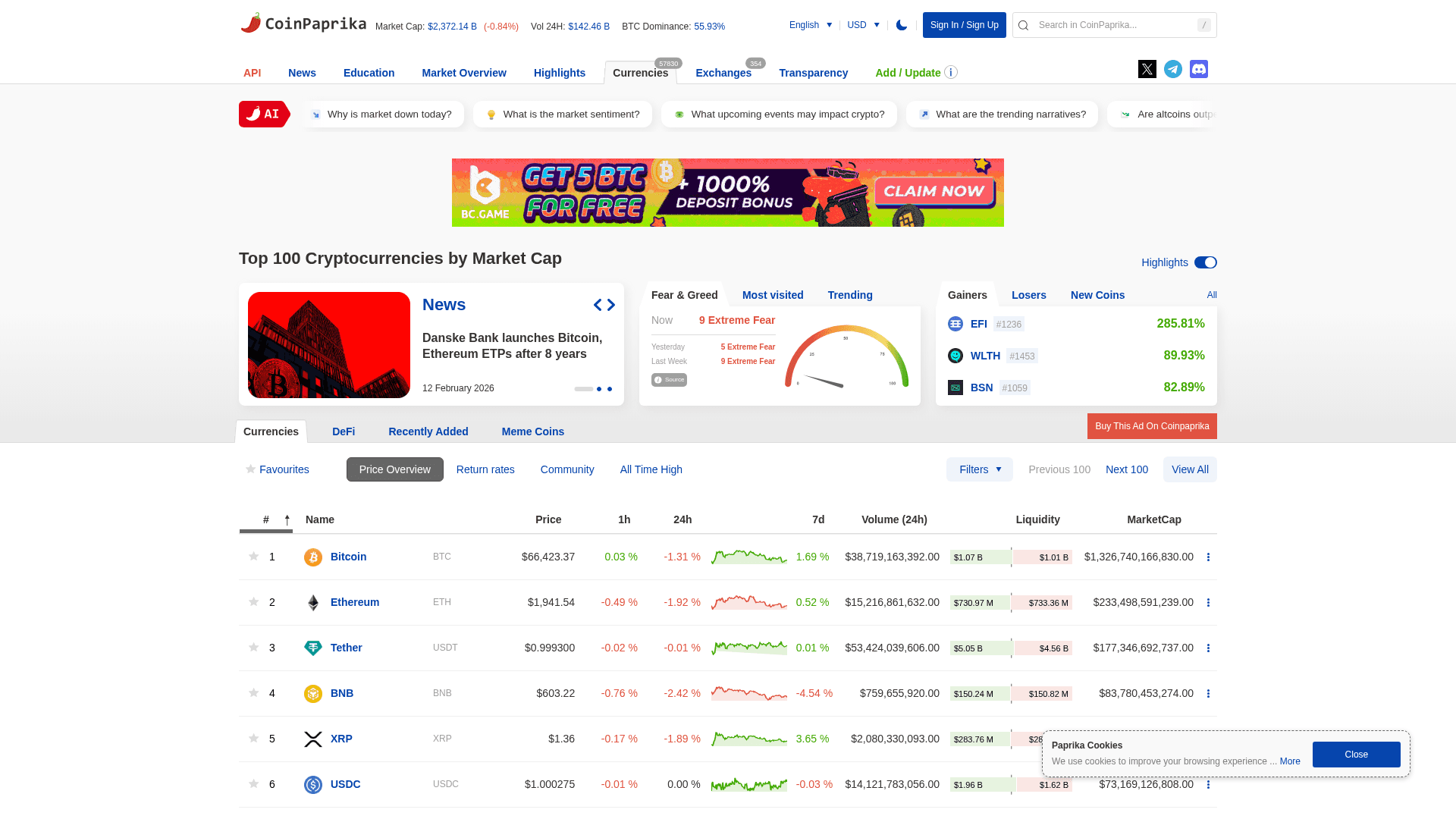

How to Scrape Coinpaprika: Crypto Market Data Extraction Guide

Perguntas Frequentes Sobre Jupiter

Encontre respostas para perguntas comuns sobre Jupiter