GLM-5.1

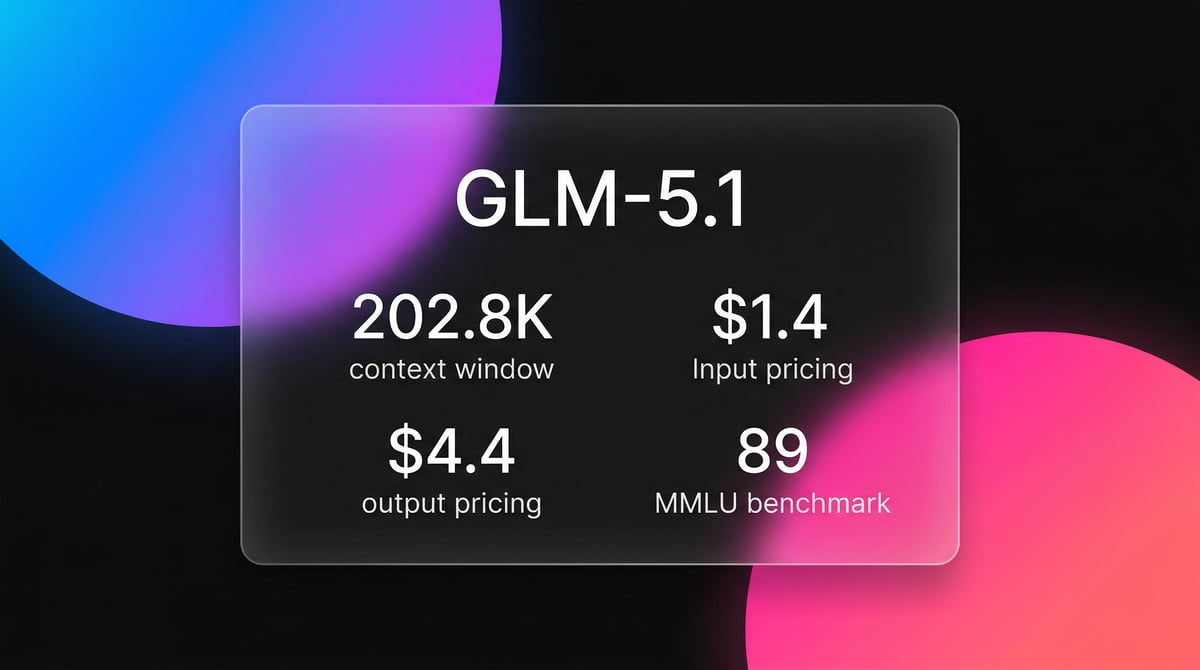

O GLM-5.1 é o modelo de reasoning flagship da Zhipu AI, com uma context window de 202K e um loop de execução autônomo de 8 horas para engenharia agentic...

Sobre GLM-5.1

Aprenda sobre as capacidades do GLM-5.1, recursos e como ele pode ajuda-lo a obter melhores resultados.

O GLM-5.1 é o modelo base flagship da Zhipu AI, projetado para engenharia de sistemas complexos e tarefas agentic de longo horizonte. Construído sobre uma arquitetura de Mixture-of-Experts (MoE) com 744 bilhões de parameters e 40 bilhões ativos por passagem, ele representa um salto significativo em resistência e resolução autônoma de problemas. O modelo foi especificamente projetado para superar os platôs de reasoning vistos em modelos de linguagem anteriores, mantendo a produtividade e a qualidade de código ao longo de milhares de tool-calls e centenas de iterações. Ele identifica bloqueadores, executa experimentos e ajusta sua própria estratégia sem intervenção humana.

Tecnicamente, o GLM-5.1 se destaca como um mecanismo de reasoning primário em sistemas multi-agentes. Ele lida com decisões arquiteturais de alto nível enquanto delega a implementação para modelos menores. Possui uma context window de 202K suportada por um mecanismo de atenção esparsa dinâmica, garantindo coerência em bases de código massivas. O modelo é lançado como pesos abertos sob a licença MIT, oferecendo uma alternativa local viável a modelos frontier proprietários para tarefas como otimização de banco de dados, engenharia de kernel de GPU e desenvolvimento de aplicações web full-stack.

Resultados do KernelBench Nível 3 mostram que o GLM-5.1 mantém uma aceleração significativa em workloads de ML agentic ao longo de turnos longos em comparação com o Claude Opus 4.6. Essa resistência permite que desenvolvedores iniciem uma tarefa de engenharia pela manhã e recebam um serviço totalmente testado e implantado até o fim do dia. Ele lida com todo o ciclo de vida de uma correção de bug, desde a reprodução do problema em um sandbox até o envio do pull request final.

Casos de Uso para GLM-5.1

Descubra as diferentes maneiras de usar GLM-5.1 para obter otimos resultados.

Engenharia de Software Autônoma

Executa de forma autônoma por mais de 8 horas para projetar, implementar e depurar microsserviços sem orientação humana.

Otimização de Banco de Dados de Alta Performance

O modelo otimiza iterativamente implementações de busca de vector baseadas em Rust ao longo de centenas de rodadas.

Otimização de Kernel de GPU

Analisa implementações de referência para produzir kernels de GPU mais rápidos que superam os compiladores de autotune padrão.

Orquestração de Multi-Agentes

Atua como um núcleo de reasoning que coordena subtarefas e tool-calls através de um enxame de modelos menores especializados.

Tarefas Complexas de Terminal

Executa operações de terminal do mundo real e administração de sistemas em várias etapas via ferramentas de CLI agentic.

Design Web Full-Stack

O modelo gera layouts de interface visualmente consistentes e lógica de backend para ambientes desktop baseados em navegador.

Pontos Fortes

Limitacoes

Inicio Rapido da API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimize this database schema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Instale o SDK e comece a fazer chamadas de API em minutos.

O Que as Pessoas Estao Dizendo Sobre GLM-5.1

Veja o que a comunidade pensa sobre GLM-5.1

“O GLM-5.1 rodou em um prompt por 8 horas seguidas. Ele não desistiu como a maioria dos modelos faz; ele continuou adicionando recursos e se autoavaliando.”

“Eu testei até 140k de contexto não menos que 5 vezes e ele permaneceu coerente. O SOTA pode ter um desafiante.”

“O GLM-5.1 está basicamente empatado com o Opus neste benchmark. É agora o modelo aberto nº 1 no Arena.”

“Cada vez que vejo um NPC ser genuinamente convencido através de um diálogo não roteirizado com o GLM-5.1, é pura mágica.”

“A performance de codificação é legítima. Ele corrigiu uma condição de corrida em nosso backend em Go sobre a qual o GPT-4o continuava alucinando.”

“Rodar isso localmente com Unsloth é um divisor de águas para a privacidade de dados em nossa stack jurídica.”

Videos Sobre GLM-5.1

Assista tutoriais, analises e discussoes sobre GLM-5.1

“O GLM-5.1 obteve 45,3% neste benchmark, o que é um salto substancial para a família.”

“É um modelo incrivelmente lento... eles provavelmente têm mais GPUs servindo o GLM-5.”

“A forma como ele lida com tool-calls é muito mais robusta do que o GLM 5 padrão.”

“É atualmente o modelo de reasoning mais forte que você pode baixar e rodar no seu próprio hardware.”

“Você pode vê-lo identificando seus próprios erros no log de pensamento.”

“Ele pode rodar autonomamente por 8 horas, refinando estratégias através de milhares de iterações.”

“Ele supera o Gemini 3.1 Pro e o Qwen 3.6 Plus em benchmarks populares de geração de repositórios.”

“O modo agentic é onde este modelo realmente brilha; ele não desiste de bugs difíceis.”

“A Z.ai basicamente derrubou o paywall de um modelo de 744B parameters de nível frontier.”

“Ele gerencia efetivamente o problema do 'platô' onde outros LLMs perdem o foco com o tempo.”

“Redução de tamanho de 80% do 1,65 TB original para 236 GB, mantendo a qualidade.”

“O poder do open-source: mesmo em uma versão quantizada, ele escreveu código funcional para fogos de artifício.”

“Você precisará de pelo menos 256 GB de RAM do sistema para sequer pensar em carregar esse gigante MoE.”

“Ele utiliza um mecanismo de atenção esparsa dinâmica para manter aquela context window de 202k coerente.”

“O uso do Unsloth torna o processo de treinamento e inference significativamente mais eficiente.”

Potencialize seu fluxo de trabalho com Automacao de IA

Automatio combina o poder de agentes de IA, automacao web e integracoes inteligentes para ajuda-lo a realizar mais em menos tempo.

Dicas Profissionais para GLM-5.1

Dicas de especialistas para ajuda-lo a aproveitar ao maximo GLM-5.1 e obter melhores resultados.

Ativar o Modo de Pensamento (Thinking Mode)

Certifique-se de que o botão 'Thinking' esteja ativado em sua configuração para desbloquear as capacidades de iteração autônoma de 8 horas.

Usar Quotas fora do Horário de Pico

Execute grandes lotes de engenharia fora do horário de pico (entre 14:00 e 18:00, horário de Pequim) para obter preços melhores.

Requisitos de Memória Local

Use a quantização Unsloth Dynamic GGUF para ajustar o modelo de 1.6TB em 256GB de memória do sistema para execuções locais.

Seleção Estratégica de Tarefas

Reserve o GLM-5.1 para reasoning arquitetural e use o GLM-4.7 para implementações de rotina para gerenciar custos.

Depoimentos

O Que Nossos Usuarios Dizem

Junte-se a milhares de usuarios satisfeitos que transformaram seu fluxo de trabalho

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Perguntas Frequentes Sobre GLM-5.1

Encontre respostas para perguntas comuns sobre GLM-5.1