GLM-5.1

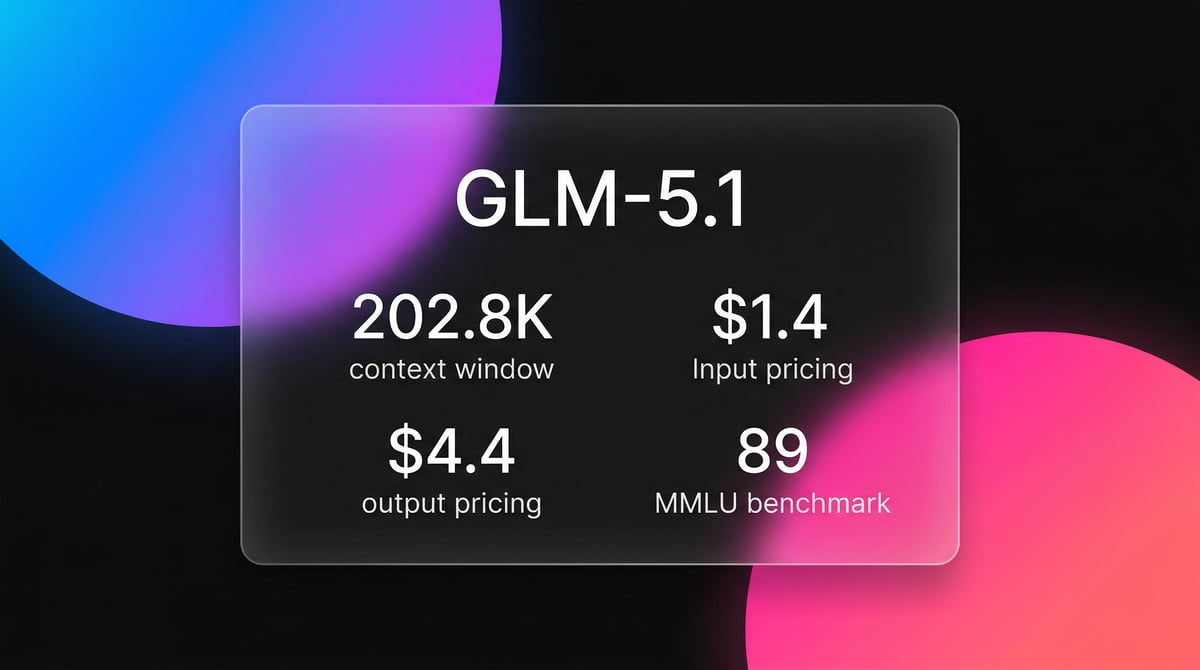

GLM-5.1 este modelul de raționament flagship de la Zhipu AI, cu o context window de 202K și o buclă de execuție autonomă de 8 ore pentru inginerie agentică...

Despre GLM-5.1

Afla despre capabilitatile lui GLM-5.1, caracteristici si cum te poate ajuta sa obtii rezultate mai bune.

GLM-5.1 este modelul fundație flagship de la Zhipu AI, conceput pentru ingineria de sisteme complexe și sarcini agentice pe termen lung. Construit pe o arhitectură Mixture-of-Experts (MoE) cu 744 miliarde de parametri și 40 miliarde activi per trecere, reprezintă un salt semnificativ în anduranță și rezolvarea autonomă a problemelor. Modelul este special conceput pentru a depăși platourile de raționament observate la modelele de limbaj anterioare, menținând productivitatea și calitatea codului pe parcursul a mii de apeluri de instrumente și sute de iterații. Identifică blocajele, rulează experimente și își ajustează propria strategie fără intervenție umană.

Din punct de vedere tehnic, GLM-5.1 excelează ca motor de raționament primar în sistemele multi-agent. Gestionează deciziile arhitecturale de nivel înalt, delegând implementarea către modele mai mici. Dispune de o context window de 202K susținută de un mecanism de atenție dinamică rară (sparse attention), asigurând coerența pe bazele de cod masive. Modelul este lansat sub licența MIT, oferind o alternativă locală viabilă la modelele frontieră proprietare pentru sarcini precum optimizarea bazelor de date, ingineria kernel-ului GPU și dezvoltarea de aplicații web full-stack.

Rezultatele KernelBench Nivel 3 arată că GLM-5.1 menține o viteză semnificativ mai mare în workload-urile de ML agentic pe parcursuri lungi, comparativ cu Claude Opus 4.6. Această anduranță permite dezvoltatorilor să declanșeze o sarcină de inginerie dimineața și să primească un serviciu complet testat și implementat până la sfârșitul zilei. Gestionează întregul ciclu de viață al unei corecții de bug, de la reproducerea problemei într-un sandbox până la trimiterea pull request-ului final.

Cazuri de utilizare pentru GLM-5.1

Descopera diferitele moduri in care poti folosi GLM-5.1 pentru a obtine rezultate excelente.

Inginerie software autonomă

Rulează autonom timp de peste 8 ore pentru a proiecta, implementa și depana microservicii fără îndrumare umană.

Optimizarea bazelor de date de înaltă performanță

Modelul optimizează iterativ implementările de căutare vector (vector search) bazate pe Rust pe parcursul a sute de runde.

Optimizarea kernel-ului GPU

Analizează implementările de referință pentru a produce kernel-uri GPU mai rapide care depășesc compilatoarele autotune standard.

Orchestrare multi-agent

Acționează ca un motor de raționament care coordonează sub-sarcini și apeluri de instrumente (tool-calls) într-un grup de modele specializate mai mici.

Sarcini complexe în terminal

Execută operațiuni reale în terminal și administrare de sistem în mai mulți pași prin intermediul instrumentelor CLI agentice.

Design Web Full-Stack

Modelul generează layout-uri UI vizual consistente și logica backend pentru medii desktop bazate pe browser.

Puncte forte

Limitari

Start rapid API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimizează această schemă de bază de date.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Instaleaza SDK-ul si incepe sa faci apeluri API in cateva minute.

Ce spun oamenii despre GLM-5.1

Vezi ce crede comunitatea despre GLM-5.1

“GLM-5.1 a rulat în buclă pe un prompt timp de 8 ore întregi. Nu a renunțat ca majoritatea modelelor; a continuat să adauge funcționalități și să se revizuiască singur.”

“L-am testat intens până la 140k context de cel puțin 5 ori și a rămas coerent. SOTA s-ar putea să aibă un competitor.”

“GLM-5.1 este practic la egalitate cu Opus în acest benchmark. Este acum modelul open #1 în Arena.”

“De fiecare dată când văd un NPC convis sincer printr-un dialog nescriptat cu GLM-5.1, este pură magie.”

“Performanța de codare este legitimă. A reparat o problemă de tip race condition în backend-ul nostru Go, despre care GPT-4o tot halucina.”

“Rularea acestui model local cu Unsloth schimbă regulile jocului pentru confidențialitatea datelor în stack-ul nostru tehnologic juridic.”

Videoclipuri despre GLM-5.1

Urmareste tutoriale, recenzii si discutii despre GLM-5.1

“GLM-5.1 a obținut 45,3% pe acest benchmark, ceea ce reprezintă un salt substanțial pentru această familie.”

“Este un model incredibil de lent... probabil că au mai multe GPU-uri care servesc încă GLM-5.”

“Modul în care gestionează apelurile de instrumente este mult mai robust decât GLM 5 standard.”

“În prezent este cel mai puternic model de raționament pe care îl poți descărca și rula pe propriul hardware.”

“Poți vedea cum identifică singur greșelile în log-ul de gândire.”

“Poate rula autonom timp de 8 ore, rafinând strategii prin mii de iterații.”

“Depășește Gemini 3.1 Pro și Qwen 3.6 Plus în benchmark-urile populare de generare de repo-uri.”

“Modul agentic este punctul forte al acestui model, nu renunță la bug-urile dificile.”

“Z.ai a eliminat practic bariera de plată pentru un model de 744B parametri de nivel frontieră.”

“Gestionează eficient problema 'plafonului' unde alte LLM-uri își pierd concentrarea în timp.”

“Reducere a dimensiunii cu 80%, de la 1,65 TB originali la 236 GB, menținând calitatea.”

“Puterea open-source: chiar și într-o versiune cuantizată, a scris cod funcțional pentru artificii.”

“Vei avea nevoie de cel puțin 256 GB RAM pentru a te gândi măcar la încărcarea acestui gigant MoE.”

“Utilizează un mecanism de atenție dinamică rară (sparse attention) pentru a menține coerența acelui context de 202k.”

“Utilizarea Unsloth face procesul de training și inference semnificativ mai eficient.”

Supraalimenteaza-ti fluxul de lucru cu automatizare AI

Automatio combina puterea agentilor AI, automatizarea web si integrarile inteligente pentru a te ajuta sa realizezi mai mult in mai putin timp.

Sfaturi Pro pentru GLM-5.1

Sfaturi de expert care te ajuta sa obtii maximul din GLM-5.1 si sa obtii rezultate mai bune.

Activarea modului Thinking

Asigurați-vă că opțiunea 'Thinking' este activată în configurația dumneavoastră pentru a debloca capacitățile de iterație autonomă de 8 ore.

Utilizarea cotelor în afara orelor de vârf

Rulați loturi mari de inginerie în afara intervalului orar 14:00-18:00 (ora Beijingului) pentru prețuri mai avantajoase.

Cerințe pentru memorie locală

Folosiți cuantizarea Unsloth Dynamic GGUF pentru a încadra modelul de 1,6 TB în 256 GB de RAM pentru execuții locale.

Selectarea strategică a sarcinilor

Rezervați GLM-5.1 pentru raționament arhitectural și utilizați GLM-4.7 pentru implementări de rutină pentru a optimiza costurile.

Testimoniale

Ce spun utilizatorii nostri

Alatura-te miilor de utilizatori multumiti care si-au transformat fluxul de lucru

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Similar AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Intrebari frecvente despre GLM-5.1

Gaseste raspunsuri la intrebarile comune despre GLM-5.1