GLM-5.1

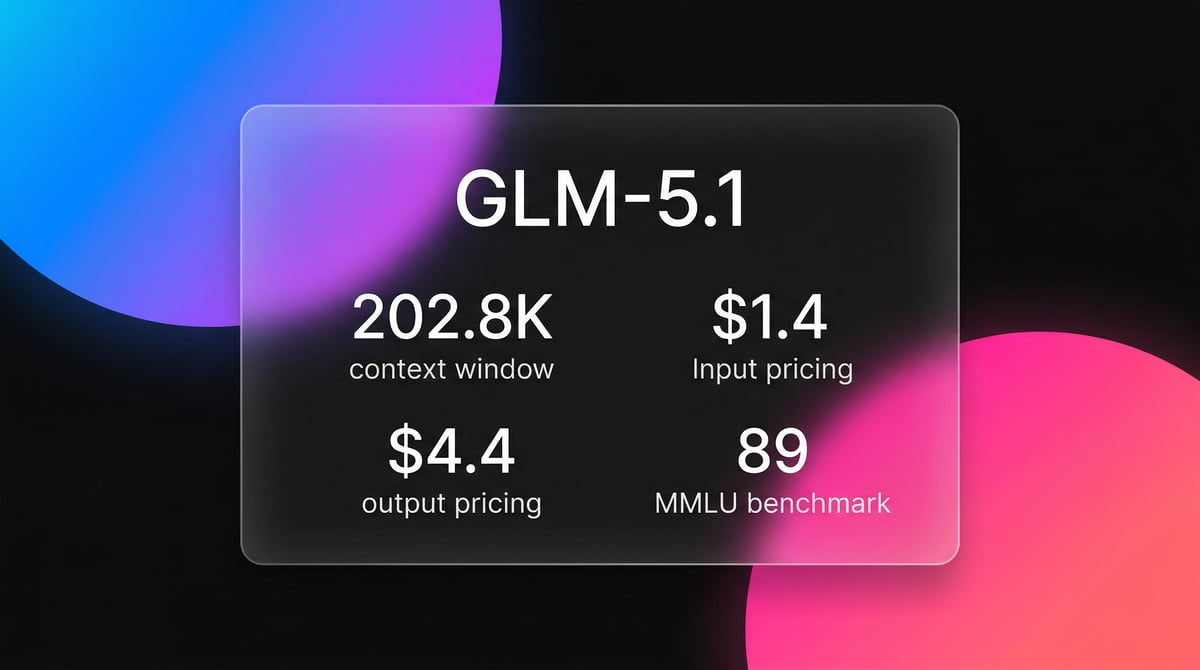

GLM-5.1 — флагманская reasoning-модель Zhipu AI с context window 202K и 8-часовым циклом автономного исполнения для сложных инженерных agentic-задач.

О модели GLM-5.1

Узнайте о возможностях, функциях и способах использования GLM-5.1.

GLM-5.1, флагманская foundation-модель Zhipu AI, предназначенная для сложного системного проектирования и долгосрочных agentic-задач. Построенная на архитектуре Mixture-of-Experts (MoE) с 744 миллиардами параметров (40 миллиардов активны на один проход), она представляет собой значительный скачок в выносливости и автономном решении проблем. Модель специально разработана для преодоления «плато» reasoning, наблюдаемого у предыдущих LLM, поддерживая продуктивность и качество кода на протяжении тысяч вызовов инструментов и сотен итераций. Она самостоятельно выявляет блокировщики, проводит эксперименты и корректирует свою стратегию без вмешательства человека.

Технически GLM-5.1 превосходно работает как основное ядро reasoning в мультиагентных системах. Она берет на себя принятие высокоуровневых архитектурных решений, делегируя реализацию более компактным моделям. Модель обладает 202K context window, поддерживаемым механизмом динамического разреженного внимания, что обеспечивает связность при работе с огромными кодовыми базами. Модель выпущена с открытыми весами по лицензии MIT, предоставляя жизнеспособную локальную альтернативу проприетарным frontier-моделям для таких задач, как оптимизация баз данных, проектирование GPU-ядер и разработка full-stack веб-приложений.

Результаты KernelBench Level 3 показывают, что GLM-5.1 сохраняет значительное преимущество в скорости выполнения agentic ML-задач при длинных сессиях по сравнению с Claude Opus 4.6. Эта выносливость позволяет разработчикам запустить инженерную задачу утром и получить полностью протестированный, развернутый сервис к концу дня. Она берет на себя весь жизненный цикл исправления багов: от воспроизведения проблемы в песочнице до отправки итогового pull request.

Варианты использования GLM-5.1

Откройте для себя различные способы использования GLM-5.1 для достижения отличных результатов.

Автономная разработка ПО

Модель работает автономно более 8 часов, проектируя, внедряя и отлаживая микросервисы без участия человека.

Высокопроизводительная настройка баз данных

Модель итеративно оптимизирует реализацию vector search на Rust в течение сотен циклов.

Оптимизация GPU-ядер

Анализирует эталонные реализации для создания более быстрых GPU-ядер, превосходящих стандартные компиляторы с автонастройкой.

Оркестрация multi-agent систем

Выступает в качестве ядра reasoning, координирующего подзадачи и вызовы инструментов среди целого «роя» специализированных моделей.

Сложные задачи в CLI

Выполняет реальные операции в терминале и многошаговое администрирование системы с помощью agentic CLI-инструментов.

Full-stack веб-дизайн

Модель генерирует визуально согласованные UI-макеты и backend-логику для веб-приложений.

Преимущества

Ограничения

Быстрый старт API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Оптимизируй эту схему базы данных.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Установите SDK и начните делать API-запросы за несколько минут.

Что люди говорят о GLM-5.1

Посмотрите, что думает сообщество о GLM-5.1

“GLM-5.1 крутила один prompt 8 часов подряд. Она не сдалась, как большинство моделей; она продолжала добавлять функции и проводить самопроверку.”

“Я тестировал её на 140k context не менее 5 раз, и она оставалась связной. У SOTA, похоже, появился конкурент.”

“GLM-5.1 идет ноздря в ноздрю с Opus в этом бенчмарке. Сейчас это open-модель №1 на арене.”

“Каждый раз, когда я вижу, как NPC искренне убеждается в чем-то через нескриптованный диалог с GLM-5.1, это чистое волшебство.”

“Производительность в коде, настоящая. Она исправила race condition в нашем Go backend, о которой GPT-4o постоянно галлюцинировала.”

“Запуск её локально с Unsloth, это прорыв для конфиденциальности данных в нашем юридическом тех-стеке.”

Видео о GLM-5.1

Смотрите обучающие материалы, обзоры и обсуждения о GLM-5.1

“GLM-5.1 набрала 45,3% в этом бенчмарке, что является значительным скачком для этого семейства.”

“Это невероятно медленная модель... вероятно, большинство их GPU всё еще обслуживают GLM-5.”

“То, как она обрабатывает вызовы инструментов, гораздо надежнее, чем в стандартной GLM 5.”

“На данный момент это самая мощная reasoning-модель, которую можно скачать и запустить на своем железе.”

“Вы можете видеть, как она действительно находит свои ошибки в логах рассуждений (thinking log).”

“Она может работать автономно 8 часов, совершенствуя стратегии через тысячи итераций.”

“Она превосходит Gemini 3.1 Pro и Qwen 3.6 Plus в популярных бенчмарках по генерации кода.”

“Agentic-режим, это то, в чем модель по-настоящему сияет: она не сдается перед сложными багами.”

“Z.ai фактически сняли платный барьер с 744B-параметра frontier-модели.”

“Она эффективно решает проблему «плато», где другие LLM со временем теряют концентрацию.”

“Уменьшение размера на 80% от исходных 1,65 ТБ до 236 ГБ при сохранении качества.”

“Сила open-source: даже в квантованной версии она написала рабочий код для fireworks.”

“Вам потребуется минимум 256 ГБ системной RAM, чтобы просто подумать о загрузке этого MoE-гиганта.”

“Она использует механизм динамического разреженного внимания (sparse attention), чтобы удерживать связность 202k context.”

“Использование Unsloth делает процесс fine-tuning и inference значительно эффективнее.”

Улучшите свой рабочий процесс с ИИ-Автоматизацией

Automatio объединяет мощь ИИ-агентов, веб-автоматизации и умных интеграций, чтобы помочь вам достигать большего за меньшее время.

Советы для GLM-5.1

Экспертные советы для максимальной эффективности GLM-5.1.

Включение режима Thinking

Убедитесь, что переключатель 'Thinking' активирован в конфигурации, чтобы разблокировать возможность 8-часовой автономной итерации.

Использование квот вне пиковых часов

Запускайте крупные инженерные пакеты задач в непиковые часы (вне периода 14:00–18:00 по пекинскому времени) для экономии средств.

Требования к локальной памяти

Используйте квантование Unsloth Dynamic GGUF, чтобы уместить модель объемом 1,6 ТБ в 256 ГБ системной RAM при локальном запуске.

Стратегический выбор задач

Оставьте GLM-5.1 для архитектурного reasoning, а для рутинных задач используйте GLM-4.7, чтобы оптимизировать расходы.

Отзывы

Что Говорят Наши Пользователи

Присоединяйтесь к тысячам довольных пользователей, которые трансформировали свой рабочий процесс

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Похожие AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Часто задаваемые вопросы о GLM-5.1

Найдите ответы на частые вопросы о GLM-5.1