Hur man skrapar Exploit-DB | Exploit Database Web Scraper

Lär dig hur du skrapar Exploit-DB för sårbarhetsdata, exploit-koder och CVE-referenser för att driva cybersäkerhetsforskning och automatiserade flöden för...

Anti-bot-skydd upptäckt

- Cloudflare

- WAF och bothantering på företagsnivå. Använder JavaScript-utmaningar, CAPTCHA och beteendeanalys. Kräver webbläsarautomatisering med stealth-inställningar.

- Hastighetsbegränsning

- Begränsar förfrågningar per IP/session över tid. Kan kringgås med roterande proxyservrar, fördröjda förfrågningar och distribuerad skrapning.

- IP-blockering

- Blockerar kända datacenter-IP:er och flaggade adresser. Kräver bostads- eller mobilproxyservrar för effektiv kringgång.

- JavaScript-utmaning

- Kräver JavaScript-exekvering för att komma åt innehåll. Enkla förfrågningar misslyckas; headless-webbläsare som Playwright eller Puppeteer behövs.

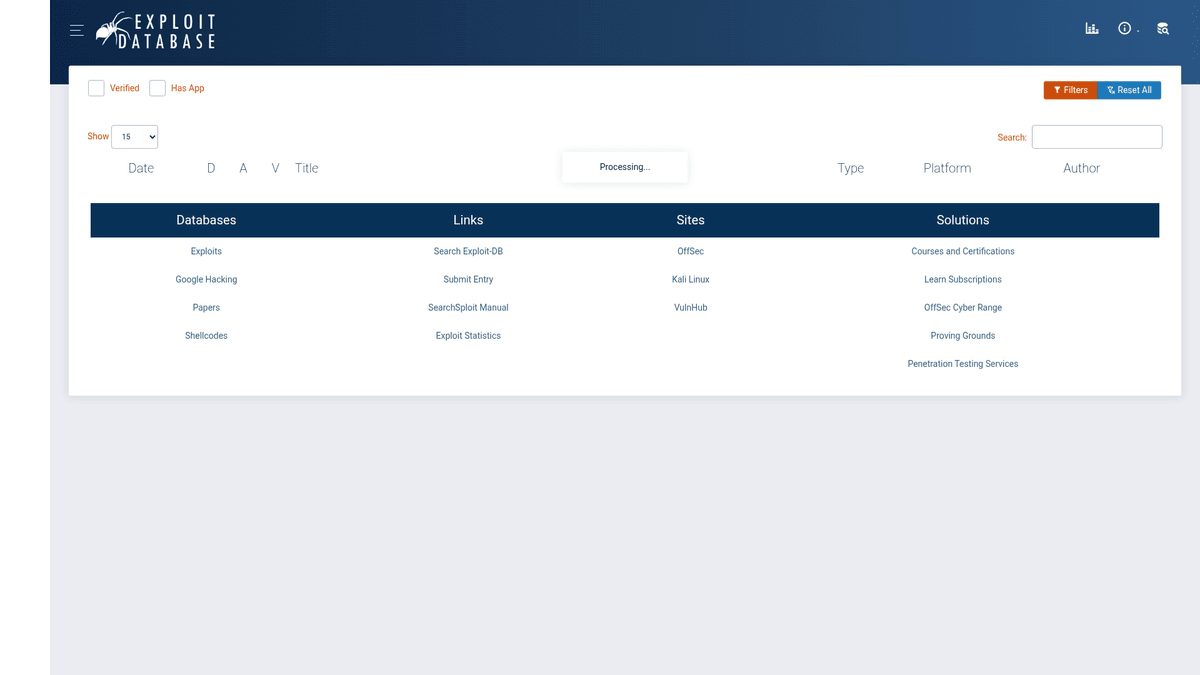

Om Exploit Database

Upptäck vad Exploit Database erbjuder och vilka värdefulla data som kan extraheras.

Omfattande sårbarhetsarkiv

Exploit Database (Exploit-DB) är ett CVE-kompatibelt arkiv med publika exploits och motsvarande sårbar programvara, utvecklat för att användas av penetrationstestare och sårbarhetsforskare. Det underhålls av OffSec (Offensive Security) och fungerar som ett centralt nav för cybersäkerhetscommunityn för att dela proof-of-concept-kod och forskning över olika plattformar och applikationer. Arkivet är en av de mest betrodda källorna för säkerhetsexperter världen över.

Datakategorisering och djup

Webbplatsen organiserar data i detaljerade kategorier som Remote Exploits, Web Applications, Local Exploits och Shellcodes. Varje post innehåller vanligtvis exploit-titel, datum, författare, plattform, tillhörande CVE ID och själva koden. Detta strukturerade tillvägagångssätt gör det möjligt för forskare att snabbt växla mellan olika typer av sårbarheter och deras historiska sammanhang.

Strategiskt värde för säkerhetsverksamhet

Att skrapa denna data är mycket värdefullt för Security Operations Centers (SOCs) och team för hotinformation för att korrelera kända exploits med interna sårbarheter. Genom att automatisera extraktionen av PoC-kod och metadata kan organisationer skapa anpassade säkerhetssignaturer, förbättra sin livscykel för sårbarhetshantering och bygga robusta flöden för hotinformation.

Varför Skrapa Exploit Database?

Upptäck affärsvärdet och användningsfallen för dataextraktion från Exploit Database.

Insamling av hotinformation i realtid

Synkronisering av sårbarhetsdatabaser

Automatiserad säkerhetsforskning och utveckling

Integrering med sårbarhetsskannrar

Historisk analys av attacktrender

Skapande av anpassade säkerhetssignaturer

Skrapningsutmaningar

Tekniska utmaningar du kan stöta på när du skrapar Exploit Database.

Aggressivt Cloudflare-skydd som kräver avancerad TLS-fingerprinting

Dynamisk laddning av innehåll via AJAX för DataTables

Frekvent IP-blockering vid anrop med hög frekvens

Strikt rate limiting vid nedladdning av rå PoC-kod

Komplex nästlad HTML-struktur för exploit-detaljer

Skrapa Exploit Database med AI

Ingen kod krävs. Extrahera data på minuter med AI-driven automatisering.

Hur det fungerar

Beskriv vad du behöver

Berätta för AI vilka data du vill extrahera från Exploit Database. Skriv det bara på vanligt språk — ingen kod eller selektorer behövs.

AI extraherar datan

Vår artificiella intelligens navigerar Exploit Database, hanterar dynamiskt innehåll och extraherar exakt det du bad om.

Få dina data

Få ren, strukturerad data redo att exportera som CSV, JSON eller skicka direkt till dina appar och arbetsflöden.

Varför använda AI för skrapning

AI gör det enkelt att skrapa Exploit Database utan att skriva kod. Vår AI-drivna plattform använder artificiell intelligens för att förstå vilka data du vill ha — beskriv det bara på vanligt språk och AI extraherar dem automatiskt.

How to scrape with AI:

- Beskriv vad du behöver: Berätta för AI vilka data du vill extrahera från Exploit Database. Skriv det bara på vanligt språk — ingen kod eller selektorer behövs.

- AI extraherar datan: Vår artificiella intelligens navigerar Exploit Database, hanterar dynamiskt innehåll och extraherar exakt det du bad om.

- Få dina data: Få ren, strukturerad data redo att exportera som CSV, JSON eller skicka direkt till dina appar och arbetsflöden.

Why use AI for scraping:

- Hanterar Cloudflare- och JavaScript-utmaningar automatiskt

- Körs nativt för ren extraktion av DataTables

- Schemalagda körningar för zero-day-övervakning dygnet runt

- No-code-gränssnitt eliminerar underhåll av komplexa kringgåendemetoder

- Direkt export till strukturerad JSON för SOC-integrering

No-code webbskrapare för Exploit Database

Peka-och-klicka-alternativ till AI-driven skrapning

Flera no-code-verktyg som Browse.ai, Octoparse, Axiom och ParseHub kan hjälpa dig att skrapa Exploit Database utan att skriva kod. Dessa verktyg använder vanligtvis visuella gränssnitt för att välja data, även om de kan ha problem med komplext dynamiskt innehåll eller anti-bot-åtgärder.

Typiskt arbetsflöde med no-code-verktyg

Vanliga utmaningar

Inlärningskurva

Att förstå selektorer och extraktionslogik tar tid

Selektorer går sönder

Webbplatsändringar kan förstöra hela ditt arbetsflöde

Problem med dynamiskt innehåll

JavaScript-tunga sidor kräver komplexa lösningar

CAPTCHA-begränsningar

De flesta verktyg kräver manuell hantering av CAPTCHAs

IP-blockering

Aggressiv scraping kan leda till att din IP blockeras

No-code webbskrapare för Exploit Database

Flera no-code-verktyg som Browse.ai, Octoparse, Axiom och ParseHub kan hjälpa dig att skrapa Exploit Database utan att skriva kod. Dessa verktyg använder vanligtvis visuella gränssnitt för att välja data, även om de kan ha problem med komplext dynamiskt innehåll eller anti-bot-åtgärder.

Typiskt arbetsflöde med no-code-verktyg

- Installera webbläsartillägg eller registrera dig på plattformen

- Navigera till målwebbplatsen och öppna verktyget

- Välj dataelement att extrahera med point-and-click

- Konfigurera CSS-selektorer för varje datafält

- Ställ in pagineringsregler för att scrapa flera sidor

- Hantera CAPTCHAs (kräver ofta manuell lösning)

- Konfigurera schemaläggning för automatiska körningar

- Exportera data till CSV, JSON eller anslut via API

Vanliga utmaningar

- Inlärningskurva: Att förstå selektorer och extraktionslogik tar tid

- Selektorer går sönder: Webbplatsändringar kan förstöra hela ditt arbetsflöde

- Problem med dynamiskt innehåll: JavaScript-tunga sidor kräver komplexa lösningar

- CAPTCHA-begränsningar: De flesta verktyg kräver manuell hantering av CAPTCHAs

- IP-blockering: Aggressiv scraping kan leda till att din IP blockeras

Kodexempel

import requests

from bs4 import BeautifulSoup

# Exploit-DB använder Cloudflare; enkla requests kan blockeras

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Notera: Huvuddatan laddas via AJAX, initial HTML är bara ett skal

print('Sidtitel:', soup.title.text)

except Exception as e:

print(f'Ett fel uppstod: {e}')När ska det användas

Bäst för statiska HTML-sidor med minimal JavaScript. Idealiskt för bloggar, nyhetssidor och enkla e-handelsproduktsidor.

Fördelar

- ●Snabbaste exekveringen (ingen webbläsaröverhead)

- ●Lägsta resursförbrukning

- ●Lätt att parallellisera med asyncio

- ●Utmärkt för API:er och statiska sidor

Begränsningar

- ●Kan inte köra JavaScript

- ●Misslyckas på SPA:er och dynamiskt innehåll

- ●Kan ha problem med komplexa anti-bot-system

Hur man skrapar Exploit Database med kod

Python + Requests

import requests

from bs4 import BeautifulSoup

# Exploit-DB använder Cloudflare; enkla requests kan blockeras

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Notera: Huvuddatan laddas via AJAX, initial HTML är bara ett skal

print('Sidtitel:', soup.title.text)

except Exception as e:

print(f'Ett fel uppstod: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_exploit_db():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://www.exploit-db.com/')

# Vänta på att DataTables laddas via AJAX

page.wait_for_selector('table#exploits-table')

rows = page.query_selector_all('table#exploits-table tbody tr')

for row in rows[:5]:

print(row.inner_text())

browser.close()

scrape_exploit_db()Python + Scrapy

import scrapy

class ExploitSpider(scrapy.Spider):

name = 'exploit_spider'

start_urls = ['https://www.exploit-db.com/']

def parse(self, response):

# Scrapy behöver en JS-middleware som scrapy-playwright för denna sajt

for exploit in response.css('table#exploits-table tbody tr'):

yield {

'title': exploit.css('td.title a::text').get(),

'id': exploit.css('td.id::text').get(),

'cve': exploit.css('td.cve a::text').get()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://www.exploit-db.com/', { waitUntil: 'networkidle2' });

const results = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('table#exploits-table tbody tr'));

return rows.map(row => row.innerText);

});

console.log(results.slice(0, 5));

await browser.close();

})();Vad Du Kan Göra Med Exploit Database-Data

Utforska praktiska tillämpningar och insikter från Exploit Database-data.

Realtidsflöde för hotinformation

Skapa ett kontinuerligt flöde av nya exploits för att varna säkerhetsteam om framväxande hot.

Så här implementerar du:

- 1Ställ in en schemalagd daglig skrapning av startsidan

- 2Jämför nya EDB-ID:n mot tidigare skrapade poster

- 3Utlös varningar via Slack eller e-post för nya kritiska exploits

Använd Automatio för att extrahera data från Exploit Database och bygga dessa applikationer utan att skriva kod.

Vad Du Kan Göra Med Exploit Database-Data

- Realtidsflöde för hotinformation

Skapa ett kontinuerligt flöde av nya exploits för att varna säkerhetsteam om framväxande hot.

- Ställ in en schemalagd daglig skrapning av startsidan

- Jämför nya EDB-ID:n mot tidigare skrapade poster

- Utlös varningar via Slack eller e-post för nya kritiska exploits

- Sårbarhetskorrelation och patchning

Hjälp IT-team att prioritera patchar baserat på förekomsten av fungerande exploit-kod.

- Extrahera CVE ID och tillhörande metadata för exploits

- Korsreferera med interna listor över programvaruinventarier

- Flagga system med offentligt tillgängliga exploits för omedelbar patchning

- Automaterat skapande av SIEM-signaturer

Extrahera proof-of-concept-shellcode för att utveckla defensiva signaturer för intrångsdetektering.

- Navigera till individuella exploit-sidor och skrapa råkod

- Analysera kod för unika bytemönster eller nätverkssträngar

- Mata in extraherade mönster i SIEM- eller IDS/IPS-regelgeneratorer

- Historisk trendanalys av sårbarheter

Analysera ett decennium av exploit-data för att förstå vilka plattformar som är mest måltavlor över tid.

- Skrapa hela arkivet inklusive datum, plattformar och typer

- Aggregera datan per plattform och år

- Visualisera attacktrender med BI-verktyg som Tableau eller PowerBI

- Akademiska dataset för cybersäkerhet

Tillhandahåll strukturerad data av hög kvalitet för machine learning model-filer som förutsäger tillförlitlighet hos exploits.

- Skrapa verifierade kontra overifierade exploits

- Extrahera källkod och metadataattribut

- Träna modeller för att klassificera kodmönster associerade med framgångsrika exploits

Superladda ditt arbetsflode med AI-automatisering

Automatio kombinerar kraften av AI-agenter, webbautomatisering och smarta integrationer for att hjalpa dig astadkomma mer pa kortare tid.

Proffstips för Skrapning av Exploit Database

Expertråd för framgångsrik dataextraktion från Exploit Database.

Kontrollera det officiella GitLab-arkivet för CSV-data i bulk innan du påbörjar en omfattande skrapning.

Använd en headless browser med stealth-plugins för att effektivt hantera Cloudflare-utmaningar.

Implementera en fördröjning på minst 10-15 sekunder mellan anrop för att undvika IP-blockeringar.

Rikta in dig på de specifika AJAX-endpoints som används av sajtens DataTables för renare JSON-output.

Använd högkvalitativa residential proxies för att efterlikna legitim trafik från säkerhetsforskare.

Rensa och normalisera CVE-ID

n omedelbart efter extraktion för att säkerställa databaskonsistens.

Omdomen

Vad vara anvandare sager

Ga med tusentals nojda anvandare som har transformerat sitt arbetsflode

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relaterat Web Scraping

How to Scrape Biluppgifter.se: Vehicle Data Extraction Guide

How to Scrape CSS Author: A Comprehensive Web Scraping Guide

How to Scrape Bilregistret.ai: Swedish Vehicle Data Extraction Guide

How to Scrape The AA (theaa.com): A Technical Guide for Car & Insurance Data

How to Scrape Car.info | Vehicle Data & Valuation Extraction Guide

How to Scrape GoAbroad Study Abroad Programs

How to Scrape ResearchGate: Publication and Researcher Data

How to Scrape Statista: The Ultimate Guide to Market Data Extraction

Vanliga fragor om Exploit Database

Hitta svar pa vanliga fragor om Exploit Database