GLM-5.1

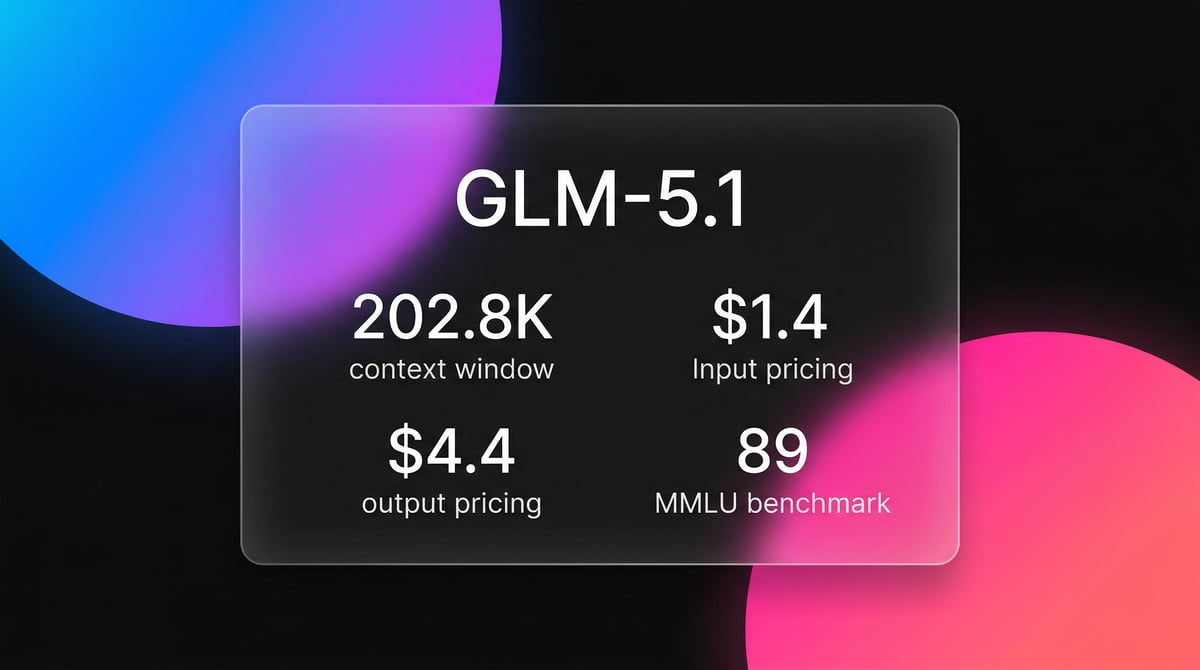

GLM-5.1 är Zhipu AI:s flagship reasoning-model, med en 202K context window och en autonom 8-timmars exekveringsloop för komplex agentic-teknik.

Om GLM-5.1

Lar dig om GLM-5.1s kapacitet, funktioner och hur det kan hjalpa dig uppna battre resultat.

GLM-5.1 är Zhipu AI:s flagship foundation model designad för komplex systemteknik och agentic-uppgifter med lång horisont. Byggd på en Mixture-of-Experts (MoE)-arkitektur med 744 miljarder parametrar och 40 miljarder aktiva per pass, representerar den ett betydande steg framåt inom uthållighet och autonom problemlösning. Modellen är särskilt konstruerad för att övervinna de reasoning-platåer man sett i tidigare LLM:er, och bibehåller produktivitet och kodkvalitet under tusentals verktygsanrop och hundratals iterationer. Den identifierar blockerare, kör experiment och justerar sin egen strategi utan mänsklig inblandning.

Tekniskt sett briljerar GLM-5.1 som en primär reasoning-motor i multi-agent-system. Den hanterar arkitektoniska beslut på hög nivå medan den delegerar implementering till mindre modeller. Den har en 202K context window som stöds av en dynamisk gles attention-mekanism, vilket säkerställer sammanhang över massiva kodbaser. Modellen släpps som open weights under MIT-licensen, vilket ger ett gångbart lokalt alternativ till proprietära frontier models för uppgifter som databasoptimering, GPU-kernel-teknik och utveckling av full-stack webbapplikationer.

KernelBench Level 3-resultat visar att GLM-5.1 bibehåller en betydande hastighetsökning i agentic ML-arbetsflöden över långa turer jämfört med Claude Opus 4.6. Denna uthållighet gör det möjligt för utvecklare att starta en teknisk uppgift på morgonen och få en fullständigt testad, distribuerad tjänst vid arbetsdagens slut. Den hanterar hela livscykeln för en buggfix, från att reproducera problemet i en sandlåda till att skicka in den slutgiltiga pull requesten.

Anvandningsfall for GLM-5.1

Upptack de olika satten du kan anvanda GLM-5.1 for att uppna fantastiska resultat.

Autonom mjukvaruutveckling

Den körs autonomt i 8+ timmar för att designa, implementera och felsöka mikrotjänster utan mänsklig vägledning.

Högpresterande databastrimning

Modellen optimerar iterativt Rust-baserade vector search-implementationer genom hundratals vändor.

GPU-kerneloptimering

Den analyserar referensimplementationer för att producera snabbare GPU-kernels som presterar bättre än standard autotune-kompilatorer.

Multi-agent-orkestrering

Den fungerar som en reasoning-kärna som koordinerar underuppgifter och verktygsanrop (tool-calls) över en svärm av specialiserade mindre modeller.

Komplexa terminaluppgifter

Den utför terminaloperationer i verkliga miljöer och systemadministration i flera steg via agentic CLI-verktyg.

Full-stack webbdesign

Modellen genererar visuellt konsekventa UI-layouter och backend-logik för webbläsarbaserade skrivbordsmiljöer.

Styrkor

Begransningar

API snabbstart

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimera detta databasschema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Installera SDK och borja gora API-anrop pa nagra minuter.

Vad folk sager om GLM-5.1

Se vad communityt tycker om GLM-5.1

“GLM-5.1 körde en prompt i 8 timmar i sträck. Den gav inte upp som de flesta modeller gör; den fortsatte att lägga till funktioner och granska sig själv.”

“Jag har stresstestat den upp till 140k kontext minst 5 gånger och den har förblivit sammanhängande. SOTA kan ha fått en utmanare.”

“GLM-5.1 är i princip i paritet med Opus på detta benchmark. Det är nu den främsta open-modellen i Arena.”

“Varje gång jag ser en NPC bli genuint övertygad genom oplanerad dialog med GLM-5.1, känns det som ren magi.”

“Kodningsprestandan är legitim. Den fixade ett race condition i vår Go-backend som GPT-4o hela tiden hallucinerade om.”

“Att köra detta lokalt med Unsloth är en game changer för datasekretess i vår juridiska tech-stack.”

Videor om GLM-5.1

Se handledningar, recensioner och diskussioner om GLM-5.1

“GLM-5.1 fick 45,3 % på detta benchmark, vilket är ett stort hopp för familjen.”

“Det är en otroligt långsam modell... de har troligen fler av sina GPU:er upptagna med att köra GLM-5.”

“Sättet den hanterar tool-calls på är mycket mer robust än standard GLM 5.”

“Det är för närvarande den starkaste reasoning-modellen du kan ladda ner och köra på din egen hårdvara.”

“Du kan se hur den faktiskt identifierar sina egna misstag i thinking-loggen.”

“Den kan köras autonomt i 8 timmar och förfina strategier genom tusentals iterationer.”

“Den överträffar Gemini 3.1 Pro och Qwen 3.6 Plus på populära benchmarks för kodgenerering.”

“Det är i agentic-läget som den här modellen verkligen glänser; den ger inte upp vid svåra buggar.”

“Z.ai har i praktiken tagit bort betalväggen för en frontier-level modell på 744B parametrar.”

“Den hanterar effektivt 'platå-problemet' där andra LLM:er tappar fokus över tid.”

“80 % storleksminskning från originalet på 1,65 TB ner till 236 GB med bibehållen kvalitet.”

“Kraften i open-source: även i en kvantiserad version skrev den fungerande kod för fireworks.”

“Du behöver minst 256 GB system-RAM för att ens överväga att ladda denna MoE-jätte.”

“Den använder en dynamisk gles attention-mekanism för att hålla 202k-kontexten sammanhängande.”

“Att använda Unsloth gör tränings- och inference-processen betydligt mer effektiv.”

Superladda ditt arbetsflode med AI-automatisering

Automatio kombinerar kraften av AI-agenter, webbautomatisering och smarta integrationer for att hjalpa dig astadkomma mer pa kortare tid.

Proffs-tips for GLM-5.1

Experttips for att hjalpa dig fa ut det mesta av GLM-5.1 och uppna battre resultat.

Aktivera Thinking Mode

Se till att reglaget för 'Thinking' är aktiverat i din konfiguration för att låsa upp de autonoma 8-timmars iterationskapaciteterna.

Använd kvoter utanför högtrafik

Kör stora tekniska batchar under tider med lägre belastning, utanför kl. 14:00–18:00 Peking-tid, för bättre prissättning.

Krav på lokalt minne

Använd Unsloth Dynamic GGUF-kvantisering för att få plats med 1,6 TB-modellen i 256 GB systemminne vid lokala körningar.

Strategiskt val av uppgifter

Reservera GLM-5.1 för arkitektonisk reasoning och använd GLM-4.7 för rutinimplementeringar för att hålla nere kostnaderna.

Omdomen

Vad vara anvandare sager

Ga med tusentals nojda anvandare som har transformerat sitt arbetsflode

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relaterat AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Vanliga fragor om GLM-5.1

Hitta svar pa vanliga fragor om GLM-5.1