วิธี Scrape Exploit-DB | เครื่องมือ Web Scraper สำหรับ Exploit Database

เรียนรู้วิธี Scrape ข้อมูลจาก Exploit-DB สำหรับข้อมูลช่องโหว่, รหัส Exploit และการอ้างอิง CVE เพื่อขับเคลื่อนการวิจัยด้านความปลอดภัยไซเบอร์และฟีด Threat...

ตรวจพบการป้องกันบอท

- Cloudflare

- WAF และการจัดการบอทระดับองค์กร ใช้ JavaScript challenges, CAPTCHAs และการวิเคราะห์พฤติกรรม ต้องมีระบบอัตโนมัติของเบราว์เซอร์พร้อมการตั้งค่าซ่อนตัว

- การจำกัดอัตรา

- จำกัดคำขอต่อ IP/เซสชันตามเวลา สามารถหลีกเลี่ยงได้ด้วยพร็อกซีหมุนเวียน การหน่วงเวลาคำขอ และการสแกรปแบบกระจาย

- การบล็อก IP

- บล็อก IP ของศูนย์ข้อมูลที่รู้จักและที่อยู่ที่ถูกทำเครื่องหมาย ต้องใช้พร็อกซีที่อยู่อาศัยหรือมือถือเพื่อหลีกเลี่ยงอย่างมีประสิทธิภาพ

- JavaScript Challenge

- ต้องมีการเรียกใช้ JavaScript เพื่อเข้าถึงเนื้อหา คำขอแบบง่ายจะล้มเหลว ต้องใช้เบราว์เซอร์ headless เช่น Playwright หรือ Puppeteer

เกี่ยวกับ Exploit Database

ค้นพบสิ่งที่ Exploit Database นำเสนอและข้อมูลที่มีค่าที่สามารถดึงได้

คลังเก็บช่องโหว่ที่ครอบคลุม

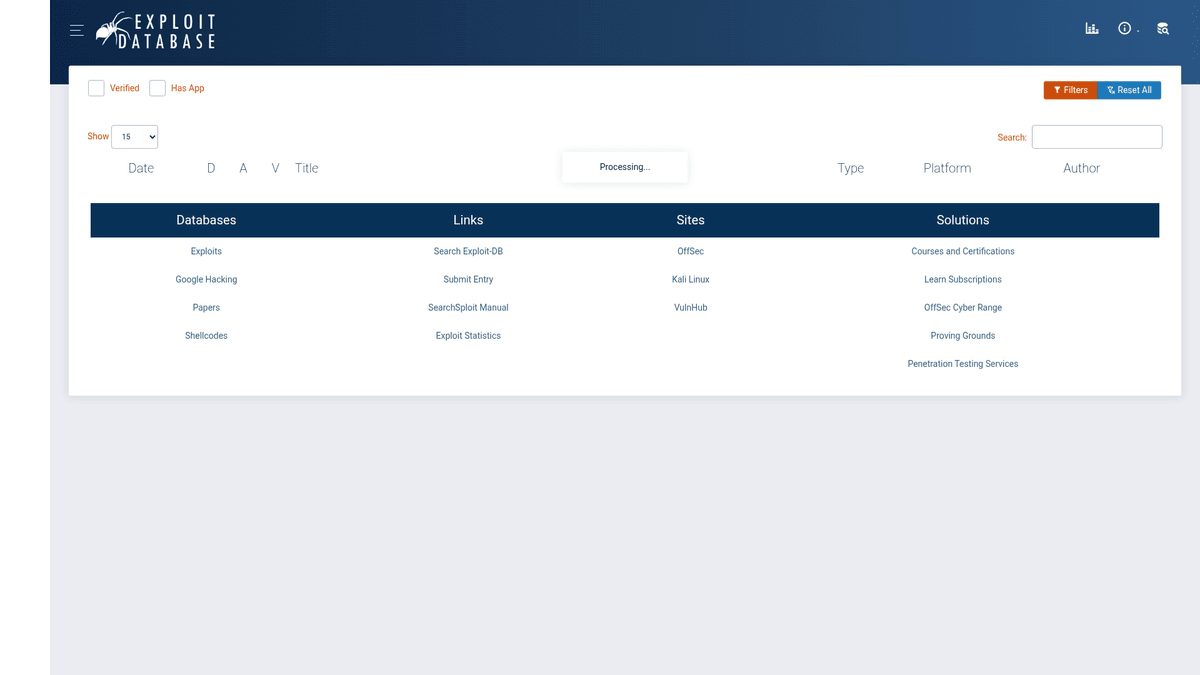

Exploit Database (Exploit-DB) เป็นคลังเก็บข้อมูลช่องโหว่ที่สอดคล้องกับมาตรฐาน CVE ซึ่งรวบรวม Exploit สาธารณะและซอฟต์แวร์ที่มีช่องโหว่ที่เกี่ยวข้อง พัฒนาขึ้นเพื่อให้นักทดสอบเจาะระบบ (Penetration Testers) และนักวิจัยช่องโหว่ใช้งาน ดูแลโดย OffSec (Offensive Security) โดยทำหน้าที่เป็นศูนย์กลางสำหรับชุมชนความปลอดภัยทางไซเบอร์ในการแบ่งปันโค้ด Proof-of-concept และงานวิจัยในแพลตฟอร์มและแอปพลิเคชันต่างๆ คลังข้อมูลนี้เป็นหนึ่งในแหล่งข้อมูลที่น่าเชื่อถือที่สุดสำหรับผู้เชี่ยวชาญด้านความปลอดภัยทั่วโลก

การจัดหมวดหมู่ข้อมูลและความลึกซึ้ง

เว็บไซต์จัดระเบียบข้อมูลเป็นหมวดหมู่ที่ละเอียด เช่น Remote Exploits, Web Applications, Local Exploits และ Shellcodes แต่ละรายการมักประกอบด้วยชื่อ Exploit, วันที่, ผู้เขียน, แพลตฟอร์ม, CVE ID ที่เกี่ยวข้อง และรหัส Exploit ดิบ แนวทางที่มีโครงสร้างนี้ช่วยให้นักวิจัยสามารถสลับไปมาระหว่างประเภทของช่องโหว่ต่างๆ และบริบททางประวัติศาสตร์ได้อย่างรวดเร็ว

มูลค่าเชิงกลยุทธ์สำหรับการปฏิบัติการด้านความปลอดภัย

การ Scrape ข้อมูลนี้มีค่าอย่างยิ่งสำหรับ Security Operations Centers (SOCs) และทีม Threat Intelligence ในการเชื่อมโยง Exploit ที่รู้จักกับช่องโหว่ภายใน การดึงโค้ด PoC และ Metadata โดยอัตโนมัติช่วยให้องค์กรสามารถสร้าง Security Signatures ที่กำหนดเอง ปรับปรุงวงจรการจัดการช่องโหว่ และสร้าง Threat Intelligence Feeds ที่แข็งแกร่ง

ทำไมต้อง Scrape Exploit Database?

ค้นพบคุณค่าทางธุรกิจและกรณีการใช้งานสำหรับการดึงข้อมูลจาก Exploit Database

การรวบรวม Threat Intelligence แบบเรียลไทม์

การซิงโครไนซ์ฐานข้อมูลช่องโหว่

การวิจัยและพัฒนาด้านความปลอดภัยโดยอัตโนมัติ

การผสานรวมกับเครื่องมือ Vulnerability Scanners

การวิเคราะห์แนวโน้มการโจมตีในอดีต

การสร้าง Security Signatures ที่กำหนดเอง

ความท้าทายในการ Scrape

ความท้าทายทางเทคนิคที่คุณอาจพบเมื่อ Scrape Exploit Database

การป้องกันของ Cloudflare ที่เข้มงวดซึ่งต้องใช้การจัดการ TLS fingerprinting ขั้นสูง

การโหลดเนื้อหาแบบไดนามิกผ่าน AJAX สำหรับ DataTables

การบล็อก IP บ่อยครั้งสำหรับคำขอที่มีความถี่สูง

การจำกัดอัตรา (Rate limiting) ที่เข้มงวดในการดาวน์โหลดโค้ด PoC ดิบ

โครงสร้าง HTML ที่ซับซ้อนและซ้อนกันสำหรับรายละเอียดของ Exploit

สกัดข้อมูลจาก Exploit Database ด้วย AI

ไม่ต้องเขียนโค้ด สกัดข้อมูลภายในไม่กี่นาทีด้วยระบบอัตโนมัติที่ขับเคลื่อนด้วย AI

วิธีการทำงาน

อธิบายสิ่งที่คุณต้องการ

บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Exploit Database แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

AI สกัดข้อมูล

ปัญญาประดิษฐ์ของเรานำทาง Exploit Database จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

รับข้อมูลของคุณ

รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

ทำไมต้องใช้ AI ในการสกัดข้อมูล

AI ทำให้การสกัดข้อมูลจาก Exploit Database เป็นเรื่องง่ายโดยไม่ต้องเขียนโค้ด แพลตฟอร์มที่ขับเคลื่อนด้วยปัญญาประดิษฐ์ของเราเข้าใจว่าคุณต้องการข้อมูลอะไร — แค่อธิบายเป็นภาษาธรรมชาติ แล้ว AI จะสกัดให้โดยอัตโนมัติ

How to scrape with AI:

- อธิบายสิ่งที่คุณต้องการ: บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Exploit Database แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

- AI สกัดข้อมูล: ปัญญาประดิษฐ์ของเรานำทาง Exploit Database จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

- รับข้อมูลของคุณ: รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

Why use AI for scraping:

- จัดการอุปสรรคจาก Cloudflare และ JavaScript โดยอัตโนมัติ

- ทำงานในระดับ native เพื่อการดึงข้อมูล DataTables ที่สะอาด

- ตั้งเวลาการทำงานเพื่อเฝ้าติดตาม zero-day ตลอด 24 ชั่วโมงทุกวัน

- อินเทอร์เฟซแบบ no-code ช่วยตัดความยุ่งยากในการบำรุงรักษาตัวข้ามระบบ

- ส่งออกข้อมูลไปยังรูปแบบ JSON ที่มีโครงสร้างโดยตรงเพื่อการผสานรวมกับ SOC

No-code web scrapers สำหรับ Exploit Database

ทางเลือกแบบ point-and-click สำหรับการ scraping ด้วย AI

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Exploit Database โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

ความท้าทายทั่วไป

เส้นโค้งการเรียนรู้

การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

Selectors เสีย

การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

ปัญหาเนื้อหาไดนามิก

เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

ข้อจำกัด CAPTCHA

เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

การบล็อก IP

การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

No-code web scrapers สำหรับ Exploit Database

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Exploit Database โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

- ติดตั้งส่วนขยายเบราว์เซอร์หรือสมัครใช้งานแพลตฟอร์ม

- นำทางไปยังเว็บไซต์เป้าหมายและเปิดเครื่องมือ

- เลือกองค์ประกอบข้อมูลที่ต้องการดึงด้วยการชี้และคลิก

- กำหนดค่า CSS selectors สำหรับแต่ละฟิลด์ข้อมูล

- ตั้งค่ากฎการแบ่งหน้าเพื่อ scrape หลายหน้า

- จัดการ CAPTCHA (มักต้องแก้ไขด้วยตนเอง)

- กำหนดค่าการตั้งเวลาสำหรับการรันอัตโนมัติ

- ส่งออกข้อมูลเป็น CSV, JSON หรือเชื่อมต่อผ่าน API

ความท้าทายทั่วไป

- เส้นโค้งการเรียนรู้: การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

- Selectors เสีย: การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

- ปัญหาเนื้อหาไดนามิก: เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

- ข้อจำกัด CAPTCHA: เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

- การบล็อก IP: การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

ตัวอย่างโค้ด

import requests

from bs4 import BeautifulSoup

# Exploit-DB ใช้ Cloudflare; คำขอแบบธรรมดาอาจถูกบล็อก

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# หมายเหตุ: ข้อมูลหลักถูกโหลดผ่าน AJAX, HTML เริ่มต้นเป็นเพียงโครงสร้างหลัก

print('Page Title:', soup.title.text)

except Exception as e:

print(f'Error encountered: {e}')เมื่อไหร่ควรใช้

เหมาะที่สุดสำหรับหน้า HTML แบบ static ที่มี JavaScript น้อย เหมาะสำหรับบล็อก ไซต์ข่าว และหน้าสินค้า e-commerce ธรรมดา

ข้อดี

- ●ประมวลผลเร็วที่สุด (ไม่มี overhead ของเบราว์เซอร์)

- ●ใช้ทรัพยากรน้อยที่สุด

- ●ง่ายต่อการทำงานแบบขนานด้วย asyncio

- ●เหมาะมากสำหรับ API และหน้า static

ข้อจำกัด

- ●ไม่สามารถรัน JavaScript ได้

- ●ล้มเหลวใน SPA และเนื้อหาไดนามิก

- ●อาจมีปัญหากับระบบ anti-bot ที่ซับซ้อน

วิธีสเครปข้อมูล Exploit Database ด้วยโค้ด

Python + Requests

import requests

from bs4 import BeautifulSoup

# Exploit-DB ใช้ Cloudflare; คำขอแบบธรรมดาอาจถูกบล็อก

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# หมายเหตุ: ข้อมูลหลักถูกโหลดผ่าน AJAX, HTML เริ่มต้นเป็นเพียงโครงสร้างหลัก

print('Page Title:', soup.title.text)

except Exception as e:

print(f'Error encountered: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_exploit_db():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://www.exploit-db.com/')

# รอให้ DataTables โหลดข้อมูลผ่าน AJAX

page.wait_for_selector('table#exploits-table')

rows = page.query_selector_all('table#exploits-table tbody tr')

for row in rows[:5]:

print(row.inner_text())

browser.close()

scrape_exploit_db()Python + Scrapy

import scrapy

class ExploitSpider(scrapy.Spider):

name = 'exploit_spider'

start_urls = ['https://www.exploit-db.com/']

def parse(self, response):

# Scrapy จำเป็นต้องใช้ JS middleware เช่น scrapy-playwright สำหรับไซต์นี้

for exploit in response.css('table#exploits-table tbody tr'):

yield {

'title': exploit.css('td.title a::text').get(),

'id': exploit.css('td.id::text').get(),

'cve': exploit.css('td.cve a::text').get()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://www.exploit-db.com/', { waitUntil: 'networkidle2' });

const results = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('table#exploits-table tbody tr'));

return rows.map(row => row.innerText);

});

console.log(results.slice(0, 5));

await browser.close();

})();คุณสามารถทำอะไรกับข้อมูล Exploit Database

สำรวจการใช้งานจริงและข้อมูลเชิงลึกจากข้อมูล Exploit Database

ฟีดข้อมูลภัยคุกคามแบบเรียลไทม์

สร้างฟีดข้อมูล Exploit ใหม่ๆ อย่างต่อเนื่องเพื่อเตือนทีมความปลอดภัยเกี่ยวกับภัยคุกคามที่เกิดขึ้นใหม่

วิธีการนำไปใช้:

- 1ตั้งค่าการ Scrape หน้าแรกตามกำหนดการทุกวัน

- 2เปรียบเทียบ EDB-ID ใหม่กับบันทึกที่เคย Scrape ไว้ก่อนหน้า

- 3ตั้งค่าการแจ้งเตือนทาง Slack หรืออีเมลสำหรับ Exploit ระดับวิกฤตใหม่

ใช้ Automatio เพื่อดึงข้อมูลจาก Exploit Database และสร้างแอปพลิเคชันเหล่านี้โดยไม่ต้องเขียนโค้ด

คุณสามารถทำอะไรกับข้อมูล Exploit Database

- ฟีดข้อมูลภัยคุกคามแบบเรียลไทม์

สร้างฟีดข้อมูล Exploit ใหม่ๆ อย่างต่อเนื่องเพื่อเตือนทีมความปลอดภัยเกี่ยวกับภัยคุกคามที่เกิดขึ้นใหม่

- ตั้งค่าการ Scrape หน้าแรกตามกำหนดการทุกวัน

- เปรียบเทียบ EDB-ID ใหม่กับบันทึกที่เคย Scrape ไว้ก่อนหน้า

- ตั้งค่าการแจ้งเตือนทาง Slack หรืออีเมลสำหรับ Exploit ระดับวิกฤตใหม่

- การเชื่อมโยงช่องโหว่และการอัปเดตแพตช์

ช่วยให้ทีม IT จัดลำดับความสำคัญของแพตช์ซอฟต์แวร์ตามการมีอยู่ของโค้ด Exploit ที่ใช้งานได้จริง

- ดึง CVE ID และ Metadata ของ Exploit ที่เกี่ยวข้อง

- ตรวจสอบข้อมูลอ้างอิงไขว้กับรายการซอฟต์แวร์ภายในองค์กร

- ติดธงระบบที่มี Exploit สาธารณะเพื่อให้รีบทำการอัปเดตแพตช์ทันที

- การสร้าง SIEM Signature แบบอัตโนมัติ

ดึงข้อมูล Shellcode ของ Proof-of-concept เพื่อสร้างลายเซ็นการป้องกันสำหรับการตรวจจับการบุกรุก

- นำทางไปยังหน้า Exploit แต่ละหน้าและ Scrape โค้ดดิบ

- วิเคราะห์โค้ดเพื่อหา Byte Patterns หรือ Network Strings ที่เป็นเอกลักษณ์

- นำรูปแบบที่ดึงออกมาใส่ใน SIEM หรือตัวสร้างกฎ IDS/IPS

- การวิเคราะห์แนวโน้มช่องโหว่ในอดีต

วิเคราะห์ข้อมูล Exploit ย้อนหลังนับทศวรรษเพื่อทำความเข้าใจว่าแพลตฟอร์มใดเป็นเป้าหมายมากที่สุดในช่วงเวลาต่างๆ

- Scrape คลังข้อมูลทั้งหมดรวมถึงวันที่ แพลตฟอร์ม และประเภท

- รวบรวมข้อมูลตามแพลตฟอร์มและปี

- สร้างภาพข้อมูลแนวโน้มการโจมตีโดยใช้เครื่องมือ BI เช่น Tableau หรือ PowerBI

- ชุดข้อมูลความปลอดภัยทางไซเบอร์เชิงวิชาการ

จัดเตรียมข้อมูลที่มีโครงสร้างและคุณภาพสูงสำหรับ machine learning model ในการทำนายความน่าเชื่อถือของ Exploit

- Scrape ข้อมูล Exploit ทั้งที่ได้รับการยืนยันและยังไม่ได้รับการยืนยัน

- ดึงซอร์สโค้ดดิบและคุณลักษณะ Metadata

- ฝึก model เพื่อจำแนกรูปแบบโค้ดที่เกี่ยวข้องกับ Exploit ที่ประสบความสำเร็จ

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมืออาชีพสำหรับการ Scrape Exploit Database

คำแนะนำจากผู้เชี่ยวชาญสำหรับการดึงข้อมูลจาก Exploit Database อย่างประสบความสำเร็จ

ตรวจสอบ GitLab repository ทางการของ GitLab สำหรับข้อมูล CSV จำนวนมากก่อนที่จะเริ่มการดึงข้อมูลปริมาณสูง

ใช้ headless browser พร้อมกับ stealth plugins เพื่อผ่านด่านทดสอบของ Cloudflare อย่างมีประสิทธิภาพ

กำหนดหน่วงเวลาอย่างน้อย 10-15 วินาทีระหว่างคำขอเพื่อหลีกเลี่ยงการโดนแบน IP

กำหนดเป้าหมายไปยัง AJAX endpoints เฉพาะที่ใช้โดย DataTables ของเว็บไซต์เพื่อให้ได้เอาต์พุต JSON ที่สะอาดกว่า

ใช้ residential proxies คุณภาพสูงเพื่อเลียนแบบทราฟฟิกของนักวิจัยด้านความปลอดภัยที่ถูกกฎหมาย

ทำความสะอาดและจัดรูปแบบ CVE IDs ให้เป็นมาตรฐานทันทีหลังจากดึงข้อมูลเพื่อให้แน่ใจว่าฐานข้อมูลมีความสอดคล้องกัน

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง Web Scraping

How to Scrape Biluppgifter.se: Vehicle Data Extraction Guide

How to Scrape CSS Author: A Comprehensive Web Scraping Guide

How to Scrape Bilregistret.ai: Swedish Vehicle Data Extraction Guide

How to Scrape The AA (theaa.com): A Technical Guide for Car & Insurance Data

How to Scrape Car.info | Vehicle Data & Valuation Extraction Guide

How to Scrape GoAbroad Study Abroad Programs

How to Scrape ResearchGate: Publication and Researcher Data

How to Scrape Statista: The Ultimate Guide to Market Data Extraction

คำถามที่พบบ่อยเกี่ยวกับ Exploit Database

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ Exploit Database