วิธีการสแครป Kleinanzeigen | ตลาดซื้อขายออนไลน์ที่ใหญ่ที่สุดในเยอรมนี

เรียนรู้วิธีการสแครป Kleinanzeigen เพื่อการตรวจสอบราคา แนวโน้มอสังหาริมทรัพย์ และการสร้างลีด ดึงข้อมูลชื่อประกาศและราคาจากเว็บไซต์อันดับหนึ่งของเยอรมนี

ตรวจพบการป้องกันบอท

- Akamai Bot Manager

- การตรวจจับบอทขั้นสูงโดยใช้ลายนิ้วมืออุปกรณ์ การวิเคราะห์พฤติกรรม และการเรียนรู้ของเครื่อง เป็นหนึ่งในระบบต่อต้านบอทที่ซับซ้อนที่สุด

- DataDome

- การตรวจจับบอทแบบเรียลไทม์ด้วยโมเดล ML วิเคราะห์ลายนิ้วมืออุปกรณ์ สัญญาณเครือข่าย และรูปแบบพฤติกรรม พบบ่อยในเว็บไซต์อีคอมเมิร์ซ

- Google reCAPTCHA

- ระบบ CAPTCHA ของ Google v2 ต้องมีการโต้ตอบของผู้ใช้ v3 ทำงานเงียบๆ ด้วยคะแนนความเสี่ยง สามารถแก้ได้ด้วยบริการ CAPTCHA

- การจำกัดอัตรา

- จำกัดคำขอต่อ IP/เซสชันตามเวลา สามารถหลีกเลี่ยงได้ด้วยพร็อกซีหมุนเวียน การหน่วงเวลาคำขอ และการสแกรปแบบกระจาย

- การบล็อก IP

- บล็อก IP ของศูนย์ข้อมูลที่รู้จักและที่อยู่ที่ถูกทำเครื่องหมาย ต้องใช้พร็อกซีที่อยู่อาศัยหรือมือถือเพื่อหลีกเลี่ยงอย่างมีประสิทธิภาพ

- ลายนิ้วมือเบราว์เซอร์

- ระบุบอทผ่านลักษณะเฉพาะของเบราว์เซอร์: canvas, WebGL, ฟอนต์, ปลั๊กอิน ต้องมีการปลอมแปลงหรือโปรไฟล์เบราว์เซอร์จริง

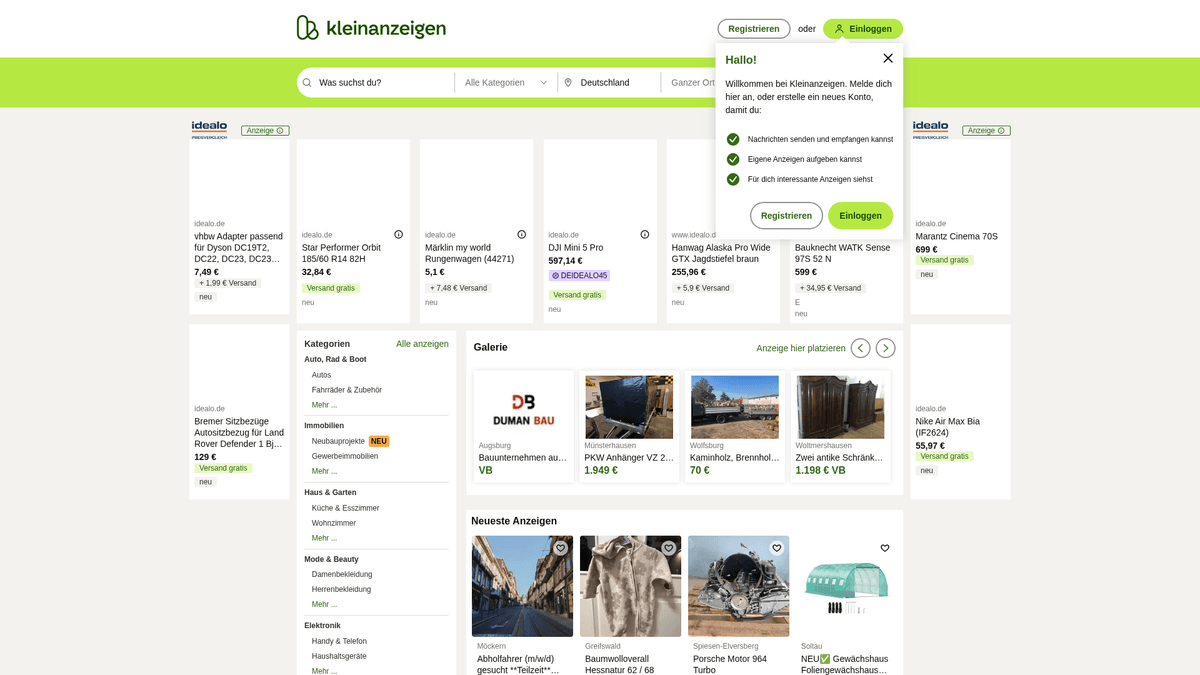

เกี่ยวกับ Kleinanzeigen

ค้นพบสิ่งที่ Kleinanzeigen นำเสนอและข้อมูลที่มีค่าที่สามารถดึงได้

ศูนย์รวมประกาศซื้อขายที่ใหญ่ที่สุดในเยอรมนี

Kleinanzeigen หรือเดิมชื่อ eBay Kleinanzeigen เป็นตลาดกลางออนไลน์สำหรับประกาศซื้อขายที่โดดเด่นที่สุดในเยอรมนี ให้บริการผู้ใช้ที่ใช้งานอยู่หลายล้านคนต่อวัน อำนวยความสะดวกในการทำธุรกรรมตั้งแต่สอสังหาริมทรัพย์ระดับไฮเอนด์และยานพาหนะ ไปจนถึงเฟอร์นิเจอร์ในครัวเรือนและบริการในท้องถิ่นเฉพาะทาง เนื่องจากมีขนาดใหญ่และฝังรากลึกในตลาดเยอรมนี แพลตฟอร์มนี้จึงทำหน้าที่เป็นกระจกสะท้อนเศรษฐกิจมือสองและความต้องการที่อยู่อาศัยในท้องถิ่นของประเทศ

ทำไมการสแครป Kleinanzeigen ถึงสำคัญ

การเข้าถึงข้อมูลที่มีโครงสร้างบน Kleinanzeigen เป็นสิ่งสำคัญสำหรับธุรกิจที่ต้องการทำความเข้าใจความผันผวนของตลาดในยุโรปกลาง แพลตฟอร์มนี้ประกอบด้วยข้อมูลเชิงลึกในระดับท้องถิ่นที่ไม่มีในเว็บไซต์ค้าปลีกระดับโลก ทำให้เป็นขุมทรัพย์สำหรับการเปรียบเทียบราคาในภูมิภาคและการวิเคราะห์แนวโน้ม ไม่ว่าคุณจะติดตามราคาขายต่อของอุปกรณ์อิเล็กทรอนิกส์หรือตรวจสอบราคาเช่าที่พุ่งสูงขึ้นในเบอร์ลิน การสแครปข้อมูลจะให้รายละเอียดที่จำเป็นสำหรับการตัดสินใจอย่างมีข้อมูล

ทำไมต้อง Scrape Kleinanzeigen?

ค้นพบคุณค่าทางธุรกิจและกรณีการใช้งานสำหรับการดึงข้อมูลจาก Kleinanzeigen

ตรวจสอบราคาอสังหาริมทรัพย์และแนวโน้มค่าเช่าในภูมิภาคต่างๆ ของเยอรมนีเพื่อการลงทุน

วิเคราะห์คู่แข่งสำหรับการขายรถยนต์มือสองและสต็อกอะไหล่ยานยนต์

สร้างลีดที่มีคุณภาพสูงสำหรับผู้ให้บริการ เช่น บริษัทขนย้ายและทีมซ่อมแซมบ้าน

ติดตามราคาขายต่อของอุปกรณ์อิเล็กทรอนิกส์เพื่อปรับปรุงกลยุทธ์การตั้งราคาเทรดอิน

วิเคราะห์แนวโน้มตลาดงานในท้องถิ่นในภาคส่วนต่างๆ เช่น ร้านอาหาร ค้าปลีก และการก่อสร้าง

เก็บข้อมูลย้อนหลังสำหรับการวิจัยทางวิชาการเกี่ยวกับพฤติกรรมทางเศรษฐกิจในตลาดมือสอง

ความท้าทายในการ Scrape

ความท้าทายทางเทคนิคที่คุณอาจพบเมื่อ Scrape Kleinanzeigen

ระบบป้องกันบอตที่เข้มงวด (Akamai และ DataDome) ตรวจจับรอยนิ้วมือของเบราว์เซอร์อัตโนมัติ

นโยบายการบล็อกตามภูมิภาค (geo-blocking) ที่เข้มงวด จำเป็นต้องใช้ German residential proxy คุณภาพสูงเพื่อเข้าถึงเนื้อหา

CSS selector แบบไดนามิกและการอัปเดตเลย์เอาต์บ่อยครั้งทำให้สแครปเปอร์แบบ static ทั่วไปใช้งานไม่ได้

การจำกัดอัตราการเรียกข้อมูล (rate limiting) ที่รุนแรง ซึ่งกระตุ้นให้เกิด CAPTCHAs ที่ซับซ้อนแม้จะมีการส่งคำขอในปริมาณปานกลาง

เทคนิคการปิดบังข้อมูล (obfuscation) ที่ใช้กับข้อมูลติดต่อและรายละเอียดของผู้ขาย

สกัดข้อมูลจาก Kleinanzeigen ด้วย AI

ไม่ต้องเขียนโค้ด สกัดข้อมูลภายในไม่กี่นาทีด้วยระบบอัตโนมัติที่ขับเคลื่อนด้วย AI

วิธีการทำงาน

อธิบายสิ่งที่คุณต้องการ

บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Kleinanzeigen แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

AI สกัดข้อมูล

ปัญญาประดิษฐ์ของเรานำทาง Kleinanzeigen จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

รับข้อมูลของคุณ

รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

ทำไมต้องใช้ AI ในการสกัดข้อมูล

AI ทำให้การสกัดข้อมูลจาก Kleinanzeigen เป็นเรื่องง่ายโดยไม่ต้องเขียนโค้ด แพลตฟอร์มที่ขับเคลื่อนด้วยปัญญาประดิษฐ์ของเราเข้าใจว่าคุณต้องการข้อมูลอะไร — แค่อธิบายเป็นภาษาธรรมชาติ แล้ว AI จะสกัดให้โดยอัตโนมัติ

How to scrape with AI:

- อธิบายสิ่งที่คุณต้องการ: บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Kleinanzeigen แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

- AI สกัดข้อมูล: ปัญญาประดิษฐ์ของเรานำทาง Kleinanzeigen จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

- รับข้อมูลของคุณ: รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

Why use AI for scraping:

- บายพาสมาตรการป้องกันบอตที่ซับซ้อนอย่าง Akamai ได้โดยอัตโนมัติโดยไม่ต้องเขียนสคริปต์เอง

- อินเทอร์เฟซแบบ Visual no-code ช่วยให้สามารถอัปเดตได้อย่างรวดเร็วเมื่อ selector ของเว็บไซต์เปลี่ยนไป

- การทำงานบนระบบคลาวด์ช่วยให้มั่นใจได้ถึงการตรวจสอบข้อมูลตลอด 24 ชั่วโมงทุกวัน โดยไม่เป็นภาระกับโครงสร้างพื้นฐานในท้องถิ่น

- ระบบการสลับ proxy ในตัวช่วยจัดการเรื่องการจำกัดทางภูมิศาสตร์และการแบน IP ได้อย่างราบรื่น

- จัดการการเปลี่ยนหน้า (pagination) ที่ซับซ้อนและการนำทางแบบ deep-link ได้โดยไม่ต้องเขียนโค้ด

No-code web scrapers สำหรับ Kleinanzeigen

ทางเลือกแบบ point-and-click สำหรับการ scraping ด้วย AI

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Kleinanzeigen โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

ความท้าทายทั่วไป

เส้นโค้งการเรียนรู้

การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

Selectors เสีย

การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

ปัญหาเนื้อหาไดนามิก

เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

ข้อจำกัด CAPTCHA

เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

การบล็อก IP

การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

No-code web scrapers สำหรับ Kleinanzeigen

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Kleinanzeigen โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

- ติดตั้งส่วนขยายเบราว์เซอร์หรือสมัครใช้งานแพลตฟอร์ม

- นำทางไปยังเว็บไซต์เป้าหมายและเปิดเครื่องมือ

- เลือกองค์ประกอบข้อมูลที่ต้องการดึงด้วยการชี้และคลิก

- กำหนดค่า CSS selectors สำหรับแต่ละฟิลด์ข้อมูล

- ตั้งค่ากฎการแบ่งหน้าเพื่อ scrape หลายหน้า

- จัดการ CAPTCHA (มักต้องแก้ไขด้วยตนเอง)

- กำหนดค่าการตั้งเวลาสำหรับการรันอัตโนมัติ

- ส่งออกข้อมูลเป็น CSV, JSON หรือเชื่อมต่อผ่าน API

ความท้าทายทั่วไป

- เส้นโค้งการเรียนรู้: การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

- Selectors เสีย: การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

- ปัญหาเนื้อหาไดนามิก: เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

- ข้อจำกัด CAPTCHA: เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

- การบล็อก IP: การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

ตัวอย่างโค้ด

import requests

from bs4 import BeautifulSoup

# Note: This site uses Akamai/DataDome. Simple requests may return 403 Forbidden.

url = 'https://www.kleinanzeigen.de/s-berlin/c0-l3331'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) Chrome/119.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9'

}

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

for item in soup.select('article.aditem'):

title = item.select_one('.aditem-main--title-line a').text.strip()

price = item.select_one('.aditem-main--middle--price-shipping--price').text.strip()

print(f'Ad: {title} | Price: {price}')

except Exception as e:

print(f'Scraping failed: {e}')เมื่อไหร่ควรใช้

เหมาะที่สุดสำหรับหน้า HTML แบบ static ที่มี JavaScript น้อย เหมาะสำหรับบล็อก ไซต์ข่าว และหน้าสินค้า e-commerce ธรรมดา

ข้อดี

- ●ประมวลผลเร็วที่สุด (ไม่มี overhead ของเบราว์เซอร์)

- ●ใช้ทรัพยากรน้อยที่สุด

- ●ง่ายต่อการทำงานแบบขนานด้วย asyncio

- ●เหมาะมากสำหรับ API และหน้า static

ข้อจำกัด

- ●ไม่สามารถรัน JavaScript ได้

- ●ล้มเหลวใน SPA และเนื้อหาไดนามิก

- ●อาจมีปัญหากับระบบ anti-bot ที่ซับซ้อน

วิธีสเครปข้อมูล Kleinanzeigen ด้วยโค้ด

Python + Requests

import requests

from bs4 import BeautifulSoup

# Note: This site uses Akamai/DataDome. Simple requests may return 403 Forbidden.

url = 'https://www.kleinanzeigen.de/s-berlin/c0-l3331'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) Chrome/119.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9'

}

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

for item in soup.select('article.aditem'):

title = item.select_one('.aditem-main--title-line a').text.strip()

price = item.select_one('.aditem-main--middle--price-shipping--price').text.strip()

print(f'Ad: {title} | Price: {price}')

except Exception as e:

print(f'Scraping failed: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def run():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

context = browser.new_context(user_agent='Mozilla/5.0', locale='de-DE')

page = context.new_page()

# Navigate to a listing page

page.goto('https://www.kleinanzeigen.de/s-anzeige/beispiel', wait_until='networkidle')

# Extract details

title = page.locator('h1#viewad-title').inner_text()

price = page.locator('#viewad-price').inner_text()

print({'title': title.strip(), 'price': price.strip()})

browser.close()

run()Python + Scrapy

import scrapy

class KleinanzeigenSpider(scrapy.Spider):

name = 'kleinanzeigen'

start_urls = ['https://www.kleinanzeigen.de/s-berlin/c0-l3331']

def parse(self, response):

for ad in response.css('article.aditem'):

yield {

'title': ad.css('.aditem-main--title-line a::text').get(),

'price': ad.css('.aditem-main--middle--price-shipping--price::text').get(),

'location': ad.css('.aditem-main--top--left::text').get()

}

next_page = response.css('a.pagination-next::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.setExtraHTTPHeaders({'Accept-Language': 'de-DE'});

await page.goto('https://www.kleinanzeigen.de/s-berlin/c0-l3331');

const ads = await page.evaluate(() => {

return Array.from(document.querySelectorAll('.aditem')).map(el => ({

title: el.querySelector('.aditem-main--title-line a')?.innerText,

price: el.querySelector('.aditem-main--middle--price-shipping--price')?.innerText

}));

});

console.log(ads);

await browser.close();

})();คุณสามารถทำอะไรกับข้อมูล Kleinanzeigen

สำรวจการใช้งานจริงและข้อมูลเชิงลึกจากข้อมูล Kleinanzeigen

การจัดทำดัชนีตลาดอสังหาริมทรัพย์

นักลงทุนอสังหาริมทรัพย์สามารถติดตามราคาเช่าและราคาขายเพื่อระบุย่านที่ราคายังต่ำกว่ามูลค่าจริง

วิธีการนำไปใช้:

- 1สแครปหมวดหมู่ 'Immobilien' (อสังหาริมทรัพย์) ทุกวัน

- 2ดึงรหัสไปรษณีย์และราคาต่อตารางเมตร

- 3รวบรวมข้อมูลเป็นดัชนีราคาประจำสัปดาห์

- 4เปรียบเทียบแนวโน้มกับรายงานที่อยู่อาศัยอย่างเป็นทางการของรัฐบาล

ใช้ Automatio เพื่อดึงข้อมูลจาก Kleinanzeigen และสร้างแอปพลิเคชันเหล่านี้โดยไม่ต้องเขียนโค้ด

คุณสามารถทำอะไรกับข้อมูล Kleinanzeigen

- การจัดทำดัชนีตลาดอสังหาริมทรัพย์

นักลงทุนอสังหาริมทรัพย์สามารถติดตามราคาเช่าและราคาขายเพื่อระบุย่านที่ราคายังต่ำกว่ามูลค่าจริง

- สแครปหมวดหมู่ 'Immobilien' (อสังหาริมทรัพย์) ทุกวัน

- ดึงรหัสไปรษณีย์และราคาต่อตารางเมตร

- รวบรวมข้อมูลเป็นดัชนีราคาประจำสัปดาห์

- เปรียบเทียบแนวโน้มกับรายงานที่อยู่อาศัยอย่างเป็นทางการของรัฐบาล

- การตรวจสอบสต็อกยานยนต์

ตัวแทนจำหน่ายรถยนต์มือสองสามารถตรวจสอบราคาของคู่แข่งและการหมุนเวียนสต็อกได้แบบเรียลไทม์

- กำหนดเป้าหมายยี่ห้อและรุ่นรถเฉพาะในส่วน 'Auto'

- ดึงข้อมูลเลขไมล์ ปีที่จดทะเบียน และราคา

- ระบุรายการประกาศที่ค้างอยู่นานเพื่อตรวจหาการตั้งราคาที่สูงเกินไป

- ตั้งค่าการแจ้งเตือนอัตโนมัติสำหรับดีลใหม่ที่ลงประกาศในราคาต่ำกว่าตลาด

- การสร้างลีดสำหรับธุรกิจบริการ

บริษัทขนย้ายและทำความสะอาดสามารถหาลูกค้าได้ในเวลาที่พวกเขาต้องการบริการพอดี

- ตรวจสอบหมวดหมู่ 'Möbel & Wohnen' เพื่อหาการขายเฟอร์นิเจอร์ที่บ่งบอกถึงการย้ายที่อยู่

- ดึงข้อมูลเขตและเมืองของผู้ขาย

- กรองประกาศโดยใช้คำหลักเช่น 'Umzug' (การย้ายบ้าน)

- ส่งลีด (leads) ให้ทีมขายเพื่อทำการตลาดในพื้นที่

- การติดตามราคาอุปกรณ์อิเล็กทรอนิกส์สำหรับผู้บริโภค

ผู้ค้าปลีกสามารถปรับข้อเสนอการรับเทิร์นเครื่องได้โดยการตรวจสอบมูลค่าตลาดปัจจุบันของเทคโนโลยีมือสอง

- สแครปหมวดหมู่เช่น 'Handy & Telecom' หรือ 'Konsole'

- ทำความสะอาดข้อความราคาเพื่อลบเครื่องหมาย 'VB' (ต่อรองได้) หรือ 'Günstig' (ราคาถูก)

- คำนวณราคาขายต่อเฉลี่ยสำหรับรุ่นเฉพาะเช่น iPhone หรือ PlayStation

- อัปเดตราคาซื้อคืนของอีคอมเมิร์ซแบบไดนามิกตามผลลัพธ์ที่ได้

- การวิเคราะห์ความต้องการในแต่ละภูมิภาค

นักวิจัยตลาดสามารถระบุได้ว่าสินค้าประเภทใดมีความต้องการสูงในรัฐต่างๆ ของเยอรมนี

- สแครปจำนวนประกาศในเมืองต่างๆ ของเยอรมนี (เช่น มิวนิก เทียบกับ เบอร์ลิน)

- เปรียบเทียบปริมาณในแต่ละหมวดหมู่ตามช่วงเวลา

- ระบุช่วงที่มีความต้องการสูงตามฤดูกาลในหมวดหมู่เช่น 'Garten' (สวน) หรือ 'Wintersport' (กีฬากันหนาว)

- สร้างรายงานสำหรับธุรกิจที่วางแผนการกระจายสินค้าในระดับภูมิภาค

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมืออาชีพสำหรับการ Scrape Kleinanzeigen

คำแนะนำจากผู้เชี่ยวชาญสำหรับการดึงข้อมูลจาก Kleinanzeigen อย่างประสบความสำเร็จ

ใช้ residential proxy ของเยอรมนีเสมอเพื่อป้องกันการถูกบล็อก IP ทันทีที่ระบบตรวจพบทราฟฟิกจากต่างประเทศ

ตั้งค่าภาษาของเบราว์เซอร์เป็น 'de-DE' เพื่อให้มั่นใจว่าเว็บไซต์แสดงผลอย่างถูกต้องและลดความสงสัยว่าเป็นบอต

กำหนดเวลาหน่วง (sleep timers) แบบสุ่มระหว่าง 10 ถึง 30 วินาที เพื่อจำลองพฤติกรรมการใช้งานแบบมนุษย์

ทำการสแครปในช่วงกลางคืน (เวลา CET) ซึ่งเป็นช่วงที่มีทราฟฟิกต่ำ เพื่อลดความเสี่ยงในการโดน rate limiting

ใช้เบราว์เซอร์แบบ headless ร่วมกับ stealth plugin เพื่อบายพาสการตรวจสอบ TLS fingerprinting ของ Akamai

หลีกเลี่ยงการสแครปหน้าเว็บที่ต้องล็อกอินหากไม่จำเป็น เนื่องจากการสแครปข้อมูลโดยใช้บัญชีผู้ใช้มีความเสี่ยงสูงที่จะถูกแบน

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง Web Scraping

How to Scrape The AA (theaa.com): A Technical Guide for Car & Insurance Data

How to Scrape CSS Author: A Comprehensive Web Scraping Guide

How to Scrape Bilregistret.ai: Swedish Vehicle Data Extraction Guide

How to Scrape Biluppgifter.se: Vehicle Data Extraction Guide

How to Scrape Car.info | Vehicle Data & Valuation Extraction Guide

How to Scrape GoAbroad Study Abroad Programs

How to Scrape ResearchGate: Publication and Researcher Data

How to Scrape Statista: The Ultimate Guide to Market Data Extraction

คำถามที่พบบ่อยเกี่ยวกับ Kleinanzeigen

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ Kleinanzeigen