วิธีดึงข้อมูล LivePiazza: เครื่องมือ Scrape อสังหาริมทรัพย์ในฟิลาเดลเฟีย

เรียนรู้วิธีดึงข้อมูล LivePiazza.com เพื่อดึงราคาอพาร์ตเมนต์หรู สถานะว่าง และแผนผังห้อง ติดตามตลาดอสังหาริมทรัพย์ในฟิลาเดลเฟียด้วย AI

ตรวจพบการป้องกันบอท

- Cloudflare

- WAF และการจัดการบอทระดับองค์กร ใช้ JavaScript challenges, CAPTCHAs และการวิเคราะห์พฤติกรรม ต้องมีระบบอัตโนมัติของเบราว์เซอร์พร้อมการตั้งค่าซ่อนตัว

- การจำกัดอัตรา

- จำกัดคำขอต่อ IP/เซสชันตามเวลา สามารถหลีกเลี่ยงได้ด้วยพร็อกซีหมุนเวียน การหน่วงเวลาคำขอ และการสแกรปแบบกระจาย

- ลายนิ้วมือเบราว์เซอร์

- ระบุบอทผ่านลักษณะเฉพาะของเบราว์เซอร์: canvas, WebGL, ฟอนต์, ปลั๊กอิน ต้องมีการปลอมแปลงหรือโปรไฟล์เบราว์เซอร์จริง

- JavaScript Challenge

- ต้องมีการเรียกใช้ JavaScript เพื่อเข้าถึงเนื้อหา คำขอแบบง่ายจะล้มเหลว ต้องใช้เบราว์เซอร์ headless เช่น Playwright หรือ Puppeteer

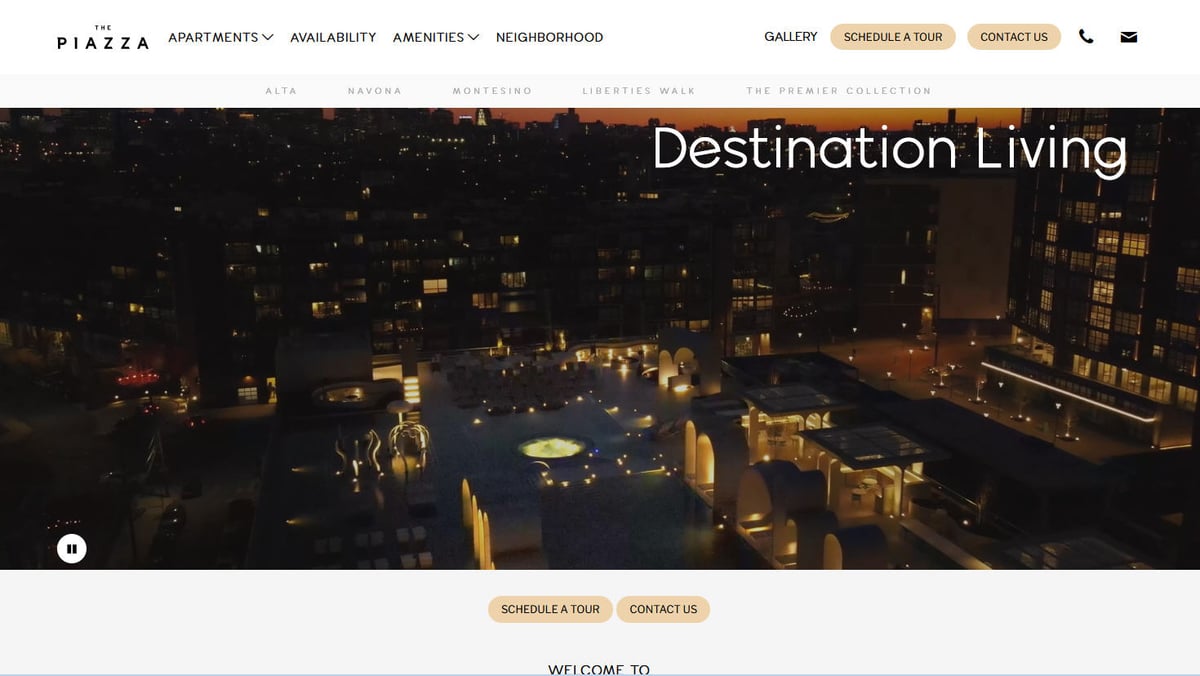

เกี่ยวกับ The Piazza

ค้นพบสิ่งที่ The Piazza นำเสนอและข้อมูลที่มีค่าที่สามารถดึงได้

The Piazza บริหารจัดการโดย Post Brothers เป็นโครงการพัฒนาอสังหาริมทรัพย์เพื่อการอยู่อาศัยและร้านค้าที่โดดเด่นในย่าน Northern Liberties ของฟิลาเดลเฟีย ประกอบด้วยชุมชนหรูหรา 4 แห่ง ได้แก่ Alta, Navona, Montesino และ Liberties Walk ซึ่งมอบประสบการณ์แบบ 'เมืองในเมือง' พร้อมสิ่งอำนวยความสะดวกระดับไฮเอนด์และการออกแบบที่ทันสมัย

เว็บไซต์นี้ทำหน้าที่เป็นพอร์ทัลแบบเรียลไทม์สำหรับผู้ที่สนใจเข้าพัก โดยแสดงอัตราค่าเช่าปัจจุบัน วันที่ห้องว่าง และตัวเลือกการตกแต่งภายในโดยละเอียด สำหรับนักวิทยาศาสตร์ข้อมูลและนักวิเคราะห์อสังหาริมทรัพย์ LivePiazza เป็นแหล่งข้อมูลสำคัญในการทำความเข้าใจตลาด multi-family ระดับหรูในเขตเมืองที่เติบโตเร็วที่สุดแห่งหนึ่งในแถบตะวันออกเฉียงเหนือ

การดึงข้อมูลนี้ช่วยให้สามารถติดตามแนวโน้มราคา ระดับการเข้าพัก และประสิทธิภาพของแรงจูงใจในการเช่าต่างๆ ที่เสนอโดยผู้พัฒนาอสังหาริมทรัพย์รายใหญ่ได้อย่างต่อเนื่อง

ทำไมต้อง Scrape The Piazza?

ค้นพบคุณค่าทางธุรกิจและกรณีการใช้งานสำหรับการดึงข้อมูลจาก The Piazza

ติดตามความผันผวนของราคาเช่าแบบเรียลไทม์ในตลาดหรูของฟิลาเดลเฟีย

ติดตามอัตราการเข้าพักและการหมุนเวียนของยูนิตในชุมชนอาคารต่างๆ

วิเคราะห์ผลกระทบของส่วนลดการเช่า เช่น 'อยู่ฟรี 2 เดือน' ต่อค่าเช่าสุทธิ

รวบรวมข้อมูลแผนผังห้องความละเอียดสูงเพื่อการวิจัยด้านสถาปัตยกรรมและการออกแบบภายใน

สร้างระบบหาลูกค้าอัตโนมัติสำหรับบริการในท้องถิ่น เช่น บริษัทขนย้ายและผู้จำหน่ายเฟอร์นิเจอร์

ทำการเปรียบเทียบเชิงแข่งขันกับโครงการหรูอื่นๆ ในภูมิภาค

ความท้าทายในการ Scrape

ความท้าทายทางเทคนิคที่คุณอาจพบเมื่อ Scrape The Piazza

หน้าจอ 'Waiting Room' และ 'Just a moment' ของ Cloudflare ที่บล็อกการเรียกใช้จาก bot พื้นฐาน

การพึ่งพาการเรนเดอร์ JavaScript ฝั่งไคลเอนต์อย่างหนักสำหรับตารางสถานะห้องว่าง

endpoint ของ API ภายในใช้ tokens แบบไดนามิกที่หมดอายุอย่างรวดเร็ว

การอัปเดตโครงสร้าง DOM บ่อยครั้งซึ่งอาจทำให้ CSS selectors แบบคงที่ใช้งานไม่ได้

สกัดข้อมูลจาก The Piazza ด้วย AI

ไม่ต้องเขียนโค้ด สกัดข้อมูลภายในไม่กี่นาทีด้วยระบบอัตโนมัติที่ขับเคลื่อนด้วย AI

วิธีการทำงาน

อธิบายสิ่งที่คุณต้องการ

บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก The Piazza แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

AI สกัดข้อมูล

ปัญญาประดิษฐ์ของเรานำทาง The Piazza จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

รับข้อมูลของคุณ

รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

ทำไมต้องใช้ AI ในการสกัดข้อมูล

AI ทำให้การสกัดข้อมูลจาก The Piazza เป็นเรื่องง่ายโดยไม่ต้องเขียนโค้ด แพลตฟอร์มที่ขับเคลื่อนด้วยปัญญาประดิษฐ์ของเราเข้าใจว่าคุณต้องการข้อมูลอะไร — แค่อธิบายเป็นภาษาธรรมชาติ แล้ว AI จะสกัดให้โดยอัตโนมัติ

How to scrape with AI:

- อธิบายสิ่งที่คุณต้องการ: บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก The Piazza แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

- AI สกัดข้อมูล: ปัญญาประดิษฐ์ของเรานำทาง The Piazza จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

- รับข้อมูลของคุณ: รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

Why use AI for scraping:

- แก้ปัญหาความท้าทายจาก Cloudflare โดยอัตโนมัติโดยไม่ต้องกำหนดค่าพร็อกซีด้วยตนเอง

- เรนเดอร์เนื้อหา JavaScript แบบไดนามิกได้เหมือนกับเบราว์เซอร์ของมนุษย์

- อนุญาตให้เลือกจุดข้อมูลด้วยภาพผ่านแผนผังห้องที่ซับซ้อน

- รองรับการทำงานตามกำหนดเวลาเพื่อจัดเก็บการเปลี่ยนแปลงราคาในแต่ละวันและแนวโน้มในอดีต

- ส่งออกข้อมูลโดยตรงไปยัง Google Sheets หรือผ่าน Webhook เพื่อการวิเคราะห์ทันที

No-code web scrapers สำหรับ The Piazza

ทางเลือกแบบ point-and-click สำหรับการ scraping ด้วย AI

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape The Piazza โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

ความท้าทายทั่วไป

เส้นโค้งการเรียนรู้

การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

Selectors เสีย

การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

ปัญหาเนื้อหาไดนามิก

เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

ข้อจำกัด CAPTCHA

เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

การบล็อก IP

การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

No-code web scrapers สำหรับ The Piazza

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape The Piazza โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

- ติดตั้งส่วนขยายเบราว์เซอร์หรือสมัครใช้งานแพลตฟอร์ม

- นำทางไปยังเว็บไซต์เป้าหมายและเปิดเครื่องมือ

- เลือกองค์ประกอบข้อมูลที่ต้องการดึงด้วยการชี้และคลิก

- กำหนดค่า CSS selectors สำหรับแต่ละฟิลด์ข้อมูล

- ตั้งค่ากฎการแบ่งหน้าเพื่อ scrape หลายหน้า

- จัดการ CAPTCHA (มักต้องแก้ไขด้วยตนเอง)

- กำหนดค่าการตั้งเวลาสำหรับการรันอัตโนมัติ

- ส่งออกข้อมูลเป็น CSV, JSON หรือเชื่อมต่อผ่าน API

ความท้าทายทั่วไป

- เส้นโค้งการเรียนรู้: การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

- Selectors เสีย: การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

- ปัญหาเนื้อหาไดนามิก: เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

- ข้อจำกัด CAPTCHA: เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

- การบล็อก IP: การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

ตัวอย่างโค้ด

import requests

from bs4 import BeautifulSoup

# หมายเหตุ: การเรียกโดยตรงนี้มักจะล้มเหลวเนื่องจาก Cloudflare

# แนะนำให้ใช้พร็อกซีหรือโซลูชันบายพาสอย่าง cloudscraper

url = 'https://www.livepiazza.com/residences'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36',

'Accept-Language': 'en-US,en;q=0.9'

}

def fetch_piazza():

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# ตัวอย่าง selector สำหรับการ์ดที่พัก

for card in soup.select('.residence-card'):

name = card.select_one('.residence-name').text.strip()

price = card.select_one('.price-value').text.strip()

print(f'ชุมชน: {name} | ราคา: {price}')

else:

print(f'ถูกบล็อกโดย Anti-Bot: สถานะ {response.status_code}')

except Exception as e:

print(f'เกิดข้อผิดพลาด: {e}')

fetch_piazza()เมื่อไหร่ควรใช้

เหมาะที่สุดสำหรับหน้า HTML แบบ static ที่มี JavaScript น้อย เหมาะสำหรับบล็อก ไซต์ข่าว และหน้าสินค้า e-commerce ธรรมดา

ข้อดี

- ●ประมวลผลเร็วที่สุด (ไม่มี overhead ของเบราว์เซอร์)

- ●ใช้ทรัพยากรน้อยที่สุด

- ●ง่ายต่อการทำงานแบบขนานด้วย asyncio

- ●เหมาะมากสำหรับ API และหน้า static

ข้อจำกัด

- ●ไม่สามารถรัน JavaScript ได้

- ●ล้มเหลวใน SPA และเนื้อหาไดนามิก

- ●อาจมีปัญหากับระบบ anti-bot ที่ซับซ้อน

วิธีสเครปข้อมูล The Piazza ด้วยโค้ด

Python + Requests

import requests

from bs4 import BeautifulSoup

# หมายเหตุ: การเรียกโดยตรงนี้มักจะล้มเหลวเนื่องจาก Cloudflare

# แนะนำให้ใช้พร็อกซีหรือโซลูชันบายพาสอย่าง cloudscraper

url = 'https://www.livepiazza.com/residences'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36',

'Accept-Language': 'en-US,en;q=0.9'

}

def fetch_piazza():

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# ตัวอย่าง selector สำหรับการ์ดที่พัก

for card in soup.select('.residence-card'):

name = card.select_one('.residence-name').text.strip()

price = card.select_one('.price-value').text.strip()

print(f'ชุมชน: {name} | ราคา: {price}')

else:

print(f'ถูกบล็อกโดย Anti-Bot: สถานะ {response.status_code}')

except Exception as e:

print(f'เกิดข้อผิดพลาด: {e}')

fetch_piazza()Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def scrape_live_piazza():

async with async_playwright() as p:

# เริ่มการทำงานด้วย user agent เฉพาะเพื่อเลียนแบบเบราว์เซอร์จริง

browser = await p.chromium.launch(headless=True)

context = await browser.new_context(user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36')

page = await context.new_page()

await page.goto('https://www.livepiazza.com/alta/')

# รอให้ตารางยูนิตแบบไดนามิกโหลดเสร็จ

await page.wait_for_selector('.unit-row', timeout=15000)

units = await page.query_selector_all('.unit-row')

for unit in units:

unit_id = await (await unit.query_selector('.unit-id')).inner_text()

rent = await (await unit.query_selector('.unit-rent')).inner_text()

print(f'ยูนิต: {unit_id.strip()} | ค่าเช่า: {rent.strip()}')

await browser.close()

asyncio.run(scrape_live_piazza())Python + Scrapy

import scrapy

class PiazzaSpider(scrapy.Spider):

name = 'piazza_spider'

start_urls = ['https://www.livepiazza.com/communities']

def parse(self, response):

# Scrapy จำเป็นต้องใช้ middleware สำหรับการเรนเดอร์ JS (เช่น Scrapy-Playwright) สำหรับเว็บไซต์นี้

for building in response.css('.building-section'):

yield {

'building_name': building.css('h3.name::text').get(),

'link': building.css('a.explore-btn::attr(href)').get(),

'starting_price': building.css('.starting-from::text').get()

}

# ตัวอย่างการไปยังหน้าถัดไป

next_page = response.css('a.next-page::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

await page.goto('https://www.livepiazza.com/montesino', { waitUntil: 'networkidle2' });

// รอให้คอนเทนเนอร์ residences เรนเดอร์เสร็จ

await page.waitForSelector('.residences-container');

const apartmentData = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('.apartment-listing'));

return rows.map(row => ({

type: row.querySelector('.plan-type').innerText,

sqft: row.querySelector('.sqft').innerText,

available: row.querySelector('.availability').innerText

}));

});

console.log(apartmentData);

await browser.close();

})();คุณสามารถทำอะไรกับข้อมูล The Piazza

สำรวจการใช้งานจริงและข้อมูลเชิงลึกจากข้อมูล The Piazza

ดัชนีค่าเช่าแบบเรียลไทม์

สร้างแดชบอร์ดแบบสดเพื่อติดตามค่าเช่าเฉลี่ยต่อตารางฟุตสำหรับอพาร์ตเมนต์หรูใน Northern Liberties

วิธีการนำไปใช้:

- 1ดึงราคาเช่ารายวันสำหรับยูนิตแบบ Studio, 1BR และ 2BR ทั้งหมด

- 2ปรับราคาให้เป็นมาตรฐานตามพื้นที่ตารางฟุตเพื่อสร้างเกณฑ์ชี้วัด PPSF

- 3สร้างแผนภูมิแสดงแนวโน้มในช่วงระยะเวลา 90 วัน

ใช้ Automatio เพื่อดึงข้อมูลจาก The Piazza และสร้างแอปพลิเคชันเหล่านี้โดยไม่ต้องเขียนโค้ด

คุณสามารถทำอะไรกับข้อมูล The Piazza

- ดัชนีค่าเช่าแบบเรียลไทม์

สร้างแดชบอร์ดแบบสดเพื่อติดตามค่าเช่าเฉลี่ยต่อตารางฟุตสำหรับอพาร์ตเมนต์หรูใน Northern Liberties

- ดึงราคาเช่ารายวันสำหรับยูนิตแบบ Studio, 1BR และ 2BR ทั้งหมด

- ปรับราคาให้เป็นมาตรฐานตามพื้นที่ตารางฟุตเพื่อสร้างเกณฑ์ชี้วัด PPSF

- สร้างแผนภูมิแสดงแนวโน้มในช่วงระยะเวลา 90 วัน

- การวิเคราะห์กลยุทธ์ส่วนลด

วิเคราะห์ว่าผู้จัดการอสังหาริมทรัพย์ใช้แรงจูงใจ 'ฟรีค่าเช่า' เพื่อเติมเต็มห้องว่างในอาคารต่างๆ อย่างไร

- ดึงข้อมูลฟิลด์ 'Promotions' สำหรับทุกยูนิตที่ประกาศเช่า

- เปรียบเทียบโปรโมชันกับจำนวนวันที่ยูนิตนั้นถูกลงประกาศไว้

- ระบุ 'จุดเปลี่ยน' ที่ผู้พัฒนาเริ่มเพิ่มแรงจูงใจหรือส่วนลด

- การศึกษาความเป็นไปได้ในการลงทุน

ใช้ข้อมูลเพื่อสนับสนุนหรือปฏิเสธโครงการพัฒนาห้องพักหรูแห่งใหม่ในพื้นที่ใกล้เคียง โดยพิจารณาจากอุปสงค์และอุปทานในปัจจุบัน

- รวบรวมจำนวนยูนิตว่างทั้งหมดใน Alta, Navona และ Montesino

- แบ่งกลุ่มสถานะว่างตาม 'วันที่ย้ายเข้า' เพื่อคาดการณ์การดูดซับอุปทาน (supply absorption)

- เปรียบเทียบราคาของ Piazza กับค่าเฉลี่ยห้องพักหรูทั่วเมือง

- การหาลูกค้าสำหรับธุรกิจขนย้าย

ระบุช่วงเวลาที่มีการย้ายเข้าจำนวนมากเพื่อวางแผนการตลาดสำหรับบริการขนย้ายและทำความสะอาดในท้องถิ่น

- กรองรายการที่ดึงมาเฉพาะ 'Available Now' หรือวันที่ที่กำลังจะมาถึง

- มุ่งเป้าไปที่อาคารที่มีจำนวนยูนิตว่างที่กำลังจะเกิดขึ้นสูงสุด

- ปรับงบประมาณการโฆษณาให้สอดคล้องกับช่วงเวลาที่มีการหมุนเวียนผู้เช่าสูงสุดที่คาดการณ์ไว้

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมืออาชีพสำหรับการ Scrape The Piazza

คำแนะนำจากผู้เชี่ยวชาญสำหรับการดึงข้อมูลจาก The Piazza อย่างประสบความสำเร็จ

ใช้ residential proxies ที่ตั้งอยู่ในฟิลาเดลเฟียเพื่อลดความสงสัยจากตัวกรองความปลอดภัยของ Cloudflare

เน้นการทำ scraping ในช่วงเช้ามืด (เวลา ET) ซึ่งเป็นช่วงที่ฝ่ายจัดการอสังหาริมทรัพย์อัปเดตสถานะว่างของยูนิต

ตรวจสอบแท็บ 'Network' ในเบราว์เซอร์ของคุณเพื่อระบุการเรียก XHR/Fetch ที่ส่งคืนข้อมูล JSON สำหรับตารางยูนิต

หมุนเวียน User-Agents บ่อยๆ เพื่อหลีกเลี่ยงการจำกัดอัตรา (rate limiting) ตามลายนิ้วมือเบราว์เซอร์ (fingerprint)

คำนวณ 'Net Effective Rent' (ค่าเช่าสุทธิ) โดยการแยกข้อมูลข้อความของข้อเสนอโปรโมชัน (เช่น 'ฟรีค่าเช่า 1 เดือน สำหรับสัญญาเช่า 13 เดือน')

ใช้ตรรกะ 'wait for' ในเครื่องมือ scraping ของคุณเพื่อให้แน่ใจว่าแผนผังห้องแบบโต้ตอบได้รับการเรนเดอร์อย่างสมบูรณ์ก่อนที่จะดึงข้อมูล

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง Web Scraping

How to Scrape Century 21 Property Listings

How to Scrape Homes.com: Real Estate Data Extraction Guide

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Sacramento Delta Property Management

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Apartments Near Me | Real Estate Data Scraper

คำถามที่พบบ่อยเกี่ยวกับ The Piazza

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ The Piazza