GLM-5.1

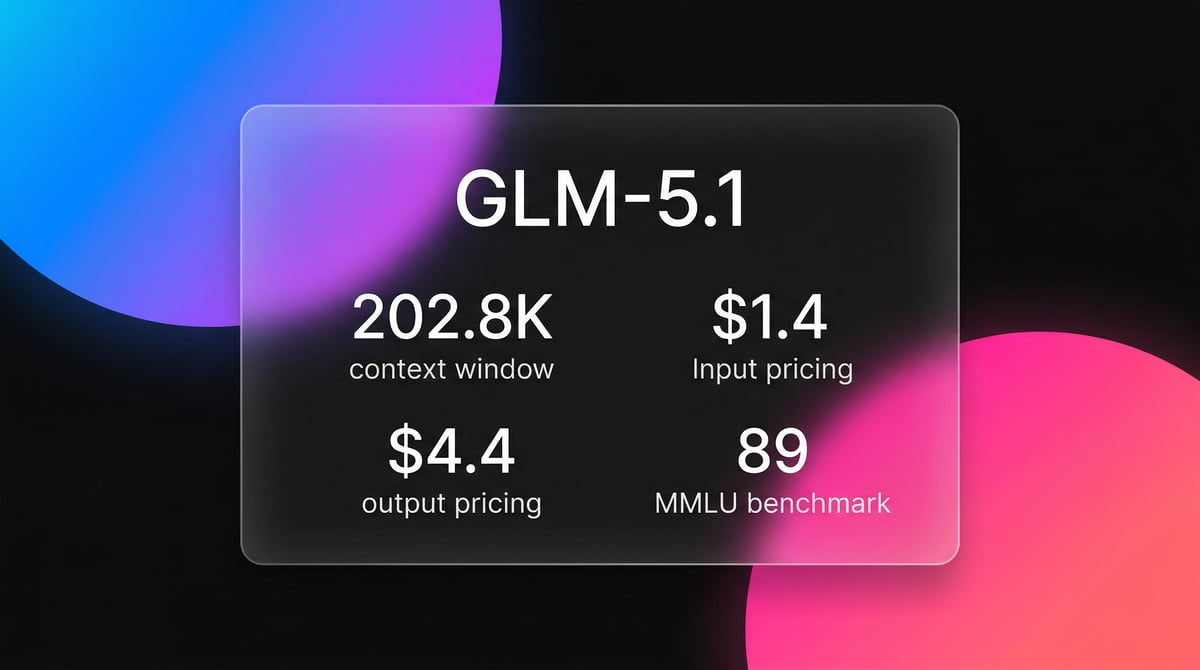

GLM-5.1 คือโมเดล reasoning เรือธงของ Zhipu AI มาพร้อม 202K context window และลูปการทำงานอัตโนมัติ 8 ชั่วโมงสำหรับวิศวกรรมระดับ agentic ที่ซับซ้อน

เกี่ยวกับ GLM-5.1

เรียนรู้เกี่ยวกับความสามารถของ GLM-5.1 คุณสมบัติ และวิธีที่จะช่วยให้คุณได้ผลลัพธ์ที่ดีขึ้น

GLM-5.1 คือ foundation model เรือธงของ Zhipu AI ที่ออกแบบมาสำหรับวิศวกรรมระบบที่ซับซ้อนและงาน agentic ระยะยาว โดยสร้างขึ้นบนสถาปัตยกรรม Mixture-of-Experts (MoE) ที่มี 744 พันล้าน parameters และใช้ 40 พันล้าน active per pass ซึ่งถือเป็นการก้าวกระโดดครั้งสำคัญในด้านความอดทนและการแก้ปัญหาแบบอัตโนมัติ โมเดลนี้ได้รับการวิศวกรรมขึ้นมาเพื่อข้ามผ่านขีดจำกัด (plateau) ที่พบใน LLM รุ่นก่อนหน้า โดยสามารถรักษาประสิทธิภาพการผลิตและคุณภาพของโค้ดได้ผ่านการเรียกใช้งานหลายพันครั้งและวนลูปการทำงานหลายร้อยรอบ มันสามารถระบุปัญหา ทดลอง และปรับกลยุทธ์ของตัวเองได้โดยไม่ต้องพึ่งพามนุษย์

ในเชิงเทคนิค GLM-5.1 โดดเด่นในฐานะแกนกลางการ reasoning หลักในระบบ multi-agent โดยจัดการการตัดสินใจทางสถาปัตยกรรมระดับสูงพร้อมแบ่งงานไปให้โมเดลย่อยๆ จัดการ มี context window ขนาด 202K ที่รองรับโดยกลไก dynamic sparse attention เพื่อความต่อเนื่องใน codebases ขนาดใหญ่ โมเดลถูกปล่อยเป็น open weights ภายใต้ MIT License เพื่อเป็นทางเลือกบน local สำหรับการแทนที่โมเดลแบบปิดในงานจำพวกการปรับแต่งฐานข้อมูล, การเขียน GPU kernel, และการพัฒนาเว็บแอปพลิเคชันแบบ full-stack

ผลลัพธ์จาก KernelBench Level 3 แสดงให้เห็นว่า GLM-5.1 มีความเร็วในงาน agentic ML ที่ยาวนาน เหนือกว่า Claude Opus 4.6 อย่างมีนัยสำคัญ ความอึดนี้ช่วยให้นักพัฒนาสามารถสั่งงานวิศวกรรมทิ้งไว้ตอนเช้าแล้วรับมอบงานที่ทดสอบและ deploy เสร็จสิ้นภายในสิ้นวันได้ทันที โดยมันสามารถจัดการวงจรการแก้ไขบั๊กได้ตั้งแต่การจำลองปัญหาไปจนถึงการส่ง pull request สุดท้าย

กรณีการใช้งานสำหรับ GLM-5.1

ค้นพบวิธีต่างๆ ที่คุณสามารถใช้ GLM-5.1 เพื่อได้ผลลัพธ์ที่ยอดเยี่ยม

วิศวกรรมซอฟต์แวร์อัตโนมัติ

ทำงานแบบอัตโนมัติได้ต่อเนื่องกว่า 8 ชั่วโมงเพื่อออกแบบ พัฒนา และ debug ไมโครเซอร์วิสโดยไม่ต้องพึ่งพามนุษย์

การจูนฐานข้อมูลประสิทธิภาพสูง

โมเดลจะวนลูปปรับปรุงการทำงานของระบบ vector search ที่เขียนด้วย Rust เป็นเวลาหลายร้อยรอบ

การปรับแต่ง GPU Kernel

วิเคราะห์ reference implementations เพื่อสร้าง GPU kernels ที่ทำงานได้เร็วกว่าตัว autotune compilers แบบปกติ

การประสานงาน Multi-Agent

ทำหน้าที่เป็นแกนกลางด้านการ reasoning เพื่อจัดสรรงานย่อยและเรียกใช้เครื่องมือต่างๆ ในกลุ่มโมเดลเฉพาะทาง

งาน Terminal ที่ซับซ้อน

รันคำสั่ง terminal และจัดการระบบในระดับขั้นตอนที่ซับซ้อนผ่านเครื่องมือ CLI ระดับ agentic

การออกแบบ Full-Stack เว็บไซต์

สร้าง UI layouts ที่มีความสอดคล้องกันและจัดการ backend logic สำหรับสภาพแวดล้อมเดสก์ท็อปบนเบราว์เซอร์

จุดแข็ง

ข้อจำกัด

เริ่มต้นด่วน API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimize this database schema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}ติดตั้ง SDK และเริ่มเรียก API ภายในไม่กี่นาที

ผู้คนพูดอะไรเกี่ยวกับ GLM-5.1

ดูว่าชุมชนคิดอย่างไรเกี่ยวกับ GLM-5.1

“GLM-5.1 รันลูปบน prompt เดียวต่อเนื่องนาน 8 ชั่วโมง มันไม่เลิกทำงานเหมือนโมเดลส่วนใหญ่ แต่มันกลับเพิ่มฟีเจอร์และทบทวนตัวเองไปเรื่อยๆ”

“ผมทดสอบการใช้งานที่ context 140k ถึง 5 ครั้ง และมันยังคงรักษาความต่อเนื่องได้ดี SOTA อาจจะมีคู่แข่งแล้ว”

“GLM-5.1 แทบจะสูสีกับ Opus ใน benchmark นี้ มันกลายเป็นโมเดล open ที่ดีที่สุดอันดับ 1 ใน Arena แล้ว”

“ทุกครั้งที่เห็น NPC ยอมจำนนด้วยบทสนทนาแบบไม่ได้เขียนสคริปต์ไว้ล่วงหน้ากับ GLM-5.1 มันเหมือนเวทมนตร์จริงๆ”

“ประสิทธิภาพด้าน Coding นั้นใช้ได้จริง มันแก้ไขปัญหา race condition ใน Go backend ที่ GPT-4o มักจะหลอน (hallucinate) ตลอดเวลาได้”

“การรันโมเดลนี้แบบ local ด้วย Unsloth คือจุดเปลี่ยนสำหรับความเป็นส่วนตัวของข้อมูลใน stack งานกฎหมายของเรา”

วิดีโอเกี่ยวกับ GLM-5.1

ดูบทเรียน รีวิว และการสนทนาเกี่ยวกับ GLM-5.1

“GLM-5.1 ทำคะแนนได้ 45.3% บน benchmark นี้ ซึ่งเป็นการก้าวกระโดดที่สำคัญมาก”

“เป็นโมเดลที่ช้ามาก... ดูเหมือนพวกเขาจะยังใช้ GPU ส่วนใหญ่ไปกับการรัน GLM-5 อยู่”

“วิธีการเรียกใช้เครื่องมือ (tool calls) ทำได้แข็งแกร่งกว่า GLM 5 มาตรฐานมาก”

“นี่คือโมเดล reasoning ที่ทรงพลังที่สุดในตอนนี้ที่คุณสามารถดาวน์โหลดไปรันบนฮาร์ดแวร์ตัวเองได้”

“คุณจะเห็นว่ามันสามารถระบุข้อผิดพลาดของตัวเองในบันทึกความคิดได้ด้วย”

“สามารถทำงานแบบอัตโนมัติได้นาน 8 ชั่วโมง โดยปรับกลยุทธ์ผ่านการทำซ้ำนับพันครั้ง”

“ทำผลงานได้เหนือกว่า Gemini 3.1 Pro และ Qwen 3.6 Plus ใน benchmark การสร้าง repo ยอดนิยม”

“โหมด agentic คือจุดแข็งที่สุดของโมเดลนี้ มันไม่ถอดใจกับบั๊กยากๆ”

“Z.ai ได้ทำลายกำแพงของโมเดลระดับ frontier ขนาด 744B parameters ให้เข้าถึงได้แล้ว”

“มันจัดการปัญหา 'plateau' ที่ทำให้ LLM อื่นๆ ขาดความต่อเนื่องเมื่อเวลาผ่านไปได้เป็นอย่างดี”

“ลดขนาดจาก 1.65 TB เดิมลงมาเหลือ 236GB โดยยังรักษาคุณภาพไว้อยู่”

“พลังของ open-source: แม้จะเป็นเวอร์ชันที่ถูกบีบอัด แต่มันก็ยังเขียนโค้ดที่ใช้งานได้จริง”

“คุณต้องใช้ RAM อย่างน้อย 256GB ถึงจะเริ่มคิดจะโหลด MoE ยักษ์ตัวนี้ได้”

“มันใช้กลไก dynamic sparse attention เพื่อรักษาความต่อเนื่องของ context 202k”

“การใช้ Unsloth ช่วยให้กระบวนการ fine-tuning และ inference มีประสิทธิภาพขึ้นมาก”

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมือโปรสำหรับ GLM-5.1

เคล็ดลับจากผู้เชี่ยวชาญเพื่อช่วยให้คุณใช้ประโยชน์สูงสุดจาก GLM-5.1 และได้ผลลัพธ์ที่ดีขึ้น

เปิดโหมด Thinking

ตรวจสอบให้แน่ใจว่าเปิดใช้งานสวิตช์ 'Thinking' ในการตั้งค่า เพื่อปลดล็อกความสามารถในการทำงานอัตโนมัติแบบต่อเนื่อง 8 ชั่วโมง

ใช้โควตาช่วงนอกเวลาเร่งด่วน

รันงานวิศวกรรมชุดใหญ่ในช่วงนอกเวลาเร่งด่วน (หลัง 18:00 น. หรือก่อน 14:00 น. ตามเวลาปักกิ่ง) เพื่อราคาที่ประหยัดกว่า

ข้อกำหนดด้านหน่วยความจำสำหรับการรันแบบ local

ใช้การทำ quantization แบบ Unsloth Dynamic GGUF เพื่อบีบอัดโมเดล 1.6TB ให้ลงไปอยู่ใน RAM 256GB สำหรับการรันในเครื่อง

การเลือกงานอย่างมีกลยุทธ์

สงวนการใช้งาน GLM-5.1 ไว้สำหรับงานด้านสถาปัตยกรรมและการใช้ reasoning ขั้นสูง และใช้ GLM-4.7 สำหรับงานเขียนโค้ดทั่วไปเพื่อคุมงบประมาณ

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

คำถามที่พบบ่อยเกี่ยวกับ GLM-5.1

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ GLM-5.1