So scrapen Sie Hacker News (news.ycombinator.com)

Erfahren Sie, wie Sie Hacker News scrapen, um Top-Tech-Beiträge, Stellenanzeigen und Community-Diskussionen zu extrahieren. Ideal für Marktforschung und...

Anti-Bot-Schutz erkannt

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

- User-Agent Filtering

Über Hacker News

Entdecken Sie, was Hacker News bietet und welche wertvollen Daten extrahiert werden können.

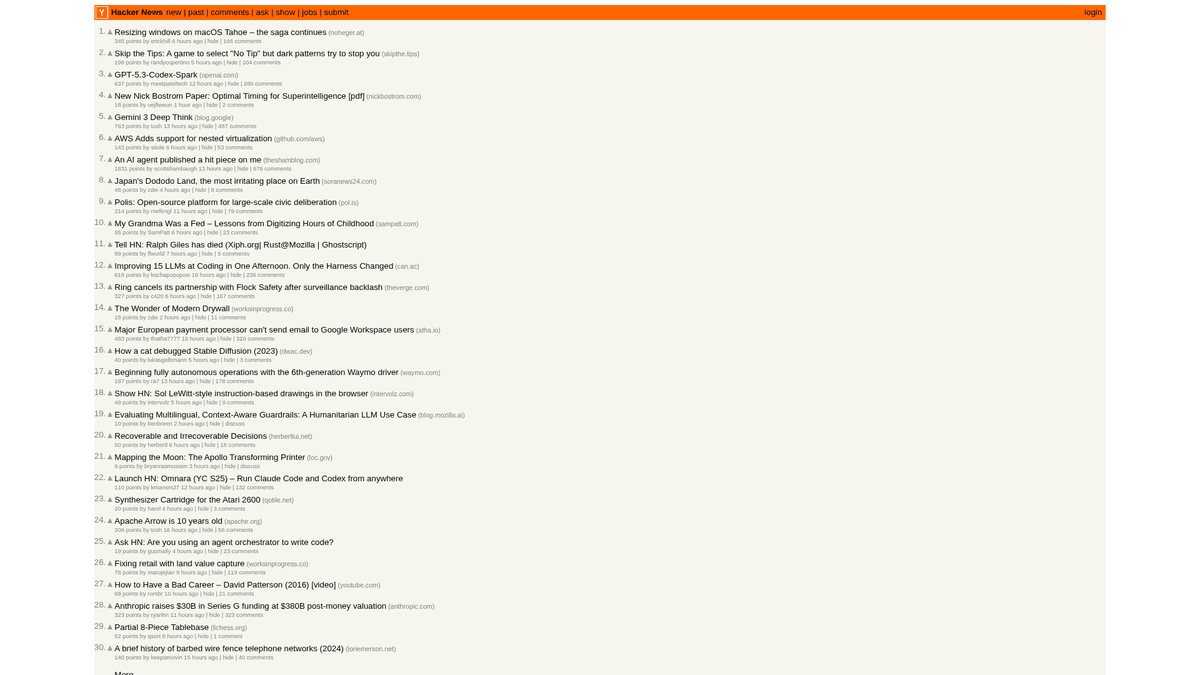

Der Tech-Hub

Hacker News ist eine Social-News-Website mit Fokus auf Informatik und Unternehmertum, die vom Startup-Inkubator Y Combinator betrieben wird. Sie fungiert als Community-Plattform, auf der Nutzer Links zu technischen Artikeln, Startup-News und tiefgehenden Diskussionen teilen.

Datenvielfalt

Die Plattform enthält eine Fülle von Echtzeitdaten, darunter hochbewertete Tech-Storys, "Show HN" Startup-Launches, "Ask HN" Community-Fragen und spezialisierte Jobbörsen. Sie gilt weithin als der Puls des Silicon Valley Ökosystems und der globalen Developer-Community.

Strategischer Mehrwert

Das Scrapen dieser Daten ermöglicht es Unternehmen und Forschern, aufkommende Technologien zu überwachen, Erwähnungen von Wettbewerbern zu verfolgen und einflussreiche Vordenker zu identifizieren. Da das Layout der Seite bemerkenswert stabil und schlank ist, gehört sie zu den zuverlässigsten Quellen für die automatisierte Aggregation technischer Nachrichten.

Warum Hacker News Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Hacker News.

Identifizierung von Markttrends

Überwachen Sie die Startseite in Echtzeit, um zu sehen, welche Programmiersprachen, Frameworks oder Tools in der Developer-Community an Bedeutung gewinnen.

Sentiment-Analyse

Scrapen Sie Kommentar-Threads, um zu analysieren, wie ein hochgradig technisches Publikum auf neue Produkt-Launches, Richtlinienänderungen oder Marktverschiebungen reagiert.

Startup-Intelligence

Verfolgen Sie 'Show HN'-Posts, um Startups in der Frühphase und innovative Nebenprojekte zu entdecken, bevor sie die Mainstream-Medien erreichen.

Lead-Generierung für Recruiting

Extrahieren Sie Daten von einstellenden Unternehmen aus dem Job-Bereich, um wachsende Tech-Firmen zu finden, die aktiv nach spezifischer Expertise suchen.

Content-Aggregation

Erstellen Sie hochwertige technische Newsfeeds oder Newsletter, indem Sie nach Beiträgen mit den meisten Upvotes oder spezifischen Developer-Keywords filtern.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Hacker News.

IP-Rate-Limiting

Hacker News begrenzt konsequent hochfrequente Anfragen von einer einzelnen IP-Adresse, was eine langsame Crawl-Geschwindigkeit oder Proxy-Rotation erforderlich macht.

Parsen verschachtelter Tabellen

Die Website verwendet veraltete HTML-Tabellenstrukturen für die Verschachtelung von Kommentaren, was eine sorgfältige Traversal-Logik erfordert, um Eltern-Kind-Beziehungen korrekt zu rekonstruieren.

Relative Zeitstempel

Zeiten werden als 'vor X Stunden' angezeigt. Dies erfordert eine Konvertierungslogik, wenn Sie absolute Zeitstempel für eine historische Zeitreihendatenbank benötigen.

Dynamische Rankings

Die Startseite ändert sich schnell, wenn Beiträge steigen oder fallen, was zu Datenduplikaten oder verpassten Elementen führen kann, wenn das Scraping nicht über eindeutige IDs erfolgt.

Scrape Hacker News mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Hacker News extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Hacker News, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Hacker News zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Hacker News extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Hacker News, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- No-Code Extraktion von Beiträgen: Extrahieren Sie Titel, Punkte und URLs in Minuten, indem Sie einfach auf Elemente klicken, anstatt benutzerdefinierte CSS- oder XPath-Selektoren für verschachtelte Tabellen zu schreiben.

- Intelligente Paginierung: Automatio verarbeitet den 'More'-Link mühelos, um automatisch durch mehrere Seiten des Verlaufs oder tiefe Kommentar-Threads zu navigieren.

- Integrierte Proxy-Rotation: Umgehen Sie Rate-Limits automatisch mit integrierter Proxy-Rotation und stellen Sie sicher, dass Ihre Scraping-Aufgaben nie durch IP-Sperren unterbrochen werden.

- Geplantes Monitoring: Richten Sie einen Zeitplan ein, um die Startseite automatisch jede Stunde zu scrapen und Ihre Datenbank mit den neuesten Tech-Trends aktuell zu halten.

- Direkte Integration: Senden Sie gescrapte Hacker News-Daten direkt an Google Sheets oder Webhooks, um Alarme auszulösen, wenn bestimmte Keywords in Diskussionen auftauchen.

No-Code Web Scraper für Hacker News

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Hacker News helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Hacker News

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Hacker News helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

url = 'https://news.ycombinator.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Stories are contained in rows with class 'athing'

posts = soup.select('.athing')

for post in posts:

title_element = post.select_one('.titleline > a')

title = title_element.text

link = title_element['href']

print(f'Title: {title}

Link: {link}

---')

except Exception as e:

print(f'Scraping failed: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Hacker News mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

url = 'https://news.ycombinator.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Stories are contained in rows with class 'athing'

posts = soup.select('.athing')

for post in posts:

title_element = post.select_one('.titleline > a')

title = title_element.text

link = title_element['href']

print(f'Title: {title}

Link: {link}

---')

except Exception as e:

print(f'Scraping failed: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://news.ycombinator.com/')

# Wait for the table to load

page.wait_for_selector('.athing')

# Extract all story titles and links

items = page.query_selector_all('.athing')

for item in items:

title_link = item.query_selector('.titleline > a')

if title_link:

print(title_link.inner_text(), title_link.get_attribute('href'))

browser.close()Python + Scrapy

import scrapy

class HackerNewsSpider(scrapy.Spider):

name = 'hn_spider'

start_urls = ['https://news.ycombinator.com/']

def parse(self, response):

for post in response.css('.athing'):

yield {

'id': post.attrib.get('id'),

'title': post.css('.titleline > a::text').get(),

'link': post.css('.titleline > a::attr(href)').get(),

}

# Follow pagination 'More' link

next_page = response.css('a.morelink::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://news.ycombinator.com/');

const results = await page.evaluate(() => {

const items = Array.from(document.querySelectorAll('.athing'));

return items.map(item => ({

title: item.querySelector('.titleline > a').innerText,

url: item.querySelector('.titleline > a').href

}));

});

console.log(results);

await browser.close();

})();Was Sie mit Hacker News-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Hacker News-Daten.

Entdeckung von Startup-Trends

Identifizieren Sie, welche Branchen oder Produkttypen am häufigsten gelauncht und diskutiert werden.

So implementieren Sie es:

- 1Scrapen Sie wöchentlich die Kategorie 'Show HN'.

- 2Bereinigen und kategorisieren Sie Startup-Beschreibungen mittels NLP.

- 3Ranken Sie Trends basierend auf Community-Upvotes und dem Sentiment der Kommentare.

Verwenden Sie Automatio, um Daten von Hacker News zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Hacker News-Daten machen können

- Entdeckung von Startup-Trends

Identifizieren Sie, welche Branchen oder Produkttypen am häufigsten gelauncht und diskutiert werden.

- Scrapen Sie wöchentlich die Kategorie 'Show HN'.

- Bereinigen und kategorisieren Sie Startup-Beschreibungen mittels NLP.

- Ranken Sie Trends basierend auf Community-Upvotes und dem Sentiment der Kommentare.

- Tech-Sourcing & Recruiting

Extrahieren Sie Stellenanzeigen und Unternehmensdetails aus spezialisierten monatlichen Recruiting-Threads.

- Überwachen Sie die ID des monatlichen 'Who is hiring'-Threads.

- Scrapen Sie alle Top-Level-Kommentare, die Jobbeschreibungen enthalten.

- Analysieren Sie den Text nach spezifischen Tech-Stacks wie Rust, AI oder React.

- Wettbewerbsanalyse

Verfolgen Sie die Erwähnung von Wettbewerbern in Kommentaren, um die öffentliche Wahrnehmung und Kritikpunkte zu verstehen.

- Richten Sie einen keyword-basierten Scraper für bestimmte Markennamen ein.

- Extrahieren Sie Nutzerkommentare und Zeitstempel für eine Sentiment-Analyse.

- Erstellen Sie wöchentliche Berichte zur Markenreputation im Vergleich zum Wettbewerb.

- Automatisierte Content-Kuration

Erstellen Sie einen hochwertigen Tech-Newsletter, der nur die relevantesten Storys enthält.

- Scrapen Sie alle 6 Stunden die Startseite.

- Filtern Sie nach Posts, die einen Schwellenwert von 200 Punkten überschreiten.

- Automatisieren Sie die Zustellung dieser Links an einen Telegram-Bot oder eine E-Mail-Liste.

- Venture Capital Lead-Generierung

Entdecken Sie Startups in der Frühphase, die ein signifikantes Interesse in der Community wecken.

- Verfolgen Sie 'Show HN'-Posts, die es auf die Startseite schaffen.

- Überwachen Sie die Wachstumsrate der Upvotes in den ersten 4 Stunden.

- Benachrichtigen Sie Analysten, wenn ein Post virale Wachstumsmuster zeigt.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Hacker News

Expertentipps für die erfolgreiche Datenextraktion von Hacker News.

Die offizielle API nutzen

Verwenden Sie für große Datenmengen die offizielle Firebase API, die effizienter und zuverlässiger ist als das Parsen der veralteten HTML-Struktur.

Robots.txt beachten

Prüfen Sie stets die robots.txt der Website und planen Sie eine Crawl-Verzögerung von mindestens 30 Sekunden ein, um eine dauerhafte Sperrung durch den Server zu vermeiden.

Eindeutige Element-IDs anvisieren

Jeder Beitrag und jeder Kommentar hat im HTML eine eindeutige numerische ID; nutzen Sie diese als Primärschlüssel in Ihrer Datenbank, um Dubletten zu vermeiden.

User Agents rotieren

Ändern Sie Ihre Browser-Header regelmäßig, um zu verhindern, dass der Server Ihren Traffic als automatisierte Bot-Aktivität identifiziert.

Die Algolia Search API verwenden

Für historische Daten oder komplexe Stichwortsuchen ist die von der Community gepflegte Algolia HN API deutlich schneller und flexibler.

Rekursives Parsen von Kommentaren

Achten Sie beim Scrapen von Kommentaren auf die 'indent'-Breite im HTML, um die Verschachtelungstiefe der Diskussion programmatisch zu bestimmen.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

Häufig gestellte Fragen zu Hacker News

Finden Sie Antworten auf häufige Fragen zu Hacker News