Open Collective scrapen: Ein Leitfaden für Finanz- und Mitwirkendendaten

Erfahren Sie, wie Sie Open Collective nach Finanztransaktionen, Listen von Mitwirkenden und Projektdaten scrapen. Gewinnen Sie transparente Einblicke für Ihre...

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- WAF

Über Open Collective

Entdecken Sie, was Open Collective bietet und welche wertvollen Daten extrahiert werden können.

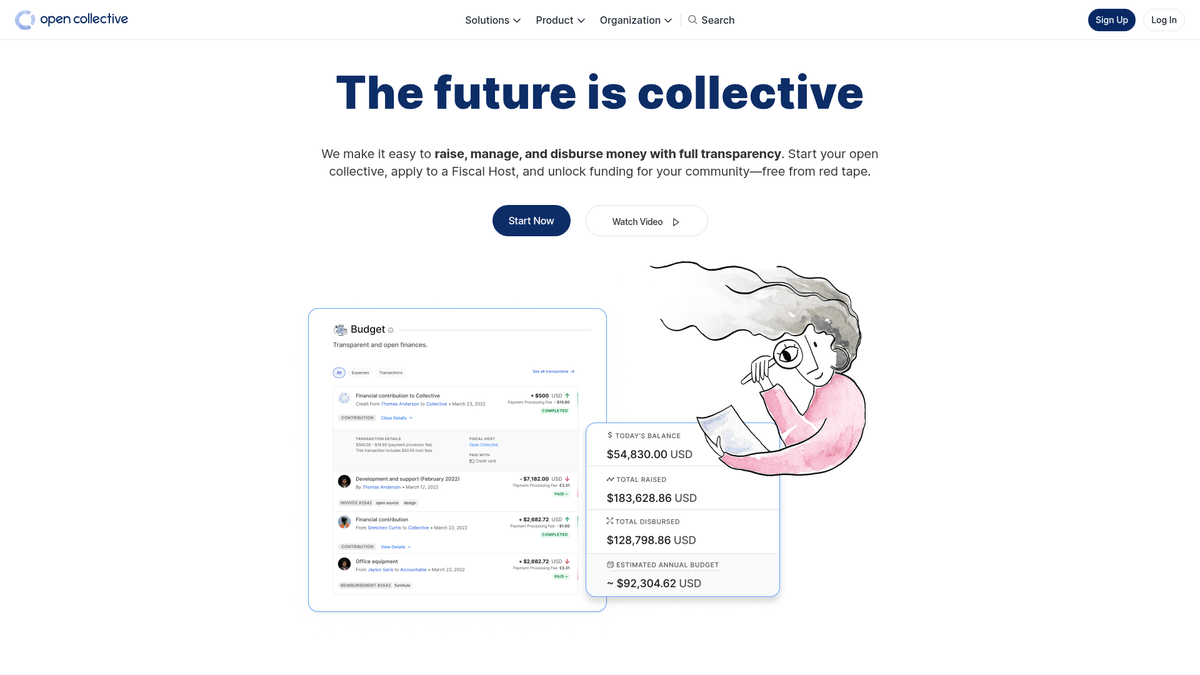

Über Open Collective

Open Collective ist eine einzigartige finanzielle und rechtliche Plattform, die darauf ausgelegt ist, Transparenz für gemeinschaftlich geführte Organisationen, open-source Softwareprojekte und Nachbarschaftsvereine zu schaffen. Als dezentrales Finanzierungstool ermöglicht es 'Collectives', Geld zu sammeln und Ausgaben zu verwalten, ohne dass eine formelle juristische Person erforderlich ist, wobei oft fiskalische Hosts für die administrative Unterstützung genutzt werden. Große Tech-Projekte wie Babel und Webpack verlassen sich auf diese Plattform, um ihre gemeinschaftsfinanzierten Ökosysteme zu verwalten.

Die Plattform ist bekannt für ihre radikale Transparenz. Jede Transaktion, ob eine Spende eines großen Unternehmens oder eine kleine Ausgabe für ein Community-Meetup, wird protokolliert und ist öffentlich einsehbar. Dies bietet eine Fülle von Daten über die finanzielle Gesundheit und die Ausgabengewohnheiten einiger der weltweit kritischsten open-source Abhängigkeiten.

Das Scraping von Open Collective ist äußerst wertvoll für Organisationen, die Marktforschung zur open-source Ökonomie betreiben möchten. Es ermöglicht Benutzern, Leads für Sponsoring zu identifizieren, Trends bei der Entwicklerfinanzierung zu verfolgen und die finanzielle Nachhaltigkeit kritischer Softwareprojekte zu prüfen. Die Daten dienen als direktes Fenster in den Kapitalfluss innerhalb der globalen Entwickler-Community.

Warum Open Collective Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Open Collective.

Analyse der Nachhaltigkeit von Open-Source

Verfolgen Sie die finanzielle Gesundheit und langfristige Lebensfähigkeit kritischer technologischer Infrastrukturprojekte wie Webpack, Babel und Logseq.

Akquise von Sponsoren

Identifizieren Sie Organisationen, die bereits Open-Source-Software sponsern, um eine gezielte Liste potenzieller Leads für Ihre eigenen Initiativen zu erstellen.

Audits zur Finanztransparenz

Überwachen Sie, wie dezentrale Gruppen und Gemeinschaftskollektive ihre Mittel zuweisen, um die Rechenschaftspflicht gegenüber Spendern und Stakeholdern sicherzustellen.

Markttrend-Analyse

Evaluieren Sie, welche Kategorien – wie Technologie, Umweltaktivismus oder Bildung – das höchste Wachstum bei der Community-Finanzierung verzeichnen.

Recherche zu Mitwirkenden & Influencern

Entdecken Sie die wichtigsten individuellen und unternehmerischen Mitwirkenden in bestimmten Nischen, um Key-Influencer für Outreach oder Recruiting zu finden.

Impact-Tracking von Fördermitteln

Aggregieren Sie Daten darüber, wie große Fördermittel auf mehrere Projekte verteilt werden, um die realen Auswirkungen philanthropischer Ausgaben zu messen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Open Collective.

JavaScript-intensives Rendering

Open Collective ist als moderne Web-Applikation konzipiert, die eine vollständige JavaScript-Ausführung erfordert, um Finanzbücher und Listen von Mitwirkenden zu rendern.

Komplexe GraphQL-Architektur

Die Website ruft Daten über tief verschachtelte GraphQL-Abfragen ab, was herkömmliches HTML-Parsing weniger effizient macht als die Überwachung von API-Antworten.

Dynamische Lademuster

Transaktionshistorien und Mitgliederlisten nutzen oft Infinite Scroll oder 'Mehr laden'-Buttons, die eine ereignisgesteuerte Automatisierung für eine vollständige Extraktion erfordern.

Cloudflare & Rate Limiting

Hochfrequentes Scraping kann die Web Application Firewall (WAF) von Cloudflare auslösen oder aufgrund strenger globaler Rate-Limits zu temporären IP-Sperren führen.

Verschachtelte Datenstrukturen

Informationen über fiskalische Hosts, Collectives und Ausgaben sind über verschiedene Seitenebenen verteilt, was eine komplexe mehrstufige Navigation erfordert.

Scrape Open Collective mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Open Collective extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Open Collective, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Open Collective zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Open Collective extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Open Collective, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Visuelle Datenextraktion: Extrahieren Sie komplexe Finanzdatensätze und Tabellen von Mitwirkenden über eine Point-and-Click-Oberfläche, ohne GraphQL-Abfragelogik schreiben zu müssen.

- Intelligente Handhabung der Paginierung: Verarbeiten Sie automatisch Infinite Scroll oder 'Mehr laden'-Buttons, um sicherzustellen, dass jede einzelne Ausgabe oder Spende aus dem Kassenbuch erfasst wird.

- Automatisierte Monitoring-Zeitpläne: Richten Sie einen wiederkehrenden Bot ein, um Daten alle 24 Stunden zu scrapen. So stellen Sie sicher, dass Sie immer über die aktuellsten Salden und Transaktionsdaten verfügen.

- Anti-Bot-Maßnahmen umgehen: Nutzen Sie die integrierte IP-Rotation und Funktionen für menschenähnliche Interaktionen, um beim Scraping in großem Stil nicht von Cloudflare blockiert zu werden.

- Direkter JSON/CSV-Export: Transformieren Sie rohe Webdaten sofort in strukturierte Formate, die für die Analyse in Google Sheets, Excel oder internen Datenbanken bereit sind.

No-Code Web Scraper für Open Collective

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Open Collective helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Open Collective

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Open Collective helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

# Der Open Collective GraphQL Endpunkt

url = 'https://api.opencollective.com/graphql/v2'

# GraphQL Abfrage für Basisinfos über ein Collective

query = '''

query {

collective(slug: "webpack") {

name

stats {

totalAmountReceived { value }

balance { value }

}

}

}

'''

headers = {'Content-Type': 'application/json'}

try:

# Senden der POST-Anfrage an die API

response = requests.post(url, json={'query': query}, headers=headers)

response.raise_for_status()

data = response.json()

# Extrahieren und Ausgeben von Name und Saldo

collective = data['data']['collective']

print(f"Name: {collective['name']}")

print(f"Saldo: {collective['stats']['balance']['value']}")

except Exception as e:

print(f"Ein Fehler ist aufgetreten: {e}")Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Open Collective mit Code scrapt

Python + Requests

import requests

# Der Open Collective GraphQL Endpunkt

url = 'https://api.opencollective.com/graphql/v2'

# GraphQL Abfrage für Basisinfos über ein Collective

query = '''

query {

collective(slug: "webpack") {

name

stats {

totalAmountReceived { value }

balance { value }

}

}

}

'''

headers = {'Content-Type': 'application/json'}

try:

# Senden der POST-Anfrage an die API

response = requests.post(url, json={'query': query}, headers=headers)

response.raise_for_status()

data = response.json()

# Extrahieren und Ausgeben von Name und Saldo

collective = data['data']['collective']

print(f"Name: {collective['name']}")

print(f"Saldo: {collective['stats']['balance']['value']}")

except Exception as e:

print(f"Ein Fehler ist aufgetreten: {e}")Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_opencollective():

with sync_playwright() as p:

# Browser mit JS-Unterstützung starten

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://opencollective.com/discover')

# Warten, bis Collective-Cards geladen sind

page.wait_for_selector('.CollectiveCard')

# Daten aus dem DOM extrahieren

collectives = page.query_selector_all('.CollectiveCard')

for c in collectives:

name = c.query_selector('h2').inner_text()

print(f'Projekt gefunden: {name}')

browser.close()

scrape_opencollective()Python + Scrapy

import scrapy

import json

class OpenCollectiveSpider(scrapy.Spider):

name = 'opencollective'

start_urls = ['https://opencollective.com/webpack']

def parse(self, response):

# Open Collective nutzt Next.js; Daten befinden sich oft in einem Script-Tag

next_data = response.xpath('//script[@id="__NEXT_DATA__"]/text()').get()

if next_data:

parsed_data = json.loads(next_data)

collective = parsed_data['props']['pageProps']['collective']

yield {

'name': collective.get('name'),

'balance': collective.get('stats', {}).get('balance'),

'currency': collective.get('currency')

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://opencollective.com/discover');

// Warten, bis der dynamische Inhalt geladen ist

await page.waitForSelector('.CollectiveCard');

// Über Elemente iterieren, um Namen zu extrahieren

const data = await page.evaluate(() => {

return Array.from(document.querySelectorAll('.CollectiveCard')).map(el => ({

name: el.querySelector('h2').innerText

}));

});

console.log(data);

await browser.close();

})();Was Sie mit Open Collective-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Open Collective-Daten.

Open Source Wachstumsprognose

Identifizieren Sie Trendtechnologien, indem Sie die finanziellen Wachstumsraten spezifischer Collective-Kategorien verfolgen.

So implementieren Sie es:

- 1Monatliche Einnahmen für Top-Projekte in spezifischen Tags extrahieren

- 2Jährliche Wachstumsraten (CAGR) berechnen

- 3Finanzielle Gesundheit von Projekten visualisieren, um Technologie-Adoption vorherzusagen

Verwenden Sie Automatio, um Daten von Open Collective zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Open Collective-Daten machen können

- Open Source Wachstumsprognose

Identifizieren Sie Trendtechnologien, indem Sie die finanziellen Wachstumsraten spezifischer Collective-Kategorien verfolgen.

- Monatliche Einnahmen für Top-Projekte in spezifischen Tags extrahieren

- Jährliche Wachstumsraten (CAGR) berechnen

- Finanzielle Gesundheit von Projekten visualisieren, um Technologie-Adoption vorherzusagen

- Lead-Generierung für SaaS

Identifizieren Sie gut finanzierte Projekte, die möglicherweise Entwickler-Tools, Hosting oder professionelle Dienstleistungen benötigen.

- Collectives nach Budget und Gesamtsumme der gesammelten Mittel filtern

- Projektbeschreibungen und externe Website-URLs extrahieren

- Tech-Stack über verknüpfte GitHub-Repositories verifizieren

- Audit von Unternehmens-Philanthropie

Verfolgen Sie, wofür große Unternehmen ihre Budgets für open-source Beiträge ausgeben.

- Mitwirkendenlisten für Top-Projekte scrapen

- Nach Organisationsprofilen vs. Einzelprofilen filtern

- Beitragssummen nach Unternehmenseinheit aggregieren

- Forschung zur gesellschaftlichen Wirkung

Analysieren Sie, wie dezentrale Gruppen ihre Mittel verteilen, um die soziale Wirkung zu verstehen.

- Vollständiges Transaktionsbuch für ein spezifisches Collective scrapen

- Ausgaben kategorisieren (Reisen, Gehälter, Hardware)

- Berichte über die Ressourcenallokation innerhalb von Community-Gruppen erstellen

- Pipeline für die Entwickler-Rekrutierung

Finden Sie aktive Köpfe in spezifischen Ökosystemen basierend auf ihrem Community-Management und ihrer Beitragshistorie.

- Mitgliederlisten wichtiger technischer Collectives scrapen

- Mitwirkende mit ihren öffentlichen sozialen Profilen abgleichen

- Aktive Maintainer für gezielte Kontaktaufnahme identifizieren

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Open Collective

Expertentipps für die erfolgreiche Datenextraktion von Open Collective.

Extraktion über URL-Slugs

Der einfachste Weg, bestimmte Collectives anzusprechen, besteht darin, ihre eindeutigen URL-Slugs zu verwenden, die auf der Haupt-Entdeckungsseite gesammelt werden können.

Auf __NEXT_DATA__ prüfen

Der Quelltext der Seite enthält oft ein Script-Tag mit der ID __NEXT_DATA__, das vorgerendertes JSON enthält. Dies kann schneller sein als das Scraping des UI.

'data-cy'-Selektoren verwenden

Nutzen Sie die 'data-cy'-Attribute in Ihren Selektoren, da es sich hierbei um Test-IDs handelt, die auch dann stabil bleiben, wenn sich CSS-Klassen bei Website-Updates ändern.

XHR-Anfragen überwachen

Verwenden Sie die Browser-Entwicklertools, um die direkten GraphQL-Endpunkt-Aufrufe zu finden, da diese die sauberste Datenstruktur für Finanztransaktionen bieten.

Zufällige Verzögerungen implementieren

Fügen Sie randomisierte Wartezeiten zwischen 2 und 6 Sekunden hinzu, um natürliches Browsing-Verhalten zu imitieren und unter dem Radar der automatisierten Bot-Erkennung zu bleiben.

Offizielle Dokumentation nutzen

Prüfen Sie die GraphQL-API-Dokumentation von Open Collective, um die Namenskonventionen für die verschiedenen Finanzdatenfelder zu verstehen.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Moon.ly | Step-by-Step NFT Data Extraction Guide

How to Scrape Yahoo Finance: Extract Stock Market Data

How to Scrape Rocket Mortgage: A Comprehensive Guide

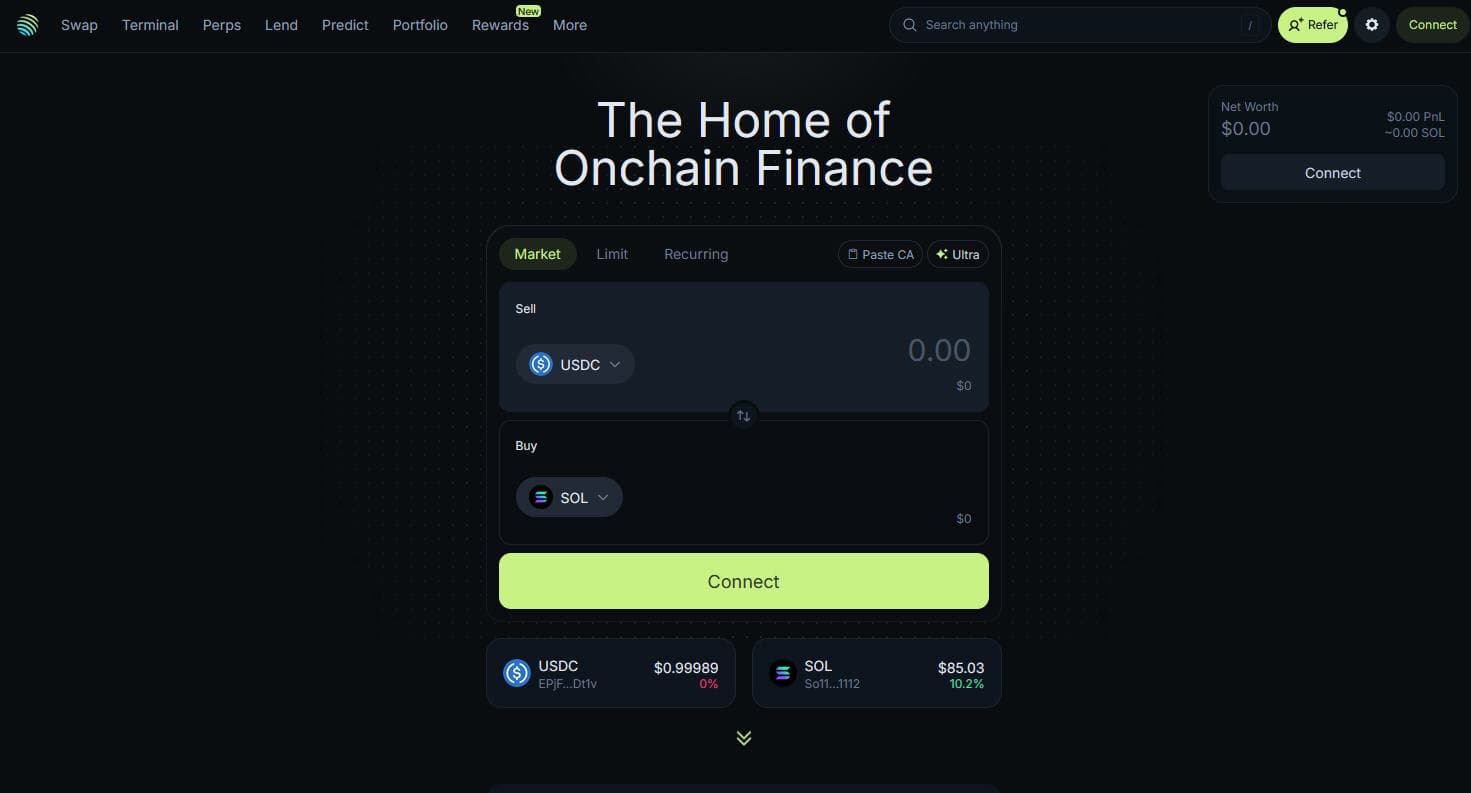

How to Scrape jup.ag: Jupiter DEX Web Scraper Guide

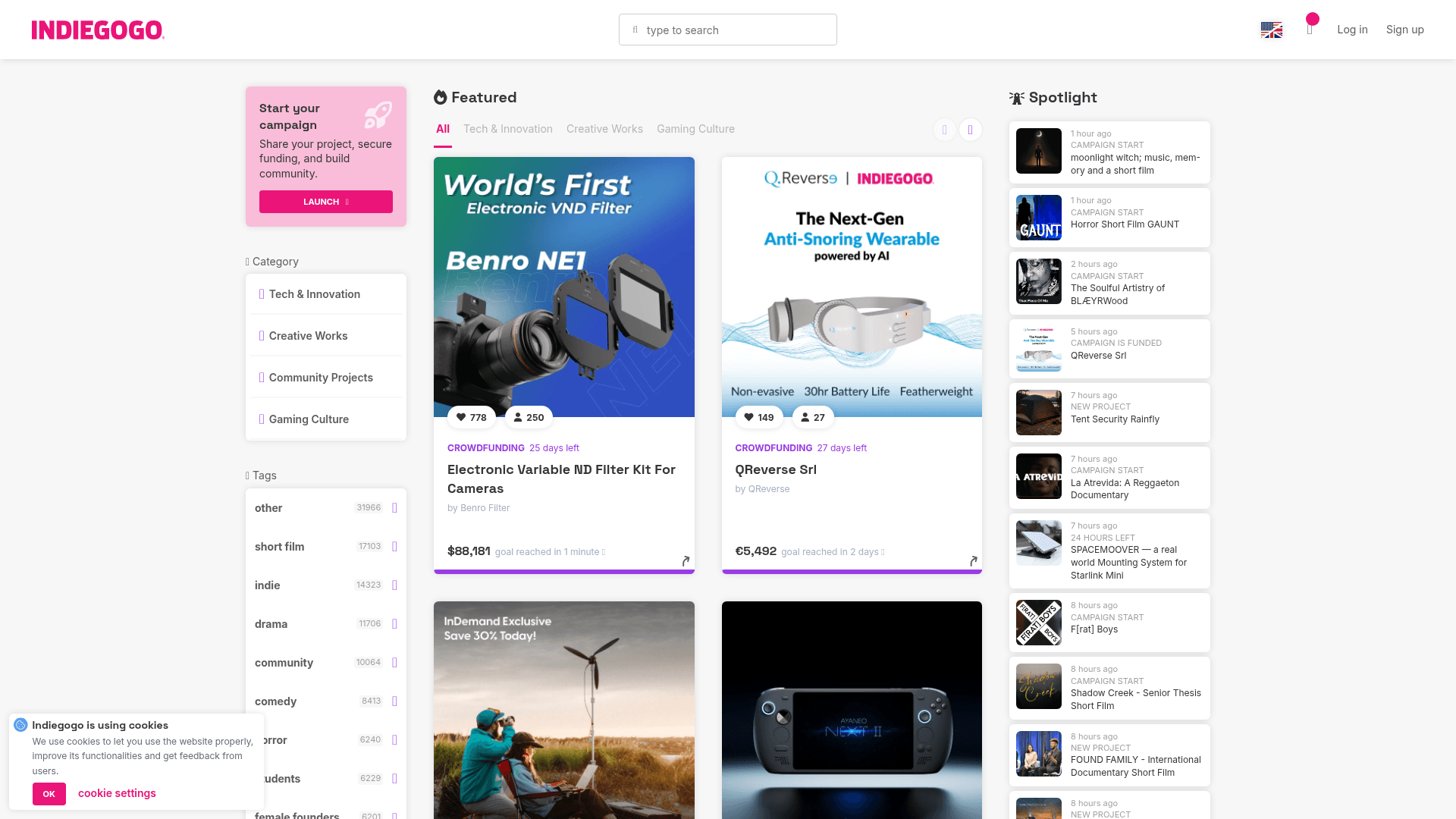

How to Scrape Indiegogo: The Ultimate Crowdfunding Data Extraction Guide

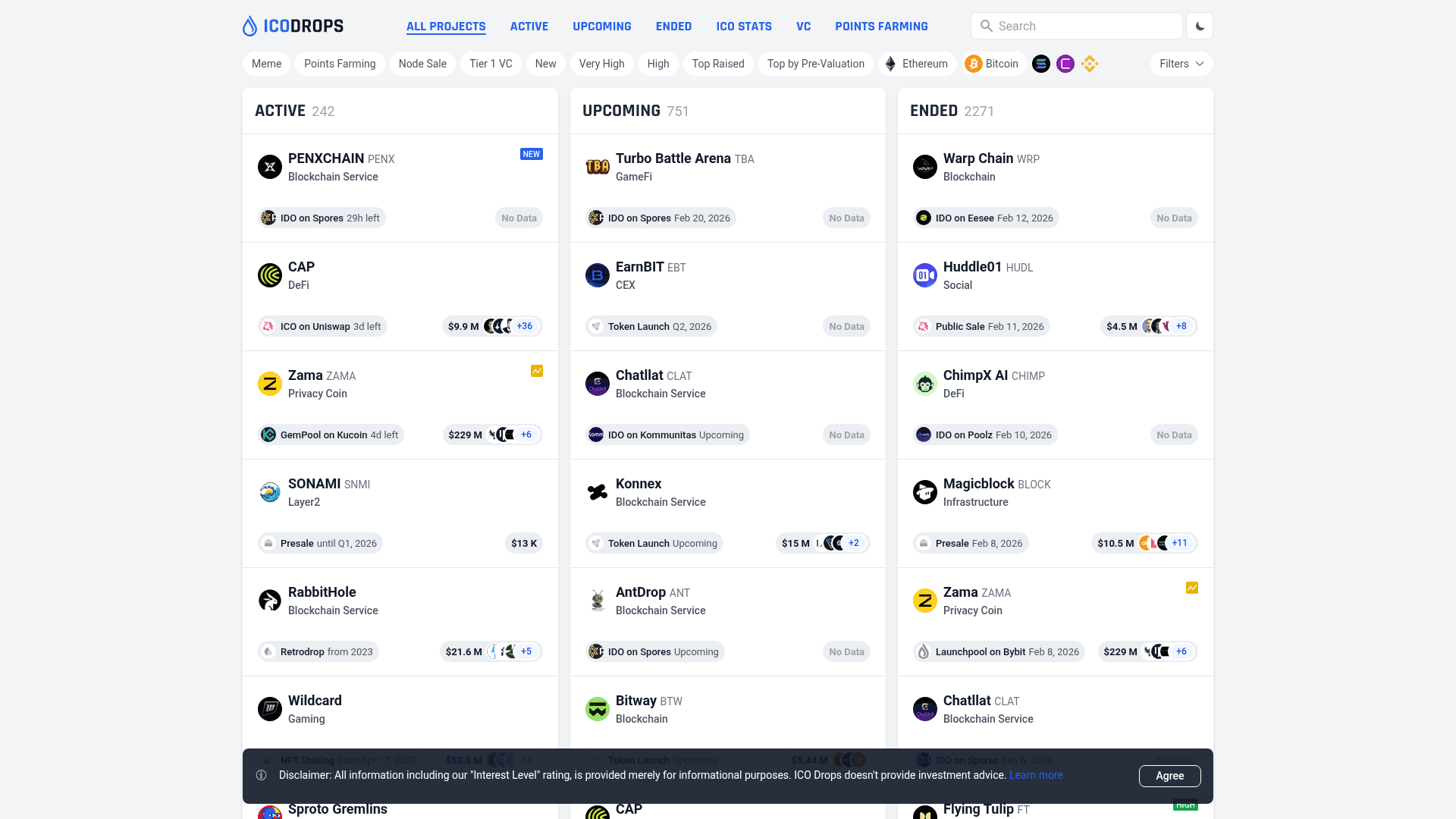

How to Scrape ICO Drops: Comprehensive Crypto Data Guide

How to Scrape Crypto.com: Comprehensive Market Data Guide

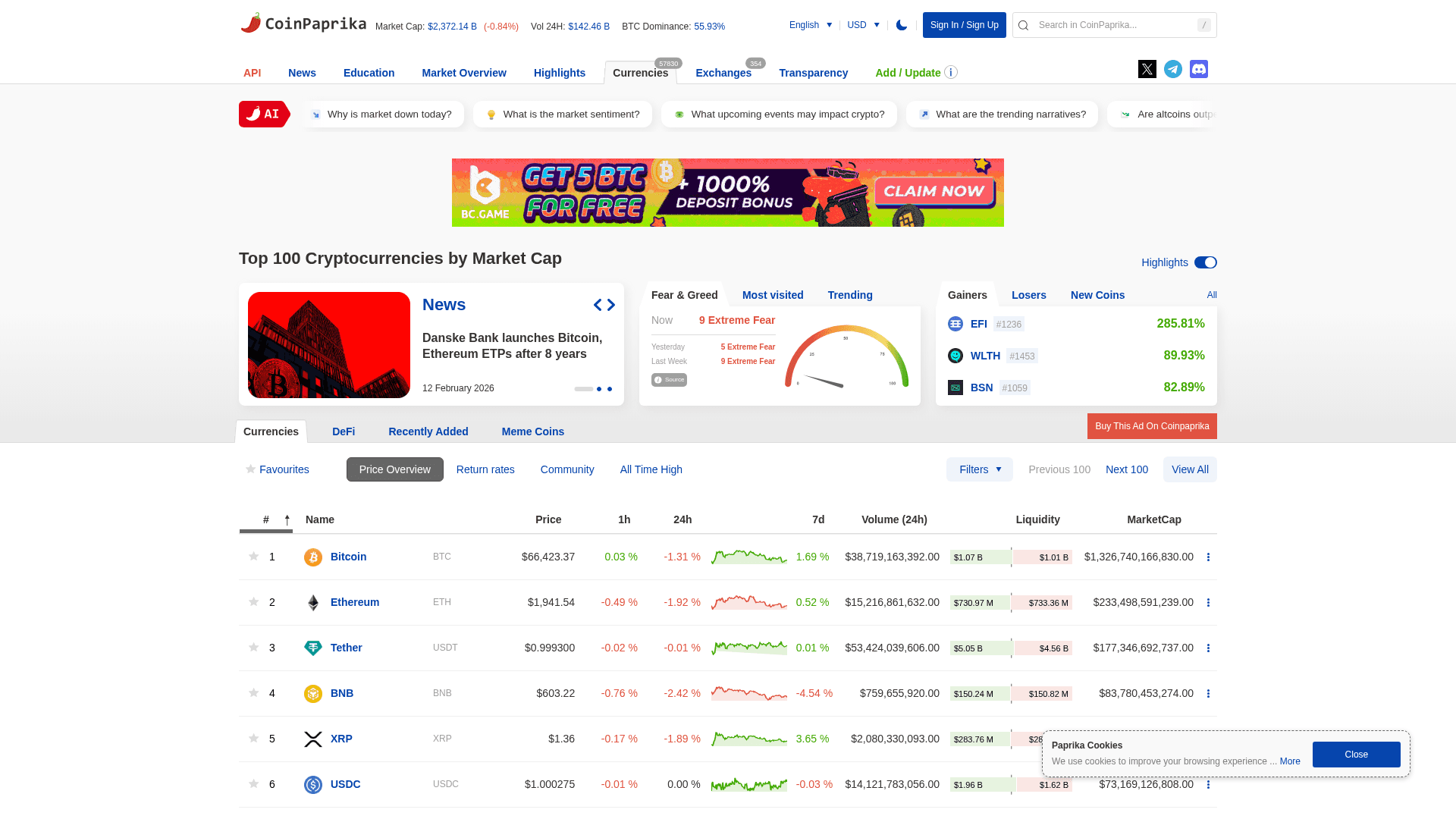

How to Scrape Coinpaprika: Crypto Market Data Extraction Guide

Häufig gestellte Fragen zu Open Collective

Finden Sie Antworten auf häufige Fragen zu Open Collective