Wie man pump.fun scrapt: Ein technischer Leitfaden für Echtzeit-Solana-Daten

Erfahren Sie, wie Sie pump.fun für Echtzeit-Solana-token-Launches, Market-Caps und Bonding-Curve-Daten scrapen. Erstellen Sie Hochfrequenz-Trading-Bots und...

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- Browser-Fingerprinting

- Identifiziert Bots anhand von Browser-Eigenschaften: Canvas, WebGL, Schriftarten, Plugins. Erfordert Spoofing oder echte Browser-Profile.

- WebSockets

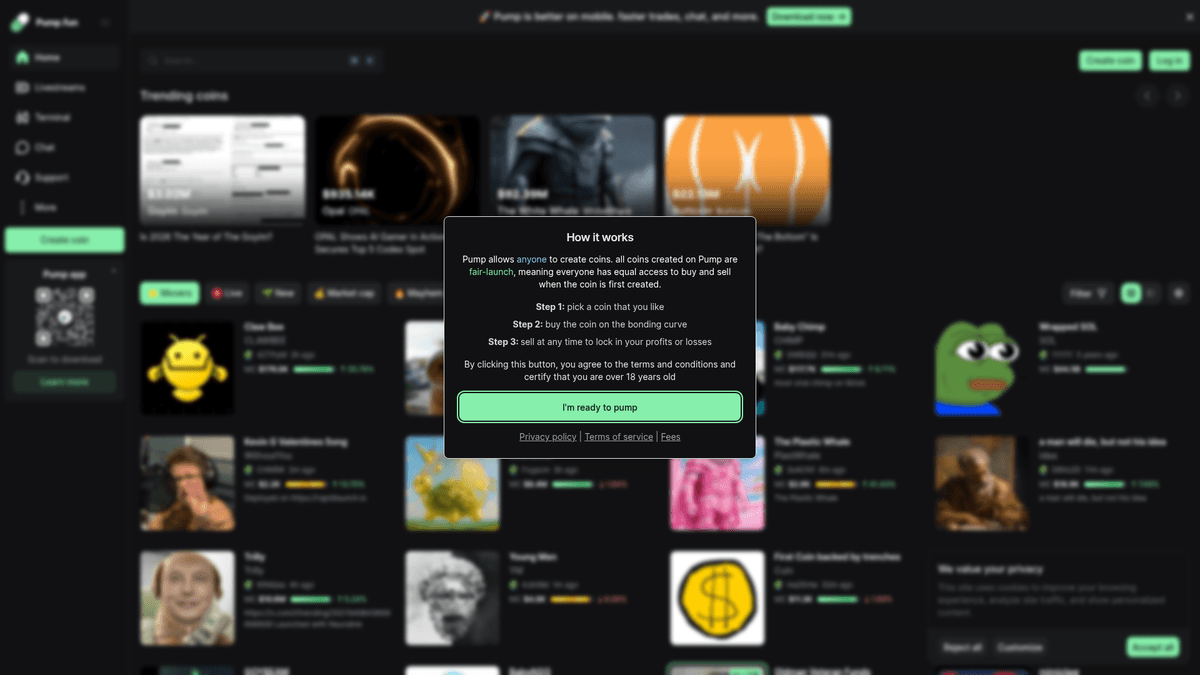

Über pump.fun

Entdecken Sie, was pump.fun bietet und welche wertvollen Daten extrahiert werden können.

Das Epizentrum der Solana-Meme-Coins

pump.fun ist eine DeFi-Plattform auf der Solana-Blockchain, die es Nutzern ermöglicht, Meme-Coins sofort zu launchen, ohne initiale Liquidität bereitzustellen. Sie nutzt einen einzigartigen 'bonding curve'-Mechanismus, bei dem der Preis steigt, je mehr Leute kaufen, bis der token schließlich zu einer großen dezentralen Exchange wie Raydium migriert, sobald eine bestimmte Marktkapitalisierung erreicht ist. Die Plattform ist zum Zentrum des Solana-Meme-Coin-Ökosystems geworden und hostet täglich Tausende neuer token-Launches.

Hochdynamische token-Daten

Die Website bietet einen Echtzeit-Feed neu erstellter tokens, deren Marktkapitalisierung, den Fortschritt der bonding curve und eine detaillierte Transaktionshistorie. Sie enthält auch soziale Links (Twitter/Telegram), Wallet-Adressen der Ersteller und Live-Chat-Protokolle für jeden token. Da alle paar Sekunden neue Projekte gestartet werden, ist die Seite eine hochdynamische Datenquelle, die spezialisierte Scraping-Techniken erfordert, um sie effektiv zu überwachen.

Warum diese Daten entscheidend sind

Das Scrapen von pump.fun ist extrem wertvoll für Krypto-Trader und Entwickler, die Sniping-Bots, Sentiment-Analyse-Tools oder Rug-Pull-Erkennungsdienste entwickeln. Durch das Extrahieren von token-Metadaten und Inhaber-Verhalten in Echtzeit können Nutzer Projekte mit hohem Momentum identifizieren, bevor sie die Mainstream-Exchanges erreichen, und ihren Markteintritt automatisieren. Angesichts der hohen Einsätze beim Meme-Coin-Trading stellt ein automatisierter Datenvorsprung einen erheblichen Wettbewerbsvorteil dar.

Warum pump.fun Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von pump.fun.

Echtzeit-token-Sniping

Das Extrahieren neu erstellter tokens im Moment ihres Erscheinens ermöglicht Tradern einen frühen Einstiegsvorteil, bevor der Massenmarkt den Launch entdeckt.

Bewertung der Entwickler-Glaubwürdigkeit

Durch das Scraping von Ersteller-Wallet-Adressen und deren historischer Launch-Performance können Sie Muster von Serien-Betrügern erkennen oder hochwertige 'Fair-Launch'-Entwickler finden.

Vorhersage der Liquiditätsmigration

Die Überwachung des Fortschritts der Bonding-Curve in Echtzeit hilft dabei, genau vorherzusagen, wann ein token zu Raydium migriert, was ein strategisches Positionsmanagement ermöglicht.

Erkennung von Whale-Bewegungen

Das Tracking großer Wallet-Einstiege in spezifische Bonding-Curves ermöglicht es Ihnen, dem 'Smart Money' zu folgen und zu identifizieren, welche Memecoins von institutionellen Akteuren akkumuliert werden.

Extraktion des Social-Sentiments

Das Scraping der Live-Kommentarbereiche und Social-Media-Links (X, Telegram) liefert Rohdaten für die Sentiment-Analyse, um den Community-Hype und Social-Proof zu messen.

Verfolgung von Markt-Narrativen

Die Aggregation von Tickern und Beschreibungen über tausende tägliche Launches hinweg hilft dabei, aufkommende Trends wie AI-agents, politische Memes oder spezifische Tier-Narrative zu identifizieren.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von pump.fun.

Fortgeschrittene Cloudflare-WAF

Die Website nutzt aggressiven Cloudflare-Schutz, einschließlich JS-Challenges und TLS-Fingerprinting, was Standard-Automatisierungsbibliotheken häufig mit 403-Forbidden-Fehlern blockiert.

WebSocket-Abhängigkeit

Die kritischsten Daten, wie Live-Preis-Updates und neue token-Events, werden über WebSockets statt über statisches HTML übertragen. Dies erfordert einen Scraper, der Socket-Frames abfangen und dekodieren kann.

Hochgeschwindigkeits-Datenstrom

Da jede Minute dutzende Coins gelauncht werden, muss der Scraper hochgradig auf niedrige Latency optimiert sein; selbst eine Verzögerung von fünf Sekunden kann dazu führen, dass die profitabelsten Einstiegspunkte verpasst werden.

Hochdynamisches DOM

Die Anwendung basiert auf Next.js mit häufigen Status-Updates, die ein Re-Rendering von Elementen verursachen. Dies macht traditionelle CSS-Selektoren instabil und anfällig für Fehler während einer Session.

Scrape pump.fun mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von pump.fun extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert pump.fun, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, pump.fun zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von pump.fun extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert pump.fun, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Automatischer Anti-Bot-Bypass: Automatio übernimmt komplexes Browser-Fingerprinting und Cloudflare-Challenges standardmäßig und stellt sicher, dass Ihr Scraper ohne manuelle Konfiguration unerkannt bleibt.

- Visuelles Data-Mapping: Verknüpfen Sie Datenpunkte wie Fortschrittsbalken der Bonding-Curve und Ersteller-Wallets ganz einfach über ein visuelles Interface, selbst wenn die zugrunde liegenden HTML-Klassen dynamisch sind.

- Echtzeit-Webhook-Trigger: Verbinden Sie Ihre gescrapten Daten über sofortige Webhooks direkt mit externen Trading-Scripts oder Telegram-Alert-Bots, sobald ein neuer token Ihre spezifischen Kriterien erfüllt.

- Cloud-basierte 24/7-Verfügbarkeit: Lassen Sie Ihre Monitore auf der Cloud-Infrastruktur von Automatio laufen, um sicherzustellen, dass Sie niemals einen Launch um Mitternacht oder einen plötzlichen 'King of the Hill'-Ausbruch verpassen, während Sie offline sind.

- Stabilität des Headless-Browsers: Automatio verwaltet die hohen Anforderungen an das JavaScript-Rendering der Pump.fun-Plattform fachgerecht und verhindert Memory-Leaks sowie Abstürze, die in DIY-Setups häufig vorkommen.

No-Code Web Scraper für pump.fun

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von pump.fun helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für pump.fun

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von pump.fun helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

import json

# Hinweis: pump.fun nutzt Cloudflare. Dieser Ansatz zielt auf den initialen State-Blob ab.

url = 'https://pump.fun/board'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36'

}

try:

session = requests.Session()

response = session.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Extraktion des Next.js Daten-Blobs mit den initialen Tokens

next_data = soup.find('script', id='__NEXT_DATA__')

if next_data:

data = json.loads(next_data.string)

print('Initial-Token-Daten erfolgreich extrahiert.')

else:

print('Dynamischer Inhalt im statischen HTML nicht gefunden.')

else:

print(f'Von Cloudflare blockiert? Status: {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man pump.fun mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

import json

# Hinweis: pump.fun nutzt Cloudflare. Dieser Ansatz zielt auf den initialen State-Blob ab.

url = 'https://pump.fun/board'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36'

}

try:

session = requests.Session()

response = session.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Extraktion des Next.js Daten-Blobs mit den initialen Tokens

next_data = soup.find('script', id='__NEXT_DATA__')

if next_data:

data = json.loads(next_data.string)

print('Initial-Token-Daten erfolgreich extrahiert.')

else:

print('Dynamischer Inhalt im statischen HTML nicht gefunden.')

else:

print(f'Von Cloudflare blockiert? Status: {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def scrape_pump_fun():

async with async_playwright() as p:

# Start mit Stealth-Einstellungen wird empfohlen

browser = await p.chromium.launch(headless=True)

context = await browser.new_context(

user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36'

)

page = await context.new_page()

# Navigieren und warten, bis JS das Token-Board gerendert hat

await page.goto('https://pump.fun/board', wait_until='networkidle')

await page.wait_for_selector('.token-card')

tokens = await page.query_selector_all('.token-card')

for token in tokens[:5]:

name = await (await token.query_selector('.name')).inner_text()

mcap = await (await token.query_selector('.market-cap')).inner_text()

print(f'Token: {name} | MCAP: {mcap}')

await browser.close()

asyncio.run(scrape_pump_fun())Python + Scrapy

import scrapy

from scrapy_playwright.page import PageMethod

class PumpFunSpider(scrapy.Spider):

name = 'pump_spider'

def start_requests(self):

yield scrapy.Request(

url='https://pump.fun/board',

meta={

'playwright': True,

'playwright_page_methods': [

PageMethod('wait_for_selector', '.token-card')

]

}

)

def parse(self, response):

for token in response.css('.token-card'):

yield {

'name': token.css('.token-name::text').get(),

'ticker': token.css('.ticker::text').get(),

'mcap': token.css('.mcap-value::text').get(),

}Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

await page.goto('https://pump.fun/board', { waitUntil: 'networkidle2' });

// Warten auf das dynamische Laden der Token-Cards

await page.waitForSelector('.token-card');

const data = await page.evaluate(() => {

const cards = Array.from(document.querySelectorAll('.token-card'));

return cards.map(card => ({

name: card.querySelector('.name')?.innerText,

ticker: card.querySelector('.symbol')?.innerText,

mcap: card.querySelector('.market-cap')?.innerText

}));

});

console.log(data);

await browser.close();

})();Was Sie mit pump.fun-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus pump.fun-Daten.

Echtzeit-Meme-Coin-Sniper

Identifizieren und kaufen Sie vielversprechende neue tokens in der Sekunde, in der sie auf der Plattform gelauncht werden.

So implementieren Sie es:

- 1Einrichten eines WebSocket-Scrapers, um auf 'coinCreated'-Events zu hören.

- 2Filter für soziale Links und Reputation der Ersteller anwenden.

- 3Kauftransaktion über Solana web3.js auslösen.

- 4Fortschritt der bonding curve für die Exit-Strategie überwachen.

Verwenden Sie Automatio, um Daten von pump.fun zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit pump.fun-Daten machen können

- Echtzeit-Meme-Coin-Sniper

Identifizieren und kaufen Sie vielversprechende neue tokens in der Sekunde, in der sie auf der Plattform gelauncht werden.

- Einrichten eines WebSocket-Scrapers, um auf 'coinCreated'-Events zu hören.

- Filter für soziale Links und Reputation der Ersteller anwenden.

- Kauftransaktion über Solana web3.js auslösen.

- Fortschritt der bonding curve für die Exit-Strategie überwachen.

- Rug-Pull-Erkennungs-Dashboard

Erstellen Sie einen Dienst, der Trader basierend auf der Historie der Entwickler vor potenziellen Scams warnt.

- Scrapen der Ersteller-Wallet-Adresse für jeden neuen Launch.

- Abfrage historischer Daten, um die Lebensdauer ihrer vorherigen tokens zu sehen.

- Identifizieren von 'gebündelten' Launches, bei denen ein Entwickler mehrere initiale Wallets kontrolliert.

- Benachrichtigung der Nutzer über Telegram oder Discord UI.

- Sentiment-basierte Trendanalyse

Visualisieren Sie, welche Themen (z. B. AI, Katzen, Politik) derzeit das Solana-Ökosystem dominieren.

- Scrapen von token-Namen und Beschreibungen aus dem 'New'-Feed.

- Einsatz von Natural Language Processing zur Kategorisierung von Themen.

- Zählen der Häufigkeit jeder Kategorie über ein rollierendes 24-Stunden-Fenster.

- Trends auf einem Dashboard für die Marktforschung darstellen.

- Whale-Movement-Tracker

Überwachen Sie, welche tokens von vermögenden Wallet-Adressen akkumuliert werden.

- Scrapen der detaillierten Trade-Historie für trendende tokens.

- Identifizieren wiederkehrender Wallet-Adressen mit großen Kaufvolumina.

- Einrichten von Alerts, wenn diese 'Whales' in einen neuen token-Launch einsteigen.

- Aggregieren von Kauf-/Verkaufsverhältnissen zur Bestimmung der Marktstärke.

- Bonding Curve Arbitrage

Sagen Sie voraus, wann ein token zu Raydium wechselt, um von Liquiditätsänderungen zu profitieren.

- Echtzeit-Scraping des Prozentsatzes für den 'Bonding Curve Progress'.

- Berechnung der Wachstumsrate in 5-Minuten-Intervallen.

- Identifizieren von tokens, die sich der 100%-Schwelle nähern.

- Automatisierter Einstieg, bevor die Raydium-Migration erfolgt.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von pump.fun

Expertentipps für die erfolgreiche Datenextraktion von pump.fun.

Initialen Status-Datensatz abfangen

Anstatt auf das Laden der Benutzeroberfläche zu warten, extrahieren Sie das '__NEXT_DATA__'-JSON-Script-Tag aus dem Quellcode, um einen schnelleren, strukturierten Snapshot des aktuellen token-Boards zu erhalten.

WebSocket-Frames abhören

Zielen Sie auf die 'coinCreated'- und 'trade'-Events im WebSocket-Stream ab, um Daten-Updates Millisekunden vor der visuellen Darstellung im Frontend zu erhalten.

Nach Social-Metadaten filtern

Programmieren Sie Ihren Scraper so, dass er tokens mit gültigen X- und Telegram-Links priorisiert, da diese Projekte statistisch gesehen eine höhere Chance haben, die initiale Bonding-Curve zu überstehen.

Hochgeschwindigkeits-Residential-Proxies nutzen

Rotieren Sie hochwertige Residential-IPs, um Rate-Limits zu vermeiden, insbesondere wenn Sie hunderte einzelner token-Seiten gleichzeitig auf Preisbewegungen überwachen.

Den 'King of the Hill' überwachen

Richten Sie eine spezifische Scraper-Instanz für den 'King of the Hill'-Slot ein, da tokens, die diese Position erreichen, oft einen massiven Anstieg der Volatilität und des Volumens erfahren.

Wallet-Historie des Erstellers verifizieren

Gleichen Sie die Wallet-Adresse des Erstellers über Ihren Scraper mit On-Chain-Explorern ab, um automatisch Entwickler zu markieren, die in der Vergangenheit Rug-Pulls durchgeführt haben.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Yahoo Finance: Extract Stock Market Data

How to Scrape Moon.ly | Step-by-Step NFT Data Extraction Guide

How to Scrape Rocket Mortgage: A Comprehensive Guide

How to Scrape Open Collective: Financial and Contributor Data Guide

How to Scrape jup.ag: Jupiter DEX Web Scraper Guide

How to Scrape Indiegogo: The Ultimate Crowdfunding Data Extraction Guide

How to Scrape ICO Drops: Comprehensive Crypto Data Guide

How to Scrape Crypto.com: Comprehensive Market Data Guide

Häufig gestellte Fragen zu pump.fun

Finden Sie Antworten auf häufige Fragen zu pump.fun