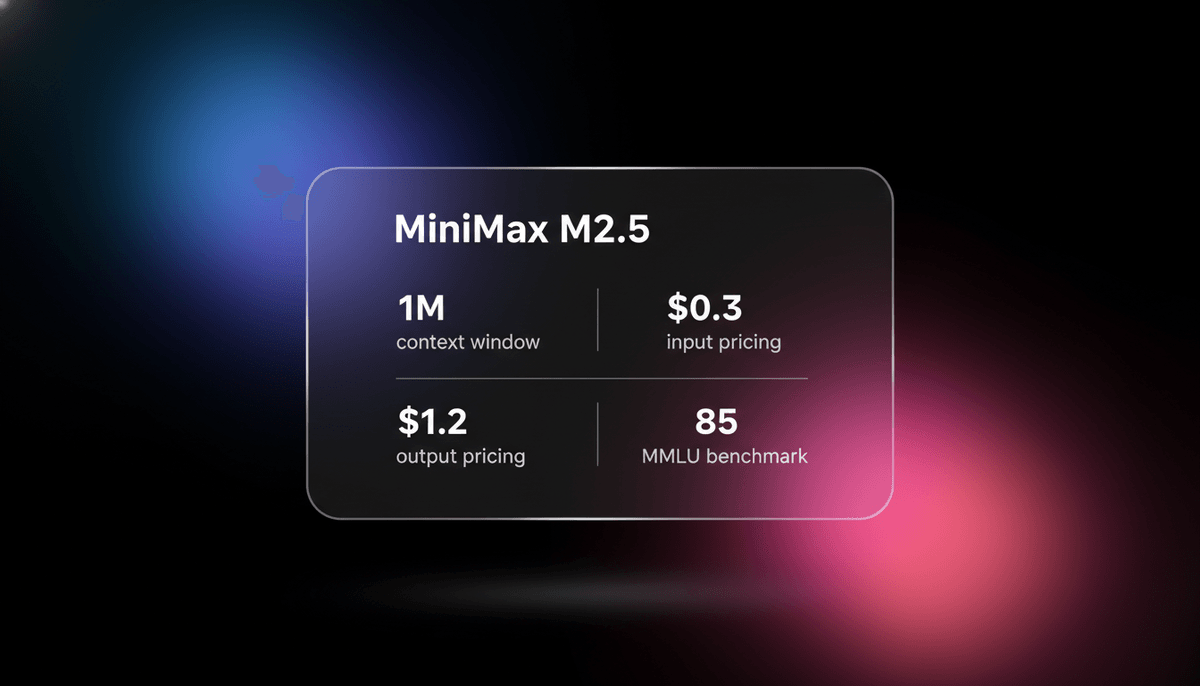

MiniMax M2.5

MiniMax M2.5 ist ein SOTA MoE-Modell mit 1M context window und erstklassigen agentic Coding-Fähigkeiten zu disruptiven Preisen für autonome Agenten.

Über MiniMax M2.5

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von MiniMax M2.5.

Effiziente Frontier-Architektur

MiniMax M2.5 ist ein hocheffizientes frontier model, das auf einer 230B Mixture-of-Experts (MoE) Architektur basiert. Durch die Aktivierung von nur 10 Milliarden parameters pro Forward-Pass erreicht es Inferenz-Geschwindigkeiten und Preisstrukturen, die nahezu 20-mal effizienter sind als bei proprietären Giganten. Es wurde speziell für agentic intelligence entwickelt und priorisiert strukturierte Logik und mehrstufige Planung gegenüber einfachen Chat-Antworten. Dieses Sparse-Design ermöglicht es dem Modell, hohe Intelligenz ohne den massiven Rechenaufwand herkömmlicher dichter Modelle aufrechtzuerhalten.

Fortschrittliche Coding-Intelligenz

Das herausragende Merkmal des Modells ist die Architekten-Denkweise, die es ihm ermöglicht, Logikstrukturen und Projekthierarchien zu visualisieren, bevor Code generiert wird. Dies macht es besonders effektiv für die autonome Softwareentwicklung, wo es mit einem Score von 80,2 % bei SWE-Bench Verified dem state-of-the-art entspricht. Mit einem 1-Million-token context window kann es gesamte Codebasen aufnehmen, was tiefgreifende Repository-Audits und komplexe System-Refactorings ermöglicht, die bisher kostentechnisch unerschwinglich waren.

Enterprise- und lokale Bereitstellung

MiniMax M2.5 unterstützt über 10 Programmiersprachen und einen nativen Durchsatz von bis zu 100 tokens pro Sekunde in seiner Lightning-Variante. Da es als open-weight Modell verfügbar ist, können Entwickler es lokal bereitstellen, um volle Datensicherheit zu gewährleisten, während sie gleichzeitig Zugriff auf dasselbe logikstarke Reasoning wie bei der gehosteten API haben. Diese Vielseitigkeit macht es zu einer praktischen Wahl sowohl für Cloud-basierte Agenten-Pipelines als auch für On-Premise-Entwickler-Tools.

Anwendungsfälle für MiniMax M2.5

Entdecken Sie die verschiedenen Möglichkeiten, MiniMax M2.5 für großartige Ergebnisse zu nutzen.

Autonome Softwareentwicklung

Lösung realer GitHub-Issues und Debugging über mehrere Dateien hinweg mittels Agenten-Frameworks.

Enterprise-Agenten-Pipelines

Betrieb von permanent aktiven Hintergrund-Agenten für Forschung und Datensynthese bei niedrigen API-Kosten.

Modernisierung von Legacy-Code

Refactoring massiver, veralteter Repositories in moderne Frameworks unter Beibehaltung logischer Standards.

Architektonische Code-Reviews

Analyse von Projekthierarchien zur Bereitstellung von Logik-Feedback und strukturellen Optimierungsvorschlägen.

Hochvolumige Dokumentenbearbeitung

Verarbeitung großer Office-Dateien mit hoher Wiedergabetreue für Finanz- und Rechtsmodellierungen.

Low-Latency Entwickler-Tools

Unterstützung von IDE-Erweiterungen und CLI-Tools, die Antwortzeiten im Sub-Sekunden-Bereich erfordern.

Stärken

Einschränkungen

API-Schnellstart

minimax/minimax-m2.5

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.MINIMAX_API_KEY,

baseURL: 'https://api.minimax.io/v1',

});

async function main() {

const response = await client.chat.completions.create({

model: 'minimax-m2.5',

messages: [{ role: 'user', content: 'Entwerfe eine Microservices-Architektur für eine Fintech-App.' }],

temperature: 0.1,

});

console.log(response.choices[0].message.content);

}

main();Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über MiniMax M2.5 sagen

Sehen Sie, was die Community über MiniMax M2.5 denkt

“Die Preisgestaltung von MiniMax M2.5 ist die eigentliche Nachricht – günstig genug, um die Architektur zu verändern, nicht nur das Budget.”

“M2.5 erreicht SOTA-Werte bei einem 10B aktiven Parameter-Modell, was bedeutet, dass es schnell und günstig ist.”

“Das Modell reduziert die Schwerstarbeit, die Benutzer leisten mussten, nur um Dinge am Laufen zu halten.”

“M2.5 erreicht den Durchsatz von Claude Opus 4.6 zu einem Bruchteil der Kosten.”

“M2.5 lokal auf einem Mac Studio auszuführen ist flüssig. Die 10B aktiven params machen wirklich einen Unterschied.”

“Der architektonische Planungsschritt erkennt logische Fehler, bevor überhaupt eine Zeile Code geschrieben wird.”

Videos über MiniMax M2.5

Schauen Sie Tutorials, Rezensionen und Diskussionen über MiniMax M2.5

“Es ist fast 20-mal günstiger als die führenden proprietären Optionen.”

“Dies ist ein erstklassiges Coding- und Agentic-Modell, das viel schneller und drastisch günstiger ist.”

“Die Leistung bei SWE-bench verified katapultiert es wirklich in die Elite-Kategorie.”

“Sie erhalten frontier intelligence bei Open-Source-Hardwareanforderungen.”

“Die MoE-Architektur hier ist perfekt für Coding-Aufgaben mit niedriger latency abgestimmt.”

“MiniMax bietet das Modell zu 3 % der Kosten von Opus 4.6 bei output tokens an.”

“Die Kosten für Intelligenz nähern sich inzwischen tatsächlich den Kosten für Strom an.”

“Es verarbeitet große Repositories im context window, ohne das typische Vergessen inmitten des Dokuments.”

“Für Entwickler-Tools ist die Geschwindigkeit der Lightning-Variante ein riesiger UX-Gewinn.”

“Es ist das erste Mal, dass ich ein so günstiges Modell sehe, das tatsächlich komplexe logische Bugs löst.”

“Es kostet nur 1 $, das Modell kontinuierlich für eine Stunde bei 100 tokens pro Sekunde zu betreiben.”

“Das interne Reasoning glänzt hier besonders, da es sich sofort korrigieren kann.”

“Im Test gegen GPT-4o liefert es konsistent bessere Refactorings über mehrere Dateien hinweg.”

“Die agentic Fähigkeiten sind integriert, kein nachträglicher Einfall im prompt.”

“Es ist angesichts der Input-Preisstufen für kleine Entwickler im Grunde kostenlos.”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für MiniMax M2.5

Expertentipps, um das Beste aus MiniMax M2.5 herauszuholen.

Verwenden Sie die Architekten-Denkweise

Bitten Sie das Modell, eine Projektstruktur zu generieren, bevor Sie den eigentlichen Implementierungscode anfordern.

Nutzen Sie das 1M-Context-Window

Stellen Sie vollständige Dokumentationen oder gesamte Module bereit, um ein globales Verständnis Ihrer Codebasis sicherzustellen.

Verwenden Sie den HighSpeed-Tarif

Wählen Sie den M2.5-HighSpeed-Endpoint, um konstante 100 tokens pro Sekunde für interaktive Agents zu erreichen.

Iterative Verfeinerung

Bitten Sie das Modell, seine anfängliche Ausgabe auf logische Lücken oder Sicherheitslücken zu überprüfen.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

Claude 3.7 Sonnet

Anthropic

Claude 3.7 Sonnet is Anthropic's first hybrid reasoning model, delivering state-of-the-art coding capabilities, a 200k context window, and visible thinking.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

GPT-5.5

OpenAI

GPT-5.5 is OpenAI's flagship frontier model with a 1M context window and five reasoning effort levels, optimized for autonomous agentic workflows and coding.

Kimi k2.6

Moonshot

Kimi k2.6 is Moonshot AI's 1T-parameter MoE model featuring a 256K context window, native video input, and elite performance in autonomous agentic coding.

Häufig gestellte Fragen zu MiniMax M2.5

Finden Sie Antworten auf häufige Fragen zu MiniMax M2.5