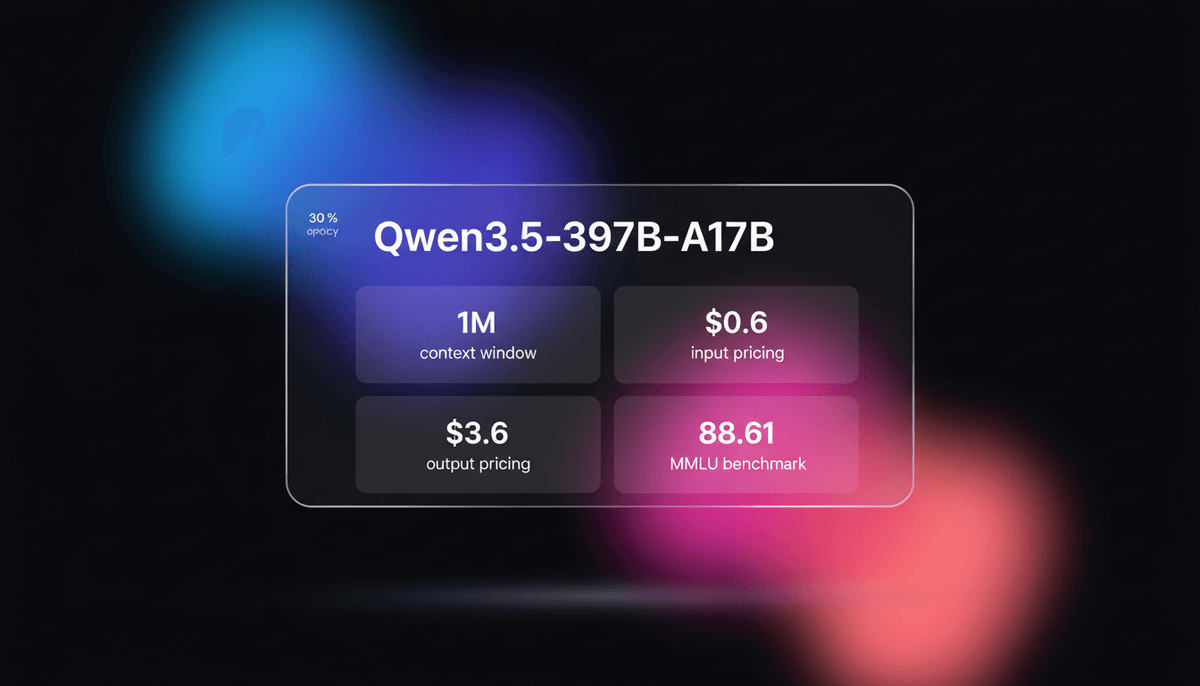

Qwen3.5-397B-A17B

Qwen3.5-397B-A17B ist Alibabas Open-Weights-MoE-Flaggschiff. Es bietet natives multimodales Reasoning, 1M context und 19-fachen Decoding-Durchsatz...

Über Qwen3.5-397B-A17B

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von Qwen3.5-397B-A17B.

Hocheffiziente Mixture-of-Experts

Qwen3.5-397B-A17B ist ein natives multimodales Flaggschiff-Modell, das eine innovative hybride Architektur verwendet. Diese kombiniert lineare Attention durch Gated Delta Networks mit einer spärlichen Mixture-of-Experts (MoE). Obwohl es insgesamt 397 Milliarden parameters enthält, aktiviert das spärliche Design nur 17 Milliarden parameters pro Forward-Pass, was eine außergewöhnliche Effizienz bei der inference und Geschwindigkeit ermöglicht, ohne die umfangreichen reasoning-Fähigkeiten zu beeinträchtigen. Es ist sowohl für Sprach- als auch für visuelle Aufgaben optimiert, unterstützt einen riesigen Wortschatz von 250k tokens und bietet Unterstützung für über 201 Sprachen und Dialekte.

Native multimodale Agentic-Workflows

Das Modell zeichnet sich als nativer multimodaler Agent aus, der bis zu eine Million tokens an context verarbeiten kann, was etwa zwei Stunden Videomaterial entspricht. Es führt einen spezialisierten Thinking-Modus für komplexes logisches reasoning ein und ist von Haus aus für agentic-Workflows wie Webentwicklung, GUI-Navigation und räumliche Intelligenz ausgestattet. Die Architektur unterstützt durchgängiges FP8-Training und ein disaggregiertes Trainings- und Inferenz-Framework, was es zu einem der skalierbarsten und effizientesten Modelle für KI-Anwendungen auf Unternehmensebene macht.

Open Weights für globale Zugänglichkeit

Dieses Modell wurde unter der Apache 2.0-Lizenz veröffentlicht und bietet der Open-Source-Community Fähigkeiten auf frontier-Niveau, die zuvor proprietären Systemen vorbehalten waren. Es schlägt die Brücke zwischen riesigen Parameterzahlen und praktischem Einsatz und ermöglicht es Unternehmen, reasoning-Aufgaben auf privater Infrastruktur mit wesentlich geringerem Rechenaufwand auszuführen als bei dichten 400B-Alternativen.

Anwendungsfälle für Qwen3.5-397B-A17B

Entdecken Sie die verschiedenen Möglichkeiten, Qwen3.5-397B-A17B für großartige Ergebnisse zu nutzen.

Langzeit-Videoanalyse

Analysieren Sie bis zu zwei Stunden Videomaterial, um Logik zu extrahieren, Code aus Filmmaterial zu rekonstruieren oder strukturierte Zusammenfassungen zu erstellen.

Wissenschaftliche Forschung auf PhD-Niveau

Lösen Sie wissenschaftliche Fragen auf Hochschulniveau und mathematische Probleme auf Olympiade-Niveau mithilfe des adaptiven Deep-Thinking-Modus.

Autonome GUI-Agenten

Automatisieren Sie Interaktionen mit Smartphones und Computern, um Büro-Workflows und appübergreifende mobile Navigation zu bewältigen.

Visuelle Softwareentwicklung

Nutzen Sie 'Vibe Coding', indem Sie Anweisungen in natürlicher Sprache und UI-Skizzen in funktionalen Frontend-Code umwandeln.

Dokumentenintelligenz

Verarbeiten Sie komplexe Dokumente, Diagramme und handgeschriebene Skizzen, um strukturierte Daten zu extrahieren und Layouts zu analysieren.

Räumliche KI-Anwendungen

Verstehen Sie pixelgenaue Beziehungen für verkörperte KI-Aufgaben wie die Analyse autonomer Fahrszenen und Roboter-Navigation.

Stärken

Einschränkungen

API-Schnellstart

alibaba/qwen3.5-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.5-plus',

messages: [{ role: 'user', content: 'Analyze the logic of this MoE architecture.' }],

extra_body: { enable_thinking: true },

});

console.log(completion.choices[0].message.content);

}

main();Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über Qwen3.5-397B-A17B sagen

Sehen Sie, was die Community über Qwen3.5-397B-A17B denkt

“Qwen3.5-397B ist im Grunde ein Modell der GPT-5-Klasse, aber mit Open Weights. Die DeltaNet-Architektur löst die MoE-Latenzprobleme perfekt.”

“Das native multimodale Reasoning von Qwen3.5 sieht unglaublich aus. 1M context + Videoanalyse werden Agenten-Workflows verändern.”

“Die Entscheidung für ein durchgängiges FP8-Training bei gleichzeitiger Beibehaltung von BF16 in sensiblen Schichten ist ein Meisterkurs in Stabilitätsoptimierungen.”

“Das ist das erste Mal, dass ich ein offenes Modell sehe, das Gemini 1.5 Pro bei komplexen multimodalen Agentenaufgaben tatsächlich schlägt.”

“Die 19-fache Verbesserung des Decoding-Durchsatzes gegenüber Qwen3-Max macht es zu einer tragfähigen Alternative für Agenten auf Produktionsebene.”

“Ich war überrascht, wie gut es mit 4-Bit-Quantisierung umgeht. Es behält fast die gesamte Reasoning-Fähigkeit auf einem dualen A100-Setup bei.”

Videos über Qwen3.5-397B-A17B

Schauen Sie Tutorials, Rezensionen und Diskussionen über Qwen3.5-397B-A17B

“Ein Modell mit 397 Milliarden Parametern, aber nur 17 Milliarden aktiven Parametern.”

“Beim Decoding mit 256K ist dieses Modell 19-mal schneller als Qwen 3 Max.”

“Das native Vision-Language-Reasoning ist das, was es für agentic Workflows besonders macht.”

“Es schlägt die meisten closed models bei den Standard-Mathe-Benchmarks.”

“Lokal auszuführen ist schwierig, aber die quantisierten Versionen laufen auf High-End-Macs.”

“Modell mit 397 Milliarden Parametern und 17 Milliarden aktiven Parametern. Es ist nativ multimodal.”

“Es ist wahrscheinlich aktuell das beste multimodale Open-Source-Modell.”

“Die Fähigkeit, zwei Stunden Video nativ zu verarbeiten, ist ein massiver Vorteil.”

“Sehen Sie sich diese Logik-Ergebnisse an, es erreicht konstant GPT-4o-Niveau.”

“Die Apache-Lizenz macht es sehr attraktiv für den Datenschutz in Unternehmen.”

“Strukturierte OCR-Extraktion. Sie haben ein unordentliches PDF... und müssen daraus sauberes JSON machen. Hier glänzt dieses Modell.”

“Sie erhalten die Intelligenz eines 400-Milliarden-Parameter-Giganten... zahlen aber die Rechenkosten eines 17-Milliarden-Parameter-Modells.”

“Es beherrscht das Long-Context-Retrieval besser als die vorherige Version.”

“Die Tool-Use-Integration ist direkt in das Basistraining eingebaut, nicht als nachträgliche Erweiterung.”

“Der Thinking-Modus erlaubt es, die eigene Logik vor der Ausgabe zu korrigieren.”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für Qwen3.5-397B-A17B

Expertentipps, um das Beste aus Qwen3.5-397B-A17B herauszuholen.

Thinking Mode aktivieren

Geben Sie den Parameter 'enable_thinking: true' in Ihrem API-Aufruf an, um tiefgehendes reasoning für Mathematik, Programmierung und komplexe logische Rätsel zu aktivieren.

Fast Mode nutzen

Verwenden Sie den 'Fast'-Modus für einfache Anfragen, um sofortige Antworten zu erhalten, ohne tokens für unnötige interne thinking-Phasen zu verbrauchen.

Video-prompts optimieren

Weisen Sie das model bei der Analyse von Videos an, sich auf das endgültige dynamische Ergebnis zu konzentrieren, anstatt auf eine Frame-für-Frame-Analyse, um eine bessere zeitliche Kohärenz zu erzielen.

Quantisierung nutzen

Verwenden Sie 4-Bit- oder 8-Bit-Quantisierung (GGUF/EXL2), um das model auf Consumer-Hardware auszuführen, sofern ausreichend VRAM (200GB+) vorhanden ist.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Sonnet 4.6

Anthropic

Claude Sonnet 4.6 offers frontier performance for coding and computer use with a massive 1M token context window for only $3/1M tokens.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Gemini 3 Flash

Gemini 3 Flash is Google's high-speed multimodal model featuring a 1M token context window, elite 90.4% GPQA reasoning, and autonomous browser automation tools.

Häufig gestellte Fragen zu Qwen3.5-397B-A17B

Finden Sie Antworten auf häufige Fragen zu Qwen3.5-397B-A17B