Qwen3.6-Max-Preview

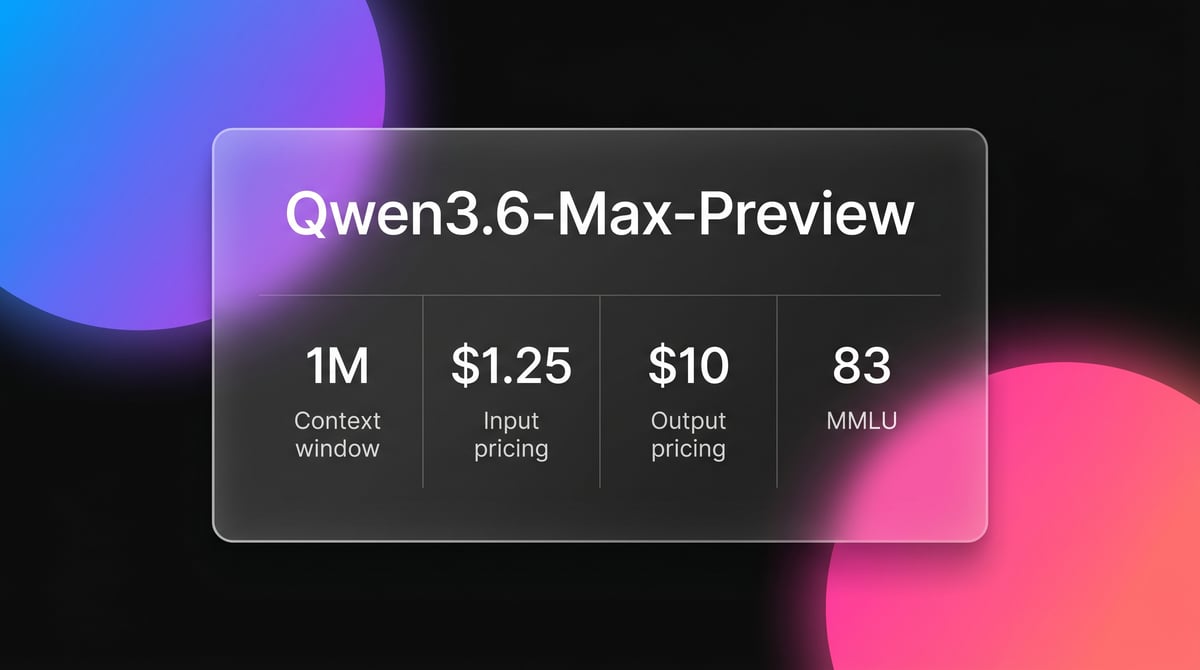

Qwen3.6-Max-Preview ist Alibabas flagship MoE-Modell mit 1M-Kontext, nativem Thinking Mode und SOTA-Ergebnissen bei agentic Coding und Reasoning.

Über Qwen3.6-Max-Preview

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von Qwen3.6-Max-Preview.

Qwen3.6-Max-Preview ist das proprietäre flagship LLM von Alibaba und repräsentiert den nächsten Schritt in ihrer leistungsstarken AI-Serie. Unter Verwendung einer dünnbesetzten Mixture-of-Experts (MoE)-Architektur erreicht das Modell die Reasoning-Tiefe eines Billionen-Parameter-Systems bei gleichzeitig hoher betrieblicher Effizienz. Es ist speziell für agentic Coding, Weltwissen und die Befolgung komplexer Anweisungen optimiert.

Das herausragende Merkmal des Modells ist der native Thinking Mode, der es dem System ermöglicht, eine sichtbare interne chain-of-thought zu generieren, bevor eine endgültige Antwort geliefert wird. Diese Transparenz ist besonders wertvoll für Entwickler, die autonome Agenten erstellen, da sie einen klaren Einblick in die logische Planung und Fehlerkorrekturschritte bietet. In Kombination mit einem massiven 1-Million-Token-Context-Window kann das Modell komplette Projekt-Repositories oder umfangreiche Dokumentationsbibliotheken in einem einzigen Durchgang aufnehmen.

Qwen3.6-Max-Preview wird im Alibaba Cloud Model Studio gehostet, unterstützt Industriestandard-Protokolle und ist mit OpenAI-API-Spezifikationen kompatibel. Es ist als erste Wahl für Unternehmen konzipiert, die AI-Funktionen auf frontier-Niveau für multimodale Datenanalysen und robuste agentic Workflows benötigen, und bietet eine leistungsstarke Alternative zu westlichen closed-source-Modellen.

Anwendungsfälle für Qwen3.6-Max-Preview

Entdecken Sie die verschiedenen Möglichkeiten, Qwen3.6-Max-Preview für großartige Ergebnisse zu nutzen.

Autonome Softwareentwicklung

Setzen Sie das Modell als Coding-Agent ein, der in der Lage ist, durch komplette Codebases zu navigieren, Architekturänderungen zu planen und Bugs über mehrere Dateien hinweg zu beheben.

Technische Analyse im großen Maßstab

Nutzen Sie das 1M-token context window, um vollständige Dokumentationssätze oder rechtliche Frameworks für tiefgreifende Analysen ohne RAG-Einschränkungen einzulesen.

Komplexes Reasoning und Planung

Nutzen Sie den nativen Thinking Mode, um hochkomplexe mathematische Probleme zu lösen, bei denen ein mehrstufiger interner Plan für die Genauigkeit erforderlich ist.

Multimodales Inhaltsverständnis

Analysieren Sie sowohl statische Bilder als auch komplexe Videosequenzen, um Daten zu extrahieren und dynamische visuelle Ereignisse zusammenzufassen.

Interaktive Terminal-Operationen

Entwickeln Sie Tools, die es der KI ermöglichen, direkt mit Shells und CLI-Umgebungen zu interagieren, und profitieren Sie von der optimierten Terminal-Bench-Leistung.

Enterprise Agentic Workflows

Integrieren Sie das Modell in komplexe Geschäftsprozesse, bei denen hohe Zuverlässigkeit bei Anweisungen und ausgefeiltes Tool-Calling für die Automatisierung erforderlich sind.

Stärken

Einschränkungen

API-Schnellstart

alibaba/qwen3.6-max-preview

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

base_url: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

async function main() {

const completion = await client.chat.completions.create({

model: 'qwen3.6-max-preview',

messages: [{ role: 'user', content: 'Design a system architecture for a real-time AI agent.' }],

extra_body: { enable_thinking: true },

stream: true

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}

}

main();Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über Qwen3.6-Max-Preview sagen

Sehen Sie, was die Community über Qwen3.6-Max-Preview denkt

“Die Performance, die man von einem Modell auf einer riesigen Serverfarm erwartet, ist jetzt auf dem Desktop verfügbar.”

“Qwen3.6-Max-Preview hat gerade Claude Opus 4.5 bei SWE-Bench Pro geschlagen. China holt schnell auf.”

“Mit 1,25 $ pro Million tokens ist Qwen für die großflächige Datenaufnahme deutlich günstiger als Claude.”

“Die Tatsache, dass der Thinking Mode als Standardzustand eingebaut ist, ist eine bedeutende Designentscheidung für agentic Zuverlässigkeit.”

“Qwen hat Qwen 3.6 Max Preview als neues proprietäres flagship-Modell auf höchstem Niveau veröffentlicht.”

“Es zeigt verbessertes agentic Coding und eine bessere Zuverlässigkeit in realen Szenarien im Vergleich zum Plus-Modell.”

Videos über Qwen3.6-Max-Preview

Schauen Sie Tutorials, Rezensionen und Diskussionen über Qwen3.6-Max-Preview

“Qwen hat Qwen 3.6 Max Preview als neues proprietäres flagship-Modell auf höchstem Niveau veröffentlicht.”

“Das Modell zeigt einen starken Sprung bei Coding-Agent-benchmarks wie SkillsBench und Terminal-Bench 2.0.”

“Qwen versucht eindeutig, bei den High-End-Modellen wie Claude 4.5 Opus ernsthaft mitzuhalten.”

“Dieses Modell stellt eine bedeutende Verbesserung bei Weltwissen und der Befolgung von Anweisungen dar.”

“Der Performance-Sprung bei SWE-bench ist das, was es wirklich von der Plus-Variante abhebt.”

“Die Benchmark-Story dreht sich wirklich darum, das gehostete Max Preview als etwas Eigenständiges von der open-weight-Familie zu positionieren.”

“Wir nutzen Qwen-Code-Seiten und Repo-Oberflächen, um die Tiefe des Ökosystems über die reinen Modell-weights hinaus zu beurteilen.”

“Der Thinking Mode ist überraschend schnell im Vergleich zu o1-Modellen vom letzten Jahr.”

“Dies ist eindeutig für Enterprise-Entwickler konzipiert, die eine zuverlässige API für agentic Aufgaben benötigen.”

“Die multimodale Vision-Performance holt in einigen Dokumentenanalyse-Tests zu Gemini 2 auf.”

“Dieses Video stellt das Qwen3.6-Max-Preview vor, einen ersten Blick auf das nächste flagship-Modell von Qwen.”

“Es zeigt verbessertes agentic Coding und eine bessere Zuverlässigkeit in realen Szenarien im Vergleich zum Plus-Modell.”

“Das 1M context window ist deutlich stabiler als das, was wir in frühen Qwen 2-Versionen gesehen haben.”

“Wenn Sie viel programmieren, ist Qwen 3.6 Max derzeit der benchmark-Spitzenreiter.”

“Die Preisgestaltung bleibt selbst für ihr proprietäres flagship-Modell sehr wettbewerbsfähig.”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für Qwen3.6-Max-Preview

Expertentipps, um das Beste aus Qwen3.6-Max-Preview herauszuholen.

Internes Reasoning aktivieren

Setzen Sie den Parameter 'enable_thinking' in Ihrer API-Anfrage auf true, um die interne Logik des Modells für das Debugging komplexer Reasoning-Prozesse anzuzeigen.

Langfristige Logik bewahren

Nutzen Sie die 'preserve_thinking'-Funktion für Multi-Turn-Konversationen, um sicherzustellen, dass das Modell über die gesamte Sitzung hinweg die logische Konsistenz beibehält.

Ganze Bibliotheken einspeisen

Nutzen Sie das 1M context window, indem Sie vollständige Quellenmaterialien statt gestückelter Daten bereitstellen, um ein besseres Verständnis über Dateien hinweg zu ermöglichen.

Kompatible Endpunkte verwenden

Für globale Anwendungen sollten Sie die Endpunkte in Singapur oder US Virginia in der Alibaba Cloud nutzen, um die regionale latency für internationale Nutzer zu minimieren.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Häufig gestellte Fragen zu Qwen3.6-Max-Preview

Finden Sie Antworten auf häufige Fragen zu Qwen3.6-Max-Preview