Cómo hacer scraping de Exploit-DB | Scraper de Exploit Database

Aprende cómo hacer scraping de Exploit-DB para obtener datos de vulnerabilidades, códigos de exploit y referencias CVE para potenciar la investigación de...

Protección Anti-Bot Detectada

- Cloudflare

- WAF y gestión de bots de nivel empresarial. Usa desafíos JavaScript, CAPTCHAs y análisis de comportamiento. Requiere automatización de navegador con configuración sigilosa.

- Limitación de velocidad

- Limita solicitudes por IP/sesión en el tiempo. Se puede eludir con proxies rotativos, retrasos en solicitudes y scraping distribuido.

- Bloqueo de IP

- Bloquea IPs de centros de datos conocidos y direcciones marcadas. Requiere proxies residenciales o móviles para eludir efectivamente.

- Desafío JavaScript

- Requiere ejecutar JavaScript para acceder al contenido. Las solicitudes simples fallan; se necesita un navegador headless como Playwright o Puppeteer.

Acerca de Exploit Database

Descubre qué ofrece Exploit Database y qué datos valiosos se pueden extraer.

Repositorio Exhaustivo de Vulnerabilidades

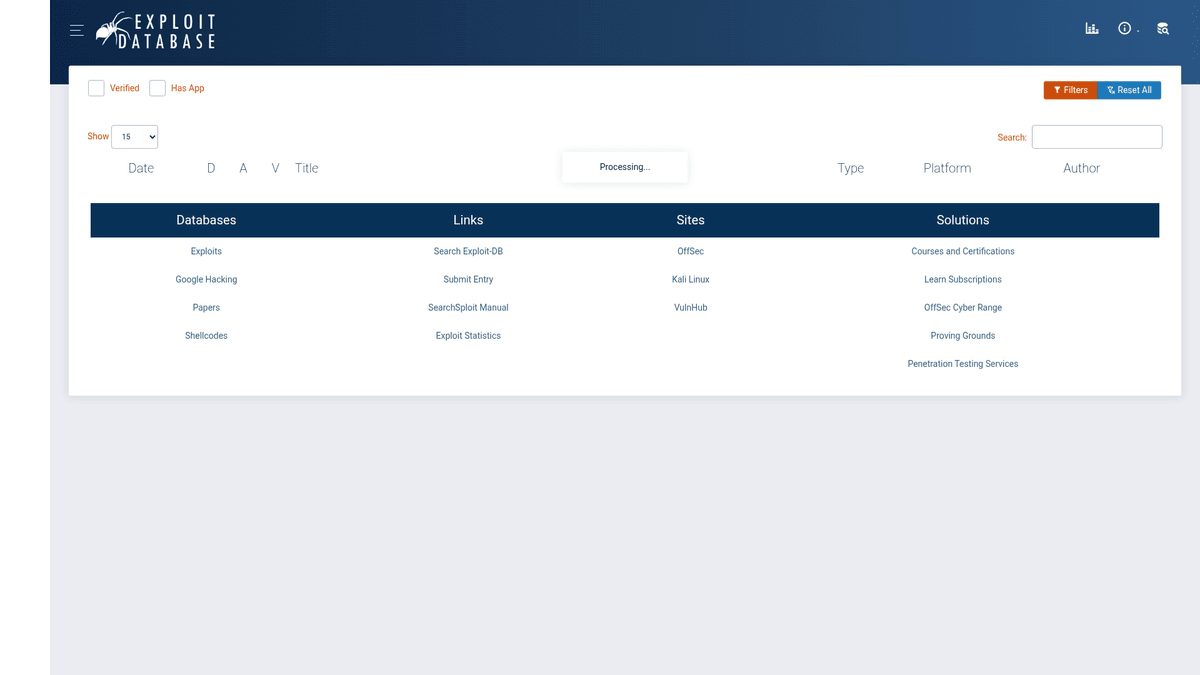

El Exploit Database (Exploit-DB) es un archivo compatible con CVE de exploits públicos y software vulnerable correspondiente, desarrollado para su uso por penetration testers e investigadores de vulnerabilidades. Mantenido por OffSec (Offensive Security), sirve como un centro neurálgico para que la comunidad de ciberseguridad comparta código de prueba de concepto (PoC) e investigación en diversas plataformas y aplicaciones. El repositorio es una de las fuentes más confiables para profesionales de la seguridad en todo el mundo.

Categorización y Profundidad de Datos

El sitio web organiza los datos en categorías granulares como Exploits Remotos, Aplicaciones Web, Exploits Locales y Shellcodes. Cada entrada suele incluir el título del exploit, fecha, autor, plataforma, el CVE ID asociado y el código del exploit. Este enfoque estructurado permite a los investigadores pivotar rápidamente entre diferentes tipos de vulnerabilidades y su contexto histórico.

Valor Estratégico para Operaciones de Seguridad

Extraer estos datos es sumamente valioso para los Centros de Operaciones de Seguridad (SOC) y los equipos de inteligencia de amenazas para correlacionar exploits conocidos con vulnerabilidades internas. Al automatizar la extracción de código PoC y metadatos, las organizaciones pueden crear firmas de seguridad personalizadas, mejorar su ciclo de vida de gestión de vulnerabilidades y construir feeds de inteligencia de amenazas robustos.

¿Por Qué Scrapear Exploit Database?

Descubre el valor comercial y los casos de uso para extraer datos de Exploit Database.

Enriquecimiento de inteligencia de amenazas

Automatiza la recopilación de nuevos exploits proof-of-concept para alimentar los centros de operaciones de seguridad internos y las plataformas de inteligencia de amenazas.

Priorización de vulnerabilidades

Cruza las vulnerabilidades de los activos internos con los exploits disponibles públicamente para determinar qué parches requieren una aplicación inmediata.

Desarrollo de herramientas de seguridad

Integra código de exploit funcional y shellcode en frameworks de pruebas de penetración personalizados o herramientas de evaluación de seguridad automatizadas.

Auditoría de cumplimiento

Mantén un registro histórico de exploits para versiones específicas de software para asegurar que los sistemas cumplan con los requisitos de seguridad regulatorios.

Monitoreo de Zero-Day

Configura alertas para exploits recién publicados que apunten a infraestructuras críticas o software empresarial ampliamente utilizado.

Desafíos de Scraping

Desafíos técnicos que puedes encontrar al scrapear Exploit Database.

Renderizado basado en JavaScript

La base de datos principal de exploits se renderiza a través de jQuery DataTables, lo que la hace invisible para los scrapers HTTP básicos que no ejecutan JavaScript.

Muros anti-bot de Cloudflare

Exploit-DB está protegido por Cloudflare, que utiliza huellas digitales del navegador y desafíos TLS para bloquear el tráfico que no sea humano.

Rate limiting estricto

Las solicitudes repetidas de archivos de código de exploit sin procesar a menudo activan una limitación de frecuencia basada en IP o bloqueos temporales si no se gestionan adecuadamente.

Carga de contenido dinámico

El sitio utiliza AJAX para cargar los datos de la tabla, lo que requiere que el scraper espere a que la red esté inactiva o intercepte llamadas específicas a la API.

Scrapea Exploit Database con IA

Sin código necesario. Extrae datos en minutos con automatización impulsada por IA.

Cómo Funciona

Describe lo que necesitas

Dile a la IA qué datos quieres extraer de Exploit Database. Solo escríbelo en lenguaje natural — sin código ni selectores.

La IA extrae los datos

Nuestra inteligencia artificial navega Exploit Database, maneja contenido dinámico y extrae exactamente lo que pediste.

Obtén tus datos

Recibe datos limpios y estructurados listos para exportar como CSV, JSON o enviar directamente a tus aplicaciones.

Por Qué Usar IA para el Scraping

La IA facilita el scraping de Exploit Database sin escribir código. Nuestra plataforma impulsada por inteligencia artificial entiende qué datos quieres — solo descríbelo en lenguaje natural y la IA los extrae automáticamente.

How to scrape with AI:

- Describe lo que necesitas: Dile a la IA qué datos quieres extraer de Exploit Database. Solo escríbelo en lenguaje natural — sin código ni selectores.

- La IA extrae los datos: Nuestra inteligencia artificial navega Exploit Database, maneja contenido dinámico y extrae exactamente lo que pediste.

- Obtén tus datos: Recibe datos limpios y estructurados listos para exportar como CSV, JSON o enviar directamente a tus aplicaciones.

Why use AI for scraping:

- Gestión automática de anti-bots: Automatio gestiona de forma nativa los desafíos de Cloudflare y el fingerprinting del navegador, asegurando que tus tareas de scraping se ejecuten sin intervención manual.

- Selección visual de datos: Mapea fácilmente la compleja estructura de DataTable simplemente haciendo clic en los elementos que deseas extraer, evitando la codificación compleja en CSS o XPath.

- Sincronización de datos programada: Configura tu scraper para que se ejecute en intervalos específicos y garantiza que tus feeds de inteligencia de amenazas estén siempre actualizados con los últimos exploits.

Scrapers Sin Código para Exploit Database

Alternativas de apuntar y clic al scraping con IA

Varias herramientas sin código como Browse.ai, Octoparse, Axiom y ParseHub pueden ayudarte a scrapear Exploit Database. Estas herramientas usan interfaces visuales para seleccionar elementos, pero tienen desventajas comparadas con soluciones con IA.

Flujo de Trabajo Típico con Herramientas Sin Código

Desafíos Comunes

Curva de aprendizaje

Comprender selectores y lógica de extracción lleva tiempo

Los selectores se rompen

Los cambios en el sitio web pueden romper todo el flujo de trabajo

Problemas con contenido dinámico

Los sitios con mucho JavaScript requieren soluciones complejas

Limitaciones de CAPTCHA

La mayoría de herramientas requieren intervención manual para CAPTCHAs

Bloqueo de IP

El scraping agresivo puede resultar en el bloqueo de tu IP

Scrapers Sin Código para Exploit Database

Varias herramientas sin código como Browse.ai, Octoparse, Axiom y ParseHub pueden ayudarte a scrapear Exploit Database. Estas herramientas usan interfaces visuales para seleccionar elementos, pero tienen desventajas comparadas con soluciones con IA.

Flujo de Trabajo Típico con Herramientas Sin Código

- Instalar extensión del navegador o registrarse en la plataforma

- Navegar al sitio web objetivo y abrir la herramienta

- Seleccionar con point-and-click los elementos de datos a extraer

- Configurar selectores CSS para cada campo de datos

- Configurar reglas de paginación para scrapear múltiples páginas

- Resolver CAPTCHAs (frecuentemente requiere intervención manual)

- Configurar programación para ejecuciones automáticas

- Exportar datos a CSV, JSON o conectar vía API

Desafíos Comunes

- Curva de aprendizaje: Comprender selectores y lógica de extracción lleva tiempo

- Los selectores se rompen: Los cambios en el sitio web pueden romper todo el flujo de trabajo

- Problemas con contenido dinámico: Los sitios con mucho JavaScript requieren soluciones complejas

- Limitaciones de CAPTCHA: La mayoría de herramientas requieren intervención manual para CAPTCHAs

- Bloqueo de IP: El scraping agresivo puede resultar en el bloqueo de tu IP

Ejemplos de Código

import requests

from bs4 import BeautifulSoup

# Exploit-DB utiliza Cloudflare; las solicitudes simples podrían ser bloqueadas

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Nota: Los datos principales se cargan vía AJAX, el HTML inicial es solo una estructura básica

print('Título de la página:', soup.title.text)

except Exception as e:

print(f'Error encontrado: {e}')Cuándo Usar

Mejor para páginas HTML estáticas donde el contenido se carga del lado del servidor. El enfoque más rápido y simple cuando no se requiere renderizado de JavaScript.

Ventajas

- ●Ejecución más rápida (sin sobrecarga del navegador)

- ●Menor consumo de recursos

- ●Fácil de paralelizar con asyncio

- ●Excelente para APIs y páginas estáticas

Limitaciones

- ●No puede ejecutar JavaScript

- ●Falla en SPAs y contenido dinámico

- ●Puede tener dificultades con sistemas anti-bot complejos

Cómo Scrapear Exploit Database con Código

Python + Requests

import requests

from bs4 import BeautifulSoup

# Exploit-DB utiliza Cloudflare; las solicitudes simples podrían ser bloqueadas

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Nota: Los datos principales se cargan vía AJAX, el HTML inicial es solo una estructura básica

print('Título de la página:', soup.title.text)

except Exception as e:

print(f'Error encontrado: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_exploit_db():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://www.exploit-db.com/')

# Esperar a que los DataTables se carguen mediante AJAX

page.wait_for_selector('table#exploits-table')

rows = page.query_selector_all('table#exploits-table tbody tr')

for row in rows[:5]:

print(row.inner_text())

browser.close()

scrape_exploit_db()Python + Scrapy

import scrapy

class ExploitSpider(scrapy.Spider):

name = 'exploit_spider'

start_urls = ['https://www.exploit-db.com/']

def parse(self, response):

# Scrapy necesita un middleware de JS como scrapy-playwright para este sitio

for exploit in response.css('table#exploits-table tbody tr'):

yield {

'title': exploit.css('td.title a::text').get(),

'id': exploit.css('td.id::text').get(),

'cve': exploit.css('td.cve a::text').get()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://www.exploit-db.com/', { waitUntil: 'networkidle2' });

const results = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('table#exploits-table tbody tr'));

return rows.map(row => row.innerText);

});

console.log(results.slice(0, 5));

await browser.close();

})();Qué Puedes Hacer Con Los Datos de Exploit Database

Explora aplicaciones prácticas e insights de los datos de Exploit Database.

Feed de Inteligencia de Amenazas en Tiempo Real

Crear un flujo continuo de nuevos exploits para advertir a los equipos de seguridad sobre amenazas emergentes.

Cómo implementar:

- 1Configurar un scraping programado de la página de inicio diariamente

- 2Comparar los nuevos EDB-IDs con los registros extraídos previamente

- 3Activar alertas en Slack o correo electrónico para nuevos exploits críticos

Usa Automatio para extraer datos de Exploit Database y crear estas aplicaciones sin escribir código.

Qué Puedes Hacer Con Los Datos de Exploit Database

- Feed de Inteligencia de Amenazas en Tiempo Real

Crear un flujo continuo de nuevos exploits para advertir a los equipos de seguridad sobre amenazas emergentes.

- Configurar un scraping programado de la página de inicio diariamente

- Comparar los nuevos EDB-IDs con los registros extraídos previamente

- Activar alertas en Slack o correo electrónico para nuevos exploits críticos

- Correlación de Vulnerabilidades y Parcheo

Ayudar a los equipos de TI a priorizar los parches de software basándose en la existencia de código de exploit funcional.

- Extraer IDs de CVE y metadatos de exploits asociados

- Cruzar la información con las listas de inventario de software interno

- Marcar sistemas con exploits públicos disponibles para un parcheo inmediato

- Creación Automatizada de Firmas para SIEM

Extraer shellcode de prueba de concepto para desarrollar firmas defensivas para la detección de intrusos.

- Navegar a las páginas de exploits individuales y extraer el código fuente

- Analizar el código en busca de patrones de bytes únicos o cadenas de red

- Alimentar los patrones extraídos en generadores de reglas para SIEM o IDS/IPS

- Análisis Histórico de Tendencias de Vulnerabilidades

Analizar una década de datos de exploits para comprender qué plataformas han sido las más atacadas a lo largo del tiempo.

- Extraer todo el archivo, incluyendo fechas, plataformas y tipos

- Agrupar los datos por plataforma y año

- Visualizar tendencias de ataque utilizando herramientas de BI como Tableau o PowerBI

- Datasets Académicos de Ciberseguridad

Proporcionar datos estructurados de alta calidad para models de machine learning que predicen la fiabilidad de un exploit.

- Extraer exploits verificados frente a los no verificados

- Obtener el código fuente original y los atributos de metadatos

- Entrenar models para clasificar patrones de código asociados con exploits exitosos

Potencia tu flujo de trabajo con Automatizacion IA

Automatio combina el poder de agentes de IA, automatizacion web e integraciones inteligentes para ayudarte a lograr mas en menos tiempo.

Consejos Pro para Scrapear Exploit Database

Consejos expertos para extraer datos exitosamente de Exploit Database.

Interceptar solicitudes XHR

En lugar de hacer scraping del HTML renderizado, busca las solicitudes JSON internas realizadas por DataTables para extraer directamente datos limpios y estructurados.

Usar proxies residenciales

Rota a través de IPs residenciales de alta calidad para evitar activar el Web Application Firewall (WAF) agresivo del sitio y los límites de rate limiting.

Filtrar por verificación

Verifica programáticamente el campo de estado 'Verified' para priorizar código de exploit funcional y de alta calidad para tus conjuntos de datos de seguridad.

Normalizar identificadores CVE

Normaliza siempre las cadenas de CVE extraídas a un formato estándar para garantizar una integración sencilla con otras bases de datos de vulnerabilidades como NVD.

Consultar el mirror de GitLab

Antes de ejecutar un scraping intensivo, revisa el repositorio oficial de Exploit-DB en GitLab para obtener datos masivos en CSV, los cuales son más fáciles de procesar para registros históricos.

Testimonios

Lo Que Dicen Nuestros Usuarios

Unete a miles de usuarios satisfechos que han transformado su flujo de trabajo

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados Web Scraping

How to Scrape Biluppgifter.se: Vehicle Data Extraction Guide

How to Scrape CSS Author: A Comprehensive Web Scraping Guide

How to Scrape Bilregistret.ai: Swedish Vehicle Data Extraction Guide

How to Scrape The AA (theaa.com): A Technical Guide for Car & Insurance Data

How to Scrape Car.info | Vehicle Data & Valuation Extraction Guide

How to Scrape GoAbroad Study Abroad Programs

How to Scrape ResearchGate: Publication and Researcher Data

How to Scrape Statista: The Ultimate Guide to Market Data Extraction

Preguntas Frecuentes Sobre Exploit Database

Encuentra respuestas a preguntas comunes sobre Exploit Database