Cómo scrapear LivePiazza: Scraper de Real Estate en Filadelfia

Aprende cómo extraer datos de LivePiazza.com para obtener precios de apartamentos de lujo, disponibilidad y planos de planta. Monitorea el mercado inmobiliario...

Protección Anti-Bot Detectada

- Cloudflare

- WAF y gestión de bots de nivel empresarial. Usa desafíos JavaScript, CAPTCHAs y análisis de comportamiento. Requiere automatización de navegador con configuración sigilosa.

- Limitación de velocidad

- Limita solicitudes por IP/sesión en el tiempo. Se puede eludir con proxies rotativos, retrasos en solicitudes y scraping distribuido.

- Huella del navegador

- Identifica bots por características del navegador: canvas, WebGL, fuentes, plugins. Requiere spoofing o perfiles de navegador reales.

- Desafío JavaScript

- Requiere ejecutar JavaScript para acceder al contenido. Las solicitudes simples fallan; se necesita un navegador headless como Playwright o Puppeteer.

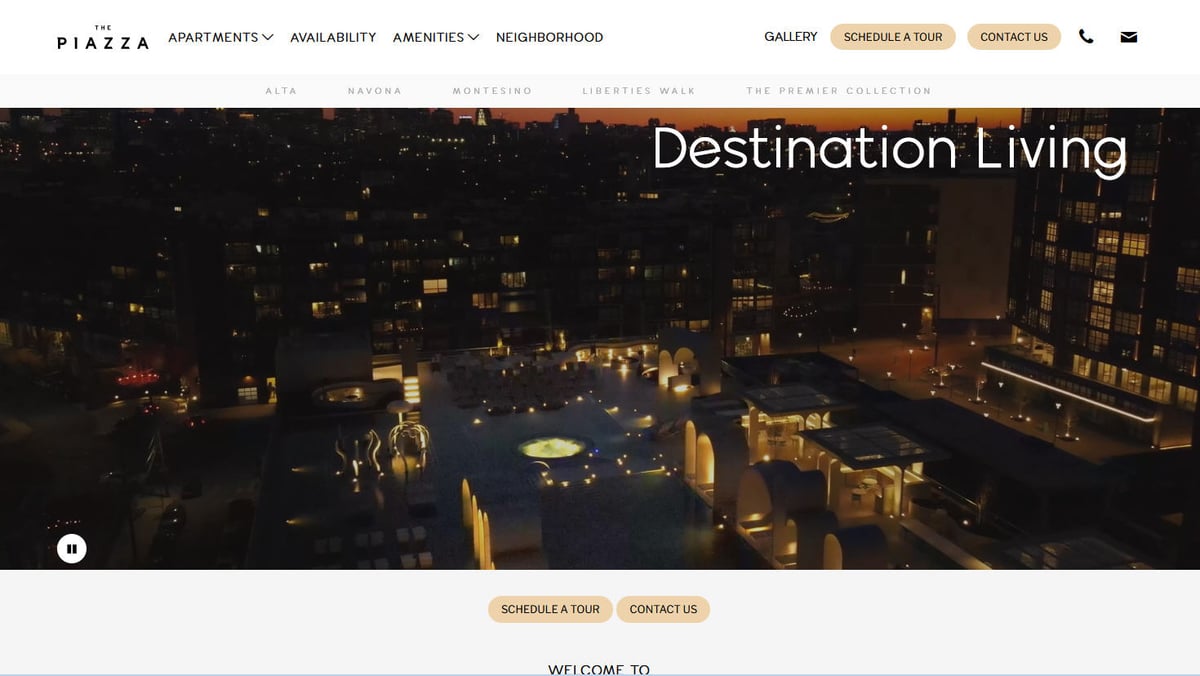

Acerca de The Piazza

Descubre qué ofrece The Piazza y qué datos valiosos se pueden extraer.

The Piazza, gestionado por Post Brothers, es un destacado desarrollo residencial y comercial en el barrio de Northern Liberties en Filadelfia. Cuenta con cuatro comunidades de lujo distintas (Alta, Navona, Montesino y Liberties Walk) que ofrecen una experiencia de 'ciudad dentro de una ciudad' con amenidades de alta gama y diseño moderno.

El sitio web funciona como un portal en tiempo real para posibles residentes, mostrando las tarifas de alquiler actuales, fechas específicas de disponibilidad de unidades y opciones detalladas de acabados interiores. Para los científicos de datos y analistas de bienes raíces, LivePiazza representa una fuente de datos crítica para entender el mercado multifamiliar de lujo en uno de los corredores urbanos de más rápido crecimiento en el noreste.

Scrapear estos datos permite un monitoreo de alta frecuencia de las tendencias de precios, los niveles de ocupación y la efectividad de los diversos incentivos de alquiler ofrecidos por desarrolladores inmobiliarios a gran escala.

¿Por Qué Scrapear The Piazza?

Descubre el valor comercial y los casos de uso para extraer datos de The Piazza.

Benchmark de mercado en tiempo real

Analiza las tendencias de alquiler de lujo en Filadelfia rastreando las tarifas actuales en las propiedades Alta, Navona y Montesino.

Monitoreo de oferta y demanda

Rastrea la disponibilidad de unidades a lo largo del tiempo para calcular las tasas de ocupación y comprender los niveles de absorción del vecindario.

Seguimiento de concesiones de alquiler

Monitorea ofertas promocionales como 'meses gratis' para determinar el alquiler neto efectivo en comparación con el precio bruto listado.

Investigación de estrategia competitiva

Evalúa cómo Post Brothers ajusta los precios para planos de planta específicos o acabados interiores en relación con la demanda del mercado.

Generación de leads para servicios

Identifica la próxima disponibilidad de unidades para dirigir campañas de marketing oportunas a personas en proceso de mudanza, diseñadores de interiores y minoristas de muebles locales.

Análisis de inversión

Recopila datos históricos de precios para ayudar a los inversores a determinar el ROI de las amenidades de lujo y los desarrollos urbanos.

Desafíos de Scraping

Desafíos técnicos que puedes encontrar al scrapear The Piazza.

Protección de Cloudflare

El sitio utiliza un WAF de Cloudflare agresivo que activa desafíos de JS y bloquea solicitudes de librerías HTTP estándar.

Renderizado de contenido dinámico

Las tablas de listados y los mapas interactivos se renderizan a través de React, lo que requiere un navegador headless para ejecutar JavaScript y extraer los datos.

Inyecciones de datos XHR

Los precios y la disponibilidad a menudo se inyectan a través de llamadas a la API interna que utilizan tokens basados en sesiones, los cuales pueden expirar durante el rastreo.

Activos con carga diferida (Lazy-Loaded)

Las imágenes de planos de planta de alta calidad y las fotos de las unidades se cargan de forma diferida, lo que requiere activadores de scroll para asegurar que se capture todo el contenido multimedia.

Cambios frecuentes en el esquema

El backend de gestión de propiedades actualiza con frecuencia su estructura DOM, lo que puede romper los selectores estáticos si no se gestionan dinámicamente.

Scrapea The Piazza con IA

Sin código necesario. Extrae datos en minutos con automatización impulsada por IA.

Cómo Funciona

Describe lo que necesitas

Dile a la IA qué datos quieres extraer de The Piazza. Solo escríbelo en lenguaje natural — sin código ni selectores.

La IA extrae los datos

Nuestra inteligencia artificial navega The Piazza, maneja contenido dinámico y extrae exactamente lo que pediste.

Obtén tus datos

Recibe datos limpios y estructurados listos para exportar como CSV, JSON o enviar directamente a tus aplicaciones.

Por Qué Usar IA para el Scraping

La IA facilita el scraping de The Piazza sin escribir código. Nuestra plataforma impulsada por inteligencia artificial entiende qué datos quieres — solo descríbelo en lenguaje natural y la IA los extrae automáticamente.

How to scrape with AI:

- Describe lo que necesitas: Dile a la IA qué datos quieres extraer de The Piazza. Solo escríbelo en lenguaje natural — sin código ni selectores.

- La IA extrae los datos: Nuestra inteligencia artificial navega The Piazza, maneja contenido dinámico y extrae exactamente lo que pediste.

- Obtén tus datos: Recibe datos limpios y estructurados listos para exportar como CSV, JSON o enviar directamente a tus aplicaciones.

Why use AI for scraping:

- Evasión fluida de sistemas anti-bot: Automatio gestiona los desafíos de Cloudflare y el fingerprinting del navegador de forma automática, garantizando un acceso ininterrumpido a los datos de precios.

- Herramienta de selección visual: Mapea fácilmente los campos de datos de tablas de residencia complejas utilizando una interfaz de apuntar y hacer clic, sin necesidad de escribir CSS o XPath personalizados.

- Programación automatizada: Configura el scraper para que se ejecute diariamente y capture las fluctuaciones de precios de alta frecuencia y los lanzamientos de nuevas unidades sin intervención manual.

- Ejecución de scripts dinámicos: Renderiza perfectamente el contenido basado en React, permitiéndote extraer datos de elementos interactivos que los scrapers tradicionales omiten.

- Integración de datos sin código: Sincroniza tus datos inmobiliarios extraídos directamente con Google Sheets o CRMs a través de Webhooks para un análisis de mercado inmediato.

Scrapers Sin Código para The Piazza

Alternativas de apuntar y clic al scraping con IA

Varias herramientas sin código como Browse.ai, Octoparse, Axiom y ParseHub pueden ayudarte a scrapear The Piazza. Estas herramientas usan interfaces visuales para seleccionar elementos, pero tienen desventajas comparadas con soluciones con IA.

Flujo de Trabajo Típico con Herramientas Sin Código

Desafíos Comunes

Curva de aprendizaje

Comprender selectores y lógica de extracción lleva tiempo

Los selectores se rompen

Los cambios en el sitio web pueden romper todo el flujo de trabajo

Problemas con contenido dinámico

Los sitios con mucho JavaScript requieren soluciones complejas

Limitaciones de CAPTCHA

La mayoría de herramientas requieren intervención manual para CAPTCHAs

Bloqueo de IP

El scraping agresivo puede resultar en el bloqueo de tu IP

Scrapers Sin Código para The Piazza

Varias herramientas sin código como Browse.ai, Octoparse, Axiom y ParseHub pueden ayudarte a scrapear The Piazza. Estas herramientas usan interfaces visuales para seleccionar elementos, pero tienen desventajas comparadas con soluciones con IA.

Flujo de Trabajo Típico con Herramientas Sin Código

- Instalar extensión del navegador o registrarse en la plataforma

- Navegar al sitio web objetivo y abrir la herramienta

- Seleccionar con point-and-click los elementos de datos a extraer

- Configurar selectores CSS para cada campo de datos

- Configurar reglas de paginación para scrapear múltiples páginas

- Resolver CAPTCHAs (frecuentemente requiere intervención manual)

- Configurar programación para ejecuciones automáticas

- Exportar datos a CSV, JSON o conectar vía API

Desafíos Comunes

- Curva de aprendizaje: Comprender selectores y lógica de extracción lleva tiempo

- Los selectores se rompen: Los cambios en el sitio web pueden romper todo el flujo de trabajo

- Problemas con contenido dinámico: Los sitios con mucho JavaScript requieren soluciones complejas

- Limitaciones de CAPTCHA: La mayoría de herramientas requieren intervención manual para CAPTCHAs

- Bloqueo de IP: El scraping agresivo puede resultar en el bloqueo de tu IP

Ejemplos de Código

import requests

from bs4 import BeautifulSoup

# Nota: Es probable que esta solicitud directa falle debido a Cloudflare

# Se recomienda un proxy o una solución de bypass como cloudscraper

url = 'https://www.livepiazza.com/residences'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36',

'Accept-Language': 'en-US,en;q=0.9'

}

def fetch_piazza():

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Ejemplo de selector para tarjetas de residencia

for card in soup.select('.residence-card'):

name = card.select_one('.residence-name').text.strip()

price = card.select_one('.price-value').text.strip()

print(f'Comunidad: {name} | Precio: {price}')

else:

print(f'Bloqueado por Anti-Bot: Status {response.status_code}')

except Exception as e:

print(f'Error: {e}')

fetch_piazza()Cuándo Usar

Mejor para páginas HTML estáticas donde el contenido se carga del lado del servidor. El enfoque más rápido y simple cuando no se requiere renderizado de JavaScript.

Ventajas

- ●Ejecución más rápida (sin sobrecarga del navegador)

- ●Menor consumo de recursos

- ●Fácil de paralelizar con asyncio

- ●Excelente para APIs y páginas estáticas

Limitaciones

- ●No puede ejecutar JavaScript

- ●Falla en SPAs y contenido dinámico

- ●Puede tener dificultades con sistemas anti-bot complejos

Cómo Scrapear The Piazza con Código

Python + Requests

import requests

from bs4 import BeautifulSoup

# Nota: Es probable que esta solicitud directa falle debido a Cloudflare

# Se recomienda un proxy o una solución de bypass como cloudscraper

url = 'https://www.livepiazza.com/residences'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36',

'Accept-Language': 'en-US,en;q=0.9'

}

def fetch_piazza():

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Ejemplo de selector para tarjetas de residencia

for card in soup.select('.residence-card'):

name = card.select_one('.residence-name').text.strip()

price = card.select_one('.price-value').text.strip()

print(f'Comunidad: {name} | Precio: {price}')

else:

print(f'Bloqueado por Anti-Bot: Status {response.status_code}')

except Exception as e:

print(f'Error: {e}')

fetch_piazza()Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def scrape_live_piazza():

async with async_playwright() as p:

# Lanzamiento con un user agent específico para imitar un navegador real

browser = await p.chromium.launch(headless=True)

context = await browser.new_context(user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36')

page = await context.new_page()

await page.goto('https://www.livepiazza.com/alta/')

# Esperar a que se cargue la tabla dinámica de unidades

await page.wait_for_selector('.unit-row', timeout=15000)

units = await page.query_selector_all('.unit-row')

for unit in units:

unit_id = await (await unit.query_selector('.unit-id')).inner_text()

rent = await (await unit.query_selector('.unit-rent')).inner_text()

print(f'Unidad: {unit_id.strip()} | Alquiler: {rent.strip()}')

await browser.close()

asyncio.run(scrape_live_piazza())Python + Scrapy

import scrapy

class PiazzaSpider(scrapy.Spider):

name = 'piazza_spider'

start_urls = ['https://www.livepiazza.com/communities']

def parse(self, response):

# Scrapy requiere un middleware de renderizado de JS (como Scrapy-Playwright) para este sitio

for building in response.css('.building-section'):

yield {

'building_name': building.css('h3.name::text').get(),

'link': building.css('a.explore-btn::attr(href)').get(),

'starting_price': building.css('.starting-from::text').get()

}

# Ejemplo de seguimiento de paginación

next_page = response.css('a.next-page::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

await page.goto('https://www.livepiazza.com/montesino', { waitUntil: 'networkidle2' });

// Esperar a que el contenedor de residencias se renderice

await page.waitForSelector('.residences-container');

const apartmentData = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('.apartment-listing'));

return rows.map(row => ({

type: row.querySelector('.plan-type').innerText,

sqft: row.querySelector('.sqft').innerText,

available: row.querySelector('.availability').innerText

}));

});

console.log(apartmentData);

await browser.close();

})();Qué Puedes Hacer Con Los Datos de The Piazza

Explora aplicaciones prácticas e insights de los datos de The Piazza.

Índice de alquileres en tiempo real

Cree un dashboard en vivo que rastree el promedio de alquiler por pie cuadrado para apartamentos de lujo en Northern Liberties.

Cómo implementar:

- 1Extraer precios diarios para todas las unidades de estudio, 1BR y 2BR.

- 2Normalizar el precio por pie cuadrado para crear una métrica de PPSF.

- 3Visualizar la línea de tendencia durante un período de 90 días.

Usa Automatio para extraer datos de The Piazza y crear estas aplicaciones sin escribir código.

Qué Puedes Hacer Con Los Datos de The Piazza

- Índice de alquileres en tiempo real

Cree un dashboard en vivo que rastree el promedio de alquiler por pie cuadrado para apartamentos de lujo en Northern Liberties.

- Extraer precios diarios para todas las unidades de estudio, 1BR y 2BR.

- Normalizar el precio por pie cuadrado para crear una métrica de PPSF.

- Visualizar la línea de tendencia durante un período de 90 días.

- Análisis de estrategia de concesiones

Analice cómo los administradores de propiedades utilizan los incentivos de 'Alquiler Gratis' para llenar las vacantes en edificios específicos.

- Scrapear el campo de 'Promociones' para cada unidad listada.

- Cruzar las promociones con el número de días que una unidad ha estado listada.

- Determinar el 'punto de inflexión' donde los desarrolladores aumentan los incentivos.

- Estudios de viabilidad de inversión

Utilice los datos para justificar o rechazar nuevos desarrollos de lujo en el área inmediata basados en la oferta y demanda actuales.

- Agregar el número total de unidades disponibles en Alta, Navona y Montesino.

- Segmentar la disponibilidad por 'fecha de mudanza' para pronosticar la absorción de la oferta.

- Comparar los precios de Piazza con los promedios de lujo de toda la ciudad.

- Generación de leads para mudanzas

Identifique ventanas de tiempo con alto volumen de mudanzas para dirigir el marketing de servicios locales de mudanza y limpieza.

- Filtrar los listados scrapeados por 'Disponible ahora' o fechas próximas específicas.

- Apuntar a los edificios con la mayor disponibilidad próxima.

- Alinear el gasto publicitario con los períodos previstos de mayor rotación.

Potencia tu flujo de trabajo con Automatizacion IA

Automatio combina el poder de agentes de IA, automatizacion web e integraciones inteligentes para ayudarte a lograr mas en menos tiempo.

Consejos Pro para Scrapear The Piazza

Consejos expertos para extraer datos exitosamente de The Piazza.

Usa proxies de Filadelfia

Utilizar proxies residenciales ubicados en el área de Filadelfia reduce el riesgo de ser marcado como un bot sospechoso por los filtros regionales.

Espera la hidratación de la tabla

Implementa una condición de 'esperar por elemento' para la lista de residencias para asegurar que la aplicación React se haya hidratado completamente antes de la extracción de datos.

Monitorea los registros de red

Identifica los endpoints JSON internos utilizados por el software de gestión de propiedades del sitio para extraer datos estructurados de manera más eficiente.

Analiza el texto de las promociones

Extrae siempre el texto en los campos de 'Especiales' o 'Promociones' para calcular con precisión el alquiler neto después de las concesiones.

Haz scroll para la extracción de contenido multimedia

Configura tu scraper para hacer scroll hasta el final de las páginas de listados para activar la carga de todas las imágenes de planos de planta y fotos de las unidades.

Rota los User Agents

Cambia entre varias huellas digitales de navegadores de escritorio modernos para evitar la detección basada en firmas de encabezado idénticas y repetitivas.

Testimonios

Lo Que Dicen Nuestros Usuarios

Unete a miles de usuarios satisfechos que han transformado su flujo de trabajo

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados Web Scraping

How to Scrape Century 21 Property Listings

How to Scrape Homes.com: Real Estate Data Extraction Guide

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Sacramento Delta Property Management

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Apartments Near Me | Real Estate Data Scraper

Preguntas Frecuentes Sobre The Piazza

Encuentra respuestas a preguntas comunes sobre The Piazza