GLM-5.1

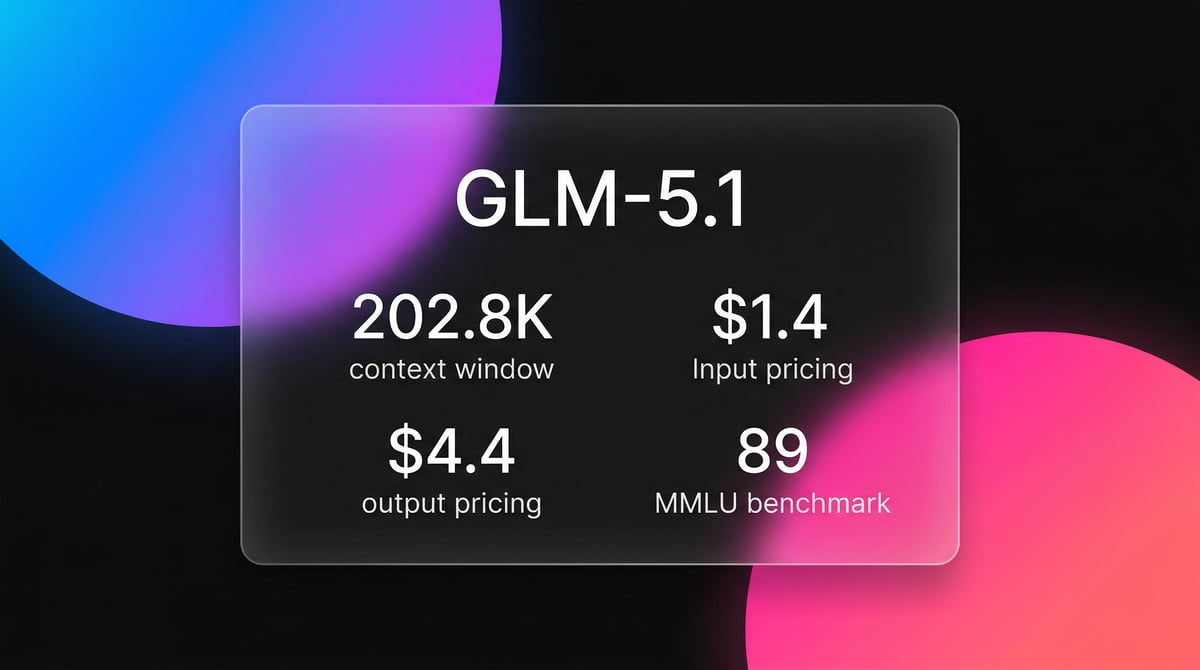

GLM-5.1 es el modelo de reasoning insignia de Zhipu AI, con una context window de 202K y un bucle de ejecución autónomo de 8 horas para ingeniería agentic...

Acerca de GLM-5.1

Conoce las capacidades, características y formas de uso de GLM-5.1.

GLM-5.1 es el modelo fundacional insignia de Zhipu AI diseñado para ingeniería de sistemas complejos y tareas agentic de largo alcance. Construido sobre una arquitectura Mixture-of-Experts (MoE) con 744 mil millones de parámetros y 40 mil millones activos por pasada, representa un salto significativo en resistencia y resolución autónoma de problemas. El modelo está diseñado específicamente para superar los estancamientos de razonamiento observados en modelos de lenguaje anteriores, manteniendo la productividad y la calidad del código a lo largo de miles de llamadas a herramientas y cientos de iteraciones. Identifica bloqueos, ejecuta experimentos y ajusta su propia estrategia sin intervención humana.

Desde el punto de vista técnico, GLM-5.1 destaca como motor de reasoning primario en sistemas multi-agente. Gestiona decisiones arquitectónicas de alto nivel mientras delega la implementación a modelos más pequeños. Cuenta con una context window de 202K respaldada por un mecanismo de atención dispersa dinámica, asegurando la coherencia a través de bases de código masivas. El modelo se publica como pesos abiertos bajo la licencia MIT, proporcionando una alternativa local viable a los frontier models propietarios para tareas como la optimización de bases de datos, ingeniería de kernels de GPU y desarrollo de aplicaciones web full-stack.

Los resultados del KernelBench Nivel 3 muestran que GLM-5.1 mantiene una aceleración significativa en cargas de trabajo de ML agentic durante turnos largos en comparación con Claude Opus 4.6. Esta resistencia permite a los desarrolladores activar una tarea de ingeniería por la mañana y recibir un servicio totalmente probado y desplegado al final del día. Maneja todo el ciclo de vida de una corrección de errores, desde reproducir el problema en un entorno aislado hasta enviar la pull request final.

Casos de uso de GLM-5.1

Descubre las diferentes formas de usar GLM-5.1 para lograr excelentes resultados.

Ingeniería de software autónoma

Se ejecuta de forma autónoma durante más de 8 horas para diseñar, implementar y depurar microservicios sin guía humana.

Optimización de bases de datos de alto rendimiento

El modelo optimiza de forma iterativa implementaciones de búsqueda vectorial basadas en Rust durante cientos de rondas.

Optimización de kernels de GPU

Analiza implementaciones de referencia para producir kernels de GPU más rápidos que superan a los compiladores de autotune predeterminados.

Orquestación multi-agente

Actúa como un núcleo de reasoning que coordina subtareas y llamadas a herramientas en un enjambre de modelos más pequeños especializados.

Tareas complejas de terminal

Ejecuta operaciones de terminal del mundo real y administración de sistemas en varios pasos a través de herramientas CLI agentic.

Diseño web full-stack

El modelo genera diseños de interfaz visualmente coherentes y lógica de backend para entornos de escritorio basados en navegador.

Fortalezas

Limitaciones

Inicio rápido de API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimize this database schema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Instala el SDK y comienza a hacer llamadas API en minutos.

Lo que la gente dice sobre GLM-5.1

Mira lo que la comunidad piensa sobre GLM-5.1

“GLM-5.1 se mantuvo en un bucle con un mismo prompt durante 8 horas seguidas. No se rindió como la mayoría de los modelos; siguió añadiendo funciones y auto-revisándose.”

“Lo he probado bajo estrés hasta 140k de contexto no menos de 5 veces y ha permanecido coherente. SOTA podría tener un competidor.”

“GLM-5.1 está básicamente codo a codo con Opus en este benchmark. Ahora es el modelo abierto número 1 en el Arena.”

“Cada vez que veo a un NPC convencerse genuinamente a través de un diálogo sin guion con GLM-5.1, es pura magia.”

“El rendimiento en codificación es legítimo. Solucionó una condición de carrera en nuestro backend en Go sobre la que GPT-4o seguía alucinando.”

“Ejecutar esto localmente con Unsloth es un cambio de juego para la privacidad de los datos en nuestro stack de tecnología legal.”

Videos sobre GLM-5.1

Mira tutoriales, reseñas y discusiones sobre GLM-5.1

“GLM-5.1 obtuvo un 45.3% en este benchmark, lo cual es un salto sustancial para la familia.”

“Es un modelo increíblemente lento... probablemente tengan la mayoría de sus GPUs todavía sirviendo a GLM-5.”

“La forma en que maneja las llamadas a herramientas es mucho más robusta que la del GLM 5 estándar.”

“Es actualmente el modelo de reasoning más fuerte que puedes descargar y ejecutar en tu propio hardware.”

“Puedes ver cómo identifica sus propios errores en el log de pensamiento.”

“Puede ejecutarse de forma autónoma durante 8 horas, refinando estrategias a través de miles de iteraciones.”

“Supera a Gemini 3.1 Pro y Qwen 3.6 Plus en los benchmarks populares de generación de repositorios.”

“El modo agentic es donde este modelo realmente brilla, no se rinde ante errores difíciles.”

“Z.ai básicamente ha eliminado el muro de pago en un modelo de 744B parámetros de nivel frontier.”

“Gestiona eficazmente el problema del 'estancamiento' donde otros LLMs pierden el enfoque con el tiempo.”

“Reducción de tamaño del 80% desde los 1.65 TB originales a 236GB mientras se mantiene la calidad.”

“El poder del open-source: incluso en una versión cuantizada, escribió código funcional para fuegos artificiales.”

“Necesitarás al menos 256GB de RAM del sistema para siquiera pensar en cargar este gigante MoE.”

“Utiliza un mecanismo de atención dispersa dinámica para mantener esa coherencia de 202k de contexto.”

“Usar Unsloth hace que el proceso de entrenamiento e inference sea significativamente más eficiente.”

Potencia tu flujo de trabajo con Automatizacion IA

Automatio combina el poder de agentes de IA, automatizacion web e integraciones inteligentes para ayudarte a lograr mas en menos tiempo.

Consejos Pro para GLM-5.1

Consejos de expertos para ayudarte a sacar el máximo provecho de GLM-5.1.

Activar el modo de pensamiento (Thinking Mode)

Asegúrate de que la opción 'Thinking' esté habilitada en tu configuración para desbloquear las capacidades de iteración autónoma de 8 horas.

Usar cuotas fuera de hora punta

Ejecuta grandes lotes de ingeniería durante horas de menor actividad fuera del horario de 14:00-18:00 (hora de Pekín) para obtener mejores precios.

Requisitos de memoria local

Utiliza la cuantización Unsloth Dynamic GGUF para que el modelo de 1.6TB quepa en 256GB de memoria del sistema para ejecuciones locales.

Selección estratégica de tareas

Reserva GLM-5.1 para el reasoning arquitectónico y utiliza GLM-4.7 para implementaciones rutinarias para gestionar los costes.

Testimonios

Lo Que Dicen Nuestros Usuarios

Unete a miles de usuarios satisfechos que han transformado su flujo de trabajo

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Preguntas Frecuentes Sobre GLM-5.1

Encuentra respuestas a preguntas comunes sobre GLM-5.1