Qwen3.5-Omni

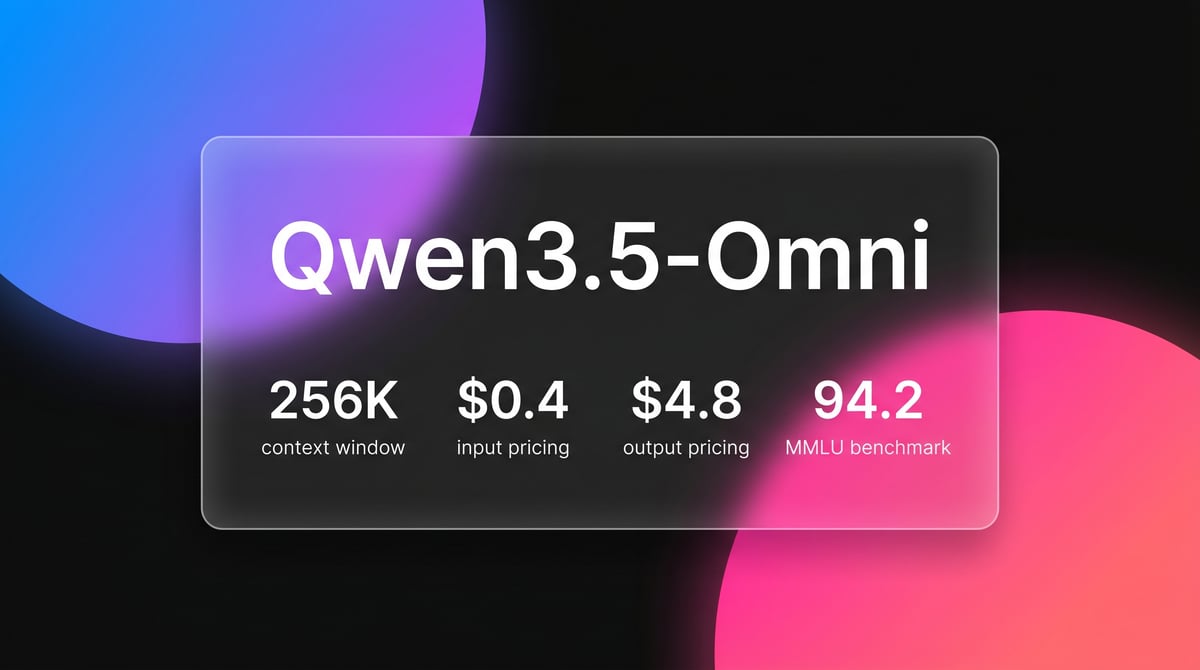

Qwen3.5-Omni es una IA omnimodal nativa de Alibaba Cloud que ofrece razonamiento audiovisual fluido, chat de voz en tiempo real y 256k de contexto para apps de...

Acerca de Qwen3.5-Omni

Conoce las capacidades, características y formas de uso de Qwen3.5-Omni.

Arquitectura omnimodal unificada

Qwen3.5-Omni es un modelo omnimodal nativo desarrollado por Alibaba Cloud, construido sobre una arquitectura unificada diseñada para procesar entradas de texto, imagen, audio y video simultáneamente. A diferencia de modelos previos que dependían de codificadores separados, Qwen3.5-Omni utiliza una arquitectura Thinker-Talker. El componente Thinker realiza un razonamiento multimodal complejo a través de señales intercaladas, mientras que el componente Talker genera voz en streaming de alta calidad y baja latencia. Esto permite al modelo manejar un contexto masivo, incluyendo hasta 10 horas de audio o casi siete minutos de video en 720p en un solo prompt.

Sincronización y rendimiento avanzados

Una característica técnica de este modelo es el sistema Adaptive Rate Interleave Alignment (ARIA), que sincroniza tokens de texto y voz para asegurar respuestas de voz naturales. El modelo admite interrupción semántica en tiempo real, permitiendo a los usuarios interrumpir a la IA durante la conversación. Está optimizado tanto para análisis multimodal de nivel empresarial como para asistentes de voz en tiempo real enfocados al consumidor, ofreciendo un rendimiento en tareas de visión y audio que iguala o supera a modelos flagship propietarios.

Especializado para interacción de baja latencia

La arquitectura del modelo está ajustada específicamente para aplicaciones en tiempo real donde la latencia es crítica. Al utilizar un enfoque Mixture-of-Experts (MoE) con una arquitectura de redes delta con puerta, el modelo mantiene una alta eficiencia computacional. Esta eficiencia le permite proporcionar interacción de audio en tiempo real mientras gestiona una context window de 256k tokens, haciéndolo adecuado para análisis de contenido de larga duración como transcripciones de reuniones e indexación de video cinematográfico.

Casos de uso de Qwen3.5-Omni

Descubre las diferentes formas de usar Qwen3.5-Omni para lograr excelentes resultados.

Asistentes de voz en tiempo real

El modelo crea avatares de IA interactivos que participan en conversaciones de voz naturales con soporte para interrupción semántica.

Subtitulado de video cinematográfico

Genera descripciones a nivel de guion y anotaciones con marcas de tiempo para contenido de video de alta definición de larga duración.

Live coding audiovisual

Los desarrolladores corrigen código mostrando su pantalla y explicando verbalmente la lógica al modelo en tiempo real.

Archivado de audio empresarial

El sistema procesa hasta 10 horas de grabaciones de reuniones o podcasts para extraer información en una sola pasada.

Servicios de traducción multilingüe

Proporciona traducción de voz a voz de extremo a extremo en 113 idiomas y varios dialectos regionales chinos.

Moderación de contenido

El modelo audita transmisiones de video y audio en busca de seguridad identificando contenido visual y verbal prohibido simultáneamente.

Fortalezas

Limitaciones

Inicio rápido de API

alibaba/qwen3.5-omni-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

const completion = await client.chat.completions.create({

model: 'qwen3.5-omni-plus',

messages: [{ role: 'user', content: 'Analyze this video content.' }],

modalities: ['text'],

stream: true,

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Instala el SDK y comienza a hacer llamadas API en minutos.

Lo que la gente dice sobre Qwen3.5-Omni

Mira lo que la comunidad piensa sobre Qwen3.5-Omni

“El "Audio-Visual Vibe Coding" cambia las reglas del juego; finalmente entiende lo que estoy mostrando en pantalla mientras explico el bug.”

“La capacidad de Qwen3.5-Omni para manejar 10 horas de audio en un solo contexto es una locura para investigadores y podcasters.”

“La clonación de voz suena sorprendentemente natural comparada con la generación anterior, casi indistinguible en inglés.”

“Finalmente, un modelo que no solo me corta a mitad de la oración; la interrupción semántica funciona según lo anunciado.”

“Números impresionantes en el nuevo Qwen3.6 27B, pero la versión Omni es la que todos usarán para productos reales.”

“Intenté interrumpirlo cinco veces y captó mi intención cada vez.”

Videos sobre Qwen3.5-Omni

Mira tutoriales, reseñas y discusiones sobre Qwen3.5-Omni

“La arquitectura Thinker-Talker es un salto gigantesco para la latencia en tiempo real [04:15].”

“Maneja 400 segundos de video, que es el doble de lo que solemos ver [07:22].”

“Este modelo es multilingüe y multimodal nativo de extremo a extremo [10:05].”

“El sistema ARIA evita los errores de pronunciación encontrados en TTS estándar [15:30].”

“Puedes mostrar literalmente tu pantalla y tener una conversación fluida sobre el código [22:10].”

“Intenté interrumpirlo cinco veces y captó mi intención cada vez [08:30].”

“La forma en que escribe código basado en lo que ve en el video es asombrosa [10:45].”

“Este es el primer competidor real del modo de voz de GPT-4o que hemos visto [14:20].”

“Admite 113 idiomas para reconocimiento de voz, lo cual es una gran ventaja [18:55].”

“La extracción de visión es mucho más robusta para PDFs complejos y video [25:15].”

“El contexto de audio de 10 horas es la verdadera estrella aquí para uso empresarial [12:10].”

“El rendimiento en idiomas distintos al inglés es donde Qwen realmente toma la delantera [15:40].”

“Puede distinguir entre ruido de fondo y una interrupción real del usuario [19:22].”

“El precio es muy competitivo, especialmente por la escala de parameters activos [24:10].”

“Es actualmente el modelo más capaz para la automatización en Python que involucra IU visual [28:45].”

Potencia tu flujo de trabajo con Automatizacion IA

Automatio combina el poder de agentes de IA, automatizacion web e integraciones inteligentes para ayudarte a lograr mas en menos tiempo.

Consejos Pro para Qwen3.5-Omni

Consejos de expertos para ayudarte a sacar el máximo provecho de Qwen3.5-Omni.

Optimizar la ingesta de audio

Segmenta el audio de más de 10 horas para mantener la precisión de recuperación factual dentro de la context window de 256k.

Aprovechar la interrupción semántica

Habilita las funciones nativas de turnos en las aplicaciones de voz para distinguir la intención del usuario del ruido de fondo.

Usar ARIA para términos técnicos

Utiliza el modo de voz en streaming para beneficiarte de la alineación ARIA, lo cual asegura que los números técnicos se pronuncien con precisión.

Control de frecuencia de fotogramas en video

Sube videos estándar a 1 FPS, pero aumenta la tasa en escenas de mucha acción para asegurar la precisión visual.

Testimonios

Lo Que Dicen Nuestros Usuarios

Unete a miles de usuarios satisfechos que han transformado su flujo de trabajo

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

GPT-5.4

OpenAI

GPT-5.4 is OpenAI's frontier model featuring a 1.05M context window and Extreme Reasoning. It excels at autonomous UI interaction and long-form data analysis.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.3 Codex

OpenAI

GPT-5.3 Codex is OpenAI's 2026 frontier coding agent, featuring a 400K context window, 77.3% Terminal-Bench score, and superior logic for complex software...

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Preguntas Frecuentes Sobre Qwen3.5-Omni

Encuentra respuestas a preguntas comunes sobre Qwen3.5-Omni