Qwen3-Coder-Next

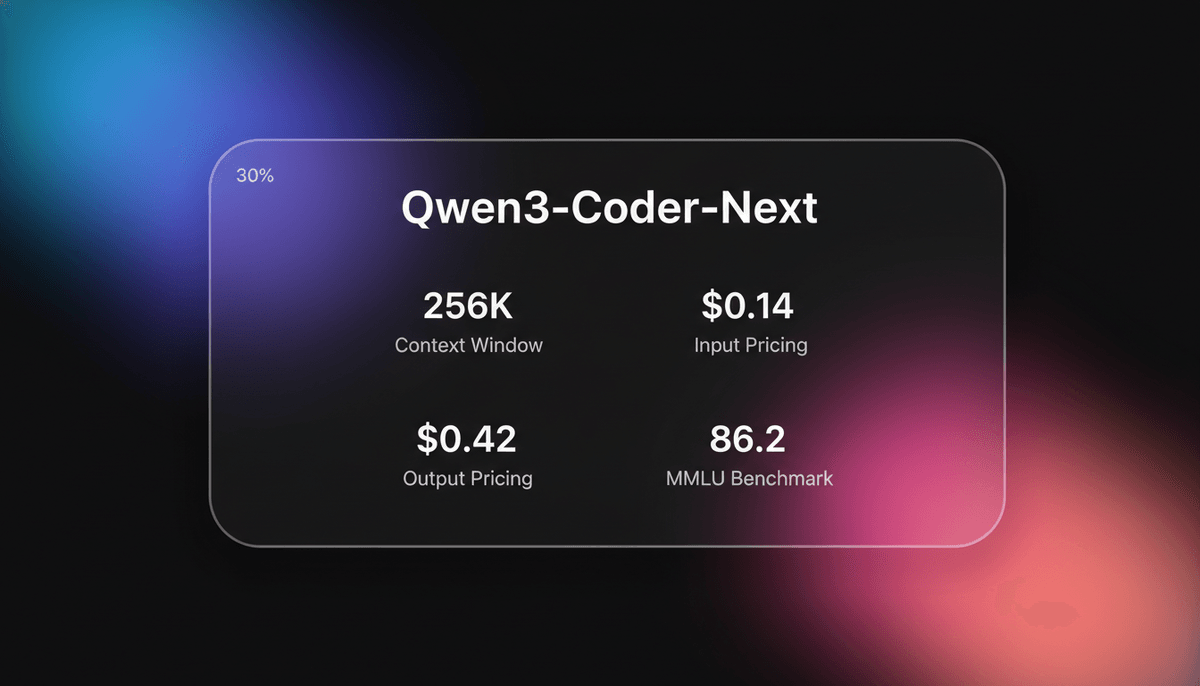

Qwen3-Coder-Next es el model de programación Apache 2.0 de élite de Alibaba Cloud, que cuenta con una arquitectura MoE de 80B y una ventana de contexto de 256k...

Acerca de Qwen3-Coder-Next

Conoce las capacidades, características y formas de uso de Qwen3-Coder-Next.

Arquitectura del model

Qwen3-Coder-Next es un model open-weights especializado diseñado por Alibaba Cloud para agentes de ingeniería de software. Utiliza una arquitectura de Mixture-of-Experts (MoE) con 80 mil millones de parámetros totales, pero solo activa 3 mil millones por token. Este diseño combina la inteligencia de un model masivo con la velocidad de inferencia de uno pequeño. La arquitectura incluye un mecanismo de atención híbrido, integrando Gated DeltaNet con Gated Attention estándar para procesar contextos de hasta 262,144 tokens.

Especialización agentic

El model está entrenado en más de 800,000 tareas de programación verificables y entornos ejecutables. Este entrenamiento enfatiza el reasoning de largo alcance y la capacidad de recuperarse de fallos de ejecución. Obtiene una puntuación del 70.8% en SWE-Bench Verified, lo que demuestra su capacidad para manejar tareas de desarrollo multietapa, desde la planificación inicial hasta la ejecución final del código. Destaca en marcos de trabajo agentic autónomos como OpenClaw y Qwen Code.

Despliegue y Privacidad

Con licencia Apache 2.0, este model proporciona una alternativa segura para los desarrolladores que requieren entornos de desarrollo locales y privados. Puede ejecutarse en hardware de consumo con suficiente RAM mediante cuantización. La ventana de contexto alta permite el análisis a escala de repositorio sin la degradación del rendimiento que normalmente se observa en models con menor contexto.

Casos de uso de Qwen3-Coder-Next

Descubre las diferentes formas de usar Qwen3-Coder-Next para lograr excelentes resultados.

Agentes de programación autónomos

Potencia marcos de trabajo para manejar tareas de desarrollo de varios pasos, desde la planificación hasta la ejecución final.

Desarrollo privado local

Ejecuta asistencia de programación de élite en GPUs de consumo con 16GB VRAM usando capas MoE cuantizadas.

Análisis de repositorios a gran escala

Procesa bases de código completas dentro de su ventana de 256k para identificar deuda técnica.

Reparación y refactorización de código

Actualiza código heredado a estándares modernos proporcionando retroalimentación de entornos ejecutables.

Scripting multilingüe

Genera código de alta fidelidad en más de 40 lenguajes de programación, incluidos Rust y Go.

Simulación 3D interactiva

Construye visualizadores y simulaciones complejas basadas en web mediante generación rápida de un solo intento (one-shot).

Fortalezas

Limitaciones

Inicio rápido de API

alibaba/qwen-3-coder-next

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: "https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

});

async function main() {

const completion = await client.chat.completions.create({

model: "qwen3-coder-next",

messages: [

{ role: "system", content: "Eres un asistente de programación profesional." },

{ role: "user", content: "Escribe un componente de React para una lista ordenable." },

],

});

console.log(completion.choices[0].message.content);

}

main();Instala el SDK y comienza a hacer llamadas API en minutos.

Lo que la gente dice sobre Qwen3-Coder-Next

Mira lo que la comunidad piensa sobre Qwen3-Coder-Next

“Casi iguala a Claude en capacidades generales de programación. Supera a Claude 3.5 Sonnet en HumanEval con un 92.7%.”

“La eficiencia de la versión MoE es una locura para el hardware local. Estoy obteniendo 26 TPS en un sistema de gama media.”

“La decodificación auto-especulativa es matemáticamente imposible para Qwen Coder Next debido a los estados recurrentes.”

“¡Qwen3-Coder-Next está basado en MoE, y es mucho más fuerte e inteligente que antes!”

“Demostrando la capacidad de cambiar de proveedor a mitad del proyecto con las nuevas variantes del model de 480B.”

“La receta de entrenamiento agentic en 800k tareas se nota en la forma en que se recupera de errores de compilación.”

Videos sobre Qwen3-Coder-Next

Mira tutoriales, reseñas y discusiones sobre Qwen3-Coder-Next

“Permite que sea accesible para personas que quieren jugar con agentes de programación con IA local”

“Esto para mí es un grito para probar este model de código abierto, lo cual haré”

“La eficiencia de memoria en esto es una gran victoria”

“Maneja la lógica compleja mejor que el anterior model denso de 72B”

“Este es el primer model abierto que sigue correctamente mis comandos de terminal”

“Qwen 3 coder Next también tiene solo 3 mil millones de parámetros activos para ejecutarse en una tarjeta gráfica de consumo”

“Funciona de maravilla. Estoy realmente sorprendido de poder obtener este resultado de una sola vez desde IA local”

“80 mil millones de parámetros generalmente requieren un clúster, pero el enfoque MoE lo cambia todo”

“Maneja más de 40 lenguajes de programación sin ninguna caída notable en el rendimiento”

“Usarlo con OpenClaw hace que se sienta como tener un desarrollador junior en el equipo”

“Un model de tres mil millones de parámetros enfrentándose cara a cara con models de 10 a 20 veces su tamaño”

“Qwen 3 viene con muchas ventajas pero con un costo menor”

“El contexto de 256k es real, no alucinó en medio de mi proyecto”

“La latencia es sorprendentemente baja dado el peso total de 80B de parámetros”

“Corrigió un error en mi repositorio de Go heredado que GPT-4o pasó por alto tres veces”

Potencia tu flujo de trabajo con Automatizacion IA

Automatio combina el poder de agentes de IA, automatizacion web e integraciones inteligentes para ayudarte a lograr mas en menos tiempo.

Consejos Pro para Qwen3-Coder-Next

Consejos de expertos para ayudarte a sacar el máximo provecho de Qwen3-Coder-Next.

Usa System Prompts largos

Proporciona al model ejemplos detallados y documentación para alinear su comportamiento agentic.

Retroalimentación de errores iterativa

Introduce los registros de error de la consola del navegador en el model para una autocorrección de alta tasa de éxito.

Optimiza la descarga de capas

Descarga capas de expertos MoE específicas a la RAM del sistema para equilibrar la velocidad de inferencia y el reasoning.

Alinea los parámetros de muestreo

Usa una temperatura de 1.0 con top_p 0.95 y top_k 40 para obtener los resultados de codificación más precisos.

Testimonios

Lo Que Dicen Nuestros Usuarios

Unete a miles de usuarios satisfechos que han transformado su flujo de trabajo

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Relacionados AI Models

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiniMax M2.5

minimax

MiniMax M2.5 is a SOTA MoE model featuring a 1M context window and elite agentic coding capabilities at disruptive pricing for autonomous agents.

GLM-4.7

Zhipu (GLM)

GLM-4.7 by Zhipu AI is a flagship 358B MoE model featuring a 200K context window, elite 73.8% SWE-bench performance, and native Deep Thinking for agentic...

GPT-4o mini

OpenAI

OpenAI's most cost-efficient small model, GPT-4o mini offers multimodal intelligence and high-speed performance at a significantly lower price point.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Preguntas Frecuentes Sobre Qwen3-Coder-Next

Encuentra respuestas a preguntas comunes sobre Qwen3-Coder-Next