Comment scraper les annonces immobilières de Century 21

Découvrez comment scraper les annonces, les prix et les détails des agents sur Century 21. Contournez Akamai et CloudFront pour extraire des données...

Protection Anti-Bot Détectée

- Akamai Bot Manager

- Détection avancée des bots par empreinte d'appareil, analyse comportementale et apprentissage automatique. L'un des systèmes anti-bot les plus sophistiqués.

- Cloudflare

- WAF et gestion de bots de niveau entreprise. Utilise des défis JavaScript, des CAPTCHAs et l'analyse comportementale. Nécessite l'automatisation du navigateur avec des paramètres furtifs.

- CloudFront

- PerimeterX (HUMAN)

- Biométrie comportementale et analyse prédictive. Détecte l'automatisation par les mouvements de souris, les schémas de frappe et l'interaction avec la page.

- Limitation de débit

- Limite les requêtes par IP/session dans le temps. Peut être contourné avec des proxys rotatifs, des délais de requête et du scraping distribué.

- User-Agent Profiling

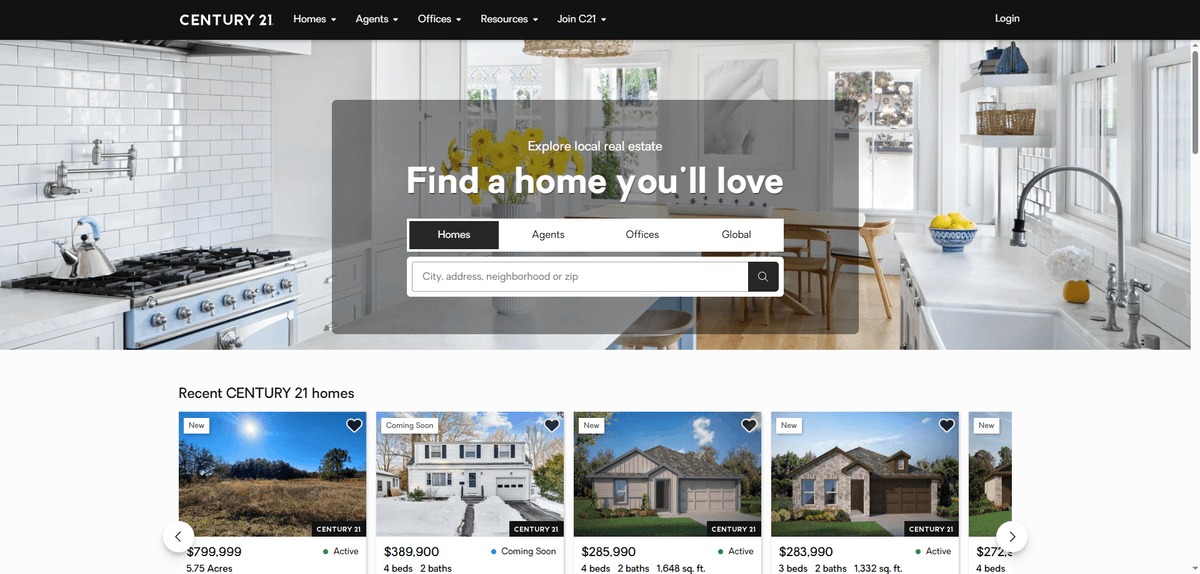

À Propos de Century 21

Découvrez ce que Century 21 offre et quelles données précieuses peuvent être extraites.

Century 21 Real Estate LLC est l'un des réseaux de franchises immobilières résidentielles les plus vastes et les plus reconnus au monde. Fondé en 1971 et actuellement filiale de Anywhere Real Estate, il opère à travers un réseau massif de milliers de bureaux détenus et gérés de manière indépendante dans plus de 80 pays. La plateforme sert de répertoire principal pour des millions d'annonces immobilières résidentielles et commerciales à travers le globe.

Le site web fournit des données immobilières complètes, notamment les prix, les spécifications architecturales et les coordonnées des agents. Représentant un marché vaste et fragmenté, le site est une source critique d'informations immobilières en temps réel. Les analystes utilisent ces données pour suivre les volumes d'annonces, les ajustements de prix et les évolutions de la demande régionale qui ne sont souvent pas capturés rapidement par les registres gouvernementaux officiels.

Le scraping des données de Century 21 est extrêmement précieux pour les investisseurs immobiliers, les développeurs prop-tech et les chercheurs de marché. Il permet la création de modèles d'évaluation automatisés (AVM), l'analyse comparative concurrentielle (benchmark) pour les agences et la génération de leads pour des services secondaires tels que l'assurance habitation ou le crédit immobilier. La portée mondiale des données les rend particulièrement utiles pour comparer les tendances immobilières internationales.

Pourquoi Scraper Century 21?

Découvrez la valeur commerciale et les cas d'utilisation pour l'extraction de données de Century 21.

Analyse des Tendances du Marché

Surveillez les fluctuations de prix régionales et les niveaux de stock pour identifier les points chauds immobiliers émergents avant qu'ils n'atteignent leur apogée.

Recherche d'Investissements

Suivez la métrique 'Jours sur le marché' pour trouver des vendeurs motivés et identifier des propriétés sous-évaluées pour un investissement potentiel.

Intelligence Compétitive

Analysez les volumes d'annonces et les taux de réussite des agences concurrentes pour déterminer les parts de marché localisées.

Génération de Leads pour Services

Identifiez les nouvelles annonces pour proposer des services professionnels tels que la photographie immobilière, le home staging ou le courtage en crédit immobilier.

Base de Données Historique des Prix

Constituez des ensembles de données à long terme pour entraîner des modèles de machine learning prédictifs afin de prévoir les futurs cycles du marché immobilier.

Défis du Scraping

Défis techniques que vous pouvez rencontrer lors du scraping de Century 21.

Détection Anti-Bot Avancée

Le site utilise Akamai Bot Manager et Cloudflare, qui emploient l'analyse comportementale pour bloquer les scripts automatisés.

Rendu de Contenu Dynamique

Les annonces sont souvent chargées via des frameworks JavaScript comme React, nécessitant un rendu complet du navigateur pour accéder aux données.

Limitation de Débit IP Agressive

L'envoi de trop de requêtes à partir d'une seule adresse IP déclenche rapidement des erreurs 403 Forbidden ou des défis reCAPTCHA.

Variance des Sous-domaines Régionaux

Les différents sous-domaines géographiques peuvent avoir des structures HTML légèrement différentes, nécessitant une logique de scraping flexible.

Scrapez Century 21 avec l'IA

Aucun code requis. Extrayez des données en minutes avec l'automatisation par IA.

Comment ça marche

Décrivez ce dont vous avez besoin

Dites à l'IA quelles données vous souhaitez extraire de Century 21. Tapez simplement en langage naturel — pas de code ni de sélecteurs.

L'IA extrait les données

Notre intelligence artificielle navigue sur Century 21, gère le contenu dynamique et extrait exactement ce que vous avez demandé.

Obtenez vos données

Recevez des données propres et structurées, prêtes à exporter en CSV, JSON ou à envoyer directement à vos applications.

Pourquoi utiliser l'IA pour le scraping

L'IA facilite le scraping de Century 21 sans écrire de code. Notre plateforme alimentée par l'intelligence artificielle comprend quelles données vous voulez — décrivez-les en langage naturel et l'IA les extrait automatiquement.

How to scrape with AI:

- Décrivez ce dont vous avez besoin: Dites à l'IA quelles données vous souhaitez extraire de Century 21. Tapez simplement en langage naturel — pas de code ni de sélecteurs.

- L'IA extrait les données: Notre intelligence artificielle navigue sur Century 21, gère le contenu dynamique et extrait exactement ce que vous avez demandé.

- Obtenez vos données: Recevez des données propres et structurées, prêtes à exporter en CSV, JSON ou à envoyer directement à vos applications.

Why use AI for scraping:

- Sélection Visuelle Sans Code: Sélectionnez les points de données immobilières comme le prix et l'adresse directement dans le navigateur sans écrire de sélecteurs CSS complexes.

- Gestion Automatisée des Proxies: Contournez les blocages basés sur l'IP sans effort grâce au système de rotation de proxies résidentiels intégré d'Automatio.

- Rendu via Navigateur Headless: Exécute automatiquement le JavaScript pour garantir que les fiches d'annonces et les images dynamiques sont entièrement chargées avant l'extraction.

- Planification Basée sur le Cloud: Planifiez votre scraper pour qu'il s'exécute quotidiennement ou toutes les heures afin de capturer les nouvelles annonces et les changements de prix sans intervention manuelle.

- Intégration de Données Fluide: Exportez les données immobilières scrapées directement vers Google Sheets ou utilisez des webhooks pour synchroniser avec votre CRM ou base de données.

Scrapers Web No-Code pour Century 21

Alternatives pointer-cliquer au scraping alimenté par l'IA

Plusieurs outils no-code comme Browse.ai, Octoparse, Axiom et ParseHub peuvent vous aider à scraper Century 21 sans écrire de code. Ces outils utilisent généralement des interfaces visuelles pour sélectionner les données, bien qu'ils puissent avoir des difficultés avec le contenu dynamique complexe ou les mesures anti-bot.

Workflow Typique avec les Outils No-Code

Défis Courants

Courbe d'apprentissage

Comprendre les sélecteurs et la logique d'extraction prend du temps

Les sélecteurs cassent

Les modifications du site web peuvent casser tout le workflow

Problèmes de contenu dynamique

Les sites riches en JavaScript nécessitent des solutions complexes

Limitations des CAPTCHAs

La plupart des outils nécessitent une intervention manuelle pour les CAPTCHAs

Blocage d'IP

Le scraping agressif peut entraîner le blocage de votre IP

Scrapers Web No-Code pour Century 21

Plusieurs outils no-code comme Browse.ai, Octoparse, Axiom et ParseHub peuvent vous aider à scraper Century 21 sans écrire de code. Ces outils utilisent généralement des interfaces visuelles pour sélectionner les données, bien qu'ils puissent avoir des difficultés avec le contenu dynamique complexe ou les mesures anti-bot.

Workflow Typique avec les Outils No-Code

- Installer l'extension de navigateur ou s'inscrire sur la plateforme

- Naviguer vers le site web cible et ouvrir l'outil

- Sélectionner en point-and-click les éléments de données à extraire

- Configurer les sélecteurs CSS pour chaque champ de données

- Configurer les règles de pagination pour scraper plusieurs pages

- Gérer les CAPTCHAs (nécessite souvent une résolution manuelle)

- Configurer la planification pour les exécutions automatiques

- Exporter les données en CSV, JSON ou se connecter via API

Défis Courants

- Courbe d'apprentissage: Comprendre les sélecteurs et la logique d'extraction prend du temps

- Les sélecteurs cassent: Les modifications du site web peuvent casser tout le workflow

- Problèmes de contenu dynamique: Les sites riches en JavaScript nécessitent des solutions complexes

- Limitations des CAPTCHAs: La plupart des outils nécessitent une intervention manuelle pour les CAPTCHAs

- Blocage d'IP: Le scraping agressif peut entraîner le blocage de votre IP

Exemples de Code

import requests

from bs4 import BeautifulSoup

# Des en-têtes réalistes sont obligatoires pour contourner les blocages CloudFront basiques

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36',

'Accept-Language': 'fr-FR,fr;q=0.9'

}

def scrape_c21(url):

try:

# Les objets Session aident à maintenir les cookies entre les requêtes

session = requests.Session()

response = session.get(url, headers=headers, timeout=15)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Les sélecteurs ciblent les classes communes des fiches immobilières

listings = soup.select('.property-card')

for item in listings:

price = item.select_one('.listing-price').text.strip() if item.select_one('.listing-price') else 'N/A'

address = item.select_one('.property-address').text.strip() if item.select_one('.property-address') else 'N/A'

print(f'Prix: {price}, Adresse: {address}')

else:

print(f'Bloqué: HTTP {response.status_code}')

except Exception as e:

print(f'Erreur: {e}')

scrape_c21('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/')Quand Utiliser

Idéal pour les pages HTML statiques avec peu de JavaScript. Parfait pour les blogs, sites d'actualités et pages e-commerce simples.

Avantages

- ●Exécution la plus rapide (sans surcharge navigateur)

- ●Consommation de ressources minimale

- ●Facile à paralléliser avec asyncio

- ●Excellent pour les APIs et pages statiques

Limitations

- ●Ne peut pas exécuter JavaScript

- ●Échoue sur les SPAs et contenu dynamique

- ●Peut avoir des difficultés avec les systèmes anti-bot complexes

Comment Scraper Century 21 avec du Code

Python + Requests

import requests

from bs4 import BeautifulSoup

# Des en-têtes réalistes sont obligatoires pour contourner les blocages CloudFront basiques

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36',

'Accept-Language': 'fr-FR,fr;q=0.9'

}

def scrape_c21(url):

try:

# Les objets Session aident à maintenir les cookies entre les requêtes

session = requests.Session()

response = session.get(url, headers=headers, timeout=15)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Les sélecteurs ciblent les classes communes des fiches immobilières

listings = soup.select('.property-card')

for item in listings:

price = item.select_one('.listing-price').text.strip() if item.select_one('.listing-price') else 'N/A'

address = item.select_one('.property-address').text.strip() if item.select_one('.property-address') else 'N/A'

print(f'Prix: {price}, Adresse: {address}')

else:

print(f'Bloqué: HTTP {response.status_code}')

except Exception as e:

print(f'Erreur: {e}')

scrape_c21('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/')Python + Playwright

from playwright.sync_api import sync_playwright

def run(playwright):

# Lancement d'un navigateur pour gérer les fiches immobilières riches en JavaScript

browser = playwright.chromium.launch(headless=True)

context = browser.new_context(user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36')

page = context.new_page()

# Navigation et attente de la stabilisation du réseau

page.goto('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/', wait_until='networkidle')

# S'assurer que le conteneur de propriété est visible avant l'extraction

page.wait_for_selector('.property-card')

listings = page.query_selector_all('.property-card')

for listing in listings:

price_el = listing.query_selector('.listing-price')

addr_el = listing.query_selector('.property-address')

if price_el and addr_el:

print(f'Prix: {price_el.inner_text()} | Adresse: {addr_el.inner_text()}')

browser.close()

with sync_playwright() as playwright:

run(playwright)Python + Scrapy

import scrapy

class C21Spider(scrapy.Spider):

name = 'c21_spider'

start_urls = ['https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/']

def parse(self, response):

# Les sélecteurs CSS de Scrapy sont efficaces pour l'extraction de masse

for property in response.css('.property-card'):

yield {

'price': property.css('.listing-price::text').get(default='').strip(),

'address': property.css('.property-address::text').get(default='').strip(),

'details_url': response.urljoin(property.css('a::attr(href)').get())

}

# Localiser et suivre le bouton de la page suivante

next_page = response.css('a.next-page::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

(async () => {

// Utilisation du plugin Stealth pour masquer Puppeteer de la détection Akamai

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

await page.goto('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/', { waitUntil: 'networkidle2' });

const results = await page.evaluate(() => {

const data = [];

document.querySelectorAll('.property-card').forEach(card => {

data.push({

price: card.querySelector('.listing-price')?.innerText.trim(),

address: card.querySelector('.property-address')?.innerText.trim(),

});

});

return data;

});

console.log(results);

await browser.close();

})();Que Pouvez-Vous Faire Avec Les Données de Century 21

Explorez les applications pratiques et les insights des données de Century 21.

Alertes de Prix Dynamiques

Les investisseurs peuvent suivre les réductions de prix dans des codes postaux spécifiques pour trouver immédiatement des vendeurs motivés.

Comment implémenter :

- 1Sélectionner une zone géographique cible sur Century 21.

- 2Scraper les annonces actives quotidiennement et les stocker dans une base de données.

- 3Comparer les prix actuels avec le prix précédemment enregistré pour le même ID d'annonce.

- 4Envoyer une alerte automatisée si un prix baisse de plus d'un pourcentage défini.

Utilisez Automatio pour extraire des données de Century 21 et créer ces applications sans écrire de code.

Que Pouvez-Vous Faire Avec Les Données de Century 21

- Alertes de Prix Dynamiques

Les investisseurs peuvent suivre les réductions de prix dans des codes postaux spécifiques pour trouver immédiatement des vendeurs motivés.

- Sélectionner une zone géographique cible sur Century 21.

- Scraper les annonces actives quotidiennement et les stocker dans une base de données.

- Comparer les prix actuels avec le prix précédemment enregistré pour le même ID d'annonce.

- Envoyer une alerte automatisée si un prix baisse de plus d'un pourcentage défini.

- Benchmark de Performance des Agences

Les propriétaires d'agences immobilières peuvent surveiller le volume d'annonces de Century 21 pour évaluer leur propre part de marché locale.

- Extraire le Nom de l'Agence et le Nom de l'Agent à partir des résultats de recherche régionaux.

- Agréger le nombre total d'annonces par agence.

- Calculer le prix médian des annonces pour chaque agence concurrente.

- Identifier les agents les plus performants pour un recrutement potentiel.

- Génération de Leads pour le Crédit Immobilier

Les prêteurs peuvent identifier les propriétés passant au statut 'Nouveau' pour proposer des solutions de financement aux acheteurs potentiels.

- Scraper les nouvelles annonces quotidiennement en utilisant les filtres 'Nouveau' ou 'Jours sur le site'.

- Filtrer les annonces par tranche de prix pertinente pour vos produits de prêt.

- Extraire les coordonnées de l'agent immobilier pour des campagnes de prospection B2B.

- Surveiller les changements de statut des propriétés pour synchroniser les efforts marketing.

- Agrégation de Contenu Prop-Tech

Les développeurs peuvent alimenter de nouvelles applications immobilières avec un inventaire en direct pour offrir de la valeur à leurs utilisateurs.

- Scraper les détails complets des propriétés, y compris les images et les équipements.

- Normaliser les données dans un format JSON standard pour votre API.

- Télécharger les données vers la base de données backend de votre application.

- Actualiser les données toutes les 24 heures pour garantir l'exactitude des annonces.

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Scraper Century 21

Conseils d'experts pour extraire avec succès les données de Century 21.

Prioriser les Proxies Résidentiels

Les adresses IP de centres de données sont facilement détectées par Akamai ; les proxies résidentiels offrent de meilleurs taux de réussite en imitant le trafic domestique réel.

Utiliser des Plugins de Navigateur Furtifs

Utilisez des bibliothèques comme puppeteer-extra-plugin-stealth pour masquer les empreintes numériques des navigateurs automatisés face aux détecteurs de bots avancés.

Extraire à partir des Balises JSON-LD

Vérifiez le code source HTML pour les balises script de type application/ld+json, qui contiennent souvent des données d'annonces pré-formatées.

Implémenter des Délais Aléatoires

Évitez une cadence fixe pour vos requêtes ; la randomisation des temps d'attente entre 3 et 10 secondes aide à échapper à la détection comportementale.

Cibler les User-Agents Mobiles

Parfois, les versions mobiles du site comportent moins de vérifications anti-bot ou des structures DOM plus simples que les versions de bureau.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés Web Scraping

How to Scrape Homes.com: Real Estate Data Extraction Guide

How to Scrape LivePiazza: Philadelphia Real Estate Scraper

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Sacramento Delta Property Management

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape Apartments Near Me | Real Estate Data Scraper

Questions Fréquentes sur Century 21

Trouvez des réponses aux questions courantes sur Century 21