GPT-5.4

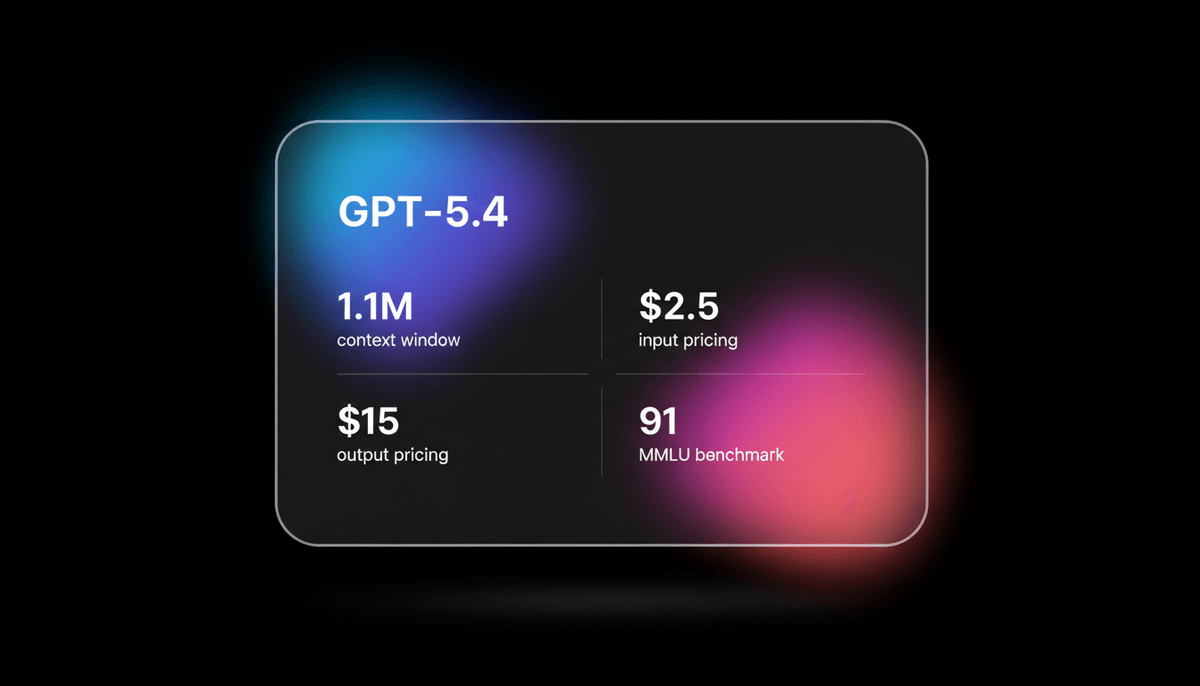

GPT-5.4 est le modèle frontier d'OpenAI avec une context window de 1,05M et un Extreme Reasoning. Il excelle dans l'interaction UI autonome et l'analyse de...

À propos de GPT-5.4

Découvrez les capacités, fonctionnalités et façons d'utiliser GPT-5.4.

La frontière du reasoning à contexte long

GPT-5.4 représente l'évolution haute performance de la série GPT-5. Il est doté d'une context window de 1,05 million de tokens, leader de l'industrie. Ce modèle traite des jeux de données extensifs, tels que des dépôts de code massifs ou des logs historiques pluriannuels, sans perdre en fidélité de reasoning. Le Mid-Response Steering interactif permet aux utilisateurs de surveiller et d'ajuster le plan de réflexion du modèle en temps réel. Cela garantit que la sortie est alignée avec des intentions complexes et multi-étapes.

Intelligence unifiée et action autonome

Techniquement, GPT-5.4 unifie les forces de codage de classe mondiale des branches Codex précédentes avec les nuances créatives de la série standard GPT-5. Il propose un mode Thinking spécialisé avec des niveaux d'effort ajustables (Standard, Extended et Heavy). Il utilise un traitement de chain-of-thought renforcé pour résoudre des problèmes scientifiques et logiques de niveau doctorat. Au-delà du texte, GPT-5.4 introduit des capacités de computer use natives. Il atteint un score de 75 % sur les tâches vérifiées par OSWorld en interprétant des captures d'écran et en exécutant des clics basés sur des coordonnées.

Efficacité et fiabilité

OpenAI rapporte une baisse de 33 % des erreurs au niveau des affirmations par rapport à ses prédécesseurs, faisant de GPT-5.4 un choix de premier ordre pour les agents autonomes et le support à la décision à fort enjeu. Il est conçu pour une efficacité énergétique et en tokens optimale, permettant un traitement du contexte long plus économique que les itérations précédentes. Qu'il s'agisse de gérer une base de code d'entreprise entière ou d'agir en tant qu'agent de planification autonome, GPT-5.4 établit une nouvelle norme en matière de fiabilité et de performance agentic.

Cas d'utilisation de GPT-5.4

Découvrez les différentes façons d'utiliser GPT-5.4 pour obtenir d'excellents résultats.

Refactoring de code à grande échelle

Réécriture systématique de bases de code héritées dépassant 300 000 lignes dans le strict respect des normes architecturales.

Modélisation financière autonome

Construction de modèles complexes à trois états où l'IA réconcilie les comptes de résultat, les bilans et les flux de trésorerie.

Conception de systèmes interactifs

Développement de simulations 3D ou de jeux basés sur la physique en pilotant le chemin logique du modèle pendant la génération.

Agentic Computer Use

Exécution de tâches de bureau en plusieurs étapes telles que la saisie massive de données, la gestion d'e-mails et les tests de logiciels via une interaction native avec l'interface.

Analyse juridique à long contexte

Croisement de centaines de documents juridiques pour identifier des incohérences ou extraire des clauses spécifiques avec une grande précision de rappel.

Support à la recherche de niveau doctorat

Résolution de preuves mathématiques complexes et de problèmes scientifiques en utilisant le mode Heavy Reasoning pour des chaînes logiques vérifiées.

Points forts

Limitations

Démarrage rapide API

openai/gpt-5.4

import OpenAI from "openai";

const openai = new OpenAI();

async function main() {

const completion = await openai.chat.completions.create({

model: "gpt-5.4",

messages: [

{ role: "user", content: "Refactor this controller for better error handling." }

],

reasoning_effort: "heavy"

});

console.log(completion.choices[0].message.content);

}

main();Installez le SDK et commencez à faire des appels API en quelques minutes.

Ce que les gens disent de GPT-5.4

Voyez ce que la communauté pense de GPT-5.4

“GPT 5.4 dans Codex est une amélioration énorme... Je l'ai vu travailler pendant 150 minutes sans perdre le contexte.”

“Les capacités de conception 3D de GPT 5.4 sont inégalées. La façon dont il a géré la transparence et la physique dans mon simulateur de vaisseau était effrayante de précision.”

“La correction de trajectoire en cours de réponse est incroyable. Je peux voir où va le modèle et le corriger avant qu'il ne gaspille des tokens.”

“Il a battu les humains 83 % du temps sur 44 métiers différents. Avocat. Comptable. Analyste financier. Administrateur.”

“OpenAI a enfin résolu le goulot d'étranglement de la sortie. 128k tokens de sortie, c'est un rêve pour les développeurs full-stack.”

“La latence du computer use est toujours là, mais la précision est assez élevée pour gérer des workflows SAP complexes, ce qui est fou.”

Vidéos sur GPT-5.4

Regardez des tutoriels, critiques et discussions sur GPT-5.4

“GPT 5.4 est là et nous pourrions bien avoir un nouveau meilleur modèle sur la planète.”

“Le Thinking de GPT 5.4 peut désormais fournir un plan de réflexion en amont... vous permettant de guider le modèle.”

“Cet élément interactif résout le problème de la « boîte noire » des modèles de reasoning.”

“La vitesse par rapport à o1-preview est le jour et la nuit pour les tâches standard.”

“Vous assistez à un reasoning qui semble réellement cohérent sur de longues conversations.”

“GPT 5.4... n'a pas été conçu pour discuter. Il a été conçu pour travailler.”

“Le chargement différé... a réduit l'utilisation totale de tokens de 47 % sans perte de précision.”

“La fonctionnalité de computer use suit les éléments d'interface avec un système basé sur les coordonnées.”

“Je l'ai testé avec une base de code Java héritée et il a réellement compris les dépendances entre les fichiers.”

“Nous entrons dans un monde où l'IA est le contrôleur du système d'exploitation.”

“1 million 50 000 tokens de context window. C'est une très longue context window.”

“Naviguez dedans pendant qu'il réfléchit, ce qui est définitivement plus efficace.”

“La tarification est élevée mais pour les gros jeux de documents, c'est le seul modèle qui fonctionne.”

“Le mode Thinking peut être ajusté en fonction de la complexité de votre prompt.”

“Il semble plus fiable sur le rappel des faits que n'importe quelle version de GPT précédente.”

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour GPT-5.4

Conseils d'experts pour tirer le meilleur parti de GPT-5.4.

Ajuster l'effort de réflexion

Utilisez les paramètres Standard, Extended ou Heavy pour équilibrer le besoin de précision avec la vitesse de génération et le coût.

Passer en revue le plan de réflexion

Surveillez le plan fourni par le modèle en amont et utilisez le Mid-Response Steering pour le corriger si la logique dévie.

Optimiser avec le chargement différé d'outils

Pour les workflows agentic, utilisez le registre de chargement différé pour réduire les coûts en tokens initiaux jusqu'à 47 %.

Utiliser des contrats de complétude

Définissez explicitement ce que signifie « terminé » dans votre prompt pour rendre le modèle plus persistant lors de tâches longues.

Vision haute résolution

Téléchargez des images haute fidélité allant jusqu'à 10,24 millions de pixels pour des inspections visuelles précises d'éléments d'interface ou de schémas techniques.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés AI Models

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Questions Fréquentes sur GPT-5.4

Trouvez des réponses aux questions courantes sur GPT-5.4