วิธีทำ Scraping ข้อมูล Geolocaux | คู่มือแนะนำการสร้าง Geolocaux Web Scraper

เรียนรู้วิธีการทำ Scraping ข้อมูลอสังหาริมทรัพย์เพื่อการพาณิชย์จาก Geolocaux.com ดึงข้อมูลราคาสำนักงาน, รายการคลังสินค้า...

ตรวจพบการป้องกันบอท

- การจำกัดอัตรา

- จำกัดคำขอต่อ IP/เซสชันตามเวลา สามารถหลีกเลี่ยงได้ด้วยพร็อกซีหมุนเวียน การหน่วงเวลาคำขอ และการสแกรปแบบกระจาย

- การบล็อก IP

- บล็อก IP ของศูนย์ข้อมูลที่รู้จักและที่อยู่ที่ถูกทำเครื่องหมาย ต้องใช้พร็อกซีที่อยู่อาศัยหรือมือถือเพื่อหลีกเลี่ยงอย่างมีประสิทธิภาพ

- Cookie Tracking

- ลายนิ้วมือเบราว์เซอร์

- ระบุบอทผ่านลักษณะเฉพาะของเบราว์เซอร์: canvas, WebGL, ฟอนต์, ปลั๊กอิน ต้องมีการปลอมแปลงหรือโปรไฟล์เบราว์เซอร์จริง

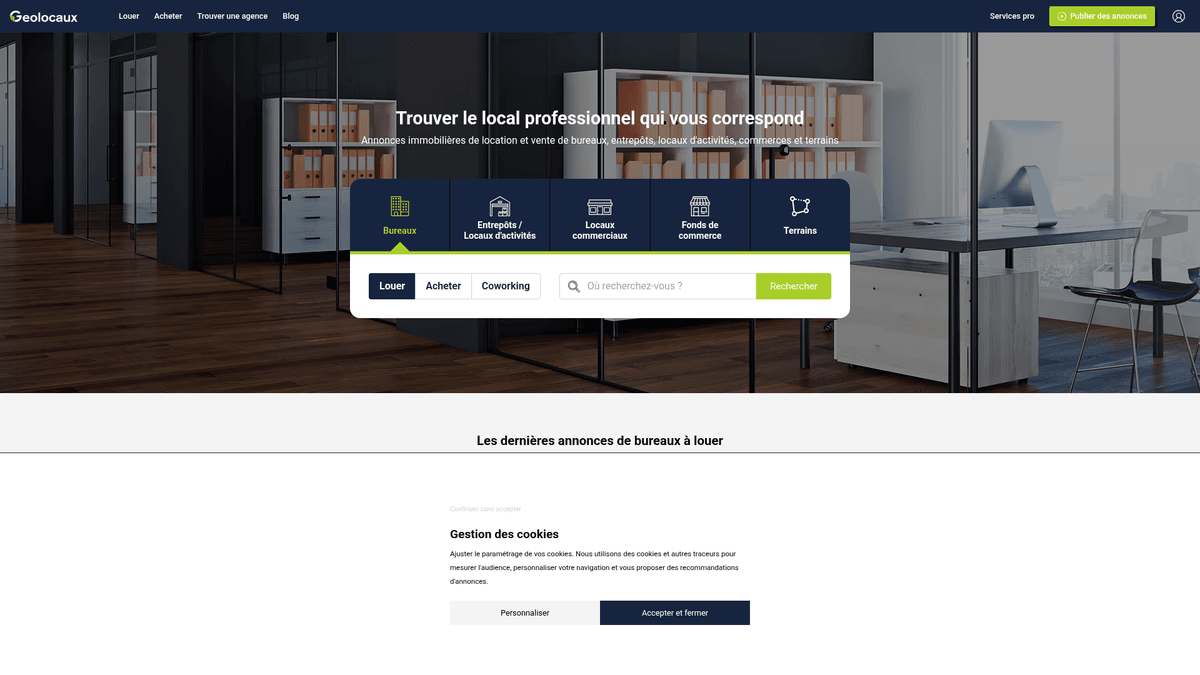

เกี่ยวกับ Geolocaux

ค้นพบสิ่งที่ Geolocaux นำเสนอและข้อมูลที่มีค่าที่สามารถดึงได้

พอร์ทัลอสังหาริมทรัพย์แบบ B2B ชั้นนำของฝรั่งเศส

Geolocaux คือแพลตฟอร์มอสังหาริมทรัพย์ชั้นนำของฝรั่งเศสที่อุทิศให้กับ อสังหาริมทรัพย์เพื่อการวิชาชีพและการพาณิชย์ โดยเฉพาะ โดยทำหน้าที่เป็นศูนย์กลางสำหรับธุรกิจที่กำลังมองหาพื้นที่สำนักงาน, คลังสินค้า, ศูนย์โลจิสติกส์ และพื้นที่ค้าปลีก ด้วยการรวบรวมรายการจากยักษ์ใหญ่ในอุตสาหกรรมอย่าง BNP Paribas Real Estate และ CBRE ทำให้แพลตฟอร์มนี้ให้ภาพรวมที่ครอบคลุมของภูมิทัศน์เชิงพาณิชย์ในฝรั่งเศส

ข้อมูลตำแหน่งทางภูมิศาสตร์และข้อมูลตลาด

แพลตฟอร์มนี้มีความโดดเด่นด้วย กลยุทธ์ที่เน้นตำแหน่งทางภูมิศาสตร์ (geolocation-first) ช่วยให้ผู้ใช้สามารถค้นหาอสังหาริมทรัพย์ตามความใกล้ชิดกับศูนย์กลางการคมนาคมและระยะเวลาการเดินทาง สิ่งนี้ทำให้ข้อมูลมีค่าอย่างยิ่งสำหรับการวางแผนโลจิสติกส์และกลยุทธ์ HR สำหรับการทำ Scraping แพลตฟอร์มนี้มีข้อมูลจำเพาะทางเทคนิคที่หนาแน่น รวมถึงความสามารถในการแบ่งพื้นที่, การเข้าถึงอินเทอร์เน็ตความเร็วสูง และราคาต่อตารางเมตรที่แม่นยำในทุกภูมิภาคของฝรั่งเศส

คุณค่าทางธุรกิจของข้อมูล Geolocaux

การ Scraping ข้อมูลจาก Geolocaux ช่วยให้องค์กรสามารถตรวจสอบ ผลตอบแทนและแนวโน้มการเช่า ของตลาดเชิงพาณิชย์ในฝรั่งเศสได้แบบเรียลไทม์ ไม่ว่าคุณจะทำการวิเคราะห์คู่แข่งในพอร์ตโฟลิโอของเอเจนซี่ หรือสร้างระบบหาลีด (lead generation) สำหรับบริการดูแลอาคารสำนักงาน รายการข้อมูลที่มีโครงสร้างเหล่านี้จะให้รายละเอียดเชิงลึกที่จำเป็นสำหรับการวิเคราะห์ธุรกิจระดับสูง

ทำไมต้อง Scrape Geolocaux?

ค้นพบคุณค่าทางธุรกิจและกรณีการใช้งานสำหรับการดึงข้อมูลจาก Geolocaux

ตรวจสอบราคาเช่าเชิงพาณิชย์ทั่วฝรั่งเศสแบบเรียลไทม์

สร้างลีดสำหรับบริการ B2B เช่น การทำความสะอาดสำนักงาน, การวางระบบ IT และการขนย้าย

รวบรวมข้อมูลเชิงแข่งขันเพื่อติดตามพอร์ตโฟลิโอของเอเจนซี่อสังหาริมทรัพย์รายใหญ่

วิเคราะห์การลงทุนเพื่อระบุภาคส่วนเชิงพาณิชย์ที่มีผลตอบแทนสูงในย่านที่กำลังเติบโต

รวบรวมข้อมูลสำหรับแอปพลิเคชัน Prop-tech และเครื่องมือจัดการอสังหาริมทรัพย์

ความท้าทายในการ Scrape

ความท้าทายทางเทคนิคที่คุณอาจพบเมื่อ Scrape Geolocaux

การโหลดเนื้อหาแบบไดนามิกที่รายละเอียดของรายการต้องอาศัยการรัน JavaScript จึงจะปรากฏ

การจำกัดอัตราคำขอ (rate limiting) ขั้นสูงที่ตรวจจับคำขอความถี่สูงจาก IP ที่ไม่ใช่ที่พักอาศัย

รูปภาพแบบ Lazy-loaded และองค์ประกอบแผนที่ที่จะทำงานเมื่อมีการเลื่อนหน้าจอเท่านั้น

โครงสร้าง HTML ที่ซับซ้อนและมีการเปลี่ยนชื่อ CSS class ของการ์ดรายการบ่อยครั้ง

สกัดข้อมูลจาก Geolocaux ด้วย AI

ไม่ต้องเขียนโค้ด สกัดข้อมูลภายในไม่กี่นาทีด้วยระบบอัตโนมัติที่ขับเคลื่อนด้วย AI

วิธีการทำงาน

อธิบายสิ่งที่คุณต้องการ

บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Geolocaux แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

AI สกัดข้อมูล

ปัญญาประดิษฐ์ของเรานำทาง Geolocaux จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

รับข้อมูลของคุณ

รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

ทำไมต้องใช้ AI ในการสกัดข้อมูล

AI ทำให้การสกัดข้อมูลจาก Geolocaux เป็นเรื่องง่ายโดยไม่ต้องเขียนโค้ด แพลตฟอร์มที่ขับเคลื่อนด้วยปัญญาประดิษฐ์ของเราเข้าใจว่าคุณต้องการข้อมูลอะไร — แค่อธิบายเป็นภาษาธรรมชาติ แล้ว AI จะสกัดให้โดยอัตโนมัติ

How to scrape with AI:

- อธิบายสิ่งที่คุณต้องการ: บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Geolocaux แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

- AI สกัดข้อมูล: ปัญญาประดิษฐ์ของเรานำทาง Geolocaux จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

- รับข้อมูลของคุณ: รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

Why use AI for scraping:

- เครื่องมือสร้างแบบ Visual No-Code: สร้าง Scraper สำหรับ Geolocaux ได้โดยไม่ต้องเขียนโค้ดแม้แต่บรรทัดเดียว

- การเรนเดอร์ JS อัตโนมัติ: จัดการองค์ประกอบแบบไดนามิกและแผนที่ที่มักจะบล็อก Scraper ทั่วไปได้อย่างง่ายดาย

- การรวม Residential Proxy: ใช้ IP ฝรั่งเศสเพื่อให้ดูกลมกลืนกับผู้ใช้งานปกติและหลีกเลี่ยงการถูกบล็อก

- การตั้งเวลาและ Webhooks: ซิงค์รายการใหม่ไปยัง CRM หรือ Google Sheets ของคุณโดยอัตโนมัติเป็นประจำทุกวัน

No-code web scrapers สำหรับ Geolocaux

ทางเลือกแบบ point-and-click สำหรับการ scraping ด้วย AI

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Geolocaux โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

ความท้าทายทั่วไป

เส้นโค้งการเรียนรู้

การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

Selectors เสีย

การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

ปัญหาเนื้อหาไดนามิก

เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

ข้อจำกัด CAPTCHA

เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

การบล็อก IP

การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

No-code web scrapers สำหรับ Geolocaux

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Geolocaux โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

- ติดตั้งส่วนขยายเบราว์เซอร์หรือสมัครใช้งานแพลตฟอร์ม

- นำทางไปยังเว็บไซต์เป้าหมายและเปิดเครื่องมือ

- เลือกองค์ประกอบข้อมูลที่ต้องการดึงด้วยการชี้และคลิก

- กำหนดค่า CSS selectors สำหรับแต่ละฟิลด์ข้อมูล

- ตั้งค่ากฎการแบ่งหน้าเพื่อ scrape หลายหน้า

- จัดการ CAPTCHA (มักต้องแก้ไขด้วยตนเอง)

- กำหนดค่าการตั้งเวลาสำหรับการรันอัตโนมัติ

- ส่งออกข้อมูลเป็น CSV, JSON หรือเชื่อมต่อผ่าน API

ความท้าทายทั่วไป

- เส้นโค้งการเรียนรู้: การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

- Selectors เสีย: การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

- ปัญหาเนื้อหาไดนามิก: เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

- ข้อจำกัด CAPTCHA: เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

- การบล็อก IP: การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

ตัวอย่างโค้ด

import requests

from bs4 import BeautifulSoup

# กำหนดเป้าหมายไปที่รายการสำนักงานในปารีส

url = 'https://www.geolocaux.com/location/bureau/paris-75/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/110.0.0.0 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# หมายเหตุ: ต้องตรวจสอบ selector กับ HTML ปัจจุบันของเว็บไซต์

listings = soup.select('article.card')

for listing in listings:

title = listing.select_one('h3').text.strip() if listing.select_one('h3') else 'N/A'

price = listing.select_one('.price').text.strip() if listing.select_one('.price') else 'On Request'

print(f'Listing: {title} | Price: {price}')

except Exception as e:

print(f'Request failed: {e}')เมื่อไหร่ควรใช้

เหมาะที่สุดสำหรับหน้า HTML แบบ static ที่มี JavaScript น้อย เหมาะสำหรับบล็อก ไซต์ข่าว และหน้าสินค้า e-commerce ธรรมดา

ข้อดี

- ●ประมวลผลเร็วที่สุด (ไม่มี overhead ของเบราว์เซอร์)

- ●ใช้ทรัพยากรน้อยที่สุด

- ●ง่ายต่อการทำงานแบบขนานด้วย asyncio

- ●เหมาะมากสำหรับ API และหน้า static

ข้อจำกัด

- ●ไม่สามารถรัน JavaScript ได้

- ●ล้มเหลวใน SPA และเนื้อหาไดนามิก

- ●อาจมีปัญหากับระบบ anti-bot ที่ซับซ้อน

วิธีสเครปข้อมูล Geolocaux ด้วยโค้ด

Python + Requests

import requests

from bs4 import BeautifulSoup

# กำหนดเป้าหมายไปที่รายการสำนักงานในปารีส

url = 'https://www.geolocaux.com/location/bureau/paris-75/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/110.0.0.0 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# หมายเหตุ: ต้องตรวจสอบ selector กับ HTML ปัจจุบันของเว็บไซต์

listings = soup.select('article.card')

for listing in listings:

title = listing.select_one('h3').text.strip() if listing.select_one('h3') else 'N/A'

price = listing.select_one('.price').text.strip() if listing.select_one('.price') else 'On Request'

print(f'Listing: {title} | Price: {price}')

except Exception as e:

print(f'Request failed: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def run_scraper():

with sync_playwright() as p:

# เปิดเบราว์เซอร์ด้วย locale ภาษาฝรั่งเศสเพื่อเลียนแบบผู้ใช้งานในพื้นที่

browser = p.chromium.launch(headless=True)

context = browser.new_context(locale='fr-FR')

page = context.new_page()

page.goto('https://www.geolocaux.com/location/bureau/')

# รอให้บทความ listing ที่เรนเดอร์ด้วย JS โหลดเสร็จ

page.wait_for_selector('article')

# ดึงข้อมูลชื่อและราคา

properties = page.query_selector_all('article')

for prop in properties:

title = prop.query_selector('h3').inner_text()

print(f'Found Property: {title}')

browser.close()

run_scraper()Python + Scrapy

import scrapy

class GeolocauxSpider(scrapy.Spider):

name = 'geolocaux'

start_urls = ['https://www.geolocaux.com/location/bureau/']

def parse(self, response):

# วนลูปผ่าน listing containers

for listing in response.css('article'):

yield {

'title': listing.css('h3::text').get(),

'price': listing.css('.price::text').get(),

'area': listing.css('.surface::text').get(),

}

# จัดการการแบ่งหน้าโดยการหาปุ่ม 'Next'

next_page = response.css('a.pagination__next::attr(href)').get()

if next_page is not None:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// ตั้งค่า viewport เพื่อให้แสดงผล layout แบบ responsive ที่ถูกต้อง

await page.setViewport({ width: 1280, height: 800 });

await page.goto('https://www.geolocaux.com/location/bureau/', { waitUntil: 'networkidle2' });

const listings = await page.evaluate(() => {

const data = [];

document.querySelectorAll('article h3').forEach(el => {

data.push({

title: el.innerText.trim()

});

});

return data;

});

console.log(listings);

await browser.close();

})();คุณสามารถทำอะไรกับข้อมูล Geolocaux

สำรวจการใช้งานจริงและข้อมูลเชิงลึกจากข้อมูล Geolocaux

การดัชนีค่าเช่าเชิงพาณิชย์

บริษัททางการเงินสามารถติดตามความผันผวนของราคาเช่าต่อตารางเมตรเพื่อประเมินความแข็งแกร่งทางเศรษฐกิจในเมืองต่างๆ ของฝรั่งเศส

วิธีการนำไปใช้:

- 1ดึงข้อมูลราคาและพื้นที่สำหรับรายการ 'Location Bureau' (เช่าสำนักงาน) ทั้งหมด

- 2จัดกลุ่มข้อมูลตามเขต (Arrondissement) หรือรหัสไปรษณีย์

- 3คำนวณราคาเฉลี่ยต่อตารางเมตรและเปรียบเทียบกับข้อมูลย้อนหลัง

- 4สร้าง heat maps สำหรับการวิเคราะห์การลงทุนในเขตเมือง

ใช้ Automatio เพื่อดึงข้อมูลจาก Geolocaux และสร้างแอปพลิเคชันเหล่านี้โดยไม่ต้องเขียนโค้ด

คุณสามารถทำอะไรกับข้อมูล Geolocaux

- การดัชนีค่าเช่าเชิงพาณิชย์

บริษัททางการเงินสามารถติดตามความผันผวนของราคาเช่าต่อตารางเมตรเพื่อประเมินความแข็งแกร่งทางเศรษฐกิจในเมืองต่างๆ ของฝรั่งเศส

- ดึงข้อมูลราคาและพื้นที่สำหรับรายการ 'Location Bureau' (เช่าสำนักงาน) ทั้งหมด

- จัดกลุ่มข้อมูลตามเขต (Arrondissement) หรือรหัสไปรษณีย์

- คำนวณราคาเฉลี่ยต่อตารางเมตรและเปรียบเทียบกับข้อมูลย้อนหลัง

- สร้าง heat maps สำหรับการวิเคราะห์การลงทุนในเขตเมือง

- การหาลีดแบบ B2B (Lead Generation)

บริษัทจำหน่ายอุปกรณ์สำนักงานและบริษัททำความสะอาดสามารถระบุอสังหาริมทรัพย์ที่เพิ่งปล่อยเช่าหรือกำลังว่างเพื่อหาโอกาสทางธุรกิจใหม่ๆ

- Scraping รายการที่ระบุว่าเป็น 'New' (ใหม่) หรือ 'Available' (ว่าง)

- ระบุชื่อเอเจนซี่อสังหาริมทรัพย์ที่ดูแลและที่อยู่ของอสังหาริมทรัพย์

- ตรวจสอบข้ามข้อมูลกับฐานข้อมูลองค์กรเพื่อหาผู้เช่ารายใหม่ที่กำลังย้ายเข้า

- ตั้งค่าระบบส่งอีเมลหรือติดต่อผู้จัดการอาคารโดยอัตโนมัติ

- การเลือกทำเลที่ตั้งโลจิสติกส์

บริษัทโลจิสติกส์สามารถวิเคราะห์ความพร้อมของคลังสินค้าใกล้กับทางหลวงหลักและศูนย์กลางการขนส่ง

- กำหนดเป้าหมายหมวดหมู่ 'Entrepôt & Logistique' บน Geolocaux

- ดึงข้อมูลที่อยู่และความใกล้ชิดกับ 'Axes Routiers' (เส้นทางถนนหลัก) จากคำบรรยาย

- จับคู่รายการอสังหาริมทรัพย์กับข้อมูลทางขึ้นลงทางด่วน

- เลือกทำเลที่เหมาะสมที่สุดตามความสะดวกในการคมนาคมขนส่ง

- การตรวจสอบคลังสินค้าของคู่แข่ง

เอเจนซี่อสังหาริมทรัพย์สามารถตรวจสอบพอร์ตโฟลิโอของคู่แข่งอย่าง CBRE หรือ JLL บนแพลตฟอร์มได้

- กรองเป้าหมายการ Scraping ตามชื่อเอเจนซี่

- ตรวจสอบปริมาณรายการอสังหาริมทรัพย์ทั้งหมดต่อเอเจนซี่ในแต่ละเดือน

- ระบุการเปลี่ยนแปลงโฟกัสของคู่แข่งไปยังประเภทอสังหาริมทรัพย์เฉพาะ (เช่น Coworking)

- ปรับงบประมาณการตลาดภายในองค์กรเพื่อแข่งขันในพื้นที่ที่ยังไม่มีคู่แข่งมากนัก

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมืออาชีพสำหรับการ Scrape Geolocaux

คำแนะนำจากผู้เชี่ยวชาญสำหรับการดึงข้อมูลจาก Geolocaux อย่างประสบความสำเร็จ

ใช้ French Residential Proxies

เพื่อหลีกเลี่ยงการถูกตรวจจับโดยตัวกรองความปลอดภัย ควรใช้พร็อกซีที่ตั้งอยู่ในประเทศฝรั่งเศส

กำหนด Random Delays

พอร์ทัลเชิงพาณิชย์มีการตรวจสอบทราฟฟิกที่มาจากโรบอต ควรเว้นระยะเวลาระหว่าง 3-10 วินาที

จัดการ 'Price on Request'

รายการอสังหาริมทรัพย์แบบ B2B จำนวนมากไม่แสดงราคา ควรตรวจสอบให้แน่ใจว่าโค้ดของคุณสามารถจัดการค่า null หรือข้อความอย่าง 'Loyer nous consulter' ได้

กระตุ้น Scroll Events

เลื่อนลงไปที่ด้านล่างของหน้ารายการเพื่อให้แน่ใจว่ารูปภาพและข้อมูลแบบ lazy-loaded ทั้งหมดถูกดึงข้อมูลมาครบถ้วน

ตรวจสอบ Selectors อย่างสม่ำเสมอ

พอร์ทัลอสังหาริมทรัพย์มักอัปเดตเลย์เอาต์บ่อยครั้ง ควรตรวจสอบ CSS selectors เป็นประจำทุกเดือน

ทำความสะอาดข้อมูลที่อยู่

ใช้บริการ geocoding เพื่อปรับข้อมูลที่อยู่ (normalize) ที่ดึงมาจาก Geolocaux ให้เป็นมาตรฐาน เพื่อการทำแผนที่ GIS ที่ดียิ่งขึ้น

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง Web Scraping

How to Scrape Century 21 Property Listings

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Sacramento Delta Property Management

How to Scrape LivePiazza: Philadelphia Real Estate Scraper

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Homes.com: Real Estate Data Extraction Guide

คำถามที่พบบ่อยเกี่ยวกับ Geolocaux

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ Geolocaux