GLM-5.1

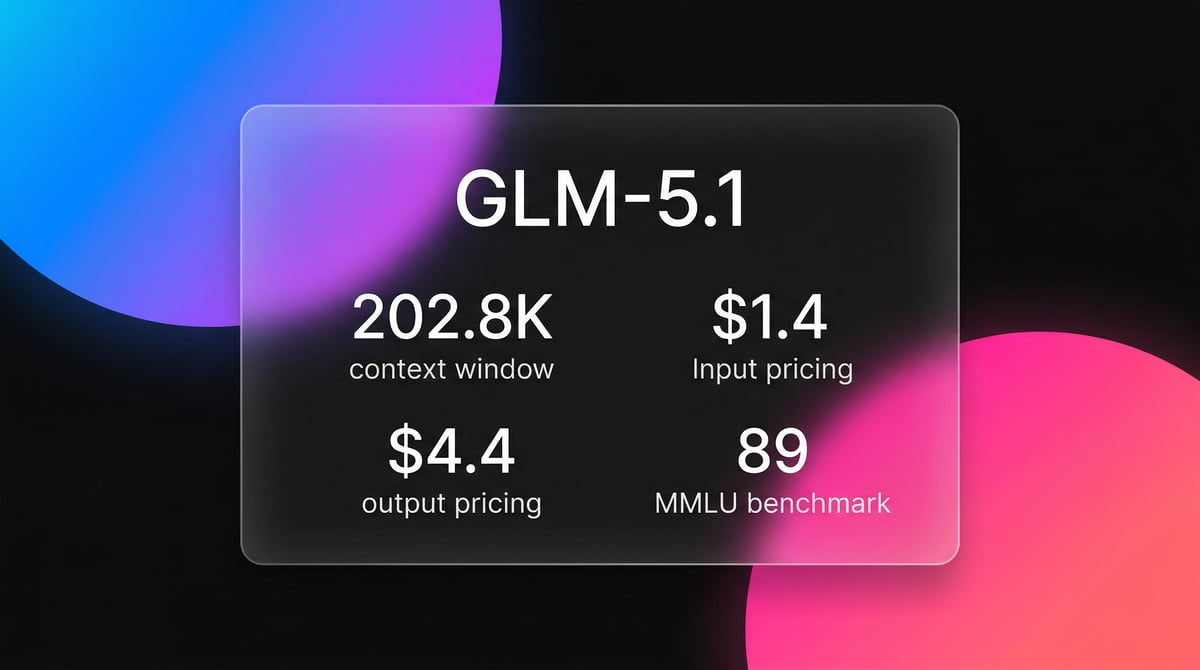

GLM-5.1 — це флагманська модель reasoning від Zhipu AI з context window 202K та 8-годинним циклом автономного виконання для складних інженерних agentic завдань.

Про GLM-5.1

Дізнайтеся про можливості GLM-5.1, функції та як це може допомогти вам досягти кращих результатів.

GLM-5.1, це флагманська фундаментна модель Zhipu AI, створена для складного системного інжинірингу та тривалих agentic завдань. Побудована на архітектурі Mixture-of-Experts (MoE) з 744 мільярдами parameters (40 мільярдів активних на прохід), вона являє собою значний крок вперед у витривалості та автономному вирішенні проблем. Модель спеціально спроєктована для подолання плато reasoning, що спостерігалися в попередніх large language models, підтримуючи продуктивність та якість коду протягом тисяч викликів інструментів та сотень ітерацій. Вона виявляє блоки, проводить експерименти та коригує власну стратегію без втручання людини.

Технічно GLM-5.1 відмінно працює як основний двигун reasoning у multi-agent системах. Вона приймає архітектурні рішення високого рівня, делегуючи впровадження меншим моделям. Модель оснащена context window 202K, що підтримується динамічним механізмом розрідженої уваги, забезпечуючи цілісність у величезних кодових базах. GLM-5.1 випущена як open weights за ліцензією MIT, надаючи життєздатну локальну альтернативу пропрієтарним frontier models для таких завдань, як оптимізація баз даних, інжиніринг GPU-ядер та розробка full-stack вебдодатків.

Результати KernelBench рівня 3 показують, що GLM-5.1 зберігає значне прискорення в agentic ML завданнях протягом довгих сесій порівняно з Claude Opus 4.6. Ця витривалість дозволяє розробникам запускати інженерне завдання вранці та отримувати повністю протестований, розгорнутий сервіс до кінця дня. Вона керує повним життєвим циклом виправлення помилок, від відтворення проблеми в пісочниці до подання фінального pull request.

Випадки використання для GLM-5.1

Відкрийте різні способи використання GLM-5.1 для досягнення чудових результатів.

Автономна розробка програмного забезпечення

Модель автономно працює понад 8 годин для проектування, впровадження та налагодження мікросервісів без втручання людини.

Високопродуктивна оптимізація баз даних

Модель ітеративно оптимізує реалізації векторного пошуку на Rust протягом сотень раундів.

Оптимізація GPU-ядер

Аналізує еталонні реалізації для створення швидших GPU-ядер, які перевершують стандартні компілятори автоналаштування.

Оркестрація multi-agent систем

Виступає в ролі ядра reasoning, що координує підзавдання та виклики інструментів у групі спеціалізованих менших моделей.

Складні завдання в терміналі

Виконує реальні операції в терміналі та багатоетапне системне адміністрування за допомогою agentic CLI-інструментів.

Full-stack вебдизайн

Модель генерує візуально цілісні макети інтерфейсу та бекенд-логіку для браузерних десктопних середовищ.

Сильні сторони

Обмеження

Швидкий старт API

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Оптимізуй цю схему бази даних.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Встановіть SDK і почніть робити API-виклики за лічені хвилини.

Що кажуть люди про GLM-5.1

Подивіться, що думає спільнота про GLM-5.1

“GLM-5.1 працювала над одним prompt протягом 8 годин поспіль. Вона не зупинилася, як більшість моделей; вона продовжувала додавати функції та перевіряти саму себе.”

“Я протестував її на 140к context щонайменше 5 разів, і вона залишалася цілісною. У SOTA, можливо, з'явився суперник.”

“GLM-5.1 на цьому benchmark йде врівень з Opus. Тепер це модель №1 серед open-source моделей в Arena.”

“Щоразу, коли я бачу, як NPC щиро переконується через нескриптований діалог з GLM-5.1, це чиста магія.”

“Продуктивність у кодингу, справжня. Вона виправила стан гонитви (race condition) у нашому Go-бекенді, про який GPT-4o постійно галюцинував.”

“Локальний запуск через Unsloth, це кардинальна зміна для конфіденційності даних у нашому юридичному стеку технологій.”

Відео про GLM-5.1

Дивіться навчальні матеріали, огляди та обговорення про GLM-5.1

“GLM-5.1 отримала 45.3% на цьому benchmark, що є суттєвим стрибком для цього сімейства.”

“Це неймовірно повільна модель... ймовірно, більшість їхніх GPU все ще зайняті моделлю GLM-5.”

“Те, як вона обробляє виклики інструментів, набагато надійніше, ніж у стандартній GLM 5.”

“Наразі це найпотужніша модель для reasoning, яку можна завантажити та запустити на власному обладнанні.”

“Ви можете побачити, як вона фактично виявляє власні помилки в логах міркувань.”

“Вона може працювати автономно протягом 8 годин, вдосконалюючи стратегії протягом тисяч ітерацій.”

“Вона перевершує Gemini 3.1 Pro та Qwen 3.6 Plus на популярних benchmark для генерації коду.”

“Режим agentic, це те, де ця модель справді сяє, вона не здається перед складними багами.”

“Z.ai фактично зняла платний бар'єр для frontier-level моделі на 744 млрд parameters.”

“Вона ефективно вирішує проблему «плато», де інші LLM з часом втрачають концентрацію.”

“Зменшення розміру на 80% з початкових 1.65 ТБ до 236 ГБ при збереженні якості.”

“Сила open-source: навіть у квантованій версії вона написала робочий код для феєрверків.”

“Вам знадобиться принаймні 256 ГБ системної RAM, щоб взагалі думати про завантаження цього гіганта MoE.”

“Вона використовує механізм динамічної розрідженої уваги (sparse attention), щоб підтримувати цілісність 202к context.”

“Використання Unsloth робить процес тренування та inference значно ефективнішим.”

Прискорте вашу роботу з AI-автоматизацією

Automatio поєднує силу AI-агентів, веб-автоматизації та розумних інтеграцій, щоб допомогти вам досягти більшого за менший час.

Професійні поради для GLM-5.1

Експертні поради, які допоможуть вам отримати максимум від GLM-5.1 та досягти кращих результатів.

Увімкнення режиму Thinking

Переконайтеся, що перемикач «Thinking» активовано у ваших налаштуваннях, щоб розблокувати можливості 8-годинної автономної ітерації.

Використання квот у непікові години

Запускайте великі інженерні пакетні завдання у непікові години поза межами 14:00-18:00 за пекінським часом для кращого ціноутворення.

Вимоги до локальної пам'яті

Використовуйте квантування Unsloth Dynamic GGUF, щоб вмістити модель обсягом 1.6 ТБ у 256 ГБ системної пам'яті для локальних запусків.

Стратегічний вибір завдань

Використовуйте GLM-5.1 для архітектурного reasoning, а GLM-4.7, для рутинних завдань, щоб оптимізувати витрати.

Відгуки

Що кажуть наші користувачі

Приєднуйтесь до тисяч задоволених користувачів, які трансформували свою роботу

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Пов'язані AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Часті запитання про GLM-5.1

Знайдіть відповіді на поширені запитання про GLM-5.1