Wie man Century 21 scrapt: Ein technischer Leitfaden für Immobilien

Scrapen Sie Century 21 für Immobilien-Listings, Preise und Maklerdaten. Meistern Sie CloudFront-Bypass, Residential Proxies und automatisierte Extraktion in...

Anti-Bot-Schutz erkannt

- CloudFront

- AWS WAF

- Browser-Fingerprinting

- Identifiziert Bots anhand von Browser-Eigenschaften: Canvas, WebGL, Schriftarten, Plugins. Erfordert Spoofing oder echte Browser-Profile.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

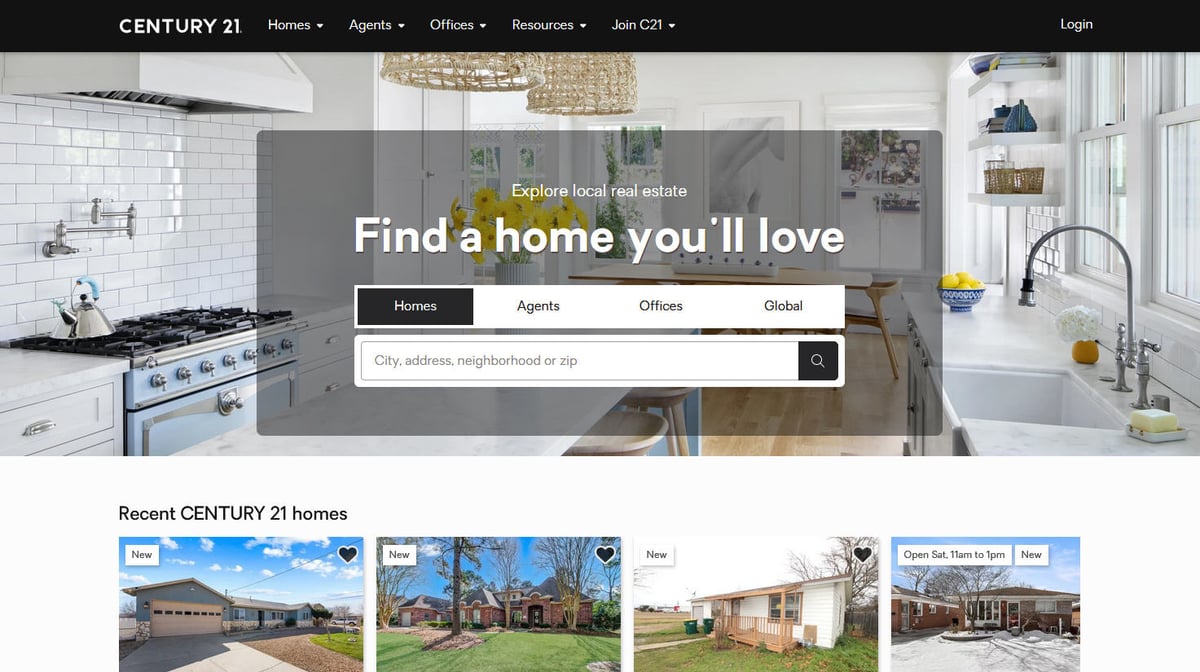

Über Century 21

Entdecken Sie, was Century 21 bietet und welche wertvollen Daten extrahiert werden können.

Das globale Immobilien-Powerhouse

Century 21 Real Estate LLC ist ein amerikanisches Franchise-Unternehmen für Immobilienmakler und eine Tochtergesellschaft von Anywhere Real Estate Inc. (ehemals Realogy). Es ist eine der bekanntesten Marken der Branche und bündelt Millionen von Wohn-, Gewerbe- und Luxusimmobilien-Listings in Dutzenden von Ländern. Die Plattform dient als standardisiertes Portal für Käufer und Verkäufer und bietet tiefgehende technische Daten zu jeder Immobilie.

Hochwertige Listing-Daten

Die Website enthält ein massives Volumen an strukturierten Immobilieninformationen. Für Datenanalysten bietet sie Zugang zu MLS-Nummern, historischen Preispunkten, spezifischen Attributen wie Quadratmeterzahl und Baujahr sowie direkten Kontaktinformationen der Agenten. Diese Daten sind äußerst wertvoll für die Erstellung von Immobilien-Apps, Datenbanken zur Lead-Generierung und Marktanalyse-Tools.

Warum Century 21 scrapen?

Das Scraping dieser Seite ermöglicht eine groß angelegte vergleichende Marktanalyse, die manuell unmöglich durchzuführen wäre. Durch die Extraktion globaler Listing-Daten können Nutzer internationale Migrationstrends verfolgen, Preisschwankungen in wachstumsstarken Märkten überwachen und unterbewertete Investitionsmöglichkeiten identifizieren, bevor sie den Massenmarkt erreichen.

Warum Century 21 Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Century 21.

Marktüberwachung in Echtzeit

Das Scrapen von Century 21 ermöglicht es Ihnen, Immobilienpreisschwankungen und Bestandsänderungen in bestimmten Postleitzahlbereichen oder internationalen Regionen in Echtzeit zu verfolgen.

Identifizierung von Investmentmöglichkeiten

Investoren können unterbewertete Angebote oder Immobilien mit kürzlichen Preissenkungen identifizieren, bevor diese von größeren Aggregator-Plattformen indexiert werden.

Lead-Generierung für Makler

Die Extraktion von Makler-Kontaktdaten und Details zu Immobilienbüros bietet eine wertvolle Datenbank für B2B-Dienstleistungen wie Marketing, Versicherungen oder Hypothekenkredite.

Training von ML Model

Historische Listing-Daten, einschließlich Quadratmeterzahl, Ausstattung und Verkaufsstatus, sind essenziell für das Training präziser Automated Valuation Models (AVMs) und AI-Bewertungen.

Wettbewerbsanalyse

Immobilienbüros nutzen diese Daten, um ihre eigene Performance mit dem regionalen Inventar und dem Marktanteilswachstum von Century 21 zu vergleichen.

Hyperlokale Datenanalyse

Sammeln Sie detaillierte Metadaten auf Nachbarschaftsebene, die in konsolidierten nationalen Immobilienberichten nicht immer verfügbar sind.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Century 21.

CloudFront 403 Forbidden Sperren

Die Website nutzt einen aggressiven CDN-Schutz, der Anfragen von standardmäßigen automatisierten Skripten oder Datencenter-IPs identifiziert und sofort blockiert.

JavaScript-lastige Inhalte

Suchergebnisse und Immobiliendetails werden dynamisch über JavaScript gerendert, was bedeutet, dass einfache HTML-Parser oft leere Ergebnisse liefern.

Fortgeschrittenes Browser-Fingerprinting

Die Seite setzt TLS- und Canvas-Fingerprinting ein, um zwischen echten menschlichen Nutzern und Headless-Browsern wie Selenium oder Puppeteer zu unterscheiden.

Instabile HTML-Selectoren

Century 21 aktualisiert häufig seine CSS-Klassen und die HTML-Struktur, was dazu führen kann, dass statische Scraper ohne regelmäßige Wartung nicht mehr funktionieren.

Scrape Century 21 mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Century 21 extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Century 21, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Century 21 zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Century 21 extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Century 21, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Nahtloser CloudFront-Bypass: Automatio nutzt fortschrittliche Stealth-Technologie und Fingerprint-Rotation, um CDN-Sperren ohne manuelle Konfiguration zu umgehen.

- No-Code-Datenextraktion: Sie können komplexe Immobilienfelder wie Angebotspreis und MLS-Nummern visuell über ein Point-and-Click-Interface zuweisen, sodass keine Programmierung erforderlich ist.

- Automatisiertes Proxy-Management: Die integrierte Rotation von Residential Proxies stellt sicher, dass Ihr Scraper eine hohe Erfolgsquote beibehält, indem er Ihren automatisierten Traffic als echte Nutzeraktivität maskiert.

- Visuelle Handhabung der Paginierung: Das Tool verarbeitet automatisch komplexe Paginierungen und 'Mehr laden'-Buttons, um sicherzustellen, dass Sie jedes Listing in einem Suchergebnis erfassen.

No-Code Web Scraper für Century 21

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Century 21 helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Century 21

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Century 21 helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Benutzerdefinierte Header sind obligatorisch, um grundlegende AWS WAF-Prüfungen zu umgehen

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9',

'Referer': 'https://www.century21.com/'

}

def scrape_c21(url):

try:

# Requests scheitern ohne hochwertige Proxies oft mit 403

response = requests.get(url, headers=headers, timeout=15)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Selektoren zielen auf gängige Property-Card-Elemente ab

listings = soup.select('.property-card')

for item in listings:

price = item.select_one('.property-card-price').get_text(strip=True)

addr = item.select_one('.property-address').get_text(strip=True)

print(f'Preis: {price} | Adresse: {addr}')

else:

print(f'Blockiert: {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')

scrape_c21('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Century 21 mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Benutzerdefinierte Header sind obligatorisch, um grundlegende AWS WAF-Prüfungen zu umgehen

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9',

'Referer': 'https://www.century21.com/'

}

def scrape_c21(url):

try:

# Requests scheitern ohne hochwertige Proxies oft mit 403

response = requests.get(url, headers=headers, timeout=15)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Selektoren zielen auf gängige Property-Card-Elemente ab

listings = soup.select('.property-card')

for item in listings:

price = item.select_one('.property-card-price').get_text(strip=True)

addr = item.select_one('.property-address').get_text(strip=True)

print(f'Preis: {price} | Adresse: {addr}')

else:

print(f'Blockiert: {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')

scrape_c21('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_with_playwright():

with sync_playwright() as p:

# Starten mit Stealth-Parametern wird empfohlen

browser = p.chromium.launch(headless=True)

context = browser.new_context(user_agent='Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7)')

page = context.new_page()

# Zu einer Suchergebnisseite navigieren

page.goto('https://www.century21.com/real-estate/los-angeles-ca/LCCALOSANGELES/')

# Warten, bis das Immobilien-Grid via JavaScript geladen wurde

page.wait_for_selector('.property-card')

cards = page.query_selector_all('.property-card')

for card in cards:

price = card.query_selector('.property-card-price').inner_text()

address = card.query_selector('.property-address').inner_text()

print({'price': price, 'address': address})

browser.close()

scrape_with_playwright()Python + Scrapy

import scrapy

class Century21Spider(scrapy.Spider):

name = 'c21_spider'

start_urls = ['https://www.century21.com/real-estate/miami-fl/LCCFMIAMI/']

def parse(self, response):

# Iteriere durch Immobilien-Container mittels CSS-Selektoren

for listing in response.css('.property-card'):

yield {

'address': listing.css('.property-address::text').get().strip(),

'price': listing.css('.property-card-price::text').get().strip(),

'url': response.urljoin(listing.css('a.card-anchor::attr(href)').get())

}

# Folge den Links zur nächsten Seite in der Pagination

next_page = response.css('a.next-page::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

async function scrapeCentury21() {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

// Realistisches Viewport setzen

await page.setViewport({ width: 1280, height: 800 });

await page.goto('https://www.century21.com/real-estate/chicago-il/LCCICHICAGO/');

// Warten, bis React-Komponenten die Listings rendern

await page.waitForSelector('.property-card');

const properties = await page.evaluate(() => {

return Array.from(document.querySelectorAll('.property-card')).map(el => ({

price: el.querySelector('.property-card-price')?.innerText,

address: el.querySelector('.property-address')?.innerText,

beds: el.querySelector('.property-beds')?.innerText

}));

});

console.log(properties);

await browser.close();

}

scrapeCentury21();Was Sie mit Century 21-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Century 21-Daten.

Vergleichende Marktanalyse

Immobilienunternehmen können lokale Wettbewerber-Listings überwachen, um sicherzustellen, dass ihr eigener Bestand marktgerecht eingepreist ist.

So implementieren Sie es:

- 1Extrahieren Sie Preise und Quadratmeterzahlen für eine bestimmte Postleitzahl.

- 2Berechnen Sie den durchschnittlichen Preis pro Quadratmeter für aktive Listings.

- 3Erstellen Sie automatisierte Berichte für Agenten, um Listing-Preise anzupassen.

Verwenden Sie Automatio, um Daten von Century 21 zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Century 21-Daten machen können

- Vergleichende Marktanalyse

Immobilienunternehmen können lokale Wettbewerber-Listings überwachen, um sicherzustellen, dass ihr eigener Bestand marktgerecht eingepreist ist.

- Extrahieren Sie Preise und Quadratmeterzahlen für eine bestimmte Postleitzahl.

- Berechnen Sie den durchschnittlichen Preis pro Quadratmeter für aktive Listings.

- Erstellen Sie automatisierte Berichte für Agenten, um Listing-Preise anzupassen.

- Lead-Sourcing für Investoren

Immobilieninvestoren können 'notleidende' oder unterbewertete Listings identifizieren, indem sie aktuelle Preise mit den historischen Medianwerten der Nachbarschaft vergleichen.

- Scrapen Sie alle 24 Stunden alle neuen Listings in einer Zielstadt.

- Filtern Sie nach Immobilien mit signifikanten Preisreduzierungen in letzter Zeit.

- Gleichen Sie Listings mit öffentlichen Steuerdaten ab, um die Rentabilität zu prüfen.

- Lead-Generierung für Hypotheken

Kreditinstitute können neue Listings identifizieren, um potenzielle Kreditnehmer mit maßgeschneiderten Finanzierungs- oder Refinanzierungsangeboten anzusprechen.

- Überwachen Sie den Bereich 'New Listings' für spezifische hochwertige Regionen.

- Extrahieren Sie den Standort der Immobilie und den geschätzten Hypothekenbedarf.

- Importieren Sie Daten in ein CRM für die direkte Ansprache potenzieller Hauskäufer.

- Training für KI-Wertermittlung

Data Scientists nutzen extrahierte Listing-Attribute, um machine learning Modelle für die automatisierte Immobilienbewertung zu trainieren.

- Aggregieren Sie über 10.000 Listings inklusive Attributen wie Baujahr und Ausstattung.

- Bereinigen und normalisieren Sie den Datensatz, um Duplikate oder veraltete Einträge zu entfernen.

- Trainieren Sie ein Regressionsmodell, um Verkaufspreise basierend auf Immobilienmerkmalen vorherzusagen.

- Tracking der Broker-Performance

Marketingfirmen können verfolgen, welche Maklerbüros die meisten Marktanteile gewinnen, indem sie die aktiven Listings pro Agentur zählen.

- Scrapen Sie den Namen des Maklers und des Maklerbüros aus allen Ergebnissen.

- Gruppieren Sie Listings nach Büros, um das gesamte Bestandvolumen zu berechnen.

- Visualisieren Sie das Wachstum oder den Rückgang von Marktanteilen über einen Zeitraum von 6 Monaten.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Century 21

Expertentipps für die erfolgreiche Datenextraktion von Century 21.

Residential Proxies nutzen

Standardmäßige Datencenter-IPs stehen bei Century 21 auf der Blacklist; verwenden Sie stets hochwertige rotierende Residential Proxies, um echte Heimanwender zu imitieren.

Die offizielle API nutzen

Prüfen Sie bei hohem Datenbedarf das Anywhere Developers Portal, das einen strukturierten und stabilen programmatischen Zugriff auf Listing-Daten über eine API ermöglicht.

Nutzerinteraktionen simulieren

Integrieren Sie zufällige Verzögerungen, Scrolling und Mausbewegungen in Ihren Scraper-Workflow, um das Risiko zu senken, dass verhaltensbasierte Anti-Bot-Prüfungen ausgelöst werden.

Regionale Subdomains scrapen

Falls die Hauptseite (.com) zu restriktiv ist, probieren Sie lokalisierte Domains wie century21canada.com aus, die möglicherweise leicht andere Sicherheitskonfigurationen aufweisen.

XML-Sitemaps parsen

Der direkte Zugriff auf Immobilien-URLs über die XML-Sitemap der Seite kann Ihnen helfen, die ressourcenintensiven Suchergebnisseiten zu umgehen.

Selector-Alerts einrichten

Richten Sie ein Monitoring für Ihren Scraper ein, damit Sie sofort benachrichtigt werden, wenn eine Änderung im HTML-Layout der Website Ihre Datenextraktion beeinträchtigt.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Century 21 Property Listings

How to Scrape Homes.com: Real Estate Data Extraction Guide

How to Scrape LivePiazza: Philadelphia Real Estate Scraper

How to Scrape Sacramento Delta Property Management

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Apartments Near Me | Real Estate Data Scraper

Häufig gestellte Fragen zu Century 21

Finden Sie Antworten auf häufige Fragen zu Century 21