So scrapen Sie Century 21 Immobilienangebote

Erfahren Sie, wie Sie Angebote, Preise und Maklerdetails von Century 21 scrapen. Umgehen Sie Akamai und CloudFront für hochwertige Immobilien-Datenextraktion.

Anti-Bot-Schutz erkannt

- Akamai Bot Manager

- Fortschrittliche Bot-Erkennung mittels Geräte-Fingerprinting, Verhaltensanalyse und maschinellem Lernen. Eines der ausgereiftesten Anti-Bot-Systeme.

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- CloudFront

- PerimeterX (HUMAN)

- Verhaltensbiometrie und prädiktive Analyse. Erkennt Automatisierung durch Mausbewegungen, Tippmuster und Seiteninteraktion.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- User-Agent Profiling

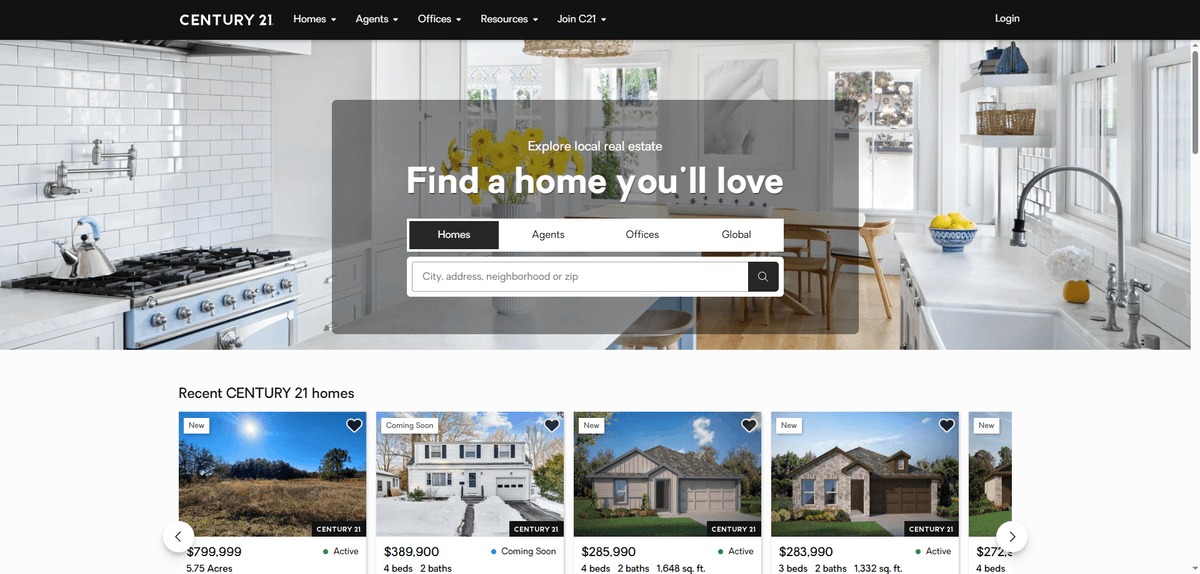

Über Century 21

Entdecken Sie, was Century 21 bietet und welche wertvollen Daten extrahiert werden können.

Century 21 Real Estate LLC ist eine der weltweit größten und bekanntesten Franchise-Gruppen für Wohnimmobilien. Gegründet 1971 und derzeit eine Tochtergesellschaft von Anywhere Real Estate, operiert sie über ein massives Netzwerk von tausenden unabhängig geführten Büros in mehr als 80 Ländern. Die Plattform dient als primäres Repository für Millionen von Wohn- und Gewerbeimmobilien weltweit.

Die Website bietet umfassende Objektdaten, einschließlich Preisen, architektonischen Spezifikationen und Kontaktdaten der Makler. Da sie einen riesigen, fragmentierten Markt repräsentiert, ist die Seite eine kritische Quelle für Immobilieninformationen in Echtzeit. Analysten nutzen diese Daten, um Angebotsvolumina, Preisanpassungen und regionale Nachfrageverschiebungen zu verfolgen, die von offiziellen Behörden oft nicht so schnell erfasst werden.

Das Scraping von Century 21 Daten ist für Immobilieninvestoren, Prop-Tech-Entwickler und Marktforscher von hohem Wert. Es ermöglicht die Erstellung automatisierter Bewertungsmodelle (AVMs), Wettbewerbs-Benchmarks für Maklerbüros und die Lead-Generierung für sekundäre Dienstleistungen wie Hausversicherungen oder Hypothekenkredite. Die globale Reichweite der Daten macht sie besonders nützlich für den Vergleich internationaler Immobilientrends.

Warum Century 21 Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Century 21.

Markttrend-Analyse

Überwachen Sie regionale Preisschwankungen und Bestandsniveaus, um aufstrebende Immobilien-Hotspots zu identifizieren, bevor sie ihren Höhepunkt erreichen.

Investment-Sourcing

Verfolgen Sie die Metrik 'Tage am Markt', um motivierte Verkäufer zu finden und unterbewertete Immobilien für potenzielle Investitionen zu identifizieren.

Wettbewerbsanalyse

Analysieren Sie das Angebotsvolumen und die Erfolgsquoten konkurrierender Agenturen, um den lokalen Marktanteil zu bestimmen.

Lead-Generierung für Dienstleistungen

Identifizieren Sie neue Angebote, um professionelle Dienstleistungen wie Immobilienfotografie, Home Staging oder Hypothekenvermittlung anzubieten.

Historische Preisdatenbank

Erstellen Sie langfristige Datensätze, um prädiktive Machine Learning Modelle zur Vorhersage künftiger Immobilienmarktzyklen zu trainieren.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Century 21.

Fortgeschrittene Anti-Bot-Erkennung

Die Seite nutzt Akamai Bot Manager und Cloudflare, die Verhaltensanalysen einsetzen, um automatisierte Scripts zu blockieren.

Dynamisches Content-Rendering

Angebote werden oft über JavaScript-Frameworks wie React geladen, was ein vollständiges Browser-Rendering für den Datenzugriff erfordert.

Aggressives IP-Rate-Limiting

Zu viele Anfragen von einer einzigen IP-Adresse führen schnell zu 403 Forbidden Fehlern oder reCAPTCHA-Herausforderungen.

Regionale Subdomain-Varianzen

Verschiedene geografische Subdomains können leicht unterschiedliche HTML-Strukturen aufweisen, was eine flexible Scraping-Logik erfordert.

Scrape Century 21 mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Century 21 extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Century 21, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Century 21 zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Century 21 extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Century 21, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Visuelle No-Code Auswahl: Wählen Sie Objektdaten wie Preis und Adresse direkt im Browser aus, ohne komplexe CSS-Selektoren schreiben zu müssen.

- Automatisiertes Proxy-Management: Umgehen Sie IP-basierte Sperren mühelos mit dem integrierten Residential Proxy Rotationssystem von Automatio.

- Headless Browser Rendering: Führt JavaScript automatisch aus, um sicherzustellen, dass dynamische Karten und Bilder vor der Extraktion vollständig geladen sind.

- Cloud-basierte Zeitplanung: Planen Sie Ihren Scraper so, dass er täglich oder stündlich läuft, um neue Angebote und Preisänderungen ohne manuelles Eingreifen zu erfassen.

- Nahtlose Datenintegration: Exportieren Sie gescrapte Immobiliendaten direkt in Google Sheets oder nutzen Sie Webhooks zur Synchronisierung mit Ihrem CRM oder Ihrer Datenbank.

No-Code Web Scraper für Century 21

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Century 21 helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Century 21

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Century 21 helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Realistische Header sind obligatorisch, um einfache CloudFront-Sperren zu umgehen

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9'

}

def scrape_c21(url):

try:

# Session-Objekte helfen, Cookies über Anfragen hinweg zu speichern

session = requests.Session()

response = session.get(url, headers=headers, timeout=15)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Selektoren zielen auf gängige Klassen für Immobilienkarten ab

listings = soup.select('.property-card')

for item in listings:

price = item.select_one('.listing-price').text.strip() if item.select_one('.listing-price') else 'N/A'

address = item.select_one('.property-address').text.strip() if item.select_one('.property-address') else 'N/A'

print(f'Preis: {price}, Adresse: {address}')

else:

print(f'Blockiert: HTTP {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')

scrape_c21('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Century 21 mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Realistische Header sind obligatorisch, um einfache CloudFront-Sperren zu umgehen

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9'

}

def scrape_c21(url):

try:

# Session-Objekte helfen, Cookies über Anfragen hinweg zu speichern

session = requests.Session()

response = session.get(url, headers=headers, timeout=15)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Selektoren zielen auf gängige Klassen für Immobilienkarten ab

listings = soup.select('.property-card')

for item in listings:

price = item.select_one('.listing-price').text.strip() if item.select_one('.listing-price') else 'N/A'

address = item.select_one('.property-address').text.strip() if item.select_one('.property-address') else 'N/A'

print(f'Preis: {price}, Adresse: {address}')

else:

print(f'Blockiert: HTTP {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')

scrape_c21('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/')Python + Playwright

from playwright.sync_api import sync_playwright

def run(playwright):

# Browser starten, um JavaScript-lastige Property-Cards zu verarbeiten

browser = playwright.chromium.launch(headless=True)

context = browser.new_context(user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36')

page = context.new_page()

# Navigieren und warten, bis sich der Netzwerkverkehr beruhigt hat

page.goto('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/', wait_until='networkidle')

# Sicherstellen, dass der Container sichtbar ist

page.wait_for_selector('.property-card')

listings = page.query_selector_all('.property-card')

for listing in listings:

price_el = listing.query_selector('.listing-price')

addr_el = listing.query_selector('.property-address')

if price_el and addr_el:

print(f'Preis: {price_el.inner_text()} | Adresse: {addr_el.inner_text()}')

browser.close()

with sync_playwright() as playwright:

run(playwright)Python + Scrapy

import scrapy

class C21Spider(scrapy.Spider):

name = 'c21_spider'

start_urls = ['https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/']

def parse(self, response):

# Scrapy CSS-Selektoren sind effizient für die Extraktion von Massendaten

for property in response.css('.property-card'):

yield {

'price': property.css('.listing-price::text').get(default='').strip(),

'address': property.css('.property-address::text').get(default='').strip(),

'details_url': response.urljoin(property.css('a::attr(href)').get())

}

# Den Button für die nächste Seite finden und ihm folgen

next_page = response.css('a.next-page::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

(async () => {

// Verwendung des Stealth-Plugins, um Puppeteer vor der Akamai-Erkennung zu maskieren

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

await page.goto('https://www.century21.com/real-estate/new-york-ny/LCNYNEWYORK/', { waitUntil: 'networkidle2' });

const results = await page.evaluate(() => {

const data = [];

document.querySelectorAll('.property-card').forEach(card => {

data.push({

price: card.querySelector('.listing-price')?.innerText.trim(),

address: card.querySelector('.property-address')?.innerText.trim(),

});

});

return data;

});

console.log(results);

await browser.close();

})();Was Sie mit Century 21-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Century 21-Daten.

Dynamische Preisalarme

Investoren können Preisreduzierungen in bestimmten Postleitzahlengebieten verfolgen, um sofort motivierte Verkäufer zu finden.

So implementieren Sie es:

- 1Wählen Sie ein geografisches Zielgebiet auf Century 21 aus.

- 2Scrapen Sie täglich aktive Angebote und speichern Sie diese in einer Datenbank.

- 3Vergleichen Sie aktuelle Preise mit dem zuvor aufgezeichneten Preis für dieselbe Listing ID.

- 4Senden Sie einen automatisierten Alarm, wenn ein Preis um mehr als einen definierten Prozentsatz fällt.

Verwenden Sie Automatio, um Daten von Century 21 zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Century 21-Daten machen können

- Dynamische Preisalarme

Investoren können Preisreduzierungen in bestimmten Postleitzahlengebieten verfolgen, um sofort motivierte Verkäufer zu finden.

- Wählen Sie ein geografisches Zielgebiet auf Century 21 aus.

- Scrapen Sie täglich aktive Angebote und speichern Sie diese in einer Datenbank.

- Vergleichen Sie aktuelle Preise mit dem zuvor aufgezeichneten Preis für dieselbe Listing ID.

- Senden Sie einen automatisierten Alarm, wenn ein Preis um mehr als einen definierten Prozentsatz fällt.

- Benchmark der Maklerleistung

Inhaber von Immobilienbüros können das Angebotsvolumen von Century 21 überwachen, um ihren eigenen lokalen Marktanteil zu messen.

- Extrahieren Sie Büronamen und Maklernamen aus regionalen Suchergebnissen.

- Aggregieren Sie die Gesamtzahl der Angebote pro Büro.

- Berechnen Sie den Median-Angebotspreis für jedes konkurrierende Büro.

- Identifizieren Sie leistungsstarke Makler für potenzielle Rekrutierungen.

- Lead-Generierung für Hypotheken

Kreditgeber können Immobilien identifizieren, die den Status 'Neu' erhalten, um potenziellen Käufern Finanzierungslösungen anzubieten.

- Scrapen Sie täglich neue Angebote unter Verwendung der Filter 'Tage auf der Website' oder 'Neu'-Badges.

- Filtern Sie Angebote nach Preisklassen, die für Ihre Kreditprodukte relevant sind.

- Extrahieren Sie die Kontaktdaten des Maklers für B2B-Empfehlungsmarketing.

- Überwachen Sie Statusänderungen von Immobilien, um Marketingbemühungen zeitlich abzustimmen.

- Prop-Tech Content-Aggregation

Entwickler können neue Immobilien-Apps mit Live-Beständen füllen, um ihren Nutzern einen Mehrwert zu bieten.

- Scrapen Sie vollständige Objektdaten einschließlich Bildern und Ausstattungsmerkmalen.

- Normalisieren Sie die Daten in ein Standard-JSON-Format für Ihre API.

- Laden Sie die Daten in die Backend-Datenbank Ihrer Anwendung hoch.

- Aktualisieren Sie die Daten alle 24 Stunden, um die Genauigkeit der Angebote zu gewährleisten.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Century 21

Expertentipps für die erfolgreiche Datenextraktion von Century 21.

Residential Proxies priorisieren

Rechenzentrums-IPs werden von Akamai leicht erkannt; Residential Proxies bieten höhere Erfolgsquoten, da sie echten privaten Datenverkehr simulieren.

Stealth-Browser-Plugins nutzen

Verwenden Sie Bibliotheken wie puppeteer-extra-plugin-stealth, um automatisierte Browser-Fingerprints vor fortschrittlichen Bot-Detektoren zu verbergen.

Aus JSON-LD Tags extrahieren

Prüfen Sie den HTML-Quellcode auf Script-Tags mit dem Typ application/ld+json, die oft vorformatierte Objektdaten enthalten.

Zufällige Delays implementieren

Vermeiden Sie einen festen Rhythmus bei Anfragen; das Randomisieren der Wartezeiten zwischen 3 und 10 Sekunden hilft, Verhaltenserkennung zu umgehen.

Mobile User-Agents nutzen

Manchmal weisen mobile Versionen der Website weniger Anti-Bot-Prüfungen oder einfachere DOM-Strukturen auf als die Desktop-Versionen.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Homes.com: Real Estate Data Extraction Guide

How to Scrape LivePiazza: Philadelphia Real Estate Scraper

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Sacramento Delta Property Management

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape Apartments Near Me | Real Estate Data Scraper

Häufig gestellte Fragen zu Century 21

Finden Sie Antworten auf häufige Fragen zu Century 21