Wie man Exploit-DB scrapt | Exploit Database Web Scraper

Erfahren Sie, wie Sie Exploit-DB nach Schwachstellendaten, Exploit-Codes und CVE-Referenzen scrappen, um die Cybersecurity-Forschung und automatisierte Threat...

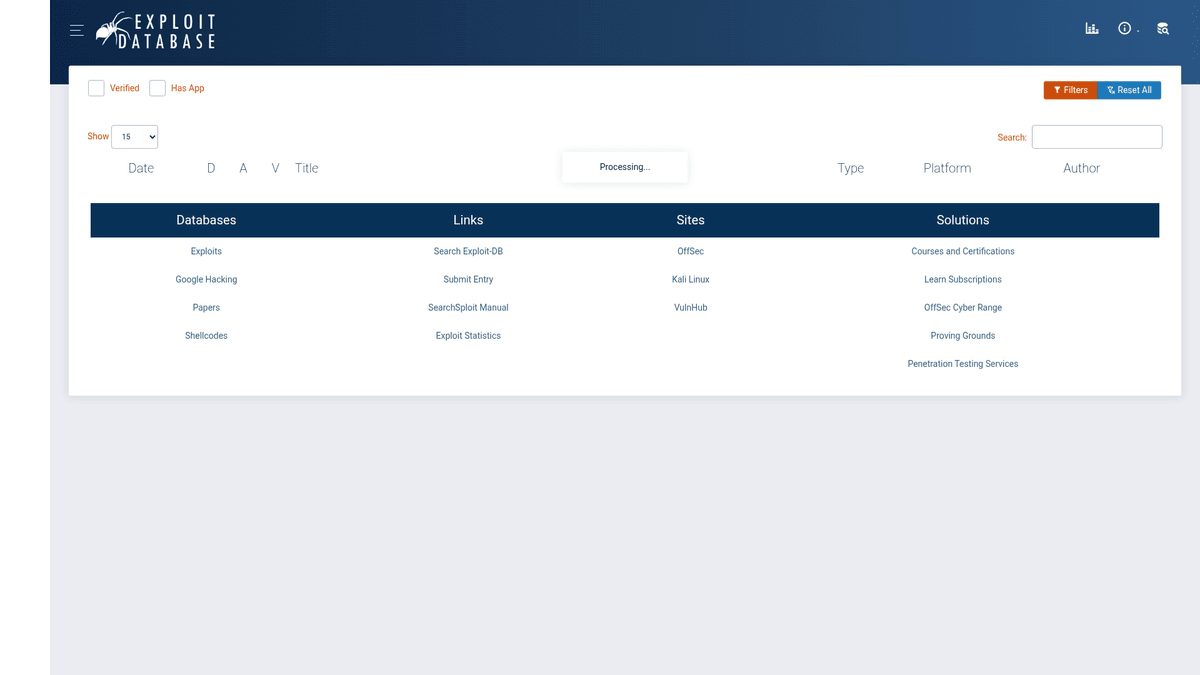

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

- JavaScript-Challenge

- Erfordert JavaScript-Ausführung zum Zugriff auf Inhalte. Einfache Anfragen scheitern; Headless-Browser wie Playwright oder Puppeteer nötig.

Über Exploit Database

Entdecken Sie, was Exploit Database bietet und welche wertvollen Daten extrahiert werden können.

Umfassendes Repository für Schwachstellen

Die Exploit Database (Exploit-DB) ist ein CVE-konformes Archiv für öffentliche Exploits und entsprechende anfällige Software, entwickelt für Penetrationstester und Schwachstellenforscher. Gepflegt von OffSec (Offensive Security), dient sie als zentraler Hub für die Cybersecurity-Community, um Proof-of-Concept-Code und Forschungsergebnisse über verschiedene Plattformen und Anwendungen hinweg zu teilen. Das Repository ist eine der vertrauenswürdigsten Quellen für Sicherheitsexperten weltweit.

Datenkategorisierung und Tiefe

Die Website organisiert Daten in granulare Kategorien wie Remote Exploits, Web Applications, Local Exploits und Shellcodes. Jeder Eintrag enthält typischerweise den Exploit-Titel, das Datum, den Autor, die Plattform, die zugehörige CVE ID und den rohen Exploit-Code. Dieser strukturierte Ansatz ermöglicht es Forschern, schnell zwischen verschiedenen Arten von Schwachstellen und ihrem historischen Kontext zu wechseln.

Strategischer Wert für den Security-Betrieb

Das Scraping dieser Daten ist für Security Operations Centers (SOCs) und Threat Intelligence-Teams von großem Wert, um bekannte Exploits mit internen Schwachstellen zu korrelieren. Durch die Automatisierung der Extraktion von PoC-Code und Metadaten können Unternehmen eigene Sicherheitssignaturen erstellen, ihren Vulnerability-Management-Lebenszyklus verbessern und robuste Threat Intelligence Feeds aufbauen.

Warum Exploit Database Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Exploit Database.

Threat Intelligence Enrichment

Automatisieren Sie die Sammlung neuer Proof-of-Concept-Exploits, um interne Security Operations Center und Threat Intelligence Plattformen zu speisen.

Priorisierung von Schwachstellen

Gleichen Sie interne Asset-Schwachstellen mit öffentlich verfügbaren Exploits ab, um zu bestimmen, welche Patches sofort angewendet werden müssen.

Entwicklung von Sicherheitstools

Integrieren Sie funktionalen Exploit-Code und Shellcode in eigene Penetration-Testing-Frameworks oder automatisierte Sicherheitsbewertungstools.

Compliance-Auditing

Führen Sie eine historische Aufzeichnung von Exploits für spezifische Softwareversionen, um sicherzustellen, dass Systeme die regulatorischen Sicherheitsanforderungen erfüllen.

Zero-Day-Monitoring

Richten Sie Alarme für neu veröffentlichte Exploits ein, die auf kritische Infrastrukturen oder weit verbreitete Unternehmenssoftware abzielen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Exploit Database.

JavaScript-basiertes Rendering

Die Hauptdatenbank der Exploits wird über jQuery DataTables gerendert, was sie für einfache HTTP-Scraper, die kein JavaScript ausführen, unsichtbar macht.

Cloudflare Anti-Bot-Barrieren

Exploit-DB wird durch Cloudflare geschützt, das Browser-Fingerprinting und TLS-Challenges einsetzt, um nicht-menschlichen Traffic zu blockieren.

Striktes Rate Limiting

Wiederholte Anfragen nach Raw-Exploit-Codedateien lösen oft IP-basiertes Rate Limiting oder temporäre Sperren aus, wenn sie nicht ordnungsgemäß gesteuert werden.

Dynamisches Laden von Inhalten

Die Website nutzt AJAX zum Laden von Tabellendaten, was erfordert, dass der Scraper entweder auf Netzwerk-Idle wartet oder gezielte API-Aufrufe abfängt.

Scrape Exploit Database mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Exploit Database extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Exploit Database, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Exploit Database zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Exploit Database extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Exploit Database, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Automatisches Anti-Bot-Handling: Automatio bewältigt Cloudflare-Challenges und Browser-Fingerprinting nativ, sodass Ihre Scraping-Aufgaben ohne manuelles Eingreifen laufen.

- Visuelle Datenauswahl: Bilden Sie die komplexe DataTable-Struktur einfach ab, indem Sie auf die Elemente klicken, die Sie extrahieren möchten, ohne komplexes CSS- oder XPath-Coding.

- Geplante Datensynchronisation: Stellen Sie Ihren Scraper so ein, dass er in bestimmten Intervallen läuft, um sicherzustellen, dass Ihre Threat Intelligence Feeds immer mit den neuesten Exploits aktualisiert werden.

No-Code Web Scraper für Exploit Database

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Exploit Database helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Exploit Database

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Exploit Database helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Exploit-DB verwendet Cloudflare; einfache Requests könnten blockiert werden

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Hinweis: Hauptdaten werden über AJAX geladen, das initiale HTML ist ein Grundgerüst

print('Seitentitel:', soup.title.text)

except Exception as e:

print(f'Fehler aufgetreten: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Exploit Database mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Exploit-DB verwendet Cloudflare; einfache Requests könnten blockiert werden

url = 'https://www.exploit-db.com/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Hinweis: Hauptdaten werden über AJAX geladen, das initiale HTML ist ein Grundgerüst

print('Seitentitel:', soup.title.text)

except Exception as e:

print(f'Fehler aufgetreten: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_exploit_db():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://www.exploit-db.com/')

# Warten, bis die DataTables via AJAX geladen sind

page.wait_for_selector('table#exploits-table')

rows = page.query_selector_all('table#exploits-table tbody tr')

for row in rows[:5]:

print(row.inner_text())

browser.close()

scrape_exploit_db()Python + Scrapy

import scrapy

class ExploitSpider(scrapy.Spider):

name = 'exploit_spider'

start_urls = ['https://www.exploit-db.com/']

def parse(self, response):

# Scrapy benötigt für diese Website eine JS-Middleware wie scrapy-playwright

for exploit in response.css('table#exploits-table tbody tr'):

yield {

'title': exploit.css('td.title a::text').get(),

'id': exploit.css('td.id::text').get(),

'cve': exploit.css('td.cve a::text').get()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://www.exploit-db.com/', { waitUntil: 'networkidle2' });

const results = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('table#exploits-table tbody tr'));

return rows.map(row => row.innerText);

});

console.log(results.slice(0, 5));

await browser.close();

})();Was Sie mit Exploit Database-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Exploit Database-Daten.

Echtzeit-Threat Intelligence Feed

Erstellen Sie einen kontinuierlichen Feed neuer Exploits, um Sicherheitsteams vor aufkommenden Bedrohungen zu warnen.

So implementieren Sie es:

- 1Richten Sie einen täglich geplanten Scrape der Homepage ein

- 2Vergleichen Sie neue EDB-IDs mit zuvor gescrapten Datensätzen

- 3Lösen Sie Slack- oder E-Mail-Benachrichtigungen für neue kritische Exploits aus

Verwenden Sie Automatio, um Daten von Exploit Database zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Exploit Database-Daten machen können

- Echtzeit-Threat Intelligence Feed

Erstellen Sie einen kontinuierlichen Feed neuer Exploits, um Sicherheitsteams vor aufkommenden Bedrohungen zu warnen.

- Richten Sie einen täglich geplanten Scrape der Homepage ein

- Vergleichen Sie neue EDB-IDs mit zuvor gescrapten Datensätzen

- Lösen Sie Slack- oder E-Mail-Benachrichtigungen für neue kritische Exploits aus

- Schwachstellen-Korrelation und Patching

Helfen Sie IT-Teams, Software-Patches basierend auf der Existenz von funktionierendem Exploit-Code zu priorisieren.

- Extrahieren Sie CVE IDs und zugehörige Exploit-Metadaten

- Gleichen Sie diese mit internen Software-Inventarlisten ab

- Markieren Sie Systeme mit öffentlich verfügbaren Exploits für sofortiges Patching

- Automatisierte SIEM-Signatur-Erstellung

Extrahieren Sie Proof-of-Concept-Shellcode, um defensive Signaturen für die Angriffserkennung zu entwickeln.

- Navigieren Sie zu einzelnen Exploit-Seiten und scrapen Sie den rohen Code

- Analysieren Sie den Code auf eindeutige Byte-Muster oder Netzwerk-Strings

- Speisen Sie extrahierte Muster in SIEM- oder IDS/IPS-Regelgeneratoren ein

- Historische Trendanalyse von Schwachstellen

Analysieren Sie ein Jahrzehnt an Exploit-Daten, um zu verstehen, welche Plattformen im Laufe der Zeit am meisten angegriffen werden.

- Scrapen Sie das gesamte Archiv inklusive Daten, Plattformen und Typen

- Aggregieren Sie die Daten nach Plattform und Jahr

- Visualisieren Sie Angriffstrends mit BI-Tools wie Tableau oder PowerBI

- Akademische Cybersecurity-Datensätze

Bereitstellung hochwertiger, strukturierter Daten für machine learning model zur Vorhersage der Zuverlässigkeit von Exploits.

- Scrapen Sie verifizierte versus nicht verifizierte Exploits

- Extrahieren Sie den Quellcode und die Metadaten-Attribute

- Trainieren Sie machine learning model, um Code-Muster erfolgreicher Exploits zu klassifizieren

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Exploit Database

Expertentipps für die erfolgreiche Datenextraktion von Exploit Database.

XHR-Anfragen abfangen

Anstatt das gerenderte HTML zu scrappen, sollten Sie nach den internen JSON-Anfragen suchen, die von den DataTables gesendet werden, um saubere, strukturierte Daten direkt zu extrahieren.

Residential Proxies nutzen

Rotieren Sie über hochwertige Residential Proxies, um das Auslösen der aggressiven Web Application Firewall (WAF) und der Rate-Limits der Website zu vermeiden.

Nach Verifizierung filtern

Prüfen Sie programmatisch das Feld 'Verified', um hochwertigen, funktionalen Exploit-Code für Ihre Sicherheitsdatensätze zu priorisieren.

CVE-Identifikatoren bereinigen

Normalisieren Sie die extrahierten CVE-Strings stets in ein Standardformat, um eine einfache Integration mit anderen Schwachstellen-Datenbanken wie der NVD zu gewährleisten.

Den GitLab-Mirror konsultieren

Bevor Sie einen umfangreichen Scrape durchführen, prüfen Sie das offizielle Exploit-DB GitLab-Repository auf Bulk-CSV-Daten, die für historische Aufzeichnungen einfacher zu verarbeiten sind.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Biluppgifter.se: Vehicle Data Extraction Guide

How to Scrape CSS Author: A Comprehensive Web Scraping Guide

How to Scrape Bilregistret.ai: Swedish Vehicle Data Extraction Guide

How to Scrape The AA (theaa.com): A Technical Guide for Car & Insurance Data

How to Scrape Car.info | Vehicle Data & Valuation Extraction Guide

How to Scrape GoAbroad Study Abroad Programs

How to Scrape ResearchGate: Publication and Researcher Data

How to Scrape Statista: The Ultimate Guide to Market Data Extraction

Häufig gestellte Fragen zu Exploit Database

Finden Sie Antworten auf häufige Fragen zu Exploit Database