Wie man jup.ag scrapt: Jupiter DEX Web Scraper Guide

Erfahren Sie, wie Sie jup.ag für Solana-Token-Preise, Swap-Routen und Marktvolumen in Echtzeit scrapen. Nutzen Sie Jupiters offizielle APIs und umgehen Sie den...

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- Browser-Fingerprinting

- Identifiziert Bots anhand von Browser-Eigenschaften: Canvas, WebGL, Schriftarten, Plugins. Erfordert Spoofing oder echte Browser-Profile.

- Browser-Fingerprinting

- Identifiziert Bots anhand von Browser-Eigenschaften: Canvas, WebGL, Schriftarten, Plugins. Erfordert Spoofing oder echte Browser-Profile.

Über Jupiter

Entdecken Sie, was Jupiter bietet und welche wertvollen Daten extrahiert werden können.

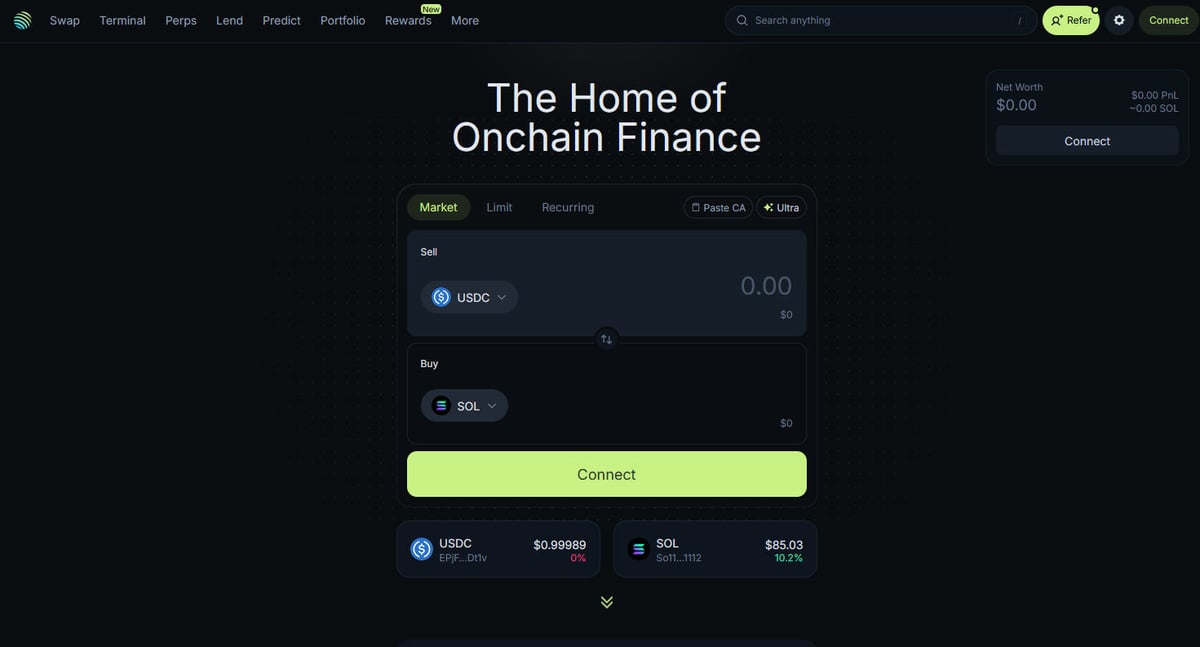

Das Zentrum von Solana DeFi

Jupiter ist der primäre Liquiditätsaggregator für die Solana-Blockchain und fungiert als „DeFi Superapp“, die das Trade-Routing über hunderte von Liquiditätspools hinweg optimiert, um Nutzern die besten Preise und minimalen Slippage zu bieten. Es ist der zentrale Knotenpunkt für das On-Chain-Finanzwesen von Solana und bietet Dienste an, die von einfachen Token-Swaps bis hin zu erweiterten Funktionen wie Perpetual-Trading mit bis zu 250-fachem Hebel, Limit-Orders und Dollar-Cost Averaging (DCA) reichen. Die Plattform liefert kritische Daten für das Ökosystem, einschließlich Echtzeit-Preisen, Liquiditätstiefe und umfassenden Marktmetriken für tausende von Assets.

Technische Architektur

Die Website basiert auf einem modernen technischen Stack mit Next.js und React, was sie zu einer hochdynamischen Single-Page-Application (SPA) macht. Da Preise und Routen in Echtzeit basierend auf dem aktuellen Blockchain-Status berechnet werden, aktualisiert sich das Frontend ständig über WebSockets und hochfrequente API-Aufrufe. Für Data Scientists, Entwickler und Trader gelten die Daten von Jupiter als der Goldstandard für die Verfolgung der Marktstimmung und Liquiditätsverschiebungen im gesamten Solana-Ökosystem.

Warum die Daten wichtig sind

Der Zugriff auf diese Daten ist unerlässlich für den Aufbau von Trading-Bots, Markt-Dashboards und die Durchführung historischer Analysen in einem der am schnellsten wachsenden Blockchain-Netzwerke. Scraper zielen oft auf Jupiter ab, um neue Token-Listings zu überwachen, „Whale“-Bewegungen in Perpetual-Märkten zu verfolgen oder Preisdivergenzen für Arbitrage zu identifizieren. Während die Plattform offizielle APIs anbietet, wird direktes Web Scraping häufig eingesetzt, um den exakten UI-Zustand und spezifische Routing-Daten zu erfassen, die in öffentlichen Endpunkten möglicherweise nicht vollständig offengelegt werden.

Warum Jupiter Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Jupiter.

Echtzeit-Preisverfolgung

Überwachen Sie Solana-Token-Preise in Echtzeit, um sich im hochvolatilen DeFi-Markt einen Vorteil zu verschaffen. Jupiter aggregiert Liquidität über das gesamte Ökosystem und liefert die genauesten verfügbaren Marktkurse.

Optimierung von Trading-Bots

Speisen Sie hochfrequente Swap-Routen- und Price-Impact-Daten in automatisierte Trading-Bots für Arbitrage oder Sniping ein. Dies ermöglicht eine schnellere Ausführung und bessere Preisfindung im Vergleich zum manuellen Handel.

Marktsentiment-Analyse

Verfolgen Sie die Aufnahme neuer Tokens in die 'Strict'-Liste von Jupiter, um Trendprojekte und das Vertrauen der Community zu identifizieren. Die Analyse von Volumenverschiebungen über verschiedene Assets hinweg hilft bei der Vorhersage breiterer Marktbewegungen.

Überwachung der Liquiditätstiefe

Scrapen Sie Liquiditätsdaten, um die Markttiefe spezifischer SPL-Tokens zu bestimmen und das Potenzial für Slippage einzuschätzen. Dies ist entscheidend für Großhändler und institutionelle Liquiditätsanbieter.

Historische Performance-Daten

Sammeln Sie tägliche Volumen- und Preishistorien für Tokens, die möglicherweise nicht an zentralisierten Börsen gelistet sind. Diese Daten sind essenziell für das Backtesting von Handelsstrategien und langfristige Marktforschung.

Metriken zum Ökosystem-Wachstum

Messen Sie das Gesamtvolumen und die Transaktionsanzahl im Solana-Netzwerk, indem Sie Jupiter als Proxy nutzen. Dies hilft Entwicklern und Investoren, die Adaptionsrate von Solana DeFi im Zeitverlauf zu verstehen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Jupiter.

Abhängigkeit vom JavaScript-Rendering

Jupiter ist als komplexe Single Page Application (SPA) mit React aufgebaut, was bedeutet, dass Daten nicht im initialen HTML vorhanden sind. Sie müssen ein Tool verwenden, das JavaScript vollständig rendern kann, um auf Preise und Token-Listen zuzugreifen.

Aggressiver Cloudflare-Schutz

Die Website nutzt die Web Application Firewall (WAF) von Cloudflare, um Nicht-Browser-Traffic und automatisierte Skripte zu blockieren. Das Umgehen dieser Hürden erfordert fortgeschrittenes Browser-Fingerprinting und Header-Management.

Dynamischer Datenstrom

Preise und Swap-Routen werden mehrmals pro Sekunde über WebSockets und hochfrequente API-Aufrufe aktualisiert. Das Erfassen konsistenter Snapshots dieser Daten erfordert eine Scraping-Infrastruktur mit geringer Latency und präzisem Timing.

Rate Limiting auf öffentlichen Endpunkten

Öffentlich zugängliche API-Endpunkte und Web-Routen sind streng limitiert, um Missbrauch zu verhindern. Das Überschreiten dieser Limits führt oft zu temporären oder permanenten IP-Sperren, was Residential Proxies unumgänglich macht.

Volatilität der UI-Selektoren

Häufige Updates am Jupiter-Frontend können dazu führen, dass sich CSS-Klassen und DOM-Strukturen ohne Vorankündigung ändern. Dies erfordert Scraper mit robusten, flexiblen Selektoren oder eine häufige Wartung, um Ausfälle zu vermeiden.

Scrape Jupiter mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Jupiter extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Jupiter, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Jupiter zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Jupiter extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Jupiter, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Vollständiges Headless-Rendering: Automatio verarbeitet nativ das komplexe JavaScript-Rendering der Jupiter-Oberfläche und stellt sicher, dass Sie dieselben Daten sehen wie ein menschlicher Nutzer. Sie müssen sich keine Sorgen über fehlende Daten machen, die erst nach dem Laden der Seite erscheinen.

- Intelligente Proxy-Rotation: Die integrierte Rotation von Residential Proxies ermöglicht es Ihnen, Cloudflare und IP-basiertes Rate Limiting mühelos zu umgehen. Dies stellt sicher, dass Ihre Scraping-Sessions selbst bei hochfrequenten Abfragen unterbrechungsfrei bleiben.

- Visuelle Datenauswahl: Wählen Sie spezifische Token-Preise, Volumina oder Routen, die Sie scrapen möchten, einfach über ein Point-and-Click-Interface aus. Es ist nicht nötig, komplexe XPath- oder CSS-Selektoren für dynamische Elemente zu schreiben.

- Automatisierte Zeitplanung: Stellen Sie Ihre Jupiter-Scraper so ein, dass sie nach einem präzisen Zeitplan laufen (z. B. jede Minute oder jede Stunde), um einen aktuellen Datensatz zu pflegen. Ideal für Echtzeit-Dashboards oder automatisierte Preisalarme.

- Direkte Datenintegration: Senden Sie Ihre gescrapten DeFi-Daten über Webhooks direkt an Google Sheets, Airtable oder Ihre eigene Datenbank. Dies eliminiert manuelle Dateneingaben und optimiert Ihren Trading- oder Research-Workflow.

No-Code Web Scraper für Jupiter

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Jupiter helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Jupiter

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Jupiter helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

def get_jupiter_price(token_address):

# Die Verwendung der offiziellen Jupiter Price API V2 ist die zuverlässigste Methode

url = f"https://api.jup.ag/price/v2?ids={token_address}"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36",

"Accept": "application/json"

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

data = response.json()

price_info = data['data'].get(token_address)

if price_info:

print(f"Token: {token_address} | Preis: ${price_info['price']}")

except Exception as e:

print(f"Ein Fehler ist aufgetreten: {e}")

# Beispiel: Abrufen des SOL-Preises

get_jupiter_price("So11111111111111111111111111111111111111112")Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Jupiter mit Code scrapt

Python + Requests

import requests

def get_jupiter_price(token_address):

# Die Verwendung der offiziellen Jupiter Price API V2 ist die zuverlässigste Methode

url = f"https://api.jup.ag/price/v2?ids={token_address}"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36",

"Accept": "application/json"

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

data = response.json()

price_info = data['data'].get(token_address)

if price_info:

print(f"Token: {token_address} | Preis: ${price_info['price']}")

except Exception as e:

print(f"Ein Fehler ist aufgetreten: {e}")

# Beispiel: Abrufen des SOL-Preises

get_jupiter_price("So11111111111111111111111111111111111111112")Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_jupiter_tokens():

with sync_playwright() as p:

# Starten eines Browsers, der das Next.js-Frontend rendern kann

browser = p.chromium.launch(headless=True)

context = browser.new_context(

user_agent="Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36"

)

page = context.new_page()

page.goto("https://jup.ag/tokens", wait_until="networkidle")

# Warten, bis die Token-Listen-Elemente im DOM gerendert sind

# Hinweis: Selektoren müssen basierend auf dem aktuellen UI-Build aktualisiert werden

page.wait_for_selector(".token-item")

tokens = page.query_selector_all(".token-item")

for token in tokens[:10]:

name = token.query_selector(".token-name").inner_text()

price = token.query_selector(".token-price").inner_text()

print(f"{name}: {price}")

browser.close()

scrape_jupiter_tokens()Python + Scrapy

import scrapy

import json

class JupiterTokenSpider(scrapy.Spider):

name = 'jupiter_tokens'

# Direktes Aufrufen des vom Frontend verwendeten Token-Listen-JSON-Endpunkts

start_urls = ['https://token.jup.ag/all']

def parse(self, response):

# Die Antwort ist eine rohe JSON-Liste aller verifizierten Token

tokens = json.loads(response.text)

for token in tokens[:100]:

yield {

'symbol': token.get('symbol'),

'name': token.get('name'),

'address': token.get('address'),

'decimals': token.get('decimals'),

'logoURI': token.get('logoURI')

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

// Setzen eines realistischen User-Agents, um einfache Filter zu umgehen

await page.setUserAgent('Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36');

// Navigieren zur Haupt-Swap-Seite

await page.goto('https://jup.ag/', { waitUntil: 'networkidle2' });

// Beispiel für die Extraktion eines Preiselements mittels Teilselektor

const solPrice = await page.evaluate(() => {

const element = document.querySelector('div[class*="price"]');

return element ? element.innerText : 'Preis nicht gefunden';

});

console.log(`Live SOL-Preis in der UI beobachtet: ${solPrice}`);

await browser.close();

})();Was Sie mit Jupiter-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Jupiter-Daten.

Preis-Arbitrage-Alarmsystem

Identifizieren Sie Preisunterschiede zwischen Jupiter und anderen Solana DEXs, um profitable Trades auszuführen.

So implementieren Sie es:

- 1Scrapen Sie Echtzeit-Swap-Raten von der Jupiter Price API.

- 2Vergleichen Sie die Raten mit den Liquiditätspools von Orca und Raydium.

- 3Richten Sie automatisierte Alarme oder Execution Hooks für Arbitrage-Möglichkeiten ein.

Verwenden Sie Automatio, um Daten von Jupiter zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Jupiter-Daten machen können

- Preis-Arbitrage-Alarmsystem

Identifizieren Sie Preisunterschiede zwischen Jupiter und anderen Solana DEXs, um profitable Trades auszuführen.

- Scrapen Sie Echtzeit-Swap-Raten von der Jupiter Price API.

- Vergleichen Sie die Raten mit den Liquiditätspools von Orca und Raydium.

- Richten Sie automatisierte Alarme oder Execution Hooks für Arbitrage-Möglichkeiten ein.

- Solana Market Health Dashboard

Erstellen Sie eine Makro-Ansicht der Solana DeFi-Aktivitäten für Investoren.

- Aggregieren Sie das 24h-Volumen und die TVL-Daten für Top-Tokens.

- Kategorisieren Sie Token nach Sektoren (Meme, AI, RWA).

- Visualisieren Sie Liquiditätsverschiebungen über verschiedene Asset-Klassen im Zeitverlauf.

- New Token Listing Sniper

Erkennen und analysieren Sie neue Token, die sofort auf Jupiters verifizierter Liste erscheinen.

- Scrapen Sie regelmäßig den Token-Listen-Endpunkt.

- Vergleichen Sie die neuen Ergebnisse mit einer lokalen Datenbank, um Neuzugänge zu finden.

- Analysieren Sie die anfängliche Liquidität und das Volumen, um das Potenzial des Tokens zu bewerten.

- Whale- und Perps-Tracker

Überwachen Sie große Positionen und Funding-Rates im Jupiter Perpetuals-Markt.

- Scrapen Sie Open Interest und Funding-Rate-Daten aus dem Perps-Bereich.

- Verfolgen Sie große Transaktionsprotokolle, um das Verhalten von Wallets zu identifizieren.

- Erstellen Sie Sentiment-Modelle basierend auf den Long/Short-Ratios großer Assets.

- Yield-Aggregation-Service

Bieten Sie Nutzern die besten verfügbaren Kreditzinsen über Jupiter Lend Vaults an.

- Scrapen Sie APY-Daten für verschiedene Stablecoins und SOL-Paare.

- Berechnen Sie die Nettorendite nach geschätzten Plattformgebühren.

- Automatisieren Sie Rebalancing-Empfehlungen zur Portfolio-Optimierung.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Jupiter

Expertentipps für die erfolgreiche Datenextraktion von Jupiter.

Offizielle API-Endpunkte priorisieren

Verwenden Sie nach Möglichkeit die offiziellen V6 Quote- oder Price-APIs von Jupiter anstatt die UI zu scrapen. Diese Endpunkte sind für hochperformanten, programmatischen Zugriff konzipiert und in der Regel stabiler.

Exponential Backoff implementieren

Wenn Ihre Anfragen ein Rate Limiting erreichen, verwenden Sie eine Strategie, die die Wartezeit zwischen den Versuchen schrittweise erhöht. Dies hilft zu verhindern, dass Ihre IP vom Sicherheitslayer von Jupiter als bösartig eingestuft wird.

Über die Strict-Liste filtern

Scrapen Sie die 'Strict'-Token-Liste von Jupiter, um sicherzustellen, dass Sie nur verifizierte Assets überwachen. Dies ist der beste Weg, um Rugpulls mit geringer Liquidität und Scam-Tokens zu filtern, die in der 'All'-Liste erscheinen.

Hochwertige Residential Proxies verwenden

Vermeiden Sie Datacenter-Proxies, da diese oft vorab von Cloudflare auf die Blacklist gesetzt werden. Residential oder mobile Proxies genießen mehr Vertrauen und lösen seltener CAPTCHAs oder 403-Forbidden-Fehler aus.

WebSocket-Traffic überwachen

Nutzen Sie den Netzwerk-Inspektor Ihres Browsers, um die WebSocket-Verbindungen zu finden, die Jupiter für Live-Updates nutzt. Das Emulieren dieser Verbindungen kann effizienter sein, als die Seite für Echtzeit-Preis-Feeds neu zu laden.

Token-Dezimalstellen berücksichtigen

Extrahieren Sie beim Scraping von Mint-Adressen immer das Feld 'decimals' aus den Token-Metadaten. Dies ist entscheidend, um rohe On-Chain-Integers korrekt in menschenlesbare Währungsbeträge umzurechnen.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

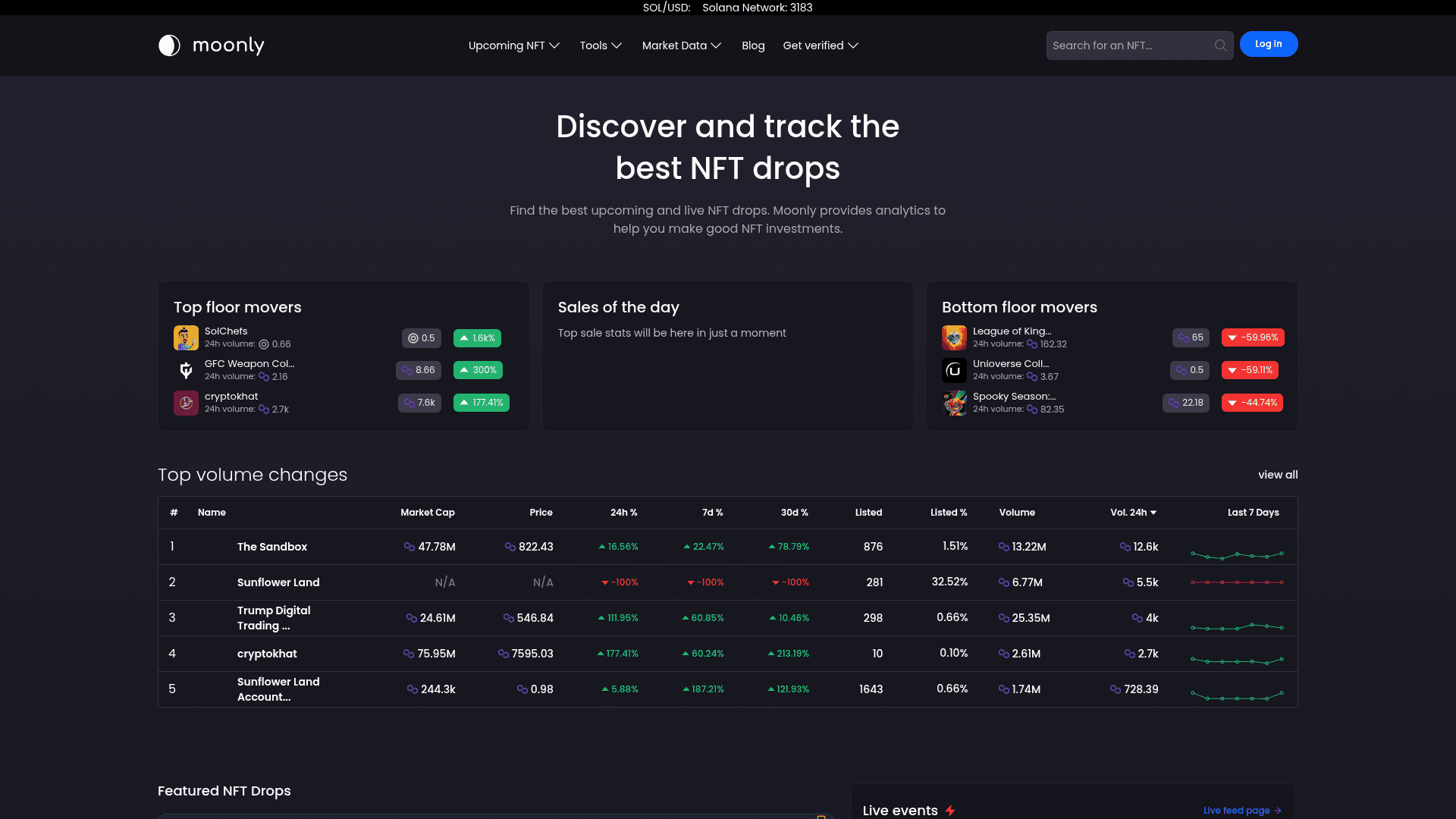

How to Scrape Moon.ly | Step-by-Step NFT Data Extraction Guide

How to Scrape Yahoo Finance: Extract Stock Market Data

How to Scrape Rocket Mortgage: A Comprehensive Guide

How to Scrape Open Collective: Financial and Contributor Data Guide

How to Scrape Indiegogo: The Ultimate Crowdfunding Data Extraction Guide

How to Scrape ICO Drops: Comprehensive Crypto Data Guide

How to Scrape Crypto.com: Comprehensive Market Data Guide

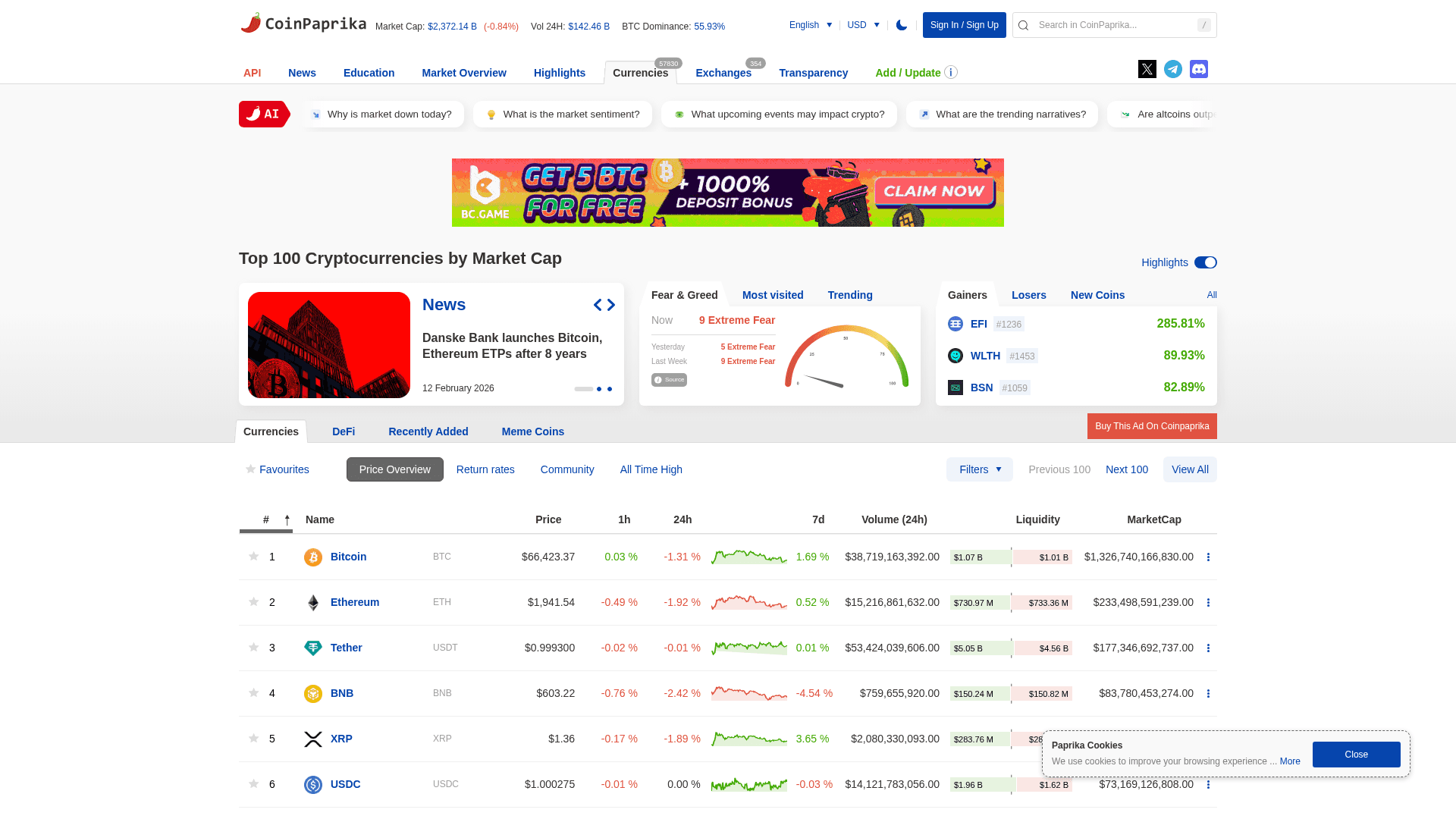

How to Scrape Coinpaprika: Crypto Market Data Extraction Guide

Häufig gestellte Fragen zu Jupiter

Finden Sie Antworten auf häufige Fragen zu Jupiter