Wie man Kleinanzeigen scrapt | Deutschlands größter Marktplatz

Erfahren Sie, wie Sie Kleinanzeigen für Preisüberwachung, Immobilientrends und Lead-Generierung scrapen. Extrahieren Sie Titel und Preise von Deutschlands...

Anti-Bot-Schutz erkannt

- Akamai Bot Manager

- Fortschrittliche Bot-Erkennung mittels Geräte-Fingerprinting, Verhaltensanalyse und maschinellem Lernen. Eines der ausgereiftesten Anti-Bot-Systeme.

- DataDome

- Echtzeit-Bot-Erkennung mit ML-Modellen. Analysiert Geräte-Fingerabdruck, Netzwerksignale und Verhaltensmuster. Häufig auf E-Commerce-Seiten.

- Google reCAPTCHA

- Googles CAPTCHA-System. v2 erfordert Benutzerinteraktion, v3 läuft unsichtbar mit Risikobewertung. Kann mit CAPTCHA-Diensten gelöst werden.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

- Browser-Fingerprinting

- Identifiziert Bots anhand von Browser-Eigenschaften: Canvas, WebGL, Schriftarten, Plugins. Erfordert Spoofing oder echte Browser-Profile.

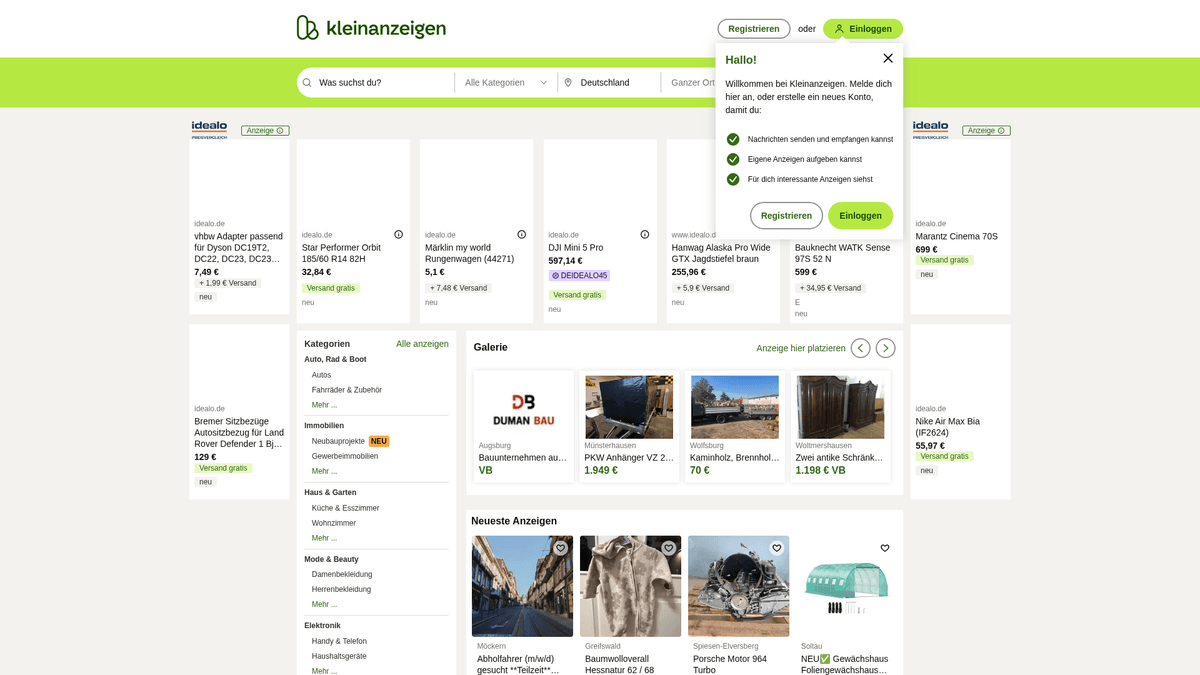

Über Kleinanzeigen

Entdecken Sie, was Kleinanzeigen bietet und welche wertvollen Daten extrahiert werden können.

Deutschlands wichtigster Hub für Kleinanzeigen

Kleinanzeigen, ehemals bekannt als eBay Kleinanzeigen, ist der bedeutendste Online-Marktplatz für Kleinanzeigen in Deutschland. Er bedient täglich Millionen aktiver Nutzer und ermöglicht Transaktionen für alles – von hochwertigen Immobilien und Fahrzeugen bis hin zu Haushaltsmöbeln und spezialisierten lokalen Dienstleistungen. Aufgrund seiner enormen Größe und tiefen Verwurzelung im deutschen Markt fungiert die Plattform als Spiegelbild der deutschen Sekundärwirtschaft und der lokalen Wohnungsnachfrage.

Warum das Scraping von Kleinanzeigen wichtig ist

Der Zugriff auf strukturierte Daten auf Kleinanzeigen ist entscheidend für Unternehmen, die Marktschwankungen in Mitteleuropa verstehen wollen. Die Plattform enthält lokalisierte Informationen, die auf globalen Handelsseiten nicht verfügbar sind, was sie zu einer Goldgrube für regionales Preis-benchmarking und Trendanalysen macht. Egal, ob Sie den Wiederverkaufswert von Elektronik verfolgen oder Mietpreissteigerungen in Berlin überwachen – Scraping liefert die granularen Daten, die für fundierte Entscheidungen erforderlich sind.

Warum Kleinanzeigen Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Kleinanzeigen.

Immobilien-Investment-Monitoring

Verfolgen Sie Wohnungs- und Hauspreise in verschiedenen deutschen Städten, um unterbewertete Investitionsmöglichkeiten zu identifizieren, bevor sie auf den großen Immobilienportalen erscheinen.

Gebrauchtwagen-Marktanalyse

Analysieren Sie Automobil-Anzeigen, um aktuelle Marktwerte für bestimmte Marken und Modelle basierend auf Kilometerstand, Alter und Ausstattung zu ermitteln.

Lead-Generierung für Umzugsservices

Identifizieren Sie potenzielle Kunden, die einen Umzug planen, indem Sie Anzeigen für Möbelverkäufe mit Keywords wie 'Umzug' oder 'Haushaltsauflösung' scrapen.

Preis-Benchmarking für den Sekundärmarkt

Überwachen Sie den Wiederverkaufswert von Unterhaltungselektronik und Luxusgütern, um Inzahlungnahme-Angebote oder Wettbewerbspreise für Neuware zu optimieren.

Entdeckung lokaler Dienstleister

Erstellen Sie eine Datenbank lokaler Handwerker, Gärtner und Reinigungsdienste, die in bestimmten Regionen direkt für deutsche Konsumenten werben.

Tracking wirtschaftlicher Trends

Aggregieren Sie Anzeigenvolumina und Preisdaten im Zeitverlauf, um die regionale Wirtschaftslage und Verschiebungen in der Verbrauchernachfrage innerhalb Deutschlands zu untersuchen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Kleinanzeigen.

Akamai Bot-Management

Kleinanzeigen nutzt den Enterprise-Bot-Schutz von Akamai, der Browser-Fingerprints und TLS-Signaturen analysiert, um automatisierte Requests zu blockieren.

Strikte Geo-Fencing-Richtlinien

Die Plattform blockiert oder drosselt häufig Traffic, der von außerhalb Deutschlands oder von bekannten Datacenter-IP-Bereichen stammt.

Dynamische Inhalte und JavaScript

Viele Elemente, einschließlich Kontaktdaten und Pagination-Trigger, erfordern die Ausführung von JavaScript, um korrekt geladen zu werden.

Häufige strukturelle Änderungen

Das HTML-Layout und die CSS-Selektoren werden regelmäßig aktualisiert, was dazu führen kann, dass statische Scraper ohne ständige Wartung ausfallen.

Aggressives Rate Limiting

Zu viele Requests in einem kurzen Zeitfenster von einer einzelnen IP lösen sofortige 403-Fehler oder komplexe reCAPTCHA-Herausforderungen aus.

Scrape Kleinanzeigen mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Kleinanzeigen extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Kleinanzeigen, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Kleinanzeigen zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Kleinanzeigen extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Kleinanzeigen, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Fortschrittlicher Anti-Bot-Bypass: Automatio verwaltet komplexe Header, Cookies und Fingerprinting automatisch, um von Enterprise-Schutzmaßnahmen wie Akamai unentdeckt zu bleiben.

- No-Code Flexibilität: Aktualisieren Sie Ihren Scraper schnell über ein visuelles Interface, falls sich das Website-Layout ändert, und sparen Sie Stunden bei Debugging und Code-Anpassungen.

- Nahtlose Proxy-Integration: Verbinden Sie ganz einfach deutsche Residential Proxies, um Geo-Blocks zu umgehen und eine hohe Erfolgsrate bei großflächigen Extraktionen beizubehalten.

- Workflow-Scheduling: Stellen Sie Ihren Scraper so ein, dass er in bestimmten Intervallen läuft, um sicherzustellen, dass Sie neue Anzeigen erfassen, sobald sie gepostet werden – ganz ohne manuelles Eingreifen.

No-Code Web Scraper für Kleinanzeigen

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Kleinanzeigen helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Kleinanzeigen

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Kleinanzeigen helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Hinweis: Diese Seite nutzt Akamai/DataDome. Einfache Requests können 403 Forbidden zurückgeben.

url = 'https://www.kleinanzeigen.de/s-berlin/c0-l3331'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) Chrome/119.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9'

}

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

for item in soup.select('article.aditem'):

title = item.select_one('.aditem-main--title-line a').text.strip()

price = item.select_one('.aditem-main--middle--price-shipping--price').text.strip()

print(f'Anzeige: {title} | Preis: {price}')

except Exception as e:

print(f'Scraping fehlgeschlagen: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Kleinanzeigen mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Hinweis: Diese Seite nutzt Akamai/DataDome. Einfache Requests können 403 Forbidden zurückgeben.

url = 'https://www.kleinanzeigen.de/s-berlin/c0-l3331'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) Chrome/119.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9'

}

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

for item in soup.select('article.aditem'):

title = item.select_one('.aditem-main--title-line a').text.strip()

price = item.select_one('.aditem-main--middle--price-shipping--price').text.strip()

print(f'Anzeige: {title} | Preis: {price}')

except Exception as e:

print(f'Scraping fehlgeschlagen: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def run():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

context = browser.new_context(user_agent='Mozilla/5.0', locale='de-DE')

page = context.new_page()

# Zu einer Anzeigenseite navigieren

page.goto('https://www.kleinanzeigen.de/s-anzeige/beispiel', wait_until='networkidle')

# Details extrahieren

title = page.locator('h1#viewad-title').inner_text()

price = page.locator('#viewad-price').inner_text()

print({'title': title.strip(), 'price': price.strip()})

browser.close()

run()Python + Scrapy

import scrapy

class KleinanzeigenSpider(scrapy.Spider):

name = 'kleinanzeigen'

start_urls = ['https://www.kleinanzeigen.de/s-berlin/c0-l3331']

def parse(self, response):

for ad in response.css('article.aditem'):

yield {

'title': ad.css('.aditem-main--title-line a::text').get(),

'price': ad.css('.aditem-main--middle--price-shipping--price::text').get(),

'location': ad.css('.aditem-main--top--left::text').get()

}

next_page = response.css('a.pagination-next::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.setExtraHTTPHeaders({'Accept-Language': 'de-DE'});

await page.goto('https://www.kleinanzeigen.de/s-berlin/c0-l3331');

const ads = await page.evaluate(() => {

return Array.from(document.querySelectorAll('.aditem')).map(el => ({

title: el.querySelector('.aditem-main--title-line a')?.innerText,

price: el.querySelector('.aditem-main--middle--price-shipping--price')?.innerText

}));

});

console.log(ads);

await browser.close();

})();Was Sie mit Kleinanzeigen-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Kleinanzeigen-Daten.

Indexierung des Immobilienmarktes

Immobilieninvestoren können Miet- und Verkaufspreise verfolgen, um unterbewertete Stadtteile zu identifizieren.

So implementieren Sie es:

- 1Tägliches Scrapen der Kategorie 'Immobilien'.

- 2Extrahieren von Postleitzahlen und Quadratmeterpreisen.

- 3Aggregieren der Daten zu einem wöchentlichen Preisindex.

- 4Vergleichen der Trends mit offiziellen staatlichen Wohnungsmarktberichten.

Verwenden Sie Automatio, um Daten von Kleinanzeigen zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Kleinanzeigen-Daten machen können

- Indexierung des Immobilienmarktes

Immobilieninvestoren können Miet- und Verkaufspreise verfolgen, um unterbewertete Stadtteile zu identifizieren.

- Tägliches Scrapen der Kategorie 'Immobilien'.

- Extrahieren von Postleitzahlen und Quadratmeterpreisen.

- Aggregieren der Daten zu einem wöchentlichen Preisindex.

- Vergleichen der Trends mit offiziellen staatlichen Wohnungsmarktberichten.

- Überwachung des Fahrzeugbestands

Gebrauchtwagenhändler können die Preise der Konkurrenz und den Lagerumschlag in Echtzeit überwachen.

- Targeting spezifischer Automarken und -modelle in der Sektion 'Auto'.

- Extrahieren von Kilometerstand, Erstzulassung und Preis.

- Identifizieren von Anzeigen, die lange aktiv bleiben, um Überpreisungen zu erkennen.

- Automatisieren von Benachrichtigungen für neu gepostete Angebote unter Marktwert.

- Generierung von Service-Leads

Umzugs- und Reinigungsunternehmen können Kunden genau dann finden, wenn diese Dienstleistungen benötigen.

- Überwachen der Kategorie 'Möbel & Wohnen' auf Möbelverkäufe, die auf einen Umzug hindeuten.

- Extrahieren von Stadtteil und Stadt des Verkäufers.

- Filtern von Anzeigen nach Keywords wie 'Umzug'.

- Übermitteln von Leads an Vertriebsteams für lokale Akquise.

- Preisverfolgung für Unterhaltungselektronik

Einzelhändler können ihre Trade-in-Angebote anpassen, indem sie die aktuellen Marktwerte für gebrauchte Technik überwachen.

- Scrapen von Kategorien wie 'Handy & Telekom' oder 'Konsole'.

- Bereinigen der Preis-Strings, um 'VB' oder 'Günstig'-Markierungen zu entfernen.

- Berechnen des durchschnittlichen Wiederverkaufswerts für spezifische Modelle wie iPhone oder PlayStation.

- Dynamisches Aktualisieren von E-Commerce-Ankaufspreisen basierend auf den Ergebnissen.

- Regionale Nachfrageanalyse

Marktforscher können identifizieren, welche Arten von Waren in bestimmten Bundesländern besonders gefragt sind.

- Scrapen der Anzeigenanzahl in verschiedenen deutschen Städten (z. B. München vs. Berlin).

- Vergleichen der Kategorievolumina über die Zeit.

- Identifizieren saisonaler Spitzenwerte in Kategorien wie 'Garten' oder 'Wintersport'.

- Erstellen von Berichten für Unternehmen, die eine regionale Warenverteilung planen.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Kleinanzeigen

Expertentipps für die erfolgreiche Datenextraktion von Kleinanzeigen.

Lokale Residential Proxies verwenden

Leiten Sie Ihren Traffic immer über deutsche Residential Proxies, um legitime lokale Nutzer zu imitieren und das aggressive Geo-Blocking der Seite zu umgehen.

Browsing-Muster randomisieren

Implementieren Sie variierende Wartezeiten zwischen Aktionen und vermeiden Sie es, Seiten in einer perfekt sequenziellen Reihenfolge anzuklicken, um Ihren Bot-Footprint zu reduzieren.

Header für deutsche Locale optimieren

Stellen Sie sicher, dass Ihre Request-Header 'Accept-Language: de-DE' enthalten, und verwenden Sie einen gängigen deutschen User-Agent, um Standard-Browsing-Profilen zu entsprechen.

Preis von Verhandlungs-Tags trennen

Verwenden Sie beim Scraping des Preises Regex, um den numerischen Wert von 'VB'-Tags (Verhandlungsbasis) zu trennen, damit Ihre Daten bereit für die Analyse sind.

Mobile User-Agents anvisieren

Manchmal verfügt die mobil-optimierte Version der Website über leicht andere Sicherheits-Trigger, was sie zu einer nützlichen Alternative für High-Volume-Scraping macht.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape The AA (theaa.com): A Technical Guide for Car & Insurance Data

How to Scrape CSS Author: A Comprehensive Web Scraping Guide

How to Scrape Bilregistret.ai: Swedish Vehicle Data Extraction Guide

How to Scrape Biluppgifter.se: Vehicle Data Extraction Guide

How to Scrape Car.info | Vehicle Data & Valuation Extraction Guide

How to Scrape GoAbroad Study Abroad Programs

How to Scrape ResearchGate: Publication and Researcher Data

How to Scrape Statista: The Ultimate Guide to Market Data Extraction

Häufig gestellte Fragen zu Kleinanzeigen

Finden Sie Antworten auf häufige Fragen zu Kleinanzeigen