How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

Erfahren Sie, wie Sie Mietanzeigen, Preise, Spezifikationen und Verfügbarkeiten von Locations Hawaii scrapen. Erhalten Sie Echtzeitdaten für die Marktanalyse...

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

- JavaScript Rendering Detection

Über Locations Hawaii

Entdecken Sie, was Locations Hawaii bietet und welche wertvollen Daten extrahiert werden können.

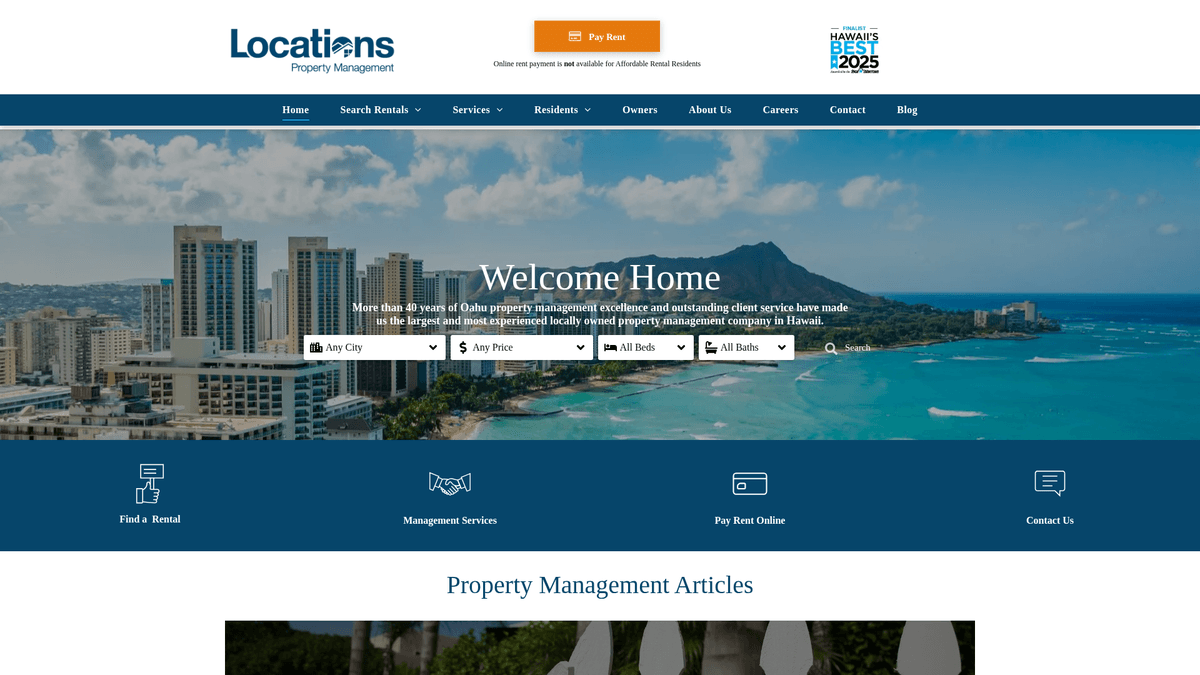

Premier Real Estate and Property Management in Honolulu

Locations Hawaii is one of Hawaii's largest and most trusted real estate firms, established in 1969. Based in Honolulu, they manage an extensive portfolio of residential, commercial, and affordable rental properties throughout the island of Oahu. Their platform serves as a primary hub for local renters to find vacancies in neighborhoods ranging from Waikiki to Kapolei.

AppFolio-Powered Data Structure

The website hosts highly structured data via the AppFolio Property Manager platform. Listings typically include granular details such as street addresses, monthly rent, security deposits, unit dimensions, and specific amenities. Because Locations Hawaii handles a significant share of the local market, their listings are often the first to go live, appearing here before hitting major national aggregators like Zillow.

Strategic Value for Data Collection

Scraping Locations Hawaii is particularly valuable for real estate investors and market analysts. The data allows for monitoring rental price trends, calculating vacancy rates in specific Honolulu zip codes, and performing automated rent benchmarking. By accessing this primary source directly, scrapers can maintain a more accurate view of the Hawaiian rental market than is possible through secondary data providers.

Warum Locations Hawaii Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Locations Hawaii.

Echtzeit-Tracking von Leerständen

Der Mietmarkt in Hawaii ist extrem schnelllebig. Durch Scraping können Sie neue Leerstände in dem Moment überwachen, in dem sie im AppFolio-Backend veröffentlicht werden.

Lokalisierte Market Intelligence

Sammeln Sie granulare Daten über die Miete pro Quadratfuß in bestimmten Stadtteilen von Honolulu, um unterbewertete Investitionsmöglichkeiten oder wettbewerbsfähige Preise zu identifizieren.

Analyse von bezahlbarem Wohnraum

Locations Hawaii verwaltet einen erheblichen Teil des bezahlbaren Mietbestands der Insel, was dies zur primären Quelle für das Tracking der Verfügbarkeit von gefördertem Wohnraum macht.

Property Management Benchmark

Analysieren Sie, wie einer der größten Property Manager Hawaiis seine Mietverträge, Haustierrichtlinien und Annehmlichkeiten strukturiert, um Ihre eigenen Managementstrategien zu optimieren.

Lead-Generierung für Dienstleister

Identifizieren Sie anstehende Leerstände, um Property Managern professionelle Reinigungs-, Staging- oder Wartungsdienste genau dann anzubieten, wenn sie Unterstützung beim Mieterwechsel benötigen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Locations Hawaii.

Dynamisches AppFolio-Rendering

Anzeigen werden via JavaScript von der AppFolio-Plattform geladen, was bedeutet, dass Standard-HTML-Parser ohne Browser-Rendering nur leere Container zurückgeben.

Cloudflare Bot-Schutz

Die Website nutzt Cloudflare, um automatisierten Datenverkehr zu filtern, was ein fortschrittliches Header-Management und Browser-Fingerprinting erfordert, um den Zugriff aufrechtzuerhalten.

Inkonsistente Datenschemata

Datenfelder wie 'Haustierrichtlinien' oder 'Nebenkosten' befinden sich oft in unstrukturierten Beschreibungsblöcken, was Regex oder KI erfordert, um saubere Werte zu extrahieren.

IP-Rate-Limiting

Aggressives Scraping von Detailseiten kann temporäre IP-Sperren auslösen, wenn die Anfragen nicht ordnungsgemäß über rotierende Residential-Proxies verteilt werden.

Scrape Locations Hawaii mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Locations Hawaii extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Locations Hawaii, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Locations Hawaii zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Locations Hawaii extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Locations Hawaii, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Headless-Browser-Automatisierung: Automatio rendert die JavaScript-lastigen Anzeigenkarten nativ genau so, wie ein Mensch sie sieht, und stellt sicher, dass keine Daten von den AppFolio-Skripten übersehen werden.

- Visuelles Data Mapping: Sie können per Point-and-Click komplexe Datenpunkte wie die Anzahl der Badezimmer und Verfügbarkeitsdaten auswählen, ohne eine einzige Zeile Code zu schreiben.

- Intelligente Pagination: Automatio kann so konfiguriert werden, dass 'Mehr laden'-Buttons und Infinite Scrolling verarbeitet werden, um den gesamten Immobilienkatalog in einer automatisierten Sitzung zu erfassen.

- Direkte CRM-Integration: Senden Sie Ihre gescrapten Mietdaten in Echtzeit automatisch an Google Sheets oder via Webhooks an Ihre internen Analyse-Tools für Immobilien.

No-Code Web Scraper für Locations Hawaii

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Locations Hawaii helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Locations Hawaii

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Locations Hawaii helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Locations Hawaii uses JS rendering, so basic requests may return empty templates.

# This example demonstrates the structure once content is loaded.

url = 'https://www.locationsrentals.com/listings'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Target listing containers based on common AppFolio classes

listings = soup.select('.listing-item')

for item in listings:

title = item.select_one('.listing-title').get_text(strip=True)

rent = item.select_one('.listing-rent').get_text(strip=True)

print(f'Listing: {title} | Price: {rent}')

except Exception as e:

print(f'Error occurred: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Locations Hawaii mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Locations Hawaii uses JS rendering, so basic requests may return empty templates.

# This example demonstrates the structure once content is loaded.

url = 'https://www.locationsrentals.com/listings'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Target listing containers based on common AppFolio classes

listings = soup.select('.listing-item')

for item in listings:

title = item.select_one('.listing-title').get_text(strip=True)

rent = item.select_one('.listing-rent').get_text(strip=True)

print(f'Listing: {title} | Price: {rent}')

except Exception as e:

print(f'Error occurred: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_listings():

with sync_playwright() as p:

# Launching browser with JS execution enabled

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://www.locationsrentals.com/listings')

# Wait for the dynamic content to load via AppFolio components

page.wait_for_selector('.listing-item')

# Extract data from the rendered DOM

listings = page.query_selector_all('.listing-item')

for listing in listings:

name = listing.query_selector('.listing-title').inner_text()

price = listing.query_selector('.listing-rent').inner_text()

print(f'Property: {name}, Rent: {price}')

browser.close()

scrape_listings()Python + Scrapy

import scrapy

class LocationsHawaiiSpider(scrapy.Spider):

name = 'locations_spider'

start_urls = ['https://www.locationsrentals.com/listings']

def parse(self, response):

# Note: Scrapy requires a middleware like Splash or Selenium to render this JS site.

for listing in response.css('.listing-item'):

yield {

'title': listing.css('.listing-title::text').get(),

'price': listing.css('.listing-rent::text').get(),

'address': listing.css('.listing-address::text').get(),

'url': response.urljoin(listing.css('a::attr(href)').get())

}

# Pagination handle for 'Load More' or next buttons

next_page = response.css('a.next_page::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Using networkidle2 to ensure React components are finished loading

await page.goto('https://www.locationsrentals.com/listings', { waitUntil: 'networkidle2' });

const results = await page.evaluate(() => {

const items = Array.from(document.querySelectorAll('.listing-item'));

return items.map(item => ({

title: item.querySelector('.listing-title')?.innerText,

price: item.querySelector('.listing-rent')?.innerText,

specs: item.querySelector('.listing-info')?.innerText

}));

});

console.log(results);

await browser.close();

})();Was Sie mit Locations Hawaii-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Locations Hawaii-Daten.

Rental Yield Calculator

Investors can use the data to calculate potential returns on similar properties by neighborhood.

So implementieren Sie es:

- 1Scrape monthly rent and square footage for all Honolulu listings.

- 2Compare data against current property sale prices in the same area.

- 3Generate a neighborhood-by-neighborhood yield heatmap.

Verwenden Sie Automatio, um Daten von Locations Hawaii zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Locations Hawaii-Daten machen können

- Rental Yield Calculator

Investors can use the data to calculate potential returns on similar properties by neighborhood.

- Scrape monthly rent and square footage for all Honolulu listings.

- Compare data against current property sale prices in the same area.

- Generate a neighborhood-by-neighborhood yield heatmap.

- B2B Cleaning Service Leads

Cleaning companies can identify properties that have just been listed as 'Available' to offer move-in/move-out services.

- Scrape the 'Available Date' field for all new listings daily.

- Filter for properties that are currently vacant or transitioning.

- Extract the assigned property manager's contact details for service outreach.

- Dynamic Price Monitoring

Local landlords can adjust their own rental prices based on real-time competitor data.

- Scrape active listings for 2-bedroom units in specific areas like Waikiki.

- Calculate the daily median price for these units.

- Set up alerts for when the market average moves by more than 5%.

- Historical Rent Analysis

Researchers can track how rent prices in Oahu have changed over years for legislative or academic study.

- Set up a recurring scrape to capture data every month.

- Store data in a time-series database to track individual property price changes.

- Analyze the impact of local tourism fluctuations on residential rent prices.

- Relocation Portal Aggregator

Create a niche website specifically for military members or digital nomads moving to Oahu.

- Aggregate listings from Locations Hawaii and other local firms.

- Tag listings based on proximity to bases or coworking hubs.

- Provide a unified search interface with unique local metadata.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Locations Hawaii

Expertentipps für die erfolgreiche Datenextraktion von Locations Hawaii.

Netzwerk-XHR-Requests überwachen

Prüfen Sie den Netzwerk-Tab des Browsers auf JSON-Antworten der AppFolio API, die oft sauberere und strukturiertere Daten enthalten als das sichtbare HTML.

Residential-Proxies aus den USA nutzen

Die Verwendung von Residential-Proxies mit Standort USA oder speziell Hawaii reduziert das Risiko erheblich, von den Geofencing-Filtern von Cloudflare blockiert zu werden.

Meta-Tags für zusammenfassende Daten scrapen

Seiten mit Immobilienangeboten enthalten oft strukturierte Metadaten (Schema.org oder OpenGraph), die Preis- und Standortdaten in einem hochgradig zuverlässigen Format bereitstellen.

Gestaffeltes Scheduling implementieren

Anstatt eines massiven täglichen Scrapes sollten Sie kleinere, häufige Updates alle paar Stunden durchführen, um neue Anzeigen zu erfassen, ohne den Server übermäßig zu belasten.

Das Verfügbarkeitsdatum erfassen

Priorisieren Sie immer das Feld für das Verfügbarkeitsdatum, um zwischen sofortigen Leerständen und Immobilien zu unterscheiden, die noch von aktuellen Mietern bewohnt werden.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Century 21 Property Listings

How to Scrape Homes.com: Real Estate Data Extraction Guide

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Sacramento Delta Property Management

How to Scrape LivePiazza: Philadelphia Real Estate Scraper

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Apartments Near Me | Real Estate Data Scraper

Häufig gestellte Fragen zu Locations Hawaii

Finden Sie Antworten auf häufige Fragen zu Locations Hawaii