Wie man LivePiazza scrapt: Philadelphia Immobilien-Scraper

Erfahren Sie, wie Sie LivePiazza.com scrapen, um Preise für Luxusapartments, Verfügbarkeiten und Grundrisse zu extrahieren. Überwachen Sie den Immobilienmarkt...

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- Browser-Fingerprinting

- Identifiziert Bots anhand von Browser-Eigenschaften: Canvas, WebGL, Schriftarten, Plugins. Erfordert Spoofing oder echte Browser-Profile.

- JavaScript-Challenge

- Erfordert JavaScript-Ausführung zum Zugriff auf Inhalte. Einfache Anfragen scheitern; Headless-Browser wie Playwright oder Puppeteer nötig.

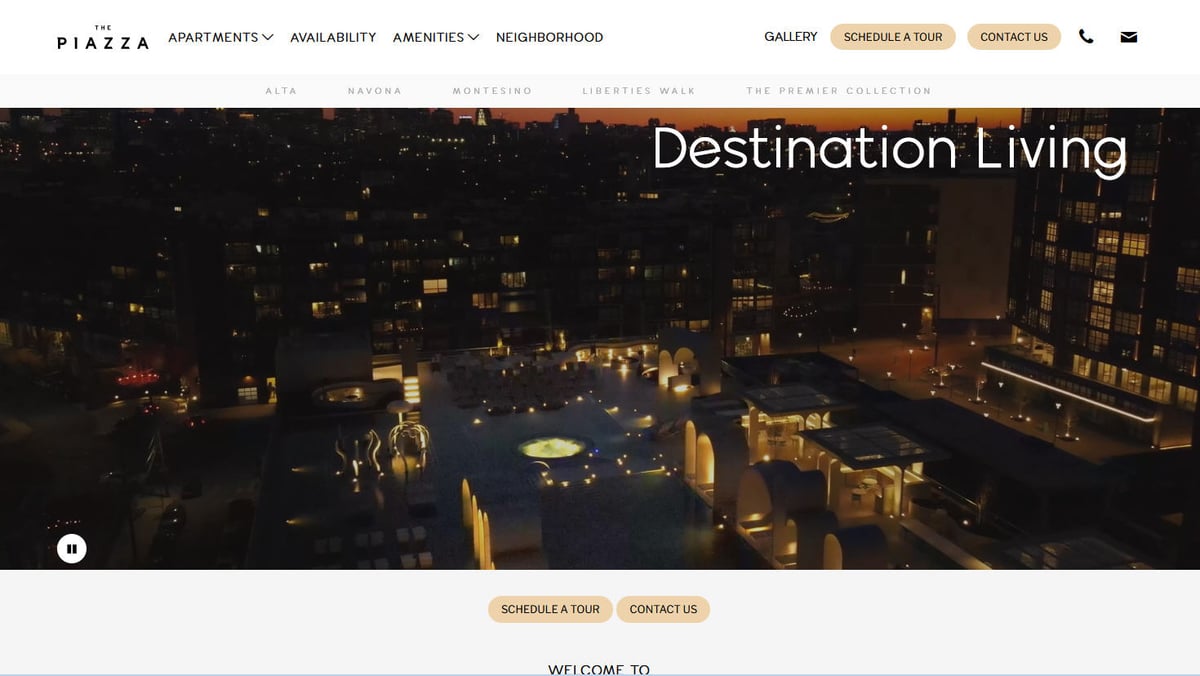

Über The Piazza

Entdecken Sie, was The Piazza bietet und welche wertvollen Daten extrahiert werden können.

The Piazza, verwaltet von Post Brothers, ist ein bedeutendes Wohn- und Einzelhandelsprojekt im Viertel Northern Liberties in Philadelphia. Es umfasst vier unterschiedliche Luxus-Communities – Alta, Navona, Montesino und Liberties Walk – und bietet ein 'Stadt-in-der-Stadt'-Erlebnis mit High-End-Amenities und modernem Design.

Die Website fungiert als Echtzeit-Portal für Mietinteressenten und zeigt aktuelle Mietpreise, spezifische Verfügbarkeitstermine für Einheiten und detaillierte Optionen für die Innenausstattung an. Für Data Scientists und Immobilienanalysten stellt LivePiazza eine kritische Datenquelle dar, um den Luxus-Mehrfamilienhaus-Markt in einem der am schnellsten wachsenden Stadtkorridore im Nordosten der USA zu verstehen.

Das Scraping dieser Daten ermöglicht eine hochfrequente Überwachung von Preistrends, Belegungsraten und der Wirksamkeit verschiedener Mietanreize, die von großen Immobilienentwicklern angeboten werden.

Warum The Piazza Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von The Piazza.

Echtzeit-Markt-Benchmark

Analysieren Sie Luxusmiet-Trends in Philadelphia, indem Sie aktuelle Raten für Alta-, Navona- und Montesino-Objekte verfolgen.

Überwachung von Angebot und Nachfrage

Verfolgen Sie die Verfügbarkeit von Wohneinheiten im Zeitverlauf, um Belegungsraten zu berechnen und die Absorption im Viertel zu verstehen.

Tracking von Mietvergünstigungen

Überwachen Sie Werbeangebote wie „Gratismiete“, um die effektive Nettomiete im Vergleich zum Brutto-Listenpreis zu ermitteln.

Wettbewerbsstrategie-Analyse

Evaluieren Sie, wie Post Brothers die Preise für bestimmte Grundrisse oder Innenausstattungen basierend auf der Marktnachfrage anpasst.

Lead-Generierung für Dienstleistungen

Identifizieren Sie kommende Verfügbarkeiten, um Umzugsunternehmen, Innenarchitekten und lokale Möbelhändler mit gezieltem Marketing anzusprechen.

Investment-Analyse

Sammeln Sie historische Preisdaten, um Investoren bei der Ermittlung des ROI von Luxus-Annehmlichkeiten und Stadtentwicklungsprojekten zu unterstützen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von The Piazza.

Cloudflare-Schutz

Die Website nutzt eine aggressive Cloudflare WAF, die JS-Challenges auslöst und Anfragen von Standard-HTTP-Bibliotheken blockiert.

Dynamisches Content-Rendering

Anzeigentabellen und interaktive Karten werden über React gerendert, was einen Headless-Browser zur Ausführung von JavaScript für die Datenextraktion erfordert.

XHR-Daten-Injektionen

Preise und Verfügbarkeit werden oft über interne API-Aufrufe mit sitzungsbasierten Tokens eingespeist, die während eines Crawls ablaufen können.

Lazy-Loaded Assets

Hochwertige Grundrisse und Fotos sind Lazy-Loaded, was Scroll-Trigger erforderlich macht, um sicherzustellen, dass alle Medien erfasst werden.

Häufige Schema-Änderungen

Das Backend der Hausverwaltung aktualisiert häufig die DOM-Struktur, was statische Selektoren unbrauchbar machen kann, wenn sie nicht dynamisch behandelt werden.

Scrape The Piazza mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von The Piazza extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert The Piazza, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, The Piazza zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von The Piazza extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert The Piazza, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Nahtlose Anti-Bot-Umgehung: Automatio verarbeitet Cloudflare-Challenges und Browser-Fingerprinting automatisch und gewährleistet so den ununterbrochenen Zugriff auf Preisdaten.

- Visuelles Auswahl-Tool: Weisen Sie Datenfelder aus komplexen Tabellen einfach über eine Point-and-Click-Oberfläche zu, ohne eigenes CSS oder XPath schreiben zu müssen.

- Automatisierte Zeitplanung: Lassen Sie den Scraper täglich laufen, um hochfrequente Preisschwankungen und neue Angebote ohne manuelles Eingreifen zu erfassen.

- Dynamische Script-Ausführung: Rendert React-basierte Inhalte perfekt und ermöglicht die Extraktion von Daten aus interaktiven Elementen, die herkömmliche Scraper übersehen.

- No-Code-Datenintegration: Synchronisieren Sie Ihre extrahierten Immobilien-Daten über Webhooks direkt mit Google Sheets oder CRMs für eine sofortige Marktanalyse.

No-Code Web Scraper für The Piazza

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von The Piazza helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für The Piazza

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von The Piazza helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Hinweis: Dieser direkte Request wird wahrscheinlich aufgrund von Cloudflare fehlschlagen

# Ein Proxy oder eine Bypass-Lösung wie cloudscraper wird empfohlen

url = 'https://www.livepiazza.com/residences'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9,en-US;q=0.8,en;q=0.7'

}

def fetch_piazza():

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Beispiel-Selektor für Wohnungs-Karten

for card in soup.select('.residence-card'):

name = card.select_one('.residence-name').text.strip()

price = card.select_one('.price-value').text.strip()

print(f'Community: {name} | Preis: {price}')

else:

print(f'Blockiert durch Anti-Bot: Status {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')

fetch_piazza()Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man The Piazza mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Hinweis: Dieser direkte Request wird wahrscheinlich aufgrund von Cloudflare fehlschlagen

# Ein Proxy oder eine Bypass-Lösung wie cloudscraper wird empfohlen

url = 'https://www.livepiazza.com/residences'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0.0.0 Safari/537.36',

'Accept-Language': 'de-DE,de;q=0.9,en-US;q=0.8,en;q=0.7'

}

def fetch_piazza():

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Beispiel-Selektor für Wohnungs-Karten

for card in soup.select('.residence-card'):

name = card.select_one('.residence-name').text.strip()

price = card.select_one('.price-value').text.strip()

print(f'Community: {name} | Preis: {price}')

else:

print(f'Blockiert durch Anti-Bot: Status {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')

fetch_piazza()Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def scrape_live_piazza():

async with async_playwright() as p:

# Start mit einem spezifischen User-Agent, um einen echten Browser zu simulieren

browser = await p.chromium.launch(headless=True)

context = await browser.new_context(user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36')

page = await context.new_page()

await page.goto('https://www.livepiazza.com/alta/')

# Warten, bis die dynamische Tabelle der Einheiten geladen ist

await page.wait_for_selector('.unit-row', timeout=15000)

units = await page.query_selector_all('.unit-row')

for unit in units:

unit_id = await (await unit.query_selector('.unit-id')).inner_text()

rent = await (await unit.query_selector('.unit-rent')).inner_text()

print(f'Einheit: {unit_id.strip()} | Miete: {rent.strip()}')

await browser.close()

asyncio.run(scrape_live_piazza())Python + Scrapy

import scrapy

class PiazzaSpider(scrapy.Spider):

name = 'piazza_spider'

start_urls = ['https://www.livepiazza.com/communities']

def parse(self, response):

# Scrapy erfordert für diese Seite eine JS-Rendering-Middleware (wie Scrapy-Playwright)

for building in response.css('.building-section'):

yield {

'building_name': building.css('h3.name::text').get(),

'link': building.css('a.explore-btn::attr(href)').get(),

'starting_price': building.css('.starting-from::text').get()

}

# Beispiel für die Verfolgung der Paginierung

next_page = response.css('a.next-page::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

(async () => {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

await page.goto('https://www.livepiazza.com/montesino', { waitUntil: 'networkidle2' });

// Warte, bis der Residences-Container gerendert ist

await page.waitForSelector('.residences-container');

const apartmentData = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('.apartment-listing'));

return rows.map(row => ({

type: row.querySelector('.plan-type').innerText,

sqft: row.querySelector('.sqft').innerText,

available: row.querySelector('.availability').innerText

}));

});

console.log(apartmentData);

await browser.close();

})();Was Sie mit The Piazza-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus The Piazza-Daten.

Echtzeit-Mietindex

Erstellen Sie ein Live-Dashboard, das die durchschnittliche Miete pro Quadratfuß für Luxusapartments in Northern Liberties verfolgt.

So implementieren Sie es:

- 1Extraktion der täglichen Preise für alle Studios, 1-Zimmer- und 2-Zimmer-Wohnungen.

- 2Normalisierung der Preise nach Quadratmeterzahl, um eine PPSF-Metrik zu erstellen.

- 3Visualisierung der Trendlinie über einen Zeitraum von 90 Tagen.

Verwenden Sie Automatio, um Daten von The Piazza zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit The Piazza-Daten machen können

- Echtzeit-Mietindex

Erstellen Sie ein Live-Dashboard, das die durchschnittliche Miete pro Quadratfuß für Luxusapartments in Northern Liberties verfolgt.

- Extraktion der täglichen Preise für alle Studios, 1-Zimmer- und 2-Zimmer-Wohnungen.

- Normalisierung der Preise nach Quadratmeterzahl, um eine PPSF-Metrik zu erstellen.

- Visualisierung der Trendlinie über einen Zeitraum von 90 Tagen.

- Analyse der Zugeständnis-Strategie

Analysieren Sie, wie Hausverwaltungen 'Mietfrei'-Anreize nutzen, um Leerstände in bestimmten Gebäuden zu füllen.

- Scrapen Sie das Feld 'Promotions' für jede gelistete Einheit.

- Abgleich der Angebote mit der Anzahl der Tage, die eine Einheit bereits gelistet ist.

- Bestimmung des 'Tipping Points', an dem Entwickler die Anreize erhöhen.

- Investitions-Machbarkeitsstudien

Nutzen Sie die Daten, um neue Luxusentwicklungen in der unmittelbaren Umgebung basierend auf aktuellem Angebot und Nachfrage zu rechtfertigen oder abzulehnen.

- Aggregieren der Gesamtzahl der verfügbaren Einheiten in Alta, Navona und Montesino.

- Segmentierung der Verfügbarkeit nach 'Einzugsdatum', um die Angebotsabsorption zu prognostizieren.

- Vergleich der Piazza-Preise mit den stadtweiten Luxus-Durchschnittswerten.

- Lead-Gen für Umzugsunternehmen

Identifizieren Sie Zeitfenster mit hohem Umzugsvolumen, um Marketing für lokale Umzugs- und Reinigungsdienste gezielt auszusteuern.

- Filtern der gescrapten Anzeigen nach 'Ab sofort verfügbar' oder spezifischen kommenden Terminen.

- Anvisieren von Gebäuden mit der höchsten bevorstehenden Verfügbarkeit.

- Abstimmung der Werbeausgaben auf die Zeiträume mit der höchsten prognostizierten Fluktuation.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von The Piazza

Expertentipps für die erfolgreiche Datenextraktion von The Piazza.

Philadelphia-Proxies verwenden

Die Verwendung von Residential-Proxies mit Standort in Philadelphia verringert das Risiko, von regionalen Filtern als verdächtiger Bot eingestuft zu werden.

Auf Table-Hydration warten

Implementieren Sie eine „Wait for Element“-Bedingung für die Wohnungsliste, um sicherzustellen, dass die React-Anwendung vor der Datenextraktion vollständig hydriert ist.

Netzwerkprotokolle überwachen

Identifizieren Sie die internen JSON-Endpunkte der Property-Management-Software, um strukturierte Daten effizienter zu extrahieren.

Aktionstexte parsen

Extrahieren Sie stets den Text aus den Feldern „Specials“ oder „Promotions“, um die Nettomiete nach Abzug von Vergünstigungen genau zu berechnen.

Scrollen für Media-Extraktion

Konfigurieren Sie Ihren Scraper so, dass er ans Ende der Listenseiten scrollt, um das Laden aller Grundrisse und Wohnungsfotos auszulösen.

User Agents rotieren

Wechseln Sie zwischen verschiedenen modernen Browser-Fingerprints für Desktops, um eine Erkennung anhand identischer Header-Signaturen zu vermeiden.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Century 21 Property Listings

How to Scrape Homes.com: Real Estate Data Extraction Guide

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Sacramento Delta Property Management

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Apartments Near Me | Real Estate Data Scraper

Häufig gestellte Fragen zu The Piazza

Finden Sie Antworten auf häufige Fragen zu The Piazza