Wie man whatsmydns.net scrapt: Ein vollständiger Leitfaden für DNS-Daten

Lernen Sie, wie Sie globale DNS-Propagations-Daten von whatsmydns.net scrapen. Extrahieren Sie automatisch Echtzeit-A-, MX-, CNAME- und TXT-Records von...

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- JavaScript-Challenge

- Erfordert JavaScript-Ausführung zum Zugriff auf Inhalte. Einfache Anfragen scheitern; Headless-Browser wie Playwright oder Puppeteer nötig.

- User-Agent Filtering

- Turnstile

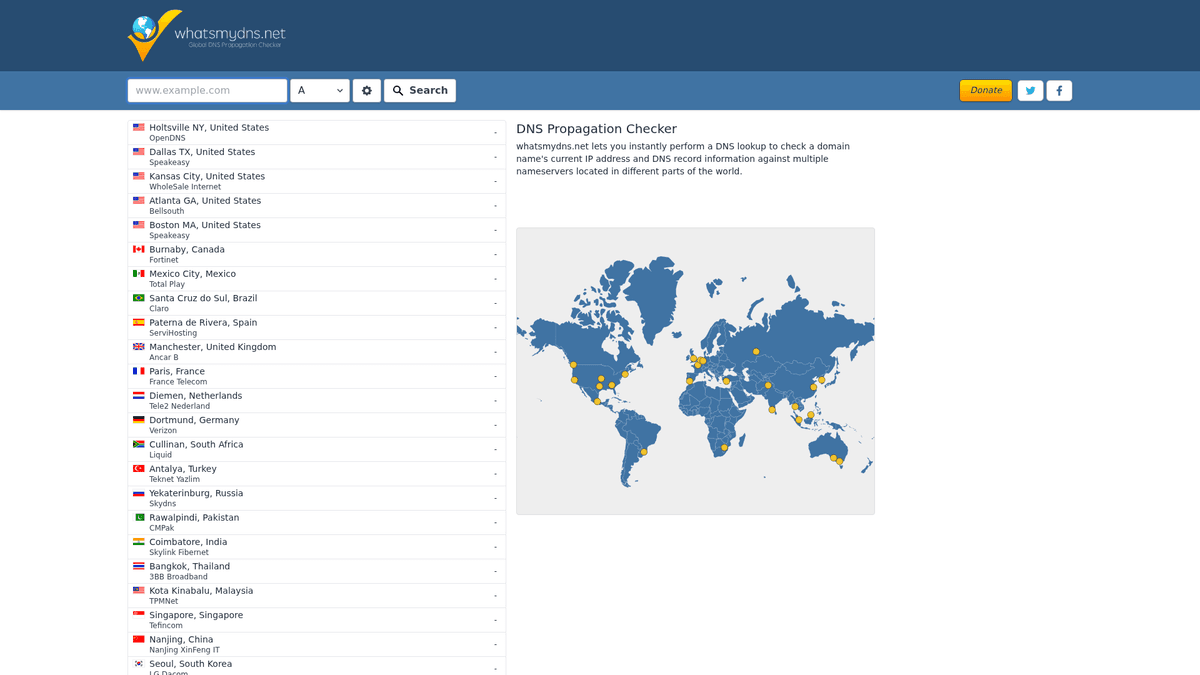

Über whatsmydns.net

Entdecken Sie, was whatsmydns.net bietet und welche wertvollen Daten extrahiert werden können.

Globale DNS-Propagations-Infrastruktur

whatsmydns.net ist ein erstklassiges Online-Utility für Systemadministratoren und Entwickler, um die DNS-Propagation weltweit zu verfolgen. Durch die Abfrage von Dutzenden von DNS-Servern in verschiedenen geografischen Regionen bietet es einen umfassenden Überblick darüber, wie eine Domain für Nutzer in verschiedenen Ländern aufgelöst wird. Diese Sichtbarkeit ist entscheidend, um sicherzustellen, dass DNS-Änderungen, wie IP-Migrationen oder Mailserver-Updates, weltweit erfolgreich übernommen wurden.

Umfassendes DNS-Record-Tracking

Die Plattform unterstützt eine breite Palette von DNS-Record-Typen, einschließlich A, AAAA, CNAME, MX, NS, PTR, SOA und TXT. Für jede Abfrage liefert die Seite eine detaillierte Liste der Serverstandorte, die aufgelösten Werte und den Status der Propagation. Diese Daten sind kritisch für die Fehlersuche bei technischen Problemen, die aufgrund von ISP-Caching oder falsch konfigurierten lokalen Resolvern nur in bestimmten Regionen auftreten.

Strategischer Datenwert

Das Scraping dieser Daten ermöglicht es Unternehmen, technische Audits zu automatisieren und den Zustand ihrer Infrastruktur zu überwachen. Anstatt die Propagation manuell zu prüfen, können Betriebe automatisierte Systeme aufbauen, die die Korrektheit der Einträge alle paar Minuten verifizieren. Dies ist besonders wertvoll bei kritischen Ereignissen wie Website-Migrationen oder Sicherheitsupdates, bei denen jede Verzögerung bei DNS-Aktualisierungen zu Ausfallzeiten oder Serviceunterbrechungen für einen Teil der globalen Nutzer führen kann.

Warum whatsmydns.net Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von whatsmydns.net.

Globales Infrastruktur-Monitoring

Überwachen Sie kontinuierlich den Status Ihrer Domain auf internationalen Servern, um eine konsistente Erreichbarkeit zu gewährleisten und regionale DNS-Ausfälle sofort zu identifizieren. Dieser proaktive Ansatz hilft technischen Teams, lokale Konnektivitätsprobleme zu lösen, bevor sie eine größere Nutzerbasis betreffen.

Automatisierte Migrations-Verifizierung

Verfolgen Sie die Propagation neuer IP-Adressen oder nameservers während eines Serverumzugs und stellen Sie sicher, dass alle globalen nodes korrekt aktualisiert werden, bevor alte Assets abgeschaltet werden. Dies liefert eine datengestützte Bestätigung für einen erfolgreichen weltweiten Cutover.

Brand Security Auditing

Überwachen Sie kritische Records wie SPF, DKIM und DMARC, um Email-Spoofing zu verhindern und unbefugte Änderungen zu erkennen, die den Ruf Ihrer Marke gefährden könnten. Regelmäßiges Scraping hilft dabei, DNS-Hijacking-Versuche in bestimmten geografischen Zonen aufzudecken.

Competitive Intelligence

Analysieren Sie die Hosting-, CDN- und Email-Infrastruktur Ihrer Wettbewerber, indem Sie deren MX- und CNAME-Records in verschiedenen Regionen scrapen. Dies ermöglicht Marktforschern, die Tech-Stacks von Branchenführern zu kartieren.

CDN-Strategie-Optimierung

Überprüfen Sie, ob Ihr CDN den Traffic weltweit zu den richtigen Edge-Standorten leitet, um datenbasierte Anpassungen an Ihrer Caching-Strategie vorzunehmen. So stellen Sie sicher, dass Nutzer Inhalte immer vom schnellstmöglichen Server erhalten.

Fehlersuche bei regionaler Latenz

Identifizieren Sie spezifische Resolver oder Zonen, in denen die DNS-Auflösung fehlschlägt oder veraltete Records zurückgibt. Dies ist ein essenzielles Tool zum Debuggen von Performance-Problemen, die nur in bestimmten Ländern auftreten.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von whatsmydns.net.

Fortgeschrittener Cloudflare-Schutz

Die Website nutzt Cloudflare-Sicherheitsmechanismen wie Turnstile und Browser-Fingerprinting, was eine anspruchsvolle Automatisierung erfordert. Einfache HTTP-Anfragen werden fast immer von der Challenge-Wall blockiert.

Asynchrones Laden der Ergebnisse

Datenpunkte sind nicht im Quell-HTML enthalten und laden zeitversetzt über AJAX-Aufrufe im Hintergrund, was statische Scraper völlig wirkungslos macht. Der Scraper muss warten, bis jeder globale node seinen Status gemeldet hat.

Aggressives Rate Limiting

Schnelle, automatisierte Abfragen von einer einzigen IP-Adresse führen rasch zu temporären Sperren oder CAPTCHAs. Dies erfordert eine hochwertige Proxy-Rotation und ein präzises Management von Request-Headern und Timing.

Echtzeit-Datenvolatilität

Die DNS-Propagation ist ein dynamischer Prozess, bei dem sich Ergebnisse sekündlich ändern können. Dies erfordert eine schnelle Extraktion und Zeitstempelung für eine genaue Analyse sowie eine robuste Datenbankstruktur.

Komplexe Selektor-Logik

Die Ergebnistabelle nutzt spezifische Status-Icons (grüne Häkchen, rote Kreuze), die zusammen mit den Textwerten korrekt geparst werden müssen. Dies erfordert präzises CSS- oder XPath-Targeting, um den visuellen Status richtig zu interpretieren.

Scrape whatsmydns.net mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von whatsmydns.net extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert whatsmydns.net, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, whatsmydns.net zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von whatsmydns.net extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert whatsmydns.net, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Integrierte Stealth-Engine: Automatio bewältigt Cloudflare-Challenges und Browser-Fingerprinting nativ, sodass Sie sich auf die Datenextraktion konzentrieren können, statt auf die technische Umgehung von Bots. Dies reduziert den technischen Aufwand erheblich.

- Visuelle AJAX-Interaktion: Mit dem No-Code-Editor können Sie einfach 'Wait for Element'-Aktionen festlegen, um sicherzustellen, dass jedes globale Serverergebnis vollständig geladen ist. Dies garantiert 100 % Datengenauigkeit, auch wenn einige Server verzögert antworten.

- Globale Proxy-Integration: Rotieren Sie mühelos zwischen residential oder datacenter proxies, um Rate-Limits zu vermeiden und Lookups von verschiedenen internationalen IP-Adressen zu simulieren. Dies sichert eine hohe Erfolgsquote bei großflächigen Audits.

- Event-gesteuertes Scheduling: Richten Sie automatisierte Trigger ein, um die DNS-Propagation während eines Migrationsfensters stündlich zu prüfen und die Daten direkt in Ihre Datenbank oder Tabelle zu senden. Dies ermöglicht ein autarkes Monitoring kritischer Updates.

- Daten-Harmonisierung: Bereinigen und formatieren Sie verschiedene Record-Typen wie MX-Prioritäten oder TXT-Strings automatisch in ein strukturiertes JSON- oder CSV-Format. Das spart Stunden manueller Datenaufbereitung und Reorganisation.

No-Code Web Scraper für whatsmydns.net

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von whatsmydns.net helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für whatsmydns.net

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von whatsmydns.net helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Hinweis: Direkte Requests könnten von Cloudflare blockiert werden

url = 'https://www.whatsmydns.net/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) Chrome/119.0.0.0 Safari/537.36',

'Accept': 'text/html,application/xhtml+xml,xml;q=0.9,image/avif,image/webp,*/*;q=0.8'

}

def check_dns_static():

try:

# Aufruf der Homepage, um Session/Cookies zu erhalten

session = requests.Session()

response = session.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Statisches Scraping ist begrenzt, da Ergebnisse via JS laden

print('Seite erfolgreich geladen. JS-Rendering für Ergebnisse erforderlich.')

else:

print(f'Blockiert: HTTP {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')

check_dns_static()Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man whatsmydns.net mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Hinweis: Direkte Requests könnten von Cloudflare blockiert werden

url = 'https://www.whatsmydns.net/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) Chrome/119.0.0.0 Safari/537.36',

'Accept': 'text/html,application/xhtml+xml,xml;q=0.9,image/avif,image/webp,*/*;q=0.8'

}

def check_dns_static():

try:

# Aufruf der Homepage, um Session/Cookies zu erhalten

session = requests.Session()

response = session.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# Statisches Scraping ist begrenzt, da Ergebnisse via JS laden

print('Seite erfolgreich geladen. JS-Rendering für Ergebnisse erforderlich.')

else:

print(f'Blockiert: HTTP {response.status_code}')

except Exception as e:

print(f'Fehler: {e}')

check_dns_static()Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_whatsmydns():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# Nutze die hash-basierte URL, um einen spezifischen DNS-Lookup auszulösen

page.goto('https://www.whatsmydns.net/#A/google.com')

# Warte, bis die Ergebnistabelle mit Daten gefüllt ist

page.wait_for_selector('.results-table tr', timeout=15000)

# Extrahiere die Ergebnisse

rows = page.query_selector_all('.results-table tr')

for row in rows:

location = row.query_selector('.location').inner_text()

result_val = row.query_selector('.value').inner_text()

print(f'[{location}] Aufgelöst zu: {result_val}')

browser.close()

scrape_whatsmydns()Python + Scrapy

import scrapy

from scrapy_playwright.page import PageMethod

class DNSPropagationSpider(scrapy.Spider):

name = 'dns_spider'

def start_requests(self):

# Scrapy-Playwright übernimmt das JS-Rendering

yield scrapy.Request(

'https://www.whatsmydns.net/#A/example.com',

meta={

'playwright': True,

'playwright_page_methods': [

PageMethod('wait_for_selector', '.results-table tr')

]

}

)

def parse(self, response):

# Iteriere durch die mit Playwright extrahierten Tabellenzeilen

for row in response.css('.results-table tr'):

yield {

'location': row.css('.location::text').get(),

'result': row.css('.value::text').get()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Navigiere direkt zur DNS-Check-URL

await page.goto('https://www.whatsmydns.net/#MX/microsoft.com', { waitUntil: 'networkidle2' });

// Warte auf das Laden der dynamischen Server-Zeilen

await page.waitForSelector('.results-table tr');

const data = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('.results-table tr'));

return rows.map(row => ({

location: row.querySelector('.location')?.innerText.trim(),

value: row.querySelector('.value')?.innerText.trim()

}));

});

console.log(data);

await browser.close();

})();Was Sie mit whatsmydns.net-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus whatsmydns.net-Daten.

Globales Uptime-Monitoring

IT-Manager können sicherstellen, dass ihre Dienste weltweit ohne manuelle Prüfungen erreichbar sind.

So implementieren Sie es:

- 1Plane ein Scraping kritischer Domains alle 30 Minuten

- 2Vergleiche die gescrapten IP-Adressen mit einer Master-Liste autorisierter IPs

- 3Löse einen automatisierten Alarm per Webhook aus, wenn in einer Region eine Abweichung festgestellt wird

Verwenden Sie Automatio, um Daten von whatsmydns.net zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit whatsmydns.net-Daten machen können

- Globales Uptime-Monitoring

IT-Manager können sicherstellen, dass ihre Dienste weltweit ohne manuelle Prüfungen erreichbar sind.

- Plane ein Scraping kritischer Domains alle 30 Minuten

- Vergleiche die gescrapten IP-Adressen mit einer Master-Liste autorisierter IPs

- Löse einen automatisierten Alarm per Webhook aus, wenn in einer Region eine Abweichung festgestellt wird

- CDN-Nutzungsanalyse

Marktforscher können anhand von CNAME-Records identifizieren, welche Content Delivery Networks von Wettbewerbern genutzt werden.

- Scrape CNAME-Records für eine Liste der Top 500 Branchen-Domains

- Gleiche die Ziel-Domains mit bekannten CDN-Anbietern ab (z. B. Cloudflare, Akamai)

- Erstelle einen Bericht über Marktanteilstrends für Infrastrukturanbieter

- Verifizierung von Zero-Downtime-Migrationen

DevOps-Teams können die vollständige Propagation bestätigen, bevor sie alte Infrastruktur abschalten.

- Führe eine DNS-Änderung durch und senke die TTL-Werte

- Scrape whatsmydns.net alle 5 Minuten während des Migrationsfensters

- Nimm den alten Server erst außer Betrieb, wenn 100 % der globalen Knoten die neue IP melden

- Erkennung von Sicherheitsbedrohungen

Sicherheitsanalysten können DNS-Poisoning oder unbefugte Änderungen an MX-Records erkennen.

- Überwache TXT- und MX-Records für hochwertige Unternehmensdomains

- Scrape den Propagations-Status, um Regionen zu finden, die veraltete oder bösartige Daten erhalten

- Identifiziere spezifische geografische Regionen, in denen DNS-Hijacking auftreten könnte

- Historische DNS-Record-Analyse

Forscher können einen Datensatz darüber aufbauen, wie sich DNS-Records im Laufe der Zeit für akademische oder rechtliche Audits ändern.

- Crawl die Records täglich und speichere die Ergebnisse in einer SQL-Datenbank

- Verfolge Verschiebungen in den IP-Bereichen von Providern über Monate oder Jahre

- Visualisiere die Geschwindigkeit der Propagation für verschiedene DNS-Anbieter mithilfe historischer Time-to-Finish-Metriken

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von whatsmydns.net

Expertentipps für die erfolgreiche Datenextraktion von whatsmydns.net.

URL-Hash-Parameter nutzen

Navigieren Sie direkt zu spezifischen Record-Typen und Domains, indem Sie den URL-Hash anpassen (z. B. #MX/domain.com). So überspringen Sie das manuelle Ausfüllen von Formularen und beschleunigen das Scraping für Batch-Domain-Checks erheblich.

Dynamische Wartezeiten implementieren

Einige globale Resolver benötigen länger für eine Antwort. Setzen Sie ein flexibles Timeout von 10-15 Sekunden, um Ergebnisse aus langsameren Regionen wie Südamerika oder Asien zu erfassen. Zu kurze Timeouts führen zu unvollständigen Datensätzen.

Die Status-Klasse extrahieren

Scrapen Sie nicht nur die IP-Adresse, sondern extrahieren Sie auch die CSS-Klasse des Status-Icons. So können Sie programmatisch zwischen einer erfolgreichen resolution und einem Timeout unterscheiden, was für die genaue Berichterstattung der Propagations-Rate entscheidend ist.

User-Agent-Strings rotieren

Rotieren Sie regelmäßig zwischen modernen Desktop- und mobilen User-Agents, um menschliches Verhalten zu imitieren und das Risiko einer Fingerprint-basierten Erkennung zu minimieren. Dies macht Ihre Automatisierung von einem Standard-Nutzer ununterscheidbar.

Interne API-Anfragen überwachen

Untersuchen Sie den Network-Tab des Browsers, um die JSON-Endpoints der AJAX-Aufrufe zu identifizieren. Diese können manchmal direkt abgefragt werden, um Daten schneller abzurufen und das Rendern der gesamten Seite zu umgehen.

Residential Proxies verwenden

Um nicht als Datacenter-bot identifiziert zu werden, sollten Sie residential proxies nutzen. Diese bieten höhere Trust-Scores und lösen seltener aggressive Cloudflare-Blocks aus. Sie bieten die stabilste Verbindung für lang laufende Scraping-Sessions.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Bilregistret.ai: Swedish Vehicle Data Extraction Guide

How to Scrape CSS Author: A Comprehensive Web Scraping Guide

How to Scrape Biluppgifter.se: Vehicle Data Extraction Guide

How to Scrape The AA (theaa.com): A Technical Guide for Car & Insurance Data

How to Scrape Car.info | Vehicle Data & Valuation Extraction Guide

How to Scrape GoAbroad Study Abroad Programs

How to Scrape ResearchGate: Publication and Researcher Data

How to Scrape Statista: The Ultimate Guide to Market Data Extraction

Häufig gestellte Fragen zu whatsmydns.net

Finden Sie Antworten auf häufige Fragen zu whatsmydns.net