Claude 3.7 Sonnet

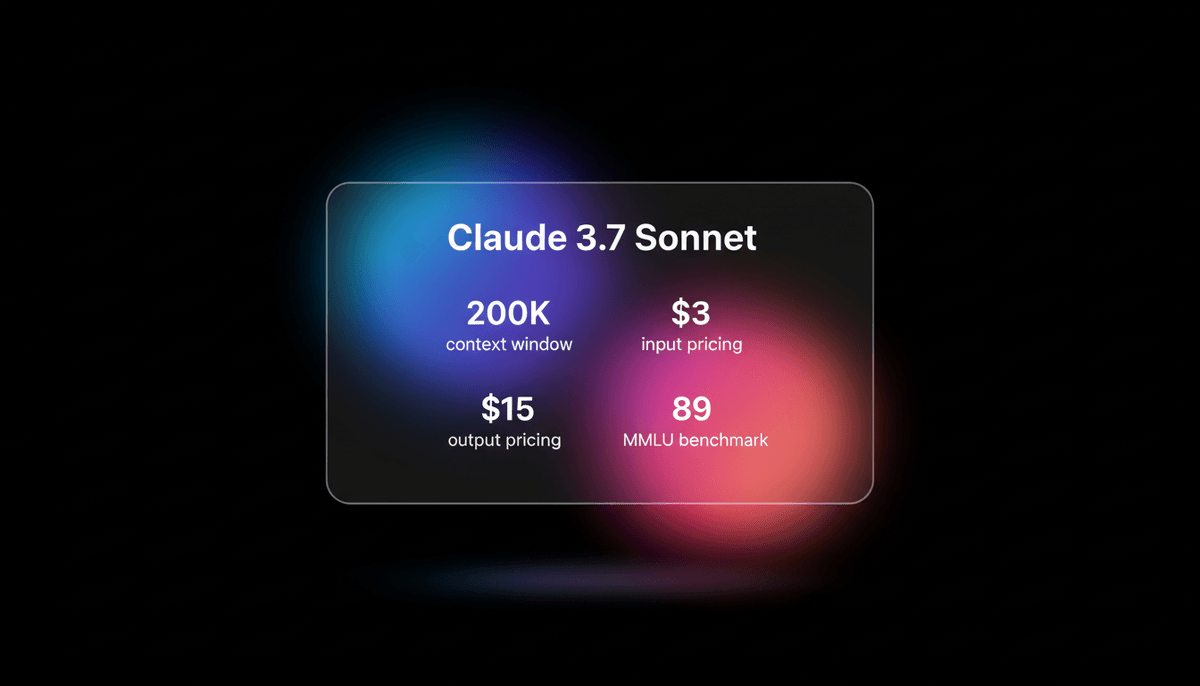

Claude 3.7 Sonnet ist das erste hybride Reasoning-model von Anthropic und bietet erstklassige Coding-Fähigkeiten, ein 200k context window und sichtbares...

Über Claude 3.7 Sonnet

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von Claude 3.7 Sonnet.

Hybrides Reasoning-Design

Claude 3.7 Sonnet nutzt eine neue Architektur, mit der Benutzer zwischen Geschwindigkeit und Tiefe wählen können. Es ist das erste model, das einen Schalter für Extended Thinking bietet, wodurch das System komplexe Logik durcharbeiten kann, bevor es eine Antwort gibt. Diese Transparenz ermöglicht es Entwicklern, genau zu sehen, wie das model zu einer Schlussfolgerung gelangt, was das Risiko versteckter Fehler bei technischer Arbeit reduziert.

Technische Problemlösung

Dieses model wurde für anspruchsvolles Software Engineering entwickelt. Es erzielt 62,1 % im SWE-bench Verified Benchmark und beweist eine starke Fähigkeit zur Lösung echter GitHub-Issues. In Verbindung mit Tools wie Claude Code verwaltet es Dateibearbeitungen und Befehlsausführungen in großen Repositories. Es bewältigt mathematische und Programmieraufgaben mit einer Präzision, die mit aktuellen Reasoning-models der Spitzenklasse mithalten kann oder diese sogar übertrifft.

Massive Kontext-Kapazität

Mit einem 200.000-token context window verarbeitet das model umfangreiche Dokumentationen oder Codebases auf einmal. Es unterstützt bis zu 128.000 tokens bei der Ausgabe, wenn der Thinking-Modus aktiv ist, was es nützlich für die Generierung langer Skripte oder detaillierter Berichte macht. Das model ist zudem multimodal, was bedeutet, dass es neben Text auch Diagramme und Schaubilder interpretieren kann.

Anwendungsfälle für Claude 3.7 Sonnet

Entdecken Sie die verschiedenen Möglichkeiten, Claude 3.7 Sonnet für großartige Ergebnisse zu nutzen.

Agentic Software Engineering

Verwendung des Terminal-Tools zum Beheben von Fehlern und Refactoring von Code über umfangreiche Dateistrukturen hinweg.

Überprüfung mathematischer Beweise

Lösung schwieriger mathematischer Probleme, indem das model die logischen Schritte selbst durchdenkt.

Repository-Analyse

Extrahieren von Daten und Identifizieren von Mustern aus gesamten technischen Codebases in einem einzigen prompt.

Visuelle Datenverarbeitung

Umwandlung komplexer Diagramme, Flussdiagramme und technischer Skizzen in strukturierte JSON-Daten.

Systemarchitektur-Planung

Entwurf von Softwaresystemen mit detaillierten Logikprüfungen unter Verwendung des erweiterten Thinking-Modus.

Automatisierte Git-Workflows

Verwaltung von Commit-Nachrichten, Code-Reviews und Testausführungen durch den Einsatz agentic Tools.

Stärken

Einschränkungen

API-Schnellstart

anthropic/claude-3-7-sonnet

import Anthropic from '@anthropic-ai/sdk';

const anthropic = new Anthropic();

const message = await anthropic.messages.create({

model: "claude-3-7-sonnet-20250219",

max_tokens: 4096,

thinking: {

type: "enabled",

budget_tokens: 2048

},

messages: [{ role: "user", content: "Analysiere diesen architektonischen Fehler..." }],

});

console.log(message.content);Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über Claude 3.7 Sonnet sagen

Sehen Sie, was die Community über Claude 3.7 Sonnet denkt

“Claude Code plus 3.7 Sonnet ist im Grunde ein Junior-Entwickler auf Steroiden in meinem Terminal. Das erste Mal, dass sich agentic AI wirklich echt anfühlt.”

“Das hybride Reasoning ist ein wichtiges Update. Ich brauche nicht immer 30 Sekunden Bedenkzeit, aber beim Debugging ist es unglaublich.”

“Anthropic hat es geschafft, ein model zu entwickeln, das bei Mathematik mit o1 konkurriert und gleichzeitig für tägliche Chats nützlich bleibt.”

“Claude liefert umfassende, hervorragend formatierte Berichte mit Quellenangaben in unter fünf Minuten.”

“Das 128k-Ausgabelimit ist eine unterschätzte Funktion. Endlich ein model, das nicht mitten in einem langen Skript abbricht.”

“Claude 3.7 + MCP ist dem, was Jarvis am nächsten kommt. Es nutzt meine lokalen Tools tatsächlich korrekt.”

Videos über Claude 3.7 Sonnet

Schauen Sie Tutorials, Rezensionen und Diskussionen über Claude 3.7 Sonnet

“Claude 3.7 ist absolut beeindruckend. Das neue Basis-model hat sich selbst übertroffen und ist noch besser beim Programmieren geworden.”

“Das neue 3.7 model hat alle anderen models, einschließlich OpenAI o3 mini, in den Schatten gestellt.”

“Es ist in der Lage, 70 % aller GitHub-Issues zu lösen.”

“Extended thinking erlaubt es dem model, über ein Problem nachzudenken, bevor es Code ausgibt.”

“Das ist ein riesiger Gewinn für die Entwickler-Experience.”

“Chatbots geben dir Ratschläge, aber Claude Code handelt aktiv. Es kann Dateien erstellen, Webseiten bauen und Pakete installieren.”

“Extended thinking bedeutet, dass Claude nachdenkt, bevor es tatsächlich Aktionen ausführt.”

“Das Tool ist für die Terminal-Umgebung optimiert.”

“Die MCP-Konnektivität ist das, was es wirklich vom Standard-ChatGPT unterscheidet.”

“Das model versteht die Absicht hinter vagen Terminal-Befehlen.”

“Die Integration mit dem Terminal über Claude Code bietet ein Maß an Agency, das wir bisher noch nicht gesehen haben.”

“Die Fähigkeit von Claude 3.7 Sonnet, seinen Denkprozess offenzulegen, ist wesentlich transparenter als bei Wettbewerbern.”

“Bei SWE-bench Verified erreicht es beachtliche 62 %.”

“Hybrides Reasoning bedeutet, dass man die Latenz nicht in Kauf nehmen muss, wenn man sie nicht braucht.”

“Es behält den hochwertigen Schreibstil früherer Claude-models bei.”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für Claude 3.7 Sonnet

Expertentipps, um das Beste aus Claude 3.7 Sonnet herauszuholen.

Reasoning-Budgets festlegen

Verwenden Sie den API-Thinking-Parameter, um die Anzahl der Reasoning-tokens zu begrenzen und die Kosten zu steuern.

Thought-Blöcke prüfen

Überprüfen Sie den internen chain-of-thought in den Antworten, um die Logik komplexer Problemlösungen zu verifizieren.

MCP-Connectors nutzen

Verbinden Sie das model mit lokalen Datenbanken und Cloud-Speichern, um Projekt-Kontext in Echtzeit bereitzustellen.

Kontext-Aktualisierung

Verwenden Sie Zusammenfassungsbefehle in langen agentic Loops, damit sich das context window auf die relevanten Daten konzentriert.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GPT-5.4

OpenAI

GPT-5.4 is OpenAI's frontier model featuring a 1.05M context window and Extreme Reasoning. It excels at autonomous UI interaction and long-form data analysis.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Häufig gestellte Fragen zu Claude 3.7 Sonnet

Finden Sie Antworten auf häufige Fragen zu Claude 3.7 Sonnet