Claude Sonnet 4.5

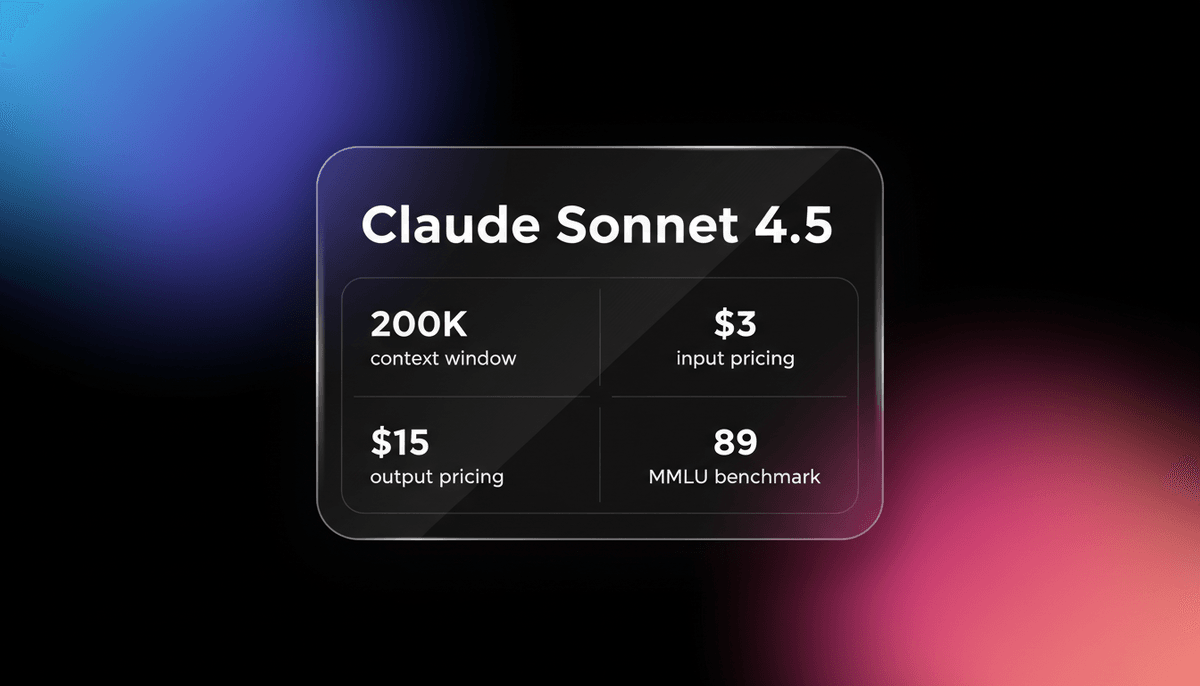

Anthropic's Claude Sonnet 4.5 bietet weltweit führende Coding-Leistung (77,2% SWE-bench) und ein 200K context window, optimiert für die nächste Generation...

Über Claude Sonnet 4.5

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von Claude Sonnet 4.5.

**Die Grenze der Agentic Intelligence**

Claude 4.5 Sonnet stellt einen bedeutenden Fortschritt in der frontier intelligence dar, optimiert für das Zeitalter der autonomen KI-Agenten. Es wurde Ende 2025 veröffentlicht und ist ein hybrid reasoning model, das es Entwicklern ermöglicht, zwischen Hochgeschwindigkeitsausführung für Routineaufgaben und Extended Thinking für komplexe logische Herausforderungen zu wählen. Es führt die benchmarks bei Computer Use und Tool-Orchestrierung an, was es zu einer bevorzugten Engine für terminalbasierte Agenten und softwaretechnische Aufgaben mit vielen Dateien macht.

**Präzision und reduzierte Halluzinationen**

Die Architektur des Modells priorisiert Logik und Präzision und reduziert die Unterwürfigkeit und Halluzinationen, die bei früheren Serien beobachtet wurden. Mit einem 64.000-token Output-Limit und einem 200.000-token Input-Fenster kann es ganze Repositories verarbeiten und in einem einzigen Durchgang vollständige Anwendungsdateien generieren. Es führt native Checkpoints für agentic Workflows ein, die es Systemen ermöglichen, Fehler autonom rückgängig zu machen und zu korrigieren, ohne dass ein Mensch eingreifen muss.

**Multimodale und Reasoning-Fähigkeiten**

Neben der Softwareentwicklung überzeugt Sonnet 4.5 bei der multimodalen Dokumentenanalyse und Finanzmodellierung. Seine interne Logik priorisiert den architektonischen Kontext, wodurch es in der Lage ist, groß angelegte Systeme effektiver abzubilden als seine Vorgänger. Ob bei der Verarbeitung handgeschriebener Notizen oder der Implementierung von API-Integrationen – das Modell behält eine hohe faktische Genauigkeit bei und befolgt strikte Anweisungen bei Aufgaben über lange Zeiträume hinweg.

Anwendungsfälle für Claude Sonnet 4.5

Entdecken Sie die verschiedenen Möglichkeiten, Claude Sonnet 4.5 für großartige Ergebnisse zu nutzen.

Autonome Softwareentwicklung

Steuerung der gesamten Entwicklung von den ersten Anforderungen bis zu automatisierten Commits über terminal interfaces.

GUI-basierte Automatisierung

Automatisierung von Web-Browsing und Dateneingabe in Legacy-Anwendungen mittels nativer Computer-Use-Fähigkeiten.

Multi-Agenten-Orchestrierung

Delegierung spezialisierter Aufgaben an Unter-Agents wie Reviewer oder Builder innerhalb einer zentralen Planungsschleife.

Komplexes Code-Refactoring

Re-Architektur von Codebases mit mehreren Dateien unter Wahrung der Konsistenz über 200.000 tokens aktiven contexts hinweg.

Nuancierte Finanzanalyse

Analyse von Quartalsberichten und Tabellenkalkulationen mittels Vision, um Diskrepanzen und Anlagestrategien zu identifizieren.

Interaktive Datenvisualisierung

Generierung dynamischer Diagramme aus komplexen Datensätzen durch eingebettete Code-Ausführung und Echtzeit-Erstellung.

Stärken

Einschränkungen

API-Schnellstart

anthropic/claude-4-5-sonnet

import Anthropic from '@anthropic-ai/sdk';

const anthropic = new Anthropic({

apiKey: process.env.ANTHROPIC_API_KEY,

});

const response = await anthropic.messages.create({

model: "claude-4-5-sonnet-20250929",

max_tokens: 1024,

messages: [

{ role: "user", content: "Analysiere diese Codebase auf Sicherheitslücken." }

],

});

console.log(response.content[0].text);Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über Claude Sonnet 4.5 sagen

Sehen Sie, was die Community über Claude Sonnet 4.5 denkt

“Claude 4.5 Sonnet ist heute überall verfügbar, das beste Coding-Modell der Welt.”

“Das behebt eines der schmerzhaftesten Skalierungsprobleme bei MCP-Setups. Ich habe gesehen, wie der Kontext verdampfte, bevor die eigentliche Arbeit begann.”

“Claude Code-Sonnet 4.5 ist Gemini 3.0 Pro bei komplexen Dockerized Refactoring-Aufgaben weit voraus.”

“Das Muster: Fehler werden zur Dokumentation. Du fügst eine Regel zu CLAUDE.md hinzu und sie passiert nie wieder.”

“Der Hybrid Reasoning-Modus ist ein Lebensretter für das Debugging komplexer asynchroner Logik, bei der normale Modelle einfach nur in Schleifen laufen.”

“Die Preisparität mit 3.5 Sonnet macht dies zu einem einfachen Upgrade für all unsere produktiven Agenten-Pipelines.”

Videos über Claude Sonnet 4.5

Schauen Sie Tutorials, Rezensionen und Diskussionen über Claude Sonnet 4.5

“Dieses neue 4.5 Sonnet Modell übertrifft sogar Opus 4.1 im Swaybench Verified Test”

“Es konnte bei komplexen mehrstufigen Aufgaben über 30 Stunden lang den Fokus halten”

“Es führt das OS World Computer Use Benchmark mit einer Punktzahl von 61,4 Prozent an”

“Die interne reasoning-Engine handhabt Python-Umgebungen weitaus stabiler als 3.5”

“Die Terminal-Integration fühlt sich deutlich präziser an, fast ohne halluzinierte Shell-Befehle”

“Sonnet 4.5 ist jetzt führend bei der Nutzung von agentic tools... ein Sprung von 20 Prozent, was wirklich aufregend ist”

“Claude Code mit Sonnet 4.5 hat die gesamte Stripe-Implementierung in 15 Minuten abgeschlossen”

“Claude Sonnet 4.5 war deutlich schneller und ein gutes Stück besser”

“Der Thinking-Schalter erlaubt es, mehr Rechenleistung auf spezifische Code-Blöcke zu verteilen”

“Es behält den Kontext perfekt bei, selbst wenn man 150.000 tokens tief in einem riesigen Projekt steckt”

“Es ist das leistungsfähigste Modell überhaupt, wenn es Ihren Computer steuert”

“Die Fehlerraten beim Programmieren sind von 9 Prozent auf praktisch Null gesunken”

“Claude Imagine ist vielleicht das coolste Feature... ein App-Entwicklungserlebnis in Echtzeit”

“Die MCP-Integration erlaubt es, Tools zu durchsuchen, ohne den prompt-context aufzubrauchen”

“Die Latenz bei der Vision-Analyse ist bei komplexen UI-Layouts deutlich reduziert”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für Claude Sonnet 4.5

Expertentipps, um das Beste aus Claude Sonnet 4.5 herauszuholen.

MCP Tool-Suche aktivieren

Nutzen Sie die Model Context Protocol Tool-Suche, um die context-Nutzung um 85 Prozent zu reduzieren und Platz für aktive Dateien zu schaffen.

Agentic Checkpoints nutzen

Verwenden Sie den Befehl /checkpoint in terminal interfaces, um vor größeren Refactorings den Fortschritt für ein sofortiges Rollback zu speichern.

Context Budgeting

Löschen Sie den Verlauf zwischen nicht zusammenhängenden Aufgaben, um Context-Fehler zu vermeiden und eine hohe logische Genauigkeit beizubehalten.

System Prompt Hierarchie

Definieren Sie die Modell-Persona und strikte Output-Vorgaben in einer eigenen Konfigurationsdatei für konsistente Ergebnisse über mehrere Agents hinweg.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

GPT-5.4

OpenAI

GPT-5.4 is OpenAI's frontier model featuring a 1.05M context window and Extreme Reasoning. It excels at autonomous UI interaction and long-form data analysis.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GPT-5.3 Codex

OpenAI

GPT-5.3 Codex is OpenAI's 2026 frontier coding agent, featuring a 400K context window, 77.3% Terminal-Bench score, and superior logic for complex software...

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Häufig gestellte Fragen zu Claude Sonnet 4.5

Finden Sie Antworten auf häufige Fragen zu Claude Sonnet 4.5