GLM-5.1

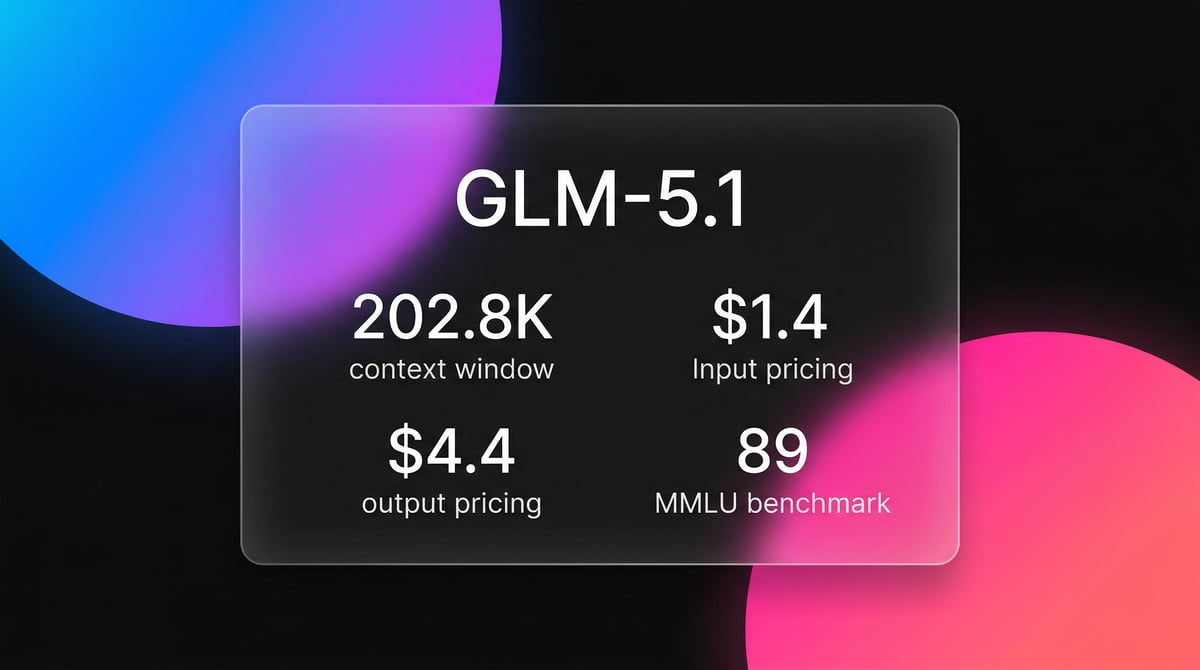

GLM-5.1 ist das flagship-Reasoning-Modell von Zhipu AI, ausgestattet mit einem 202K context window und einer autonomen 8-Stunden-Ausführungsschleife für...

Über GLM-5.1

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von GLM-5.1.

GLM-5.1 ist das flagship-foundation model von Zhipu AI, das für komplexe Systemtechnik und langfristige agentic Aufgaben entwickelt wurde. Basierend auf einer Mixture-of-Experts (MoE)-Architektur mit 744 Milliarden parameters und 40 Milliarden aktiven pro Durchlauf, stellt es einen bedeutenden Sprung in Ausdauer und autonomer Problemlösung dar. Das Modell wurde speziell entwickelt, um die Reasoning-Plateaus früherer Modelle zu überwinden und Produktivität sowie Codequalität über Tausende von Tool-Calls und Hunderte von Iterationen hinweg beizubehalten. Es erkennt Hindernisse, führt Experimente durch und passt seine eigene Strategie ohne menschliches Eingreifen an.

Technisch gesehen eignet sich GLM-5.1 hervorragend als primäre Reasoning-Engine in Multi-Agenten-Systemen. Es übernimmt architektonische Entscheidungen auf hoher Ebene und delegiert die Implementierung an kleinere Modelle. Es bietet ein 202K context window, das durch einen dynamischen sparse attention-Mechanismus unterstützt wird, was die Kohärenz über massive Codebasen hinweg sicherstellt. Das Modell wird als open weights unter der MIT License veröffentlicht und bietet eine praktikable lokale Alternative zu geschlossenen frontier models für Aufgaben wie Datenbankoptimierung, GPU-Kernel-Engineering und Full-Stack-Webanwendungsentwicklung.

KernelBench Level 3 Ergebnisse zeigen, dass GLM-5.1 bei agentic ML-Workloads über lange Zeiträume hinweg eine deutlich höhere Geschwindigkeit im Vergleich zu Claude Opus 4.6 beibehält. Diese Ausdauer ermöglicht es Entwicklern, morgens eine Engineering-Aufgabe zu starten und bis zum Ende des Tages einen vollständig getesteten, bereitgestellten Dienst zu erhalten. Es übernimmt den gesamten Lebenszyklus eines Bug-Fixes, von der Reproduktion des Problems in einer Sandbox bis zur Einreichung des endgültigen Pull-Requests.

Anwendungsfälle für GLM-5.1

Entdecken Sie die verschiedenen Möglichkeiten, GLM-5.1 für großartige Ergebnisse zu nutzen.

Autonomes Software-Engineering

Es läuft über 8 Stunden autonom, um Microservices ohne menschliches Eingreifen zu entwerfen, zu implementieren und zu debuggen.

Hochleistungs-Datenbankoptimierung

Das Modell optimiert in Hunderten von Durchläufen iterativ Rust-basierte vector search-Implementierungen.

GPU-Kernel-Optimierung

Es analysiert Referenzimplementierungen, um schnellere GPU kernels zu erstellen, die Standard-Autotune-Compiler übertreffen.

Multi-Agent-Orchestrierung

Es fungiert als Reasoning-Kern, der Teilaufgaben und Tool-Calls in einem Schwarm spezialisierter, kleinerer Modelle koordiniert.

Komplexe Terminal-Aufgaben

Es führt über agentic CLI-Tools echte Terminaloperationen und mehrstufige Systemverwaltungsaufgaben aus.

Full-Stack-Webdesign

Das Modell generiert visuell konsistente UI-Layouts und Backend-Logik für browserbasierte Desktop-Umgebungen.

Stärken

Einschränkungen

API-Schnellstart

zhipu/glm-5.1

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.ZHIPU_API_KEY,

baseURL: 'https://api.z.ai/api/paas/v4'

});

const chat = await client.chat.completions.create({

model: 'glm-5.1',

messages: [{ role: 'user', content: 'Optimieren Sie dieses Datenbankschema.' }],

stream: true

});

for await (const chunk of chat) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über GLM-5.1 sagen

Sehen Sie, was die Community über GLM-5.1 denkt

“GLM-5.1 lief bei einem prompt 8 Stunden lang in einer Schleife. Es hat nicht wie die meisten Modelle aufgegeben; es hat ständig Funktionen hinzugefügt und sich selbst überprüft.”

“Ich habe es mehr als fünfmal auf 140k-Kontext getestet und es blieb kohärent. Das SOTA könnte einen Herausforderer bekommen haben.”

“GLM-5.1 ist bei diesem benchmark praktisch gleichauf mit Opus. Es ist jetzt das führende offene Modell in der Arena.”

“Jedes Mal, wenn ich sehe, wie ein NPC durch ungeskriptete Dialoge mit GLM-5.1 überzeugt wird, ist das pure Magie.”

“Die Coding-Leistung ist legitim. Es hat eine Race Condition in unserem Go-Backend behoben, bei der GPT-4o ständig halluzinierte.”

“Die lokale Ausführung mit Unsloth ist ein Wendepunkt für den Datenschutz in unserem Legal-Tech-Stack.”

Videos über GLM-5.1

Schauen Sie Tutorials, Rezensionen und Diskussionen über GLM-5.1

“GLM-5.1 erreichte 45,3 % in diesem benchmark, was ein massiver Sprung für die Modellfamilie ist.”

“Es ist ein unglaublich langsames Modell... sie haben wahrscheinlich mehr ihrer GPUs noch für GLM-5 im Einsatz.”

“Die Art und Weise, wie es mit Tool-Calls umgeht, ist viel robuster als beim Standard-GLM 5.”

“Es ist derzeit das stärkste Reasoning-Modell, das man herunterladen und auf eigener Hardware ausführen kann.”

“Man kann sehen, wie es tatsächlich seine eigenen Fehler im Thinking-Log identifiziert.”

“Es kann 8 Stunden lang autonom laufen und Strategien durch Tausende von Iterationen verfeinern.”

“Es übertrifft Gemini 3.1 Pro und Qwen 3.6 Plus bei beliebten Repo-Generation-Benchmarks.”

“Der agentic Modus ist die wahre Stärke dieses Modells, es gibt bei schwierigen Bugs nicht auf.”

“Z.ai hat praktisch die Bezahlschranke für ein frontier-level 744B parameter Modell fallen gelassen.”

“Es bewältigt effektiv das Plateau-Problem, bei dem andere LLMs mit der Zeit den Fokus verlieren.”

“80 % Größenreduzierung von den ursprünglichen 1,65 TB auf 236 GB bei gleichbleibender Qualität.”

“Die Kraft von open-source: Selbst in einer quantisierten Version schrieb es funktionierenden Code für Feuerwerke.”

“Sie benötigen mindestens 256 GB System-RAM, um überhaupt an das Laden dieses MoE-Giganten zu denken.”

“Es verwendet einen dynamischen sparse attention-Mechanismus, um diesen 202k-Kontext kohärent zu halten.”

“Die Verwendung von Unsloth macht den Trainings- und inference-Prozess deutlich effizienter.”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für GLM-5.1

Expertentipps, um das Beste aus GLM-5.1 herauszuholen.

Thinking Mode aktivieren

Stellen Sie sicher, dass der 'Thinking'-Schalter in Ihrer Konfiguration aktiviert ist, um die 8-Stunden-Autonomie-Iterationen freizuschalten.

Off-Peak-Kontingente nutzen

Führen Sie große Engineering-Batches außerhalb der Stoßzeiten zwischen 14:00 und 18:00 Uhr Pekinger Zeit durch, um von günstigeren Preisen zu profitieren.

Lokale Speicheranforderungen

Verwenden Sie die Unsloth Dynamic GGUF-Quantisierung, um das 1,6 TB große Modell für lokale Ausführungen in 256 GB RAM zu laden.

Strategische Aufgabenauswahl

Reservieren Sie GLM-5.1 für architektonisches reasoning und verwenden Sie GLM-4.7 für Routineimplementierungen, um die Kosten zu optimieren.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

Kimi K2.5

Moonshot

Discover Moonshot AI's Kimi K2.5, a 1T-parameter open-source agentic model featuring native multimodal capabilities, a 262K context window, and SOTA reasoning.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

Häufig gestellte Fragen zu GLM-5.1

Finden Sie Antworten auf häufige Fragen zu GLM-5.1