Kimi K2.5

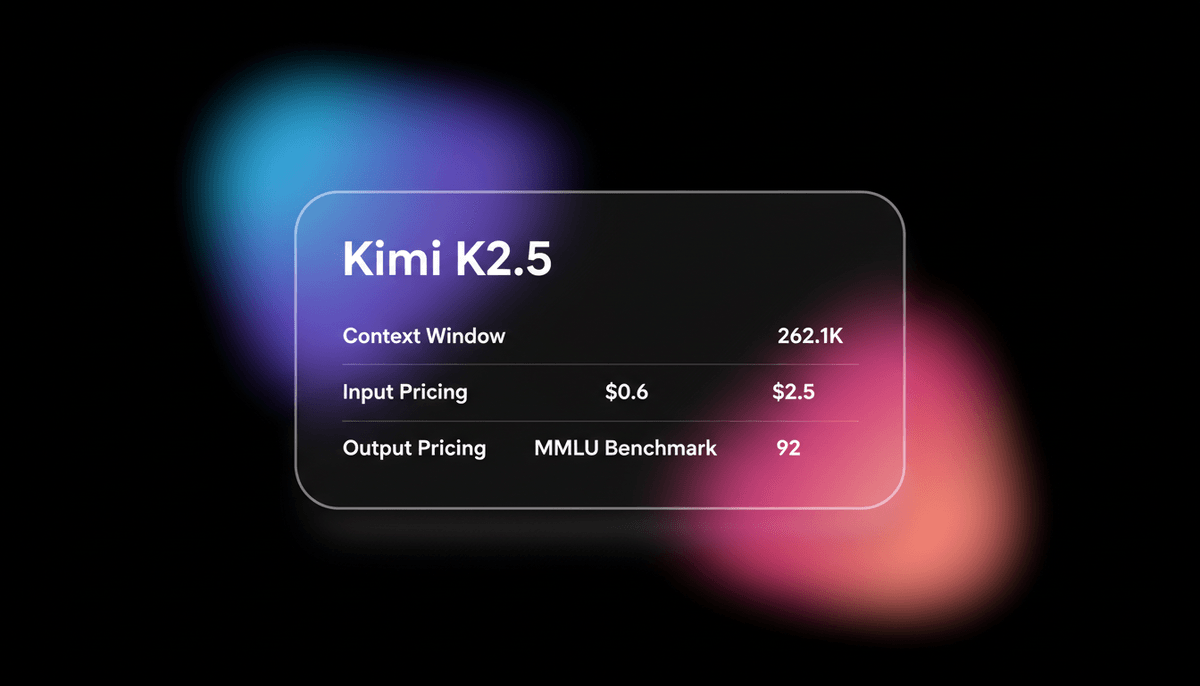

Entdecken Sie Moonshot AIs Kimi K2.5, ein open-source agentic model mit 1T Parametern, nativen multimodalen Fähigkeiten, einer 262K context window und...

Über Kimi K2.5

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von Kimi K2.5.

Kimi K2.5 ist ein open-source, multimodales model von Moonshot AI. Es verwendet eine 1-Billion-Parameter-Mixture-of-Experts-Architektur, bei der 32 Milliarden Parameter pro token aktiv sind. Das System vereint Text-, Bild- und Videoverarbeitung durch ein einheitliches Reasoning-Framework, anstatt separate externe encoder für jede Modalität zu verwenden. Diese Architektur ermöglicht es dem model, 256.000 tokens an Kontext zu verarbeiten, während gleichzeitig eine hohe Abrufgenauigkeit und logische Konsistenz über sehr lange Sequenzen hinweg beibehalten wird.

Das model zeichnet sich durch seine Agent Swarm-Fähigkeit aus. Diese Funktion ermöglicht es dem System, bis zu 100 parallele Sub-agents zu koordinieren, um komplexe Forschungs- oder Entwicklungsaufgaben gleichzeitig auszuführen. Durch die Integration eines MoonViT-3D encoders mit 400M Parametern kann K2.5 mehrere Stunden Videomaterial mit zeitlicher Präzision analysieren. Es wurde speziell für die autonome Ausführung konzipiert und übertrifft viele proprietäre models in agentic benchmarks wie SWE-Bench und BrowseComp.

Kimi K2.5 bietet einen dedizierten Thinking-Modus für Aufgaben, die tiefgreifende Logik erfordern. Wenn aktiviert, generiert das model eine interne chain-of-thought, um sich selbst zu korrigieren und Schritte zu verifizieren, bevor eine endgültige Antwort produziert wird. Dies macht es äußerst effektiv für Mathematik auf Wettbewerbsniveau und groß angelegte Softwareentwicklung. Die Token-Ökonomie ist für den Unternehmenseinsatz optimiert und bietet frontier-Level-Intelligenz zu einem Bruchteil der Kosten konkurrierender closed-source Systeme.

Anwendungsfälle für Kimi K2.5

Entdecken Sie die verschiedenen Möglichkeiten, Kimi K2.5 für großartige Ergebnisse zu nutzen.

Autonome Softwareentwicklung

Lösung komplexer GitHub-Issues und Erstellung von Architektur für Multi-File-Projekte unter Verwendung von SWE-Bench-optimierter Logik.

Visuelle Webentwicklung

Erstellung von funktionalem Frontend-Code und UI-Designs direkt aus Bildschirmaufnahmen bestehender Website-Interaktionen.

Multithreading-Recherche

Verwendung von Agent Swarm, um Informationen aus über 100 Quellen in einem einzigen parallelen Workflow zu crawlen und zusammenzufassen.

Lange Videoanalyse

Extrahieren spezifischer Ereignisse und zeitlicher Daten aus stundenlangen Sicherheits- oder Vorlesungsaufnahmen ohne Tools zur Frame-Extraktion.

Generierung mathematischer Beweise

Anwendung des Deep-Thinking-Modus zur Lösung mathematischer Probleme auf Olympiade-Niveau mit einer Genauigkeit von 96 Prozent.

Automatisierung von Unternehmensdokumenten

Generierung mehrseitiger PDF-Berichte und komplexer Finanztabellen aus unstrukturierten Geschäftsdatenquellen.

Stärken

Einschränkungen

API-Schnellstart

fireworks/kimi-k2p5

import OpenAI from 'openai';

const client = new OpenAI({ apiKey: process.env.KIMI_API_KEY, baseURL: 'https://api.moonshot.cn/v1' });

async function main() {

const res = await client.chat.completions.create({

model: 'kimi-k2.5',

messages: [

{ role: 'system', content: 'You are Kimi, a reasoning agent.' },

{ role: 'user', content: 'Design a parallel research plan for quantum computing trends.' }

],

extra_body: { thinking: { type: 'enabled' } }

});

console.log(res.choices[0].message.content);

}

main();Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über Kimi K2.5 sagen

Sehen Sie, was die Community über Kimi K2.5 denkt

“Kimi K2.5 kostet bei ähnlichem Leistungsniveau fast nur 10 Prozent dessen, was Opus kostet.”

“Die Leute vergessen, dass Nvidia 600 Milliarden Dollar an Wert verlor, als ein chinesisches Labor etwas Großes open source machte. Kimi tut das mit frontier-Intelligenz erneut.”

“Das Attention Residuals-Konzept in K2.5 ist die erste architektonische Änderung seit Jahren, die tatsächlich das Problem des Vergessens bei LLMs behebt.”

“Workers AI betreibt jetzt große models. Kimi K2.5 ist das erste. Es ist eines der besten open-source models überhaupt und auch sehr gut zum Coden.”

“Kimi K2.5 ist ein ganz anderes Kaliber. Es ist ein intelligentes, unglaubliches RP-model, aber es kann neurotisch werden, wenn man keine Community-Presets verwendet.”

“Ich habe meinen GPT 4-Workflow durch Kimi K2.5 ersetzt, weil der Thinking-Modus transparenter ist und die context window mein ganzes Repo abdeckt.”

Videos über Kimi K2.5

Schauen Sie Tutorials, Rezensionen und Diskussionen über Kimi K2.5

“Kimmy K2.5 schlägt GPT 5.2 mit hohem thinking-Level und lässt andere frontier-Modelle weit hinter sich.”

“Es ist das bisher stärkste open-source coding-model mit 76,8 Punkten auf SWE verified.”

“Agent swarm markiert den Wechsel von einem einzelnen agent zu einem Multi-agent-System, das parallele Workflows über bis zu 1500 koordinierte Schritte ausführt.”

“Die context window ist mit 256k tokens gewaltig und reicht für die meisten Projekte völlig aus.”

“Moonshot verschiebt Anfang 2026 wirklich die Grenzen dessen, was mit open weights möglich ist.”

“Es hat die gesamte Apple-Designästhetik wirklich gut getroffen und allein aus einem Video eine ansprechend aussehende Website mit Animationen erstellt.”

“Die Swarm-Funktion sieht sehr cool aus und macht definitiv Spaß, da sie jedem Sub-agent ID-Badges zuweist.”

“K2.5 ist mit 60 Cent pro Million Input tokens und 3 Dollar pro Million Output tokens viel günstiger.”

“Die native Videoverarbeitung bedeutet, dass Sie keine teuren externen Tools zur Verarbeitung von Frames benötigen.”

“Dieses model ist ein Wendepunkt für Entwickler, die autonome agents mit begrenztem Budget benötigen.”

“Moonshot hat dies erreicht, indem jedem Sub-agent an verschiedenen kritischen Stufen Belohnungen zugewiesen werden, um einen seriellen Zusammenbruch zu verhindern.”

“Das model lernt, Parallelität nur dann zu wählen, wenn dies den kritischen Pfad verkürzt – eine sehr clevere Innovation.”

“Kimi K2.5 steht kurz davor, dass man es mit GGUF auf Consumer-Hardware ausführen kann.”

“Der Thinking-Modus ist unglaublich robust bei der Lösung komplexer logischer Fehler in Python.”

“Ein 1-Billion-Parameter-model so veröffentlicht zu sehen, ist eine riesige Sache für die open-source Community.”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für Kimi K2.5

Expertentipps, um das Beste aus Kimi K2.5 herauszuholen.

Thinking-Modus aktivieren

Geben Sie den thinking-Parameter in Ihrer API-Anfrage an, um bei Mathematik- und Coding-Aufgaben maximale Genauigkeit zu erzielen.

Agent Swarm auslösen

Weisen Sie das model an, einen Swarm für Forschungsaufgaben einzusetzen, um eine parallele Orchestrierung über mehrere Sub-agents hinweg zu erzwingen.

Temperature optimieren

Verwenden Sie für den Thinking-Modus eine temperature von 1.0, um vielfältiges reasoning zu ermöglichen, senken Sie diese jedoch auf 0.6 für Standard-Chats.

Kombinierte Vision-Prompts

Laden Sie Fehlermeldungs-Screenshots zusammen mit Code-Snippets hoch, um das integrierte Text-Vision-Training des models zu nutzen.

Context Caching

Nutzen Sie context caching für wiederkehrende lange Dokumente, um die Input-Kosten um bis zu 90 Prozent zu senken.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

Grok-4

xAI

Grok-4 by xAI is a frontier model featuring a 2M token context window, real-time X platform integration, and world-record reasoning capabilities.

GPT-5.1

OpenAI

GPT-5.1 is OpenAI’s advanced reasoning flagship featuring adaptive thinking, native multimodality, and state-of-the-art performance in math and technical...

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Qwen3.5-397B-A17B

alibaba

Qwen3.5-397B-A17B is Alibaba's flagship open-weight MoE model. It features native multimodal reasoning, a 1M context window, and a 19x decoding throughput...

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

Häufig gestellte Fragen zu Kimi K2.5

Finden Sie Antworten auf häufige Fragen zu Kimi K2.5