Qwen3.5-Omni

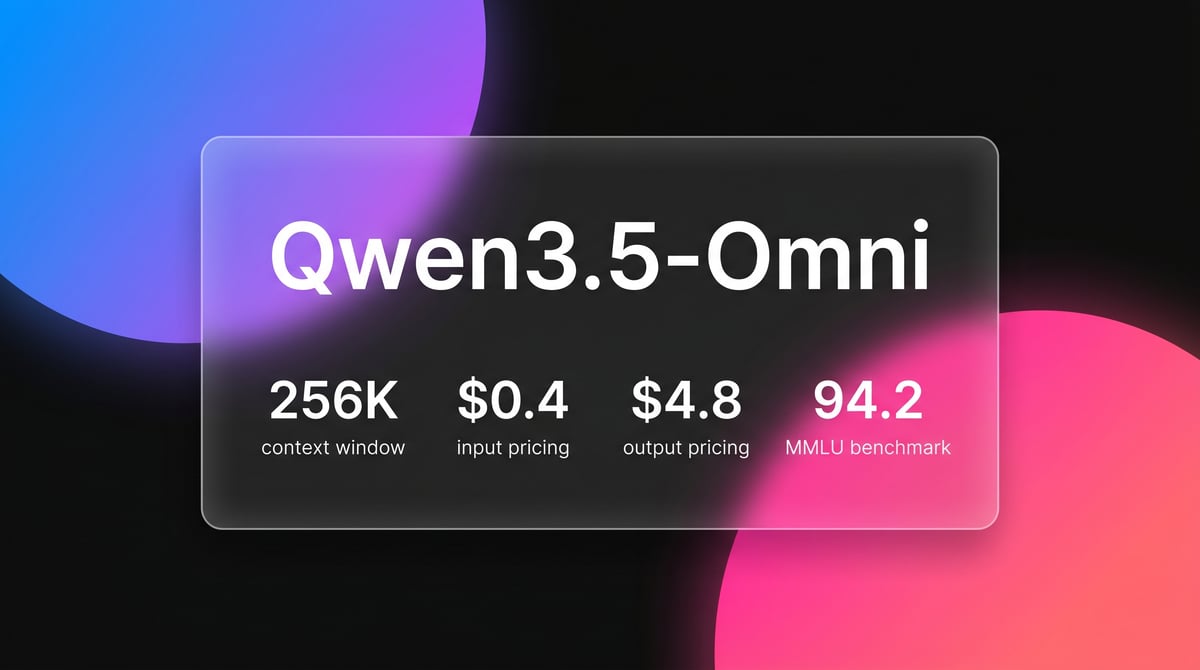

Qwen3.5-Omni ist eine native omnimodale KI von Alibaba Cloud, die nahtloses audiovisuelles Reasoning, Echtzeit-Voice-Chat und 256k Kontext für Anwendungen mit...

Über Qwen3.5-Omni

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von Qwen3.5-Omni.

Einheitliche omnimodale Architektur

Qwen3.5-Omni ist ein natives omnimodales Modell von Alibaba Cloud, das auf einer einheitlichen Architektur basiert, um Text-, Bild-, Audio- und Video-Inputs gleichzeitig zu verarbeiten. Im Gegensatz zu früheren Modellen, die auf separaten Encodern basierten, nutzt Qwen3.5-Omni eine Thinker-Talker-Architektur. Die Thinker-Komponente führt komplexes multimodales Reasoning über verschachtelte Signale durch, während die Talker-Komponente hochwertige Streaming-Sprache mit niedriger Latenz generiert. Dies ermöglicht es dem Modell, massive Kontextmengen zu bewältigen, einschließlich bis zu 10 Stunden Audio oder fast sieben Minuten 720p-Video in einem einzigen prompt.

Fortschrittliche Synchronisation und Performance

Ein technisches Merkmal dieses Modells ist das Adaptive Rate Interleave Alignment (ARIA) System, das Text- und Sprach-tokens synchronisiert, um natürlich klingende Sprachantworten sicherzustellen. Das Modell unterstützt semantische Unterbrechungen in Echtzeit, was es Benutzern erlaubt, die KI während der Konversation zu unterbrechen. Es ist sowohl für multimodale Unternehmensanalysen als auch für verbraucherorientierte Echtzeit-Sprachassistenten optimiert und bietet eine Performance bei Bild- und Audioaufgaben, die proprietäre flagship-Modelle erreicht oder übertrifft.

Spezialisiert auf Interaktion mit niedriger Latenz

Die Architektur des Modells ist speziell für Echtzeitanwendungen abgestimmt, bei denen die Latenz kritisch ist. Durch den Einsatz eines Mixture-of-Experts (MoE) Ansatzes in Kombination mit einer Gated-Delta-Network-Architektur behält das Modell eine hohe rechnerische Effizienz bei. Diese Effizienz ermöglicht eine Audio-Interaktion in Echtzeit bei gleichzeitigem Management eines 256k-token context window, was es ideal für die Analyse von Langformat-Inhalten wie Meeting-Transkripten oder die Indexierung von Videofilmen macht.

Anwendungsfälle für Qwen3.5-Omni

Entdecken Sie die verschiedenen Möglichkeiten, Qwen3.5-Omni für großartige Ergebnisse zu nutzen.

Echtzeit-Sprachassistenten

Das Modell erstellt interaktive KI-Avatare, die dank Unterstützung für semantische Unterbrechungen natürliche Sprachkonversationen führen.

Cinematische Video-Captioning

Es generiert Beschreibungen auf Drehbuchniveau sowie zeitgestempelte Anmerkungen für hochauflösende Langvideos.

Audiovisuelles Live-Coding

Entwickler beheben Code, indem sie ihren Bildschirm teilen und die Logik dem Modell in Echtzeit verbal erklären.

Archivierung von Unternehmens-Audio

Das System verarbeitet bis zu 10 Stunden an Meeting-Aufzeichnungen oder Podcasts, um in einem Durchgang Erkenntnisse zu extrahieren.

Mehrsprachige Übersetzungsdienste

Es bietet End-to-End-Sprachübersetzung in 113 Sprachen und verschiedenen regionalen chinesischen Dialekten.

Content-Moderation

Das Modell prüft Video- und Audiostreams auf Sicherheit, indem es gleichzeitig visuelle und verbale verbotene Inhalte identifiziert.

Stärken

Einschränkungen

API-Schnellstart

alibaba/qwen3.5-omni-plus

import OpenAI from 'openai';

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: 'https://dashscope-intl.aliyuncs.com/compatible-mode/v1',

});

const completion = await client.chat.completions.create({

model: 'qwen3.5-omni-plus',

messages: [{ role: 'user', content: 'Analyze this video content.' }],

modalities: ['text'],

stream: true,

});

for await (const chunk of completion) {

process.stdout.write(chunk.choices[0]?.delta?.content || '');

}Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über Qwen3.5-Omni sagen

Sehen Sie, was die Community über Qwen3.5-Omni denkt

“Das audiovisuelle Vibe-Coding ist ein echter Game-Changer; es versteht endlich, was ich auf dem Bildschirm zeige, während ich den Bug erkläre.”

“Die Fähigkeit von Qwen3.5-Omni, 10 Stunden Audio in einem context window zu verarbeiten, ist für Forscher und Podcaster ein Wahnsinn.”

“Das Voice-Cloning klingt im Vergleich zur vorherigen Generation überraschend natürlich, im Englischen fast nicht mehr zu unterscheiden.”

“Endlich ein Modell, das mich nicht mitten im Satz unterbricht; die semantische Unterbrechung funktioniert wie versprochen.”

“Beeindruckende Zahlen für das neue Qwen3.6 27B, aber die Omni-Version ist diejenige, die jeder für echte Produkte verwenden wird.”

“Ich habe versucht, es fünfmal zu unterbrechen, und es hat jedes Mal meine Absicht verstanden.”

Videos über Qwen3.5-Omni

Schauen Sie Tutorials, Rezensionen und Diskussionen über Qwen3.5-Omni

“Die Thinker-Talker-Architektur ist ein massiver Sprung nach vorn in Sachen Echtzeit-Latenz [04:15].”

“Es verarbeitet 400 Sekunden Video, was doppelt so viel ist, wie wir normalerweise sehen [07:22].”

“Dieses Modell ist von Grund auf mehrsprachig und multimodal [10:05].”

“Das ARIA-System verhindert die Aussprachefehler, die bei Standard-TTS auftreten [15:30].”

“Man kann buchstäblich seinen Bildschirm zeigen und eine flüssige Konversation über den Code führen [22:10].”

“Ich habe versucht, es fünfmal zu unterbrechen, und es hat jedes Mal meine Absicht verstanden [08:30].”

“Die Art und Weise, wie es Code basierend auf dem schreibt, was es im Video sieht, ist unheimlich [10:45].”

“Dies ist der erste echte Konkurrent für den Sprachmodus von GPT-4o, den wir bisher gesehen haben [14:20].”

“Es unterstützt 113 Sprachen bei der Spracherkennung, was ein riesiger Vorteil ist [18:55].”

“Die Extraktion visueller Informationen ist für komplexe PDFs und Videos weitaus robuster [25:15].”

“Der 10-Stunden-Audio-Kontext ist hier der eigentliche Star für den Unternehmenseinsatz [12:10].”

“Die Leistung in Nicht-Englisch-Sprachen ist der Bereich, in dem Qwen wirklich die Nase vorn hat [15:40].”

“Es kann zwischen Hintergrundgeräuschen und tatsächlichen Benutzerunterbrechungen unterscheiden [19:22].”

“Die Preisgestaltung ist sehr wettbewerbsfähig, besonders bei der Anzahl der aktiven parameters [24:10].”

“Dies ist derzeit das leistungsfähigste Modell für Python-Automatisierung mit visueller Benutzeroberfläche [28:45].”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für Qwen3.5-Omni

Expertentipps, um das Beste aus Qwen3.5-Omni herauszuholen.

Audio-Ingestion optimieren

Segmentieren Sie Audioaufnahmen, die länger als 10 Stunden sind, um die Genauigkeit beim Abrufen von Fakten innerhalb des 256k context window zu gewährleisten.

Semantische Unterbrechung nutzen

Aktivieren Sie native Turn-Taking-Funktionen in Voice-Apps, um die Benutzerabsicht von Hintergrundgeräuschen zu unterscheiden.

ARIA für Fachbegriffe verwenden

Nutzen Sie den Streaming-Sprachmodus, um von der ARIA-Ausrichtung zu profitieren, die eine präzise Aussprache technischer Zahlen sicherstellt.

Kontrolle der Video-Bildrate

Laden Sie Standardvideos mit 1 FPS hoch, erhöhen Sie die Rate jedoch bei actiongeladenen Szenen, um visuelle Präzision zu gewährleisten.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

GPT-5.4

OpenAI

GPT-5.4 is OpenAI's frontier model featuring a 1.05M context window and Extreme Reasoning. It excels at autonomous UI interaction and long-form data analysis.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

GPT-5.3 Codex

OpenAI

GPT-5.3 Codex is OpenAI's 2026 frontier coding agent, featuring a 400K context window, 77.3% Terminal-Bench score, and superior logic for complex software...

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Häufig gestellte Fragen zu Qwen3.5-Omni

Finden Sie Antworten auf häufige Fragen zu Qwen3.5-Omni