Qwen3-Coder-Next

Qwen3-Coder-Next ist das erstklassige Apache 2.0 Coding-model von Alibaba Cloud, mit 80B MoE-Architektur und 256k context window für fortgeschrittene lokale...

Über Qwen3-Coder-Next

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von Qwen3-Coder-Next.

Modellarchitektur

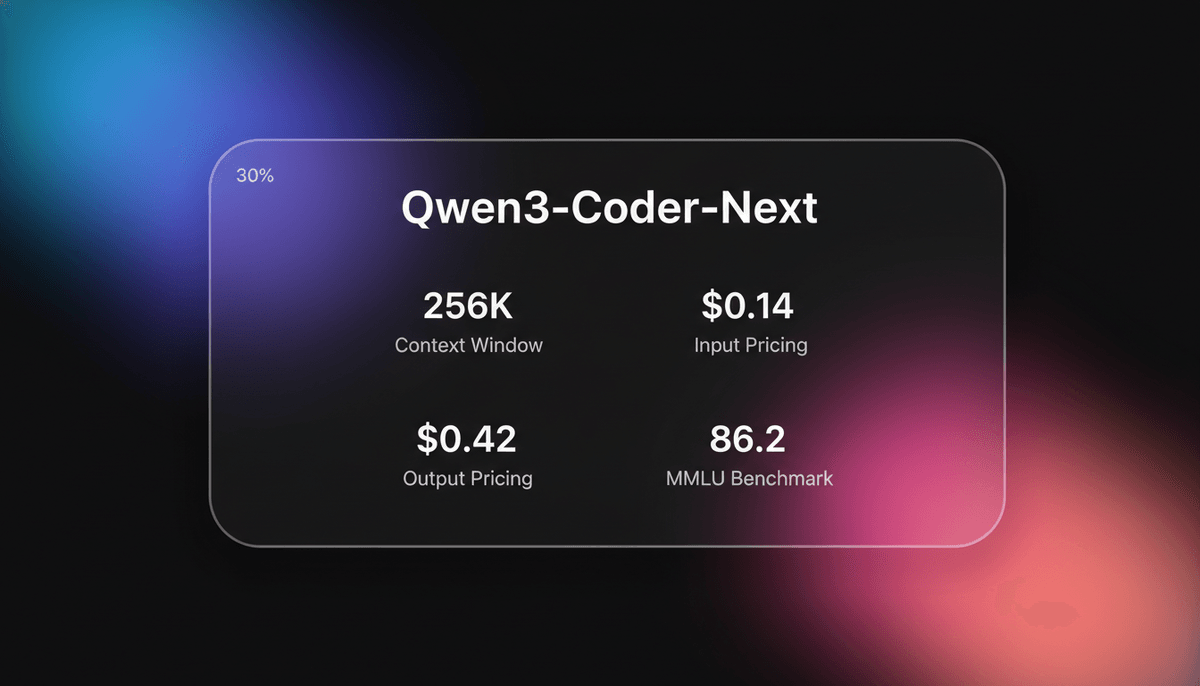

Qwen3-Coder-Next ist ein spezialisiertes open-weight model von Alibaba Cloud für Software-Engineering-agents. Es nutzt eine Mixture-of-Experts (MoE)-Architektur mit insgesamt 80 Milliarden parameters, aktiviert jedoch nur 3 Milliarden pro token. Dieses Design kombiniert die Intelligenz eines riesigen Modells mit der inference-Geschwindigkeit eines kleinen Modells. Die Architektur umfasst einen hybriden attention-Mechanismus, der Gated DeltaNet mit standard Gated Attention kombiniert, um Kontexte von bis zu 262.144 tokens zu verarbeiten.

Agentic-Spezialisierung

Das model wurde mit über 800.000 verifizierbaren Coding-Aufgaben und in ausführbaren Umgebungen trainiert. Dieses Training legt den Schwerpunkt auf weitreichendes Reasoning und die Fähigkeit, sich von Ausführungsfehlern zu erholen. Es erzielt 70,8 % auf SWE-Bench Verified und demonstriert damit seine Kapazität, mehrstufige Entwicklungsaufgaben von der ersten Planung bis zur finalen Code-Ausführung zu bewältigen. Es ist hervorragend geeignet für autonome agentic Frameworks wie OpenClaw und Qwen Code.

Bereitstellung und Datenschutz

Lizenziert unter Apache 2.0 bietet dieses model eine sichere Alternative für Entwickler, die lokale, private Entwicklungsumgebungen benötigen. Es kann durch Quantisierung auf Consumer-Hardware mit ausreichend RAM ausgeführt werden. Das große context window ermöglicht Analysen auf Repository-Ebene ohne den Leistungsabfall, der bei Modellen mit kleinerem Kontext typisch ist.

Anwendungsfälle für Qwen3-Coder-Next

Entdecken Sie die verschiedenen Möglichkeiten, Qwen3-Coder-Next für großartige Ergebnisse zu nutzen.

Autonome Coding-agents

Unterstützt Frameworks bei der Bewältigung mehrstufiger Entwicklungsaufgaben, von der Planung bis zur finalen Ausführung.

Lokale private Entwicklung

Führt erstklassige Coding-Unterstützung auf Consumer-GPUs mit 16GB VRAM unter Verwendung quantisierter MoE-Layer aus.

Repository-Analyse im großen Maßstab

Verarbeitet komplette Codebasen innerhalb seines 256k-Fensters, um technische Schulden zu identifizieren.

Code-Reparatur und Refactoring

Aktualisiert Legacy-Code auf moderne Standards durch Bereitstellung ausführbaren Umgebungs-Feedbacks.

Mehrsprachiges Scripting

Generiert hochpräzisen Code in über 40 Programmiersprachen, einschließlich Rust und Go.

Interaktive 3D-Simulation

Erstellt komplexe webbasierte Visualisierungen und Simulationen mittels schneller One-Shot-Generierung.

Stärken

Einschränkungen

API-Schnellstart

alibaba/qwen-3-coder-next

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.DASHSCOPE_API_KEY,

baseURL: "https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

});

async function main() {

const completion = await client.chat.completions.create({

model: "qwen3-coder-next",

messages: [

{ role: "system", content: "You are a professional coding assistant." },

{ role: "user", content: "Write a React component for a sortable list." },

],

});

console.log(completion.choices[0].message.content);

}

main();Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über Qwen3-Coder-Next sagen

Sehen Sie, was die Community über Qwen3-Coder-Next denkt

“Erreicht fast Claude-Niveau bei den allgemeinen Coding-Fähigkeiten. Schlägt Claude 3.5 Sonnet bei HumanEval mit 92,7 %.”

“Die Effizienz der MoE-Version ist der Wahnsinn für lokale Hardware. Ich erhalte 26 TPS auf einem Mittelklasse-System.”

“Self-speculative decoding ist für Qwen Coder Next aufgrund der recurrent states mathematisch unmöglich.”

“Qwen3-Coder-Next basiert auf MoE und ist viel stärker und intelligenter als zuvor!”

“Demonstriert die Fähigkeit, mitten im Projekt mit den neuen 480B-Modellvarianten den Anbieter zu wechseln.”

“Das agentic Training-Rezept auf 800k Aufgaben zeigt sich darin, wie es sich von Build-Fehlern erholt.”

Videos über Qwen3-Coder-Next

Schauen Sie Tutorials, Rezensionen und Diskussionen über Qwen3-Coder-Next

“Macht es zugänglich für Leute, die mit lokalen AI-Coding-agents experimentieren wollen”

“Für mich schreit das nach einem offenen Code-Test, den ich hiermit durchführen werde”

“Die Speichereffizienz bei diesem Modell ist ein riesiger Gewinn”

“Es handhabt komplexe Logik besser als das vorherige 72B dense model”

“Dies ist das erste open-source model, das meine Terminal-Befehle korrekt befolgt”

“Qwen 3 Coder Next hat auch nur 3 Milliarden aktive parameters, um auf Consumer-Grafikkarten zu laufen”

“Es funktioniert wunderbar. Ich bin wirklich erstaunt, dass ich dieses Ergebnis in einem Rutsch von einer lokalen AI erhalten kann”

“80 Milliarden parameters erfordern normalerweise einen Cluster, aber der MoE-Ansatz ändert alles”

“Es verarbeitet 40+ Programmiersprachen ohne spürbaren Leistungsabfall”

“Die Verwendung mit OpenClaw fühlt sich an, als hätte man einen Junior-Entwickler im Team”

“Ein 3-Milliarden-Parameter-Modell im direkten Vergleich mit Modellen, die 10- bis 20-mal so groß sind”

“Qwen 3 kommt mit vielen Vorteilen, aber zu geringeren Kosten”

“Der 256k-context ist echt, er hat nicht inmitten meines Projekts halluziniert”

“Die latency ist überraschend niedrig angesichts des Gesamtgewichts von 80B parameters”

“Es hat einen Bug in meinem alten Go-Repository behoben, den GPT-4o dreimal übersehen hat”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für Qwen3-Coder-Next

Expertentipps, um das Beste aus Qwen3-Coder-Next herauszuholen.

Verwenden Sie lange System-prompts

Geben Sie dem model detaillierte Beispiele und Dokumentationen, um sein agentic Verhalten präzise auszurichten.

Iteratives Fehler-Feedback

Füttern Sie Browser-Konsolen-Fehlerprotokolle zurück in das model für eine Selbstkorrektur mit hoher Erfolgsquote.

Optimierung des Layer-Offloadings

Lagern Sie spezifische MoE-Expert-Layer in den System-RAM aus, um inference-Geschwindigkeit und Reasoning auszubalancieren.

Sampling-parameters anpassen

Verwenden Sie eine Temperature von 1.0 mit top_p 0.95 und top_k 40 für die präzisesten Coding-Ergebnisse.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

MiMo V2.5 Pro

Other

MiMo V2.5 Pro is Xiaomi's open-source 1.02T parameter MoE model featuring a 1M context window, native multimodality, and elite agentic coding performance.

DeepSeek-V3.2-Speciale

DeepSeek

DeepSeek-V3.2-Speciale is a reasoning-first LLM featuring gold-medal math performance, DeepSeek Sparse Attention, and a 131K context window. Rivaling GPT-5...

MiniMax M2.5

minimax

MiniMax M2.5 is a SOTA MoE model featuring a 1M context window and elite agentic coding capabilities at disruptive pricing for autonomous agents.

GLM-4.7

Zhipu (GLM)

GLM-4.7 by Zhipu AI is a flagship 358B MoE model featuring a 200K context window, elite 73.8% SWE-bench performance, and native Deep Thinking for agentic...

GPT-4o mini

OpenAI

OpenAI's most cost-efficient small model, GPT-4o mini offers multimodal intelligence and high-speed performance at a significantly lower price point.

Qwen 3.7 Max

alibaba

Qwen 3.7 Max is Alibaba’s flagship AI model for deep reasoning and autonomous agent tasks, featuring a 256k context window and top-tier coding performance.

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

DeepSeek v4

DeepSeek

DeepSeek v4 is a 1.6T parameter MoE model featuring a 1M token context window and native multimodal support for text, vision, and video at disruptive prices.

Häufig gestellte Fragen zu Qwen3-Coder-Next

Finden Sie Antworten auf häufige Fragen zu Qwen3-Coder-Next