Comment scraper Archive.org | Scraper web pour Internet Archive

Apprenez à scraper Archive.org pour obtenir des snapshots historiques et des métadonnées de médias. \n\nDonnées clés : extrayez des livres, des vidéos et des...

Protection Anti-Bot Détectée

- Limitation de débit

- Limite les requêtes par IP/session dans le temps. Peut être contourné avec des proxys rotatifs, des délais de requête et du scraping distribué.

- Blocage IP

- Bloque les IP de centres de données connues et les adresses signalées. Nécessite des proxys résidentiels ou mobiles pour contourner efficacement.

- Account Restrictions

- WAF Protections

À Propos de Archive.org

Découvrez ce que Archive.org offre et quelles données précieuses peuvent être extraites.

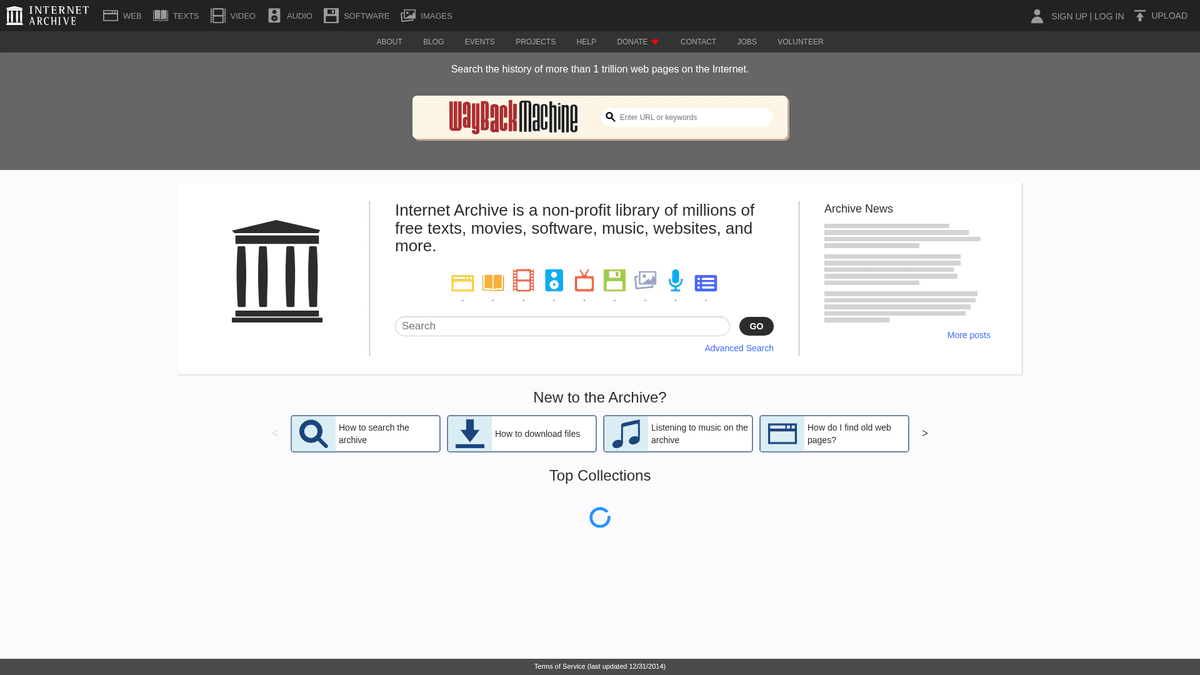

Présentation d'Archive.org

Archive.org, connu sous le nom d'Internet Archive, est une bibliothèque numérique à but non lucratif basée à San Francisco. Sa mission est de fournir un accès universel à toutes les connaissances en archivant des artefacts numériques, y compris la célèbre Wayback Machine qui a sauvegardé plus de 800 milliards de pages web.

Collections numériques

Le site héberge une immense variété de contenus : plus de 38 millions de livres et textes, 14 millions d'enregistrements audio et des millions de vidéos et programmes logiciels. Ceux-ci sont organisés en collections avec des champs de métadonnées riches tels que le Titre de l'élément, le Créateur et les Droits d'utilisation.

Pourquoi scraper Archive.org

Ces données sont inestimables pour les chercheurs, les journalistes et les développeurs. Elles permettent des études longitudinales du web, la récupération de contenus perdus et la création de jeux de données massifs pour le Traitement du Langage Naturel (NLP) et les modèles de machine learning.

Pourquoi Scraper Archive.org?

Découvrez la valeur commerciale et les cas d'utilisation pour l'extraction de données de Archive.org.

Analyse historique du web

Scraper la Wayback Machine vous permet de suivre l'évolution du message d'une marque, de ses offres de produits et de ses prix sur plusieurs décennies.

Récupération de contenu perdu

Récupérez des articles, du code ou de la documentation de sites web hors ligne ou supprimés, servant ainsi de sauvegarde numérique pour des recherches perdues.

Audit SEO et de domaines

Analysez les profils historiques de backlinks et les structures de contenu des domaines expirés avant de les acheter pour des stratégies de redirection SEO.

Collecte de preuves juridiques

Rassemblez des snapshots horodatés de pages web publiques pour servir de preuves médico-légales dans des affaires de propriété intellectuelle ou de conformité réglementaire.

Entraînement de model AI

Extrayez des jeux de données massifs et diversifiés de textes historiques et de médias du domaine public pour entraîner des Large Language Models sur l'évolution du langage humain.

Veille concurrentielle

Surveillez comment les concurrents ont historiquement modifié leur positionnement stratégique ou changé leurs conditions d'utilisation pour obtenir des avantages sur le marché.

Défis du Scraping

Défis techniques que vous pouvez rencontrer lors du scraping de Archive.org.

Limitation de débit agressive

Archive.org renvoie fréquemment des erreurs 503 'Service Unavailable' lorsqu'il détecte des requêtes automatisées à haute fréquence vers ses pages de recherche ou de calendrier.

Structures HTML incohérentes

Les snapshots historiques conservent le code d'origine du site, ce qui signifie qu'un seul scraper doit souvent gérer des dizaines de mises en page HTML différentes pour une même URL.

Échelle de données massive

Avec des pétaoctets de données disponibles, l'identification du snapshot ou du fichier de métadonnées spécifique dont vous avez besoin nécessite un filtrage sophistiqué via l'API CDX.

Navigation complexe par horodatage

Les URL de la Wayback Machine utilisent un système d'horodatage imbriqué qui rend la navigation directe difficile sans une construction programmatique d'URL.

Scrapez Archive.org avec l'IA

Aucun code requis. Extrayez des données en minutes avec l'automatisation par IA.

Comment ça marche

Décrivez ce dont vous avez besoin

Dites à l'IA quelles données vous souhaitez extraire de Archive.org. Tapez simplement en langage naturel — pas de code ni de sélecteurs.

L'IA extrait les données

Notre intelligence artificielle navigue sur Archive.org, gère le contenu dynamique et extrait exactement ce que vous avez demandé.

Obtenez vos données

Recevez des données propres et structurées, prêtes à exporter en CSV, JSON ou à envoyer directement à vos applications.

Pourquoi utiliser l'IA pour le scraping

L'IA facilite le scraping de Archive.org sans écrire de code. Notre plateforme alimentée par l'intelligence artificielle comprend quelles données vous voulez — décrivez-les en langage naturel et l'IA les extrait automatiquement.

How to scrape with AI:

- Décrivez ce dont vous avez besoin: Dites à l'IA quelles données vous souhaitez extraire de Archive.org. Tapez simplement en langage naturel — pas de code ni de sélecteurs.

- L'IA extrait les données: Notre intelligence artificielle navigue sur Archive.org, gère le contenu dynamique et extrait exactement ce que vous avez demandé.

- Obtenez vos données: Recevez des données propres et structurées, prêtes à exporter en CSV, JSON ou à envoyer directement à vos applications.

Why use AI for scraping:

- Sélection visuelle de la date: Automatio vous permet d'interagir visuellement avec le calendrier de la Wayback Machine pour sélectionner et parcourir les snapshots sans écrire de logique regex complexe.

- Rendu de contenu dynamique: Le moteur basé sur le navigateur garantit que les pages archivées contenant des composants JavaScript ou Flash hérités sont correctement rendues avant l'extraction des données.

- Logique de réessai intelligente: Automatio peut être configuré pour gérer automatiquement les erreurs 503 fréquentes et les blocages IP temporaires courants lors du scraping d'Archive.org.

- Mapping de données structurées: Convertissez le HTML historique désordonné en formats CSV ou JSON propres, facilitant ainsi l'analyse longitudinale du contenu archivé.

Scrapers Web No-Code pour Archive.org

Alternatives pointer-cliquer au scraping alimenté par l'IA

Plusieurs outils no-code comme Browse.ai, Octoparse, Axiom et ParseHub peuvent vous aider à scraper Archive.org sans écrire de code. Ces outils utilisent généralement des interfaces visuelles pour sélectionner les données, bien qu'ils puissent avoir des difficultés avec le contenu dynamique complexe ou les mesures anti-bot.

Workflow Typique avec les Outils No-Code

Défis Courants

Courbe d'apprentissage

Comprendre les sélecteurs et la logique d'extraction prend du temps

Les sélecteurs cassent

Les modifications du site web peuvent casser tout le workflow

Problèmes de contenu dynamique

Les sites riches en JavaScript nécessitent des solutions complexes

Limitations des CAPTCHAs

La plupart des outils nécessitent une intervention manuelle pour les CAPTCHAs

Blocage d'IP

Le scraping agressif peut entraîner le blocage de votre IP

Scrapers Web No-Code pour Archive.org

Plusieurs outils no-code comme Browse.ai, Octoparse, Axiom et ParseHub peuvent vous aider à scraper Archive.org sans écrire de code. Ces outils utilisent généralement des interfaces visuelles pour sélectionner les données, bien qu'ils puissent avoir des difficultés avec le contenu dynamique complexe ou les mesures anti-bot.

Workflow Typique avec les Outils No-Code

- Installer l'extension de navigateur ou s'inscrire sur la plateforme

- Naviguer vers le site web cible et ouvrir l'outil

- Sélectionner en point-and-click les éléments de données à extraire

- Configurer les sélecteurs CSS pour chaque champ de données

- Configurer les règles de pagination pour scraper plusieurs pages

- Gérer les CAPTCHAs (nécessite souvent une résolution manuelle)

- Configurer la planification pour les exécutions automatiques

- Exporter les données en CSV, JSON ou se connecter via API

Défis Courants

- Courbe d'apprentissage: Comprendre les sélecteurs et la logique d'extraction prend du temps

- Les sélecteurs cassent: Les modifications du site web peuvent casser tout le workflow

- Problèmes de contenu dynamique: Les sites riches en JavaScript nécessitent des solutions complexes

- Limitations des CAPTCHAs: La plupart des outils nécessitent une intervention manuelle pour les CAPTCHAs

- Blocage d'IP: Le scraping agressif peut entraîner le blocage de votre IP

Exemples de Code

import requests

from bs4 import BeautifulSoup

# Définir l'URL cible pour une collection

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (contact: email@example.com)'}

try:

# Envoyer la requête avec les en-têtes

response = requests.get(url, headers=headers)

response.raise_for_status()

# Analyser le contenu HTML

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'Sans Titre'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Élément trouvé : {title} | Lien : {link}')

except Exception as e:

print(f'Une erreur est survenue : {e}')Quand Utiliser

Idéal pour les pages HTML statiques avec peu de JavaScript. Parfait pour les blogs, sites d'actualités et pages e-commerce simples.

Avantages

- ●Exécution la plus rapide (sans surcharge navigateur)

- ●Consommation de ressources minimale

- ●Facile à paralléliser avec asyncio

- ●Excellent pour les APIs et pages statiques

Limitations

- ●Ne peut pas exécuter JavaScript

- ●Échoue sur les SPAs et contenu dynamique

- ●Peut avoir des difficultés avec les systèmes anti-bot complexes

Comment Scraper Archive.org avec du Code

Python + Requests

import requests

from bs4 import BeautifulSoup

# Définir l'URL cible pour une collection

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (contact: email@example.com)'}

try:

# Envoyer la requête avec les en-têtes

response = requests.get(url, headers=headers)

response.raise_for_status()

# Analyser le contenu HTML

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'Sans Titre'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Élément trouvé : {title} | Lien : {link}')

except Exception as e:

print(f'Une erreur est survenue : {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_archive():

with sync_playwright() as p:

# Lancer le navigateur headless

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# Naviguer vers les résultats de recherche

page.goto('https://archive.org/search.php?query=web+scraping')

# Attendre le chargement des résultats dynamiques

page.wait_for_selector('.item-ia')

# Extraire les titres des annonces

items = page.query_selector_all('.item-ia')

for item in items:

title = item.query_selector('.ttl').inner_text()

print(f'Titre extrait : {title}')

browser.close()

if __name__ == '__main__':

scrape_archive()Python + Scrapy

import scrapy

class ArchiveSpider(scrapy.Spider):

name = 'archive_spider'

start_urls = ['https://archive.org/details/movies']

def parse(self, response):

# Itérer à travers les conteneurs d'éléments

for item in response.css('.item-ia'):

yield {

'title': item.css('.ttl::text').get().strip(),

'url': response.urljoin(item.css('a::attr(href)').get()),

'views': item.css('.views::text').get()

}

# Gérer la pagination via le lien 'suivant'

next_page = response.css('a.next::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Accéder à une section média spécifique

await page.goto('https://archive.org/details/audio');

// S'assurer que les éléments sont rendus

await page.waitForSelector('.item-ia');

// Extraire les données du contexte de la page

const data = await page.evaluate(() => {

const cards = Array.from(document.querySelectorAll('.item-ia'));

return cards.map(card => ({

title: card.querySelector('.ttl')?.innerText.trim(),

id: card.getAttribute('data-id')

}));

});

console.log(data);

await browser.close();

})();Que Pouvez-Vous Faire Avec Les Données de Archive.org

Explorez les applications pratiques et les insights des données de Archive.org.

Historique des prix de la concurrence

Les détaillants analysent les anciennes versions de sites web pour comprendre comment les concurrents ont ajusté leurs prix au fil des ans.

Comment implémenter :

- 1Récupérer les instantanés des domaines concurrents via l'API Wayback Machine.

- 2Identifier les horodatages pertinents pour des examens trimestriels ou annuels.

- 3Scraper les données de prix et de catalogue de produits à partir du HTML archivé.

- 4Analyser l'évolution des prix au fil du temps pour éclairer les stratégies actuelles.

Utilisez Automatio pour extraire des données de Archive.org et créer ces applications sans écrire de code.

Que Pouvez-Vous Faire Avec Les Données de Archive.org

- Historique des prix de la concurrence

Les détaillants analysent les anciennes versions de sites web pour comprendre comment les concurrents ont ajusté leurs prix au fil des ans.

- Récupérer les instantanés des domaines concurrents via l'API Wayback Machine.

- Identifier les horodatages pertinents pour des examens trimestriels ou annuels.

- Scraper les données de prix et de catalogue de produits à partir du HTML archivé.

- Analyser l'évolution des prix au fil du temps pour éclairer les stratégies actuelles.

- Récupération de l'autorité de contenu

Les agences SEO récupèrent du contenu à haute autorité à partir de domaines expirés pour reconstruire le trafic et la valeur d'un site.

- Rechercher des domaines expirés à haute DA dans votre niche.

- Localiser les instantanés sains les plus récents sur Archive.org.

- Scraper en masse les articles originaux et les actifs multimédias.

- Republier le contenu sur de nouveaux sites pour regagner les classements de recherche historiques.

- Preuves pour litiges numériques

Les équipes juridiques utilisent des horodatages d'archives vérifiés pour prouver l'existence d'un contenu web spécifique devant les tribunaux.

- Interroger la Wayback Machine pour une URL et une plage de dates spécifiques.

- Capturer des captures d'écran pleine page et des journaux HTML bruts.

- Valider l'horodatage cryptographique de l'archive via l'API.

- Générer une pièce jointe juridique montrant l'état historique du site.

- Entraînement de LLM

Les chercheurs en AI scrapent des livres et des journaux du domaine public pour construire des corpus d'entraînement massifs et respectueux du droit d'auteur.

- Filtrer les collections d'Archive.org par droits d'utilisation 'publicdomain'.

- Utiliser l'API Metadata pour trouver des éléments aux formats 'plaintext'.

- Télécharger par lots les fichiers .txt via l'interface compatible S3.

- Nettoyer et tokenizer les données pour les intégrer dans des pipelines d'entraînement de LLM.

- Analyse de l'évolution linguistique

Les universitaires étudient comment l'usage de la langue et l'argot ont changé en scrapant des décennies de texte web.

- Définir un ensemble de mots-clés cibles ou de marqueurs linguistiques.

- Extraire le texte des archives web sur différentes décennies.

- Effectuer une analyse de sentiment et de fréquence sur le corpus extrait.

- Visualiser l'évolution des modèles de langage au fil du temps.

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Scraper Archive.org

Conseils d'experts pour extraire avec succès les données de Archive.org.

Utilisez l'API CDX Server

Au lieu de crawler l'interface utilisateur web, utilisez l'API CDX pour obtenir une liste de tous les snapshots disponibles pour une URL dans un format JSON structuré.

L'astuce 'id_' pour le contenu brut

Ajoutez 'id_' à l'horodatage dans une URL Wayback (par ex., /web/2022id_/) pour récupérer le HTML brut d'origine sans la barre de navigation d'Archive.org.

Implémentez un backoff exponentiel

Lorsque vous rencontrez une erreur 503, doublez le temps d'attente entre les requêtes pour permettre aux serveurs d'Archive.org de récupérer et éviter un bannissement permanent.

Identifiez votre crawler

Incluez une chaîne User-Agent descriptive et un e-mail de contact afin que le personnel d'Internet Archive puisse vous contacter si votre bot cause des problèmes.

Filtrez par type MIME

Lors de l'utilisation des API de métadonnées ou CDX, filtrez les résultats sur 'text/html' pour éviter de gaspiller de la bande passante avec des images, du CSS ou des fichiers binaires.

Échantillonnez vos snapshots

Pour réduire la charge et accélérer le scraping, ciblez un snapshot par mois ou par an plutôt que d'essayer de télécharger chaque version archivée.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Questions Fréquentes sur Archive.org

Trouvez des réponses aux questions courantes sur Archive.org