Comment scraper SeekaHost : Guide complet de web scraping

Découvrez comment scraper les plans d'hébergement, les tarifs et les données de domaine de SeekaHost. Extrayez les fonctionnalités d'hébergement web et le...

Protection Anti-Bot Détectée

- Cloudflare

- WAF et gestion de bots de niveau entreprise. Utilise des défis JavaScript, des CAPTCHAs et l'analyse comportementale. Nécessite l'automatisation du navigateur avec des paramètres furtifs.

- Limitation de débit

- Limite les requêtes par IP/session dans le temps. Peut être contourné avec des proxys rotatifs, des délais de requête et du scraping distribué.

- User-Agent Blocking

- robots.txt

À Propos de SeekaHost

Découvrez ce que SeekaHost offre et quelles données précieuses peuvent être extraites.

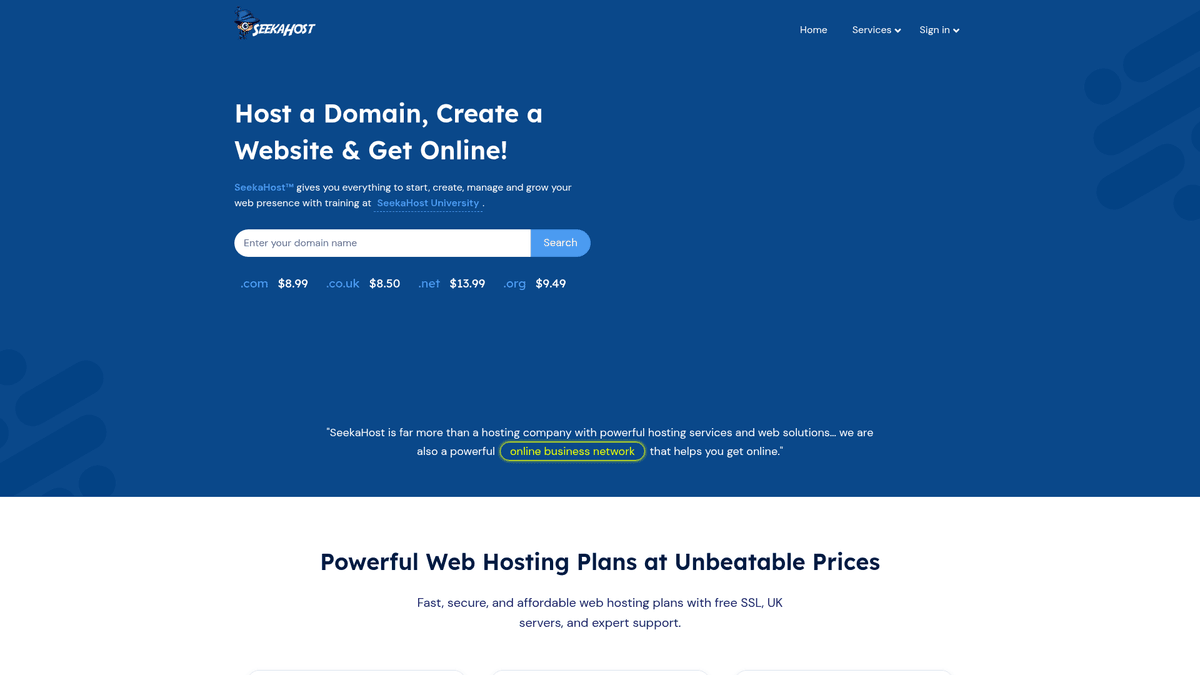

SeekaHost est un hébergeur web mondial de premier plan et un bureau d'enregistrement de domaines dont le siège est à Londres, au Royaume-Uni. Il propose une gamme diversifiée de services, notamment l'hébergement personnel, professionnel, VPS et WordPress. Il a acquis une influence significative dans la communauté SEO pour son hébergement spécialisé de Private Blog Network (PBN) et ses solutions d'IP optimisées pour le SEO.

Le site web contient des informations structurées concernant divers niveaux d'hébergement, des spécifications techniques précises comme le stockage et la bande passante, ainsi que les tarifs en temps réel pour des centaines d'extensions de domaines (TLD). Il propose également un blog complet et la SeekaHost University, qui fournissent une multitude de tutoriels techniques et de connaissances en marketing digital.

Le scraping de SeekaHost est particulièrement précieux pour l'analyse concurrentielle dans le secteur de l'hébergement. En extrayant les données de ce site, les entreprises peuvent surveiller les fluctuations de prix, comparer les fonctionnalités par rapport aux concurrents et agréger du contenu technique de haute qualité à des fins de recherche ou d'information.

Pourquoi Scraper SeekaHost?

Découvrez la valeur commerciale et les cas d'utilisation pour l'extraction de données de SeekaHost.

Benchmark concurrentiel des prix

Surveillez les points de tarification de l'hébergement WordPress et PBN de SeekaHost pour vous assurer que vos services de revendeur d'hébergement ou vos offres d'agence restent compétitifs.

Suivi des fonctionnalités PBN

Extrayez des détails spécifiques sur les classes d'IP uniques et les emplacements de serveurs, qui sont critiques pour les professionnels du SEO évaluant l'hébergement de réseaux de blogs privés.

Analyse du marché des TLD de domaines

Scrapez la page d'enregistrement de domaines pour suivre les tendances de prix sur des centaines d'extensions TLD et identifier les meilleurs moments pour les acquisitions de domaines en masse.

Insights sur la stratégie de contenu SEO

Analysez le blog de SeekaHost pour identifier les sujets de marketing numérique et les stratégies SEO qui gagnent actuellement du terrain dans le secteur.

Génération de leads pour les agences

Collectez les spécifications des plans d'hébergement pour identifier les entreprises utilisant des technologies spécifiques qui pourraient bénéficier de services de gestion ou de migration spécialisés.

Surveillance de la localisation des services

Suivez l'ajout de nouveaux centres de données et emplacements de serveurs pour comprendre la stratégie d'expansion de l'infrastructure mondiale de SeekaHost.

Défis du Scraping

Défis techniques que vous pouvez rencontrer lors du scraping de SeekaHost.

Protection WAF de Cloudflare

SeekaHost utilise la sécurité Cloudflare, ce qui peut déclencher des CAPTCHAs ou bloquer les requêtes présentant un comportement de navigation non humain ou manquant d'en-têtes de navigateur appropriés.

Rendu dynamique des données

Les tableaux de prix et les listes de spécifications techniques sont souvent chargés dynamiquement, nécessitant l'exécution de JavaScript pour extraire les données finales rendues.

Limitation de débit agressive

Des requêtes répétées et rapides vers les pages de tarification peuvent entraîner des bannissements temporaires d'IP, rendant les proxies rotatifs et les délais de type humain essentiels.

Modifications fréquentes de l'UI

En tant que site axé sur le marketing, SeekaHost met fréquemment à jour ses mises en page, ce qui peut casser les scrapers reposant sur des sélecteurs CSS statiques ou des structures HTML fixes.

Scrapez SeekaHost avec l'IA

Aucun code requis. Extrayez des données en minutes avec l'automatisation par IA.

Comment ça marche

Décrivez ce dont vous avez besoin

Dites à l'IA quelles données vous souhaitez extraire de SeekaHost. Tapez simplement en langage naturel — pas de code ni de sélecteurs.

L'IA extrait les données

Notre intelligence artificielle navigue sur SeekaHost, gère le contenu dynamique et extrait exactement ce que vous avez demandé.

Obtenez vos données

Recevez des données propres et structurées, prêtes à exporter en CSV, JSON ou à envoyer directement à vos applications.

Pourquoi utiliser l'IA pour le scraping

L'IA facilite le scraping de SeekaHost sans écrire de code. Notre plateforme alimentée par l'intelligence artificielle comprend quelles données vous voulez — décrivez-les en langage naturel et l'IA les extrait automatiquement.

How to scrape with AI:

- Décrivez ce dont vous avez besoin: Dites à l'IA quelles données vous souhaitez extraire de SeekaHost. Tapez simplement en langage naturel — pas de code ni de sélecteurs.

- L'IA extrait les données: Notre intelligence artificielle navigue sur SeekaHost, gère le contenu dynamique et extrait exactement ce que vous avez demandé.

- Obtenez vos données: Recevez des données propres et structurées, prêtes à exporter en CSV, JSON ou à envoyer directement à vos applications.

Why use AI for scraping:

- Outil de sélection visuelle: Sélectionnez facilement des tableaux de prix d'hébergement complexes et des grilles techniques à l'aide de l'interface pointer-cliquer d'Automatio sans écrire une seule ligne de code.

- Gestion native du JavaScript: Automatio affiche automatiquement les éléments dynamiques du site SeekaHost, garantissant que vous capturez les prix réels affichés aux utilisateurs.

- Gestion intelligente anti-bot: Contournez Cloudflare et les autres couches de sécurité grâce aux fonctionnalités intégrées de fingerprinting de navigateur et de rotation avancée de proxies d'Automatio.

- Planification automatisée: Configurez votre scraper pour qu'il s'exécute selon un calendrier quotidien ou hebdomadaire afin de mettre à jour automatiquement vos bases de données chaque fois que SeekaHost modifie ses tarifs ou ses fonctionnalités d'hébergement.

- Synchronisation directe avec Google Sheets: Diffusez les données d'hébergement extraites directement dans Google Sheets pour une utilisation immédiate dans vos tableaux de bord d'analyse concurrentielle ou vos modèles de tarification.

Scrapers Web No-Code pour SeekaHost

Alternatives pointer-cliquer au scraping alimenté par l'IA

Plusieurs outils no-code comme Browse.ai, Octoparse, Axiom et ParseHub peuvent vous aider à scraper SeekaHost sans écrire de code. Ces outils utilisent généralement des interfaces visuelles pour sélectionner les données, bien qu'ils puissent avoir des difficultés avec le contenu dynamique complexe ou les mesures anti-bot.

Workflow Typique avec les Outils No-Code

Défis Courants

Courbe d'apprentissage

Comprendre les sélecteurs et la logique d'extraction prend du temps

Les sélecteurs cassent

Les modifications du site web peuvent casser tout le workflow

Problèmes de contenu dynamique

Les sites riches en JavaScript nécessitent des solutions complexes

Limitations des CAPTCHAs

La plupart des outils nécessitent une intervention manuelle pour les CAPTCHAs

Blocage d'IP

Le scraping agressif peut entraîner le blocage de votre IP

Scrapers Web No-Code pour SeekaHost

Plusieurs outils no-code comme Browse.ai, Octoparse, Axiom et ParseHub peuvent vous aider à scraper SeekaHost sans écrire de code. Ces outils utilisent généralement des interfaces visuelles pour sélectionner les données, bien qu'ils puissent avoir des difficultés avec le contenu dynamique complexe ou les mesures anti-bot.

Workflow Typique avec les Outils No-Code

- Installer l'extension de navigateur ou s'inscrire sur la plateforme

- Naviguer vers le site web cible et ouvrir l'outil

- Sélectionner en point-and-click les éléments de données à extraire

- Configurer les sélecteurs CSS pour chaque champ de données

- Configurer les règles de pagination pour scraper plusieurs pages

- Gérer les CAPTCHAs (nécessite souvent une résolution manuelle)

- Configurer la planification pour les exécutions automatiques

- Exporter les données en CSV, JSON ou se connecter via API

Défis Courants

- Courbe d'apprentissage: Comprendre les sélecteurs et la logique d'extraction prend du temps

- Les sélecteurs cassent: Les modifications du site web peuvent casser tout le workflow

- Problèmes de contenu dynamique: Les sites riches en JavaScript nécessitent des solutions complexes

- Limitations des CAPTCHAs: La plupart des outils nécessitent une intervention manuelle pour les CAPTCHAs

- Blocage d'IP: Le scraping agressif peut entraîner le blocage de votre IP

Exemples de Code

import requests

from bs4 import BeautifulSoup

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

url = 'https://www.seekahost.com/personal-web-hosting/'

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

plans = soup.find_all('div', class_='pricing-table')

for plan in plans:

name = plan.find('h3').get_text(strip=True)

price = plan.find('span', class_='price').get_text(strip=True)

print(f'Plan: {name}, Price: {price}')

except Exception as e:

print(f'Error: {e}')Quand Utiliser

Idéal pour les pages HTML statiques avec peu de JavaScript. Parfait pour les blogs, sites d'actualités et pages e-commerce simples.

Avantages

- ●Exécution la plus rapide (sans surcharge navigateur)

- ●Consommation de ressources minimale

- ●Facile à paralléliser avec asyncio

- ●Excellent pour les APIs et pages statiques

Limitations

- ●Ne peut pas exécuter JavaScript

- ●Échoue sur les SPAs et contenu dynamique

- ●Peut avoir des difficultés avec les systèmes anti-bot complexes

Comment Scraper SeekaHost avec du Code

Python + Requests

import requests

from bs4 import BeautifulSoup

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

url = 'https://www.seekahost.com/personal-web-hosting/'

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

plans = soup.find_all('div', class_='pricing-table')

for plan in plans:

name = plan.find('h3').get_text(strip=True)

price = plan.find('span', class_='price').get_text(strip=True)

print(f'Plan: {name}, Price: {price}')

except Exception as e:

print(f'Error: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_seekahost():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://www.seekahost.com/blog/', wait_until='networkidle')

titles = page.locator('h4 a').all_text_contents()

for title in titles:

print(f'Post Title: {title.strip()}')

browser.close()

if __name__ == '__main__':

scrape_seekahost()Python + Scrapy

import scrapy

class SeekaHostSpider(scrapy.Spider):

name = 'seekahost_spider'

start_urls = ['https://www.seekahost.com/blog/']

def parse(self, response):

for post in response.css('div.blog-item'):

yield {

'title': post.css('h4 a::text').get().strip(),

'author': post.css('span.author a::text').get(),

'date': post.css('span.date::text').get(),

}

next_page = response.css('a.next::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.setUserAgent('Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36');

await page.goto('https://www.seekahost.com/domain-pricing/', { waitUntil: 'networkidle2' });

const pricingData = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('table tr'));

return rows.slice(1).map(row => ({

tld: row.cells[0]?.innerText.trim(),

price: row.cells[1]?.innerText.trim()

}));

});

console.log(pricingData);

await browser.close();

})();Que Pouvez-Vous Faire Avec Les Données de SeekaHost

Explorez les applications pratiques et les insights des données de SeekaHost.

Moteur de comparaison d'hébergement

Créez un outil permettant aux utilisateurs de comparer les plans d'hébergement les moins chers de SeekaHost avec d'autres fournisseurs majeurs.

Comment implémenter :

- 1Scrapez quotidiennement les fonctionnalités et les prix des plans SeekaHost.

- 2Scrapez des données similaires chez des concurrents comme Bluehost.

- 3Normalisez les champs de données tels que le stockage et le statut SSL.

- 4Mettez à jour un tableau de bord frontal avec une matrice de comparaison.

Utilisez Automatio pour extraire des données de SeekaHost et créer ces applications sans écrire de code.

Que Pouvez-Vous Faire Avec Les Données de SeekaHost

- Moteur de comparaison d'hébergement

Créez un outil permettant aux utilisateurs de comparer les plans d'hébergement les moins chers de SeekaHost avec d'autres fournisseurs majeurs.

- Scrapez quotidiennement les fonctionnalités et les prix des plans SeekaHost.

- Scrapez des données similaires chez des concurrents comme Bluehost.

- Normalisez les champs de données tels que le stockage et le statut SSL.

- Mettez à jour un tableau de bord frontal avec une matrice de comparaison.

- Intelligence de marché SEO

Analysez les tendances de prix et de disponibilité de l'hébergement spécialisé PBN (Private Blog Network).

- Extrayez les tarifs des packages d'hébergement IP de classe A, B et C.

- Suivez les changements de disponibilité de services techniques spécifiques.

- Corrélez les changements de prix avec les évolutions plus larges de l'industrie SEO.

- Générez un rapport de marché trimestriel pour les professionnels du SEO.

- Curateur de contenu automatisé

Agrégez des tutoriels techniques et des guides de gestion de serveur pour une communauté de développeurs de niche.

- Surveillez le blog de SeekaHost pour les nouveaux articles.

- Scrapez le titre, le texte intégral et la catégorie des nouveaux posts.

- Résumez le contenu à l'aide d'outils d'IA.

- Publiez les résumés dans une newsletter spécialisée ou un flux Twitter.

- Alertes pour revendeurs de domaines

Surveillez la tarification des TLD pour alerter les revendeurs lorsque les coûts d'enregistrement de domaine baissent.

- Scrapez la page de tarification des domaines toutes les 24 heures.

- Comparez les prix actuels à une base de données historique.

- Déclenchez des alertes si un TLD cible tombe en dessous d'un prix spécifique.

- Informez les revendeurs via des alertes automatisées sur Slack ou par e-mail.

Optimisez votre flux de travail avec l'Automatisation IA

Automatio combine la puissance des agents IA, de l'automatisation web et des integrations intelligentes pour vous aider a accomplir plus en moins de temps.

Conseils Pro pour Scraper SeekaHost

Conseils d'experts pour extraire avec succès les données de SeekaHost.

Prioriser les proxies résidentiels

L'utilisation d'adresses IP résidentielles réduit le risque d'être signalé par le système de sécurité de Cloudflare par rapport à l'utilisation de proxies de datacenter standards.

Utiliser l'attente d'inactivité réseau

Configurez toujours votre scraper pour qu'il attende que le réseau soit inactif afin de garantir que tous les scripts de tarification ont fini de charger avant de commencer l'extraction des données.

Aléatoriser les délais d'interaction

Ajoutez des délais variables entre les chargements de pages et les interactions pour imiter un utilisateur humain consultant les plans d'hébergement et les sections du blog.

Cibler les sitemaps XML

Pour le scraping de blog, utilisez le sitemap XML du site pour obtenir une liste directe de toutes les URL d'articles plutôt que de parcourir répétitivement la pagination principale du blog.

Vérifier les viewports mobiles

Vérifiez si les données sont présentées plus simplement sur les viewports mobiles, car certains sites d'hébergement simplifient leurs tableaux de prix pour les petits écrans.

Capturer les métadonnées et les tags

Lors du scraping du blog, extrayez les tags de catégorie et les métadonnées d'auteur pour mieux catégoriser les tendances du secteur dans votre jeu de données final.

Témoignages

Ce Que Disent Nos Utilisateurs

Rejoignez des milliers d'utilisateurs satisfaits qui ont transforme leur flux de travail

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Associés Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Questions Fréquentes sur SeekaHost

Trouvez des réponses aux questions courantes sur SeekaHost