Hugging Face scraping útmutató: A teljes technikai segédlet

Mesterfokú Hugging Face scraping: AI modellek, datasetek és metaadatok kinyerése. Tanulja meg a Cloudflare megkerülését és az adatgyűjtés automatizálását AI...

Anti-bot védelem észlelve

- Cloudflare

- Vállalati szintű WAF és botkezelés. JavaScript kihívásokat, CAPTCHA-kat és viselkedéselemzést használ. Böngészőautomatizálás szükséges rejtett beállításokkal.

- Sebességkorlátozás

- IP/munkamenet alapú kéréseket korlátoz időben. Forgó proxykkal, kéréskésleltetéssel és elosztott scrapinggel megkerülhető.

- IP-blokkolás

- Ismert adatközponti IP-ket és megjelölt címeket blokkol. Lakossági vagy mobil proxyk szükségesek a hatékony megkerüléshez.

- Bot Detection

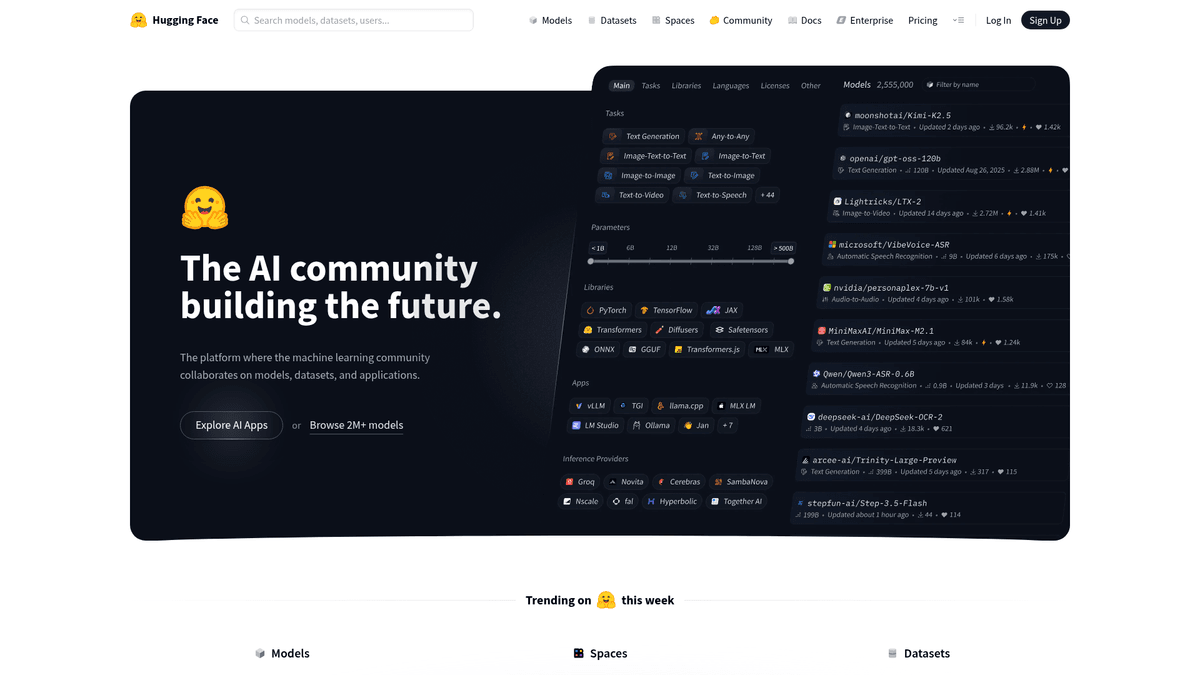

A(z) Hugging Face Névjegye

Fedezze fel, mit kínál a(z) Hugging Face és milyen értékes adatok nyerhetők ki.

A Hugging Face a machine learning és a mesterséges intelligencia vezető platformja és közössége, amelyet gyakran az AI GitHubjaként emlegetnek. Központi csomópontot biztosít, ahol a kutatók és fejlesztők megoszthatják, felfedezhetik és együttműködhetnek modelleken, dataseteken és a Spaces néven ismert demo alkalmazásokon. Olyan jelentős technológiai szereplők hozzájárulásainak ad otthont, mint a Google, a Meta és a Microsoft, a független fejlesztők hatalmas közössége mellett. A platform hatalmas mennyiségű strukturált adatot tartalmaz, beleértve a model teljesítménymutatókat, dataset konfigurációkat, felhasználói aktivitási naplókat és könyvtár-kompatibilitási információkat.

A Hugging Face scrapingje rendkívül értékes azoknak a szervezeteknek, amelyek piaci elemzést (competitive intelligence) végeznének, nyomon követnék az egyes AI frameworkök elterjedését, vagy metaadatokat gyűjtenének akadémiai kutatásokhoz. A platformról kinyert adatokkal a felhasználók monitorozhatják a felkapott modelleket, azonosíthatják a legfontosabb közreműködőket, és naprakészek maradhatnak a generatív AI gyorsan változó világában. A platform feladatok szerint csoportosítja a tartalmakat, mint például az NLP, a Computer Vision és az Audio, így kritikus fontosságú forrása a state-of-the-art machine learning megoldásoknak.

Miért Kell Scrapelni a(z) Hugging Face-t?

Fedezze fel a(z) Hugging Face-ból történő adatkinyerés üzleti értékét és felhasználási eseteit.

Piackutatás végzése a legnépszerűbb AI modellekről és frameworkökről.

Versenytárs-elemzés konkrét szervezetek modell-megjelenéseinek nyomon követésével.

Metaadatok gyűjtése az open-source AI fejlődésének tudományos vizsgálatához.

Új datasetek figyelése specifikus iparágakban, mint az egészségügy vagy pénzügy.

AI szakértők és kiemelkedő kutatócsoportok adatbázisának építése.

A machine learning model architektúrák új trendjeinek azonosítása.

Scraping Kihívások

Technikai kihívások, amelyekkel a(z) Hugging Face scrapelésekor találkozhat.

A weboldal erősen támaszkodik a JavaScript renderingre a keresési eredmények és modell-listák betöltéséhez.

A Cloudflare védelem blokkolhatja azokat az automatizált kéréseket, amelyek nem utánozzák a valódi böngésző viselkedését.

A Hugging Face szigorú sebességkorlátozást (rate limiting) alkalmaz, különösen a Hub API elérésekor.

A Model Card-ok és README-k oldalszerkezete dinamikus és jelentősen eltérhet.

A felhasználói felület gyakori változtatásai figyelmeztetés nélkül elronthatják a CSS-alapú scrapereket.

Scrapeld a Hugging Face-t AI-val

Nincs szükség kódolásra. Nyerj ki adatokat percek alatt AI-vezérelt automatizálással.

Hogyan működik

Írd le, mire van szükséged

Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a Hugging Face-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

Az AI kinyeri az adatokat

Mesterséges intelligenciánk navigál a Hugging Face-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

Kapd meg az adataidat

Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Miért érdemes AI-t használni a scrapeléshez

Az AI megkönnyíti a Hugging Face scrapelését kódírás nélkül. Mesterséges intelligenciával működő platformunk megérti, milyen adatokra van szükséged — csak írd le természetes nyelven, és az AI automatikusan kinyeri őket.

How to scrape with AI:

- Írd le, mire van szükséged: Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a Hugging Face-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

- Az AI kinyeri az adatokat: Mesterséges intelligenciánk navigál a Hugging Face-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

- Kapd meg az adataidat: Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Why use AI for scraping:

- A no-code interfész lehetővé teszi scraperek építését modellekhez és datasetekhez technikai szaktudás nélkül is.

- Automatikusan kezeli a dinamikus tartalmakat és a JavaScript renderinget extra konfiguráció nélkül.

- A felhőalapú futtatás biztosítja a scraping feladatok megbízható működését a helyi erőforrások terhelése nélkül.

- Beépített funkciók a lapozás (pagination) és a komplex elemek hatékony kiválasztásának kezelésére.

- A kinyert metaadatok könnyen exportálhatók közvetlenül Google Sheets-be, CSV-be vagy API-n keresztül.

No-Code Web Scraperek a Hugging Face számára

Kattints-és-válassz alternatívák az AI-alapú scrapeléshez

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a Hugging Face scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

Gyakori Kihívások

Tanulási görbe

A szelektorok és a kinyerési logika megértése időt igényel

Szelektorok elromlanak

A weboldal változásai tönkretehetik a teljes munkafolyamatot

Dinamikus tartalom problémák

JavaScript-gazdag oldalak komplex megoldásokat igényelnek

CAPTCHA korlátozások

A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

IP blokkolás

Az agresszív scraping az IP blokkolásához vezethet

No-Code Web Scraperek a Hugging Face számára

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a Hugging Face scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

- Böngésző bővítmény telepítése vagy regisztráció a platformon

- Navigálás a célweboldalra és az eszköz megnyitása

- Adatelemek kiválasztása kattintással

- CSS szelektorok konfigurálása minden adatmezőhöz

- Lapozási szabályok beállítása több oldal scrapeléséhez

- CAPTCHA kezelése (gyakran manuális megoldás szükséges)

- Ütemezés konfigurálása automatikus futtatásokhoz

- Adatok exportálása CSV, JSON formátumba vagy API-n keresztüli csatlakozás

Gyakori Kihívások

- Tanulási görbe: A szelektorok és a kinyerési logika megértése időt igényel

- Szelektorok elromlanak: A weboldal változásai tönkretehetik a teljes munkafolyamatot

- Dinamikus tartalom problémák: JavaScript-gazdag oldalak komplex megoldásokat igényelnek

- CAPTCHA korlátozások: A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

- IP blokkolás: Az agresszív scraping az IP blokkolásához vezethet

Kod peldak

import requests

from bs4 import BeautifulSoup

url = 'https://huggingface.co/models?sort=downloads'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Extracting model articles

models = soup.find_all('article')

for model in models:

name = model.find('h4').text.strip()

print(f'Model Name: {name}')

except Exception as e:

print(f'Error occurred: {e}')Mikor Használjuk

A legjobb statikus HTML oldalakhoz, ahol a tartalom szerver oldalon töltődik. A leggyorsabb és legegyszerűbb megközelítés, amikor JavaScript renderelés nem szükséges.

Előnyök

- ●Leggyorsabb végrehajtás (nincs böngésző overhead)

- ●Legalacsonyabb erőforrás-fogyasztás

- ●Könnyen párhuzamosítható asyncio-val

- ●Kiváló API-khoz és statikus oldalakhoz

Korlátok

- ●Nem tudja végrehajtani a JavaScriptet

- ●Nem működik SPA-knál és dinamikus tartalmaknál

- ●Problémái lehetnek összetett anti-bot rendszerekkel

How to Scrape Hugging Face with Code

Python + Requests

import requests

from bs4 import BeautifulSoup

url = 'https://huggingface.co/models?sort=downloads'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Extracting model articles

models = soup.find_all('article')

for model in models:

name = model.find('h4').text.strip()

print(f'Model Name: {name}')

except Exception as e:

print(f'Error occurred: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_hf():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://huggingface.co/models')

# Wait for model list to render

page.wait_for_selector('article')

models = page.query_selector_all('article h4')

for m in models:

print(m.inner_text())

browser.close()

scrape_hf()Python + Scrapy

import scrapy

class HuggingFaceSpider(scrapy.Spider):

name = 'hf_spider'

start_urls = ['https://huggingface.co/models']

def parse(self, response):

for model in response.css('article'):

yield {

'title': model.css('h4::text').get(),

'author': model.css('span.text-gray-400::text').get()

}

# Handle pagination

next_page = response.css('a[aria-label="Next"]::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://huggingface.co/models');

// Wait for the dynamic content to load

await page.waitForSelector('article');

const data = await page.evaluate(() => {

return Array.from(document.querySelectorAll('article h4')).map(h => h.innerText);

});

console.log(data);

await browser.close();

})();Mit Tehet a(z) Hugging Face Adataival

Fedezze fel a(z) Hugging Face adataiból származó gyakorlati alkalmazásokat és betekintéseket.

AI piaci trendek azonosítása

A vállalatok számára előnyös annak meghatározása, hogy mely AI feladatok iránt nő leginkább az érdeklődés globálisan.

Hogyan implementáljuk:

- 1Gyűjtse össze havonta a letöltési számokat az összes modelre a specifikus kategóriákon belül.

- 2Összegezze az adatokat a kategóriánkénti százalékos növekedés megállapításához.

- 3Azonosítsa a kiugró modelleket, amelyek hirtelen népszerűség-növekedést mutatnak.

Használja az Automatio-t adatok kinyeréséhez a Hugging Face-ből és építse meg ezeket az alkalmazásokat kódírás nélkül.

Mit Tehet a(z) Hugging Face Adataival

- AI piaci trendek azonosítása

A vállalatok számára előnyös annak meghatározása, hogy mely AI feladatok iránt nő leginkább az érdeklődés globálisan.

- Gyűjtse össze havonta a letöltési számokat az összes modelre a specifikus kategóriákon belül.

- Összegezze az adatokat a kategóriánkénti százalékos növekedés megállapításához.

- Azonosítsa a kiugró modelleket, amelyek hirtelen népszerűség-növekedést mutatnak.

- Versenytárs-figyelés (Competitive Intelligence)

A technológiai cégek nyomon követik a versenytársak, például a Meta vagy a Google open-source tevékenységét a versenyelőny megőrzése érdekében.

- Állítson be célzott scrapinget specifikus szervezeti profilokra a Hugging Face-en.

- Figyelje az új repository létrehozásokat vagy a meglévő model card-ok frissítéseit.

- Riasztja a termékfejlesztő csapatokat, ha egy versenytárs új modellt ad ki egy releváns területen.

- Technológiai tehetségek felkutatása (Lead Generation)

A toborzók a hozzájárulások minősége és a közösségi hatás elemzésével találhatnak rá a legkiválóbb AI kutatókra.

- Gyűjtse ki a szerzők listáját a 100 ezer feletti letöltéssel rendelkező, jól teljesítő modellekről.

- Scrape-elje a felhasználói profilokat a linkelt közösségi média vagy személyes weboldalak megtalálásához.

- Szűrjön azokra az egyénekre, akik rendszeresen népszerű open-source projektekhez járulnak hozzá.

- Akadémiai kutatási adatkészletek

A kutatók az AI kutatási ökoszisztéma együttműködő jellegét és fejlődését elemzik.

- Metaadatok kinyerése, beleértve a szerzői listákat, idézettségi számokat és szervezeti kötődéseket.

- Térképezze fel a kapcsolatokat a különböző szervezetek és az egyéni közreműködők között.

- Alkalmazzon hálózatelemzést az AI kutatási ökoszisztéma központjainak vizualizálásához.

Turbozd fel a munkafolyamatodat AI automatizalasal

Az Automatio egyesiti az AI ugynokk, a web automatizalas es az okos integraciok erejet, hogy segitsen tobbet elerni kevesebb ido alatt.

Profi Tippek a(z) Hugging Face Scrapeléséhez

Szakértői tanácsok a(z) Hugging Face-ból történő sikeres adatkinyeréshez.

Mindig ellenőrizze a 'config.json' fájlt a model repository-ban a legpontosabb technikai metaadatokért.

A blokkolások elkerülése érdekében lehetőség szerint a hivatalos Hugging Face Hub Python könyvtárat használja a manuális scraping helyett.

IP-címek rotálásához használjon kiváló minőségű lakossági (residential) proxy szolgáltatást, ha több ezer model adatait gyűjti.

Ütemezze a scraping folyamatokat csúcsidőn kívülre a gyorsabb válaszidő és a kisebb detektálási kockázat érdekében.

Tisztítsa meg a kinyert szöveges adatokat a markdown syntax és az URL-ek eltávolításával, hogy hasznosabbá tegye őket az elemzéshez.

Kövesse a Hugging Face blogot a felhasználói felület frissítéseiért, amelyek megváltoztathatják a scraper CSS szelektorait.

Velemenyek

Mit mondanak a felhasznaloink

Csatlakozz tobb ezer elegedett felhasznalohoz, akik atalakitottak a munkafolyamatukat

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Kapcsolodo Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape American Museum of Natural History (AMNH)

Gyakran ismetelt kerdesek a Hugging Face-rol

Talalj valaszokat a Hugging Face-val kapcsolatos gyakori kerdesekre